Les développeurs recherchent souvent des API robustes pour alimenter leurs applications d'IA. L'API DeepSeek-V3.1 se distingue comme une option polyvalente. Elle offre des capacités avancées de modélisation linguistique. Vous accédez à des fonctionnalités telles que les complétions de chat et les intégrations d'outils. Cet article explique comment l'utiliser étape par étape.

Tout d'abord, obtenez une clé API depuis la plateforme DeepSeek. Inscrivez-vous sur leur site et générez la clé. Avec cela, vous pouvez commencer à faire des requêtes.

Ensuite, comprenez les composants essentiels. DeepSeek-V3.1 s'appuie sur des modèles à grande échelle. Il prend en charge des contextes allant jusqu'à 128K tokens. Vous gérez efficacement des requêtes complexes. De plus, il inclut des modes de pensée pour un raisonnement plus approfondi. Au fur et à mesure, notez comment ces éléments s'assemblent.

Qu'est-ce que DeepSeek-V3.1 et pourquoi le choisir ?

DeepSeek-V3.1 représente une évolution dans les modèles d'IA. Les ingénieurs de DeepSeek-ai l'ont développé comme une architecture hybride. Le modèle totalise 671 milliards de paramètres mais n'en active que 37 milliards lors de l'inférence. Cette conception réduit les exigences de calcul tout en maintenant des performances élevées.

Vous trouverez deux variantes principales : DeepSeek-V3.1-Base et le DeepSeek-V3.1 complet. La version de base sert de fondation pour une formation ultérieure. Elle a subi une extension de contexte long en deux phases. Dans la première phase, l'entraînement a été étendu à 630 milliards de tokens pour un contexte de 32K. Ensuite, la deuxième phase a ajouté 209 milliards de tokens pour un contexte de 128K. Des documents longs supplémentaires ont enrichi l'ensemble de données.

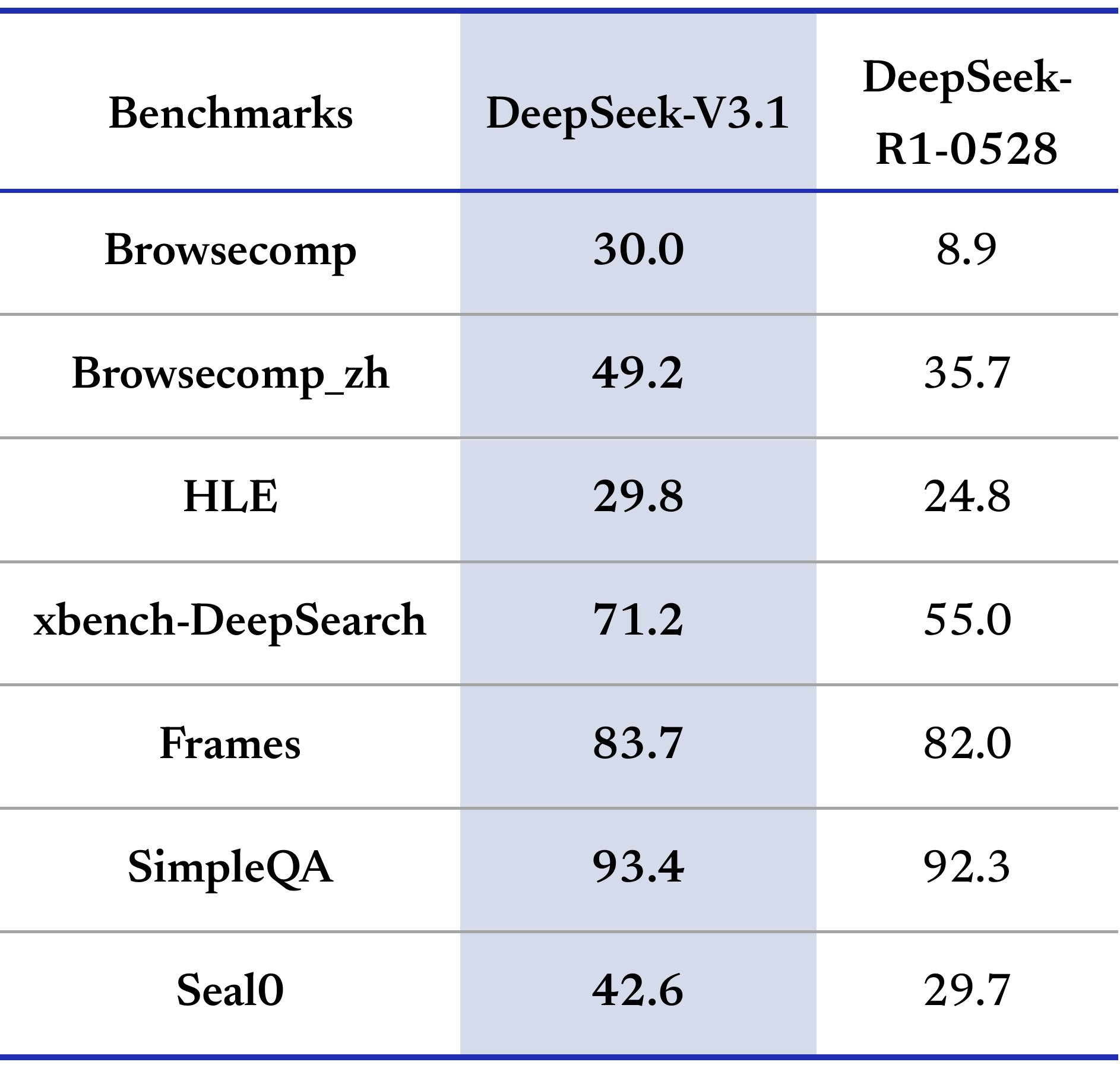

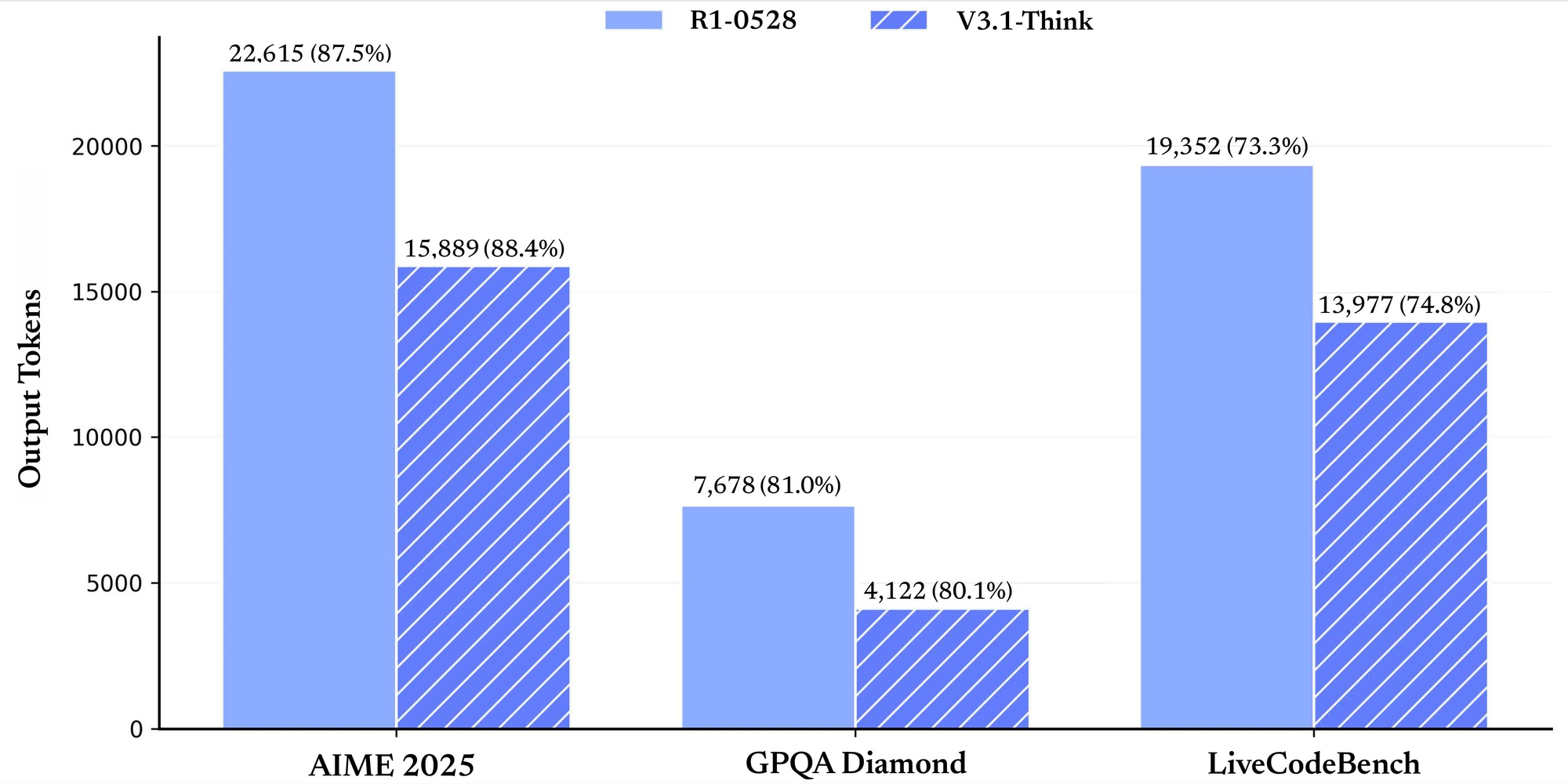

Les benchmarks de performance soulignent ses atouts. Pour les tâches générales, il obtient un score de 91,8 sur MMLU-Redux en mode non-pensée et de 93,7 en mode pensée. Sur GPQA-Diamond, il atteint respectivement 74,9 et 80,1. Dans les évaluations liées au code, LiveCodeBench donne 56,4 en mode non-pensée et 74,8 en mode pensée. Les benchmarks mathématiques comme AIME 2024 montrent 66,3 et 93,1. Ces chiffres démontrent sa fiabilité dans tous les domaines.

Pourquoi choisir l'API DeepSeek-V3.1 ? Elle excelle dans les tâches d'agent et l'appel de fonctions. Vous l'intégrez pour les agents de recherche ou les agents de code. Comparée à d'autres API, elle offre des prix rentables et des fonctionnalités de compatibilité. En conséquence, les équipes l'adoptent pour des solutions d'IA évolutives. Pour passer à la configuration, préparez votre environnement avec soin.

Démarrer avec l'intégration de l'API DeepSeek-V3.1

Vous commencez par configurer votre environnement de développement. Installez les bibliothèques nécessaires. Pour Python, utilisez pip pour ajouter les requêtes ou les SDK compatibles. Les points de terminaison de l'API DeepSeek-V3.1 suivent les protocoles HTTP standard. L'URL de base est https://api.deepseek.com.

Générez votre clé API depuis le tableau de bord. Stockez-la en toute sécurité dans des variables d'environnement. Par exemple, définissez DEEPSEEK_API_KEY dans votre shell. Maintenant, faites votre première requête. Utilisez le point de terminaison de complétion de chat. Envoyez une requête POST à /chat/completions.

Incluez les en-têtes avec Authorization: Bearer votre_clé. Le corps contient le modèle comme "deepseek-chat", un tableau de messages et des paramètres comme max_tokens. Une requête simple ressemble à ceci :

import requests

url = "https://api.deepseek.com/chat/completions"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"model": "deepseek-chat",

"messages": [{"role": "user", "content": "Bonjour, DeepSeek-V3.1!"}],

"max_tokens": 100

}

response = requests.post(url, headers=headers, json=data)

print(response.json())

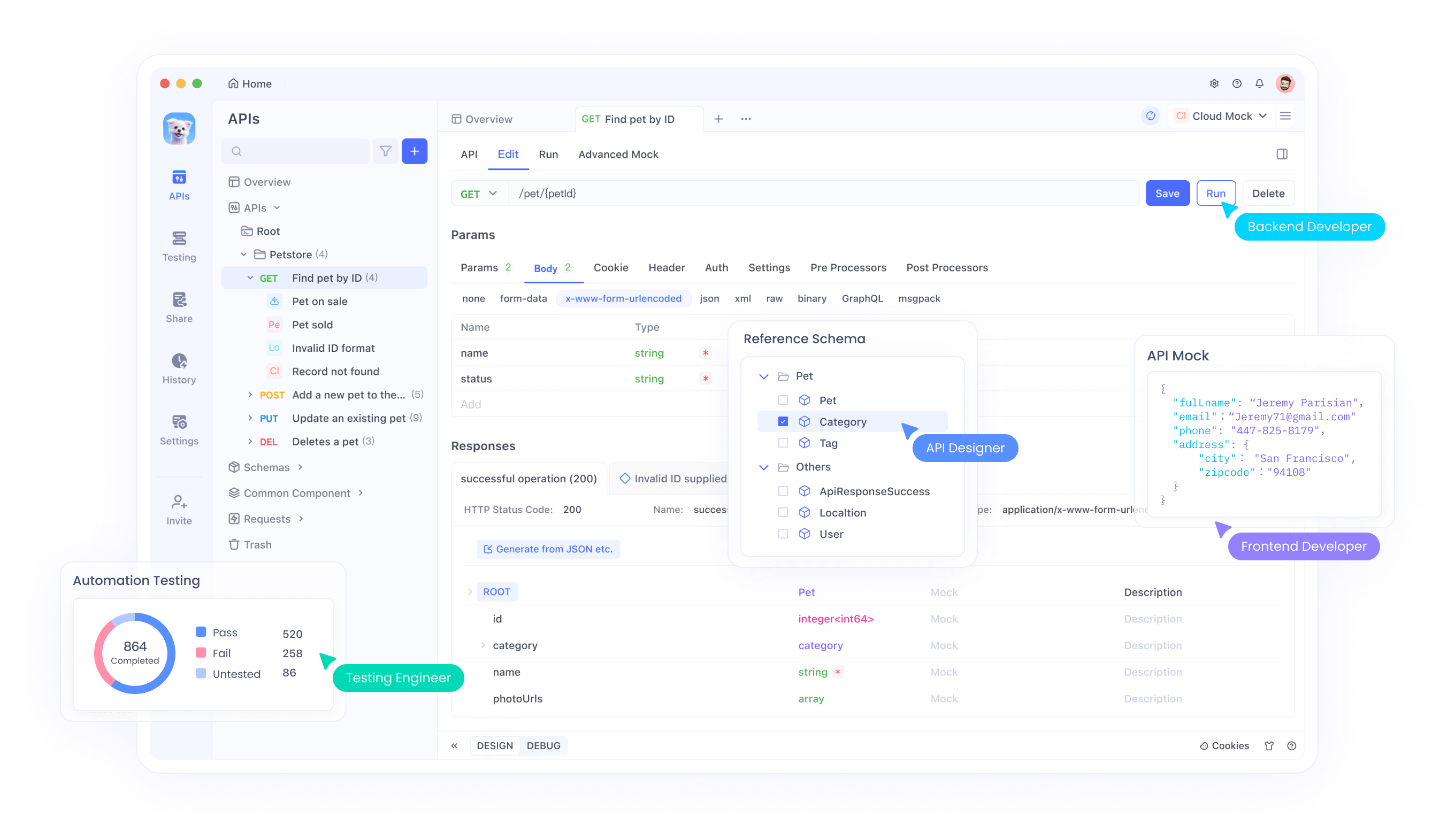

Ce code récupère une réponse. Vérifiez le champ de contenu pour la sortie. Si des erreurs se produisent, vérifiez la clé et la charge utile. De plus, testez avec Apidog. Importez le point de terminaison et simulez des appels. Apidog visualise les réponses, facilitant le débogage.

Explorez les options de modèle. DeepSeek-chat convient aux chats généraux. DeepSeek-reasoner gère les tâches de raisonnement. Sélectionnez en fonction de vos besoins. Au fur et à mesure, incorporez le streaming pour des sorties en temps réel. Définissez `stream` sur `true` dans la requête. Traitez les morceaux en conséquence.

La sécurité compte aussi. Utilisez toujours HTTPS. Limitez l'exposition des clés. Faites pivoter les clés périodiquement. Une fois les bases couvertes, passez aux fonctionnalités avancées comme l'appel de fonctions.

Maîtriser l'appel de fonctions dans l'API DeepSeek-V3.1

L'appel de fonctions améliore l'API DeepSeek-V3.1. Vous définissez des outils que le modèle invoque. Cela permet des interactions dynamiques, comme la récupération de données météorologiques.

Définissez les outils dans la requête. Chaque outil a un type "function", un nom, une description et des paramètres. Les paramètres utilisent le schéma JSON. Par exemple, un outil `get_weather` :

{

"type": "function",

"function": {

"name": "get_weather",

"description": "Obtenir la météo actuelle",

"parameters": {

"type": "object",

"properties": {

"location": {"type": "string", "description": "Nom de la ville"}

},

"required": ["location"]

}

}

}

Incluez ceci dans le tableau `tools` de votre requête de complétion de chat. Le modèle analyse le message de l'utilisateur. Si pertinent, il renvoie des `tool_calls` dans la réponse. Chaque appel a un `id`, un `name` et des `arguments`.

Gérez l'appel. Exécutez la fonction localement. Pour `get_weather`, interrogez une API externe ou des données simulées. Ajoutez le résultat comme un message d'outil :

{

"role": "tool",

"tool_call_id": "id_appel_ici",

"content": "Température : 24°C"

}

Renvoyez les messages mis à jour. Le modèle génère une réponse finale.

Utilisez le mode strict pour une meilleure validation. Définissez `strict` sur `true` et utilisez l'URL de base bêta. Cela applique la conformité au schéma. Les types pris en charge incluent `string`, `number`, `array`. Évitez les champs non pris en charge comme `minLength`.

Les bonnes pratiques incluent des descriptions claires. Testez les outils avec Apidog pour simuler les réponses. Surveillez les erreurs dans les arguments. En conséquence, vos applications deviennent plus interactives. Ensuite, examinez la compatibilité avec d'autres écosystèmes.

Tirer parti de la compatibilité de l'API Anthropic dans DeepSeek-V3.1

L'API DeepSeek-V3.1 prend en charge le format Anthropic. Cela vous permet d'utiliser les SDK Anthropic de manière transparente. Définissez l'URL de base sur https://api.deepseek.com/anthropic.

Installez le SDK Anthropic : `pip install anthropic`. Configurez l'environnement :

export ANTHROPIC_BASE_URL=https://api.deepseek.com/anthropic

export ANTHROPIC_API_KEY=VOTRE_CLE_DEEPSEEK

Créez des messages :

import anthropic

client = anthropic.Anthropic()

message = client.messages.create(

model="deepseek-chat",

max_tokens=1000,

system="Vous êtes utile.",

messages=[{"role": "user", "content": [{"type": "text", "text": "Salut"}]}]

)

print(message.content)

Cela fonctionne comme Anthropic mais utilise les modèles DeepSeek. Champs pris en charge : `max_tokens`, `temperature` (0-2.0), `tools`. Ignorés : `top_k`, `cache_control`.

Des différences existent. Pas de support d'image ou de document. Les options de choix d'outils sont limitées. Utilisez ceci pour migrer depuis Anthropic. Testez avec Apidog pour comparer les réponses. Par conséquent, vous étendez votre boîte à outils sans réécrire de code.

Comprendre l'architecture du modèle et le tokenizer de DeepSeek-V3.1

DeepSeek-V3.1-Base constitue le cœur. Il utilise une conception hybride pour l'efficacité. La longueur du contexte atteint 128K, idéal pour les documents longs.

La formation a impliqué des phases étendues. Premièrement, 32K avec 630 milliards de tokens. Puis, 128K avec 209 milliards. Le format FP8 assure la compatibilité.

Configuration du tokenizer : `add_bos_token true`, `model_max_length 131072`. Token BOS "<|début de phrase|>", EOS "<|fin de phrase|>". Le modèle de chat gère les rôles comme Utilisateur, Assistant, balises de pensée.

Appliquez des modèles pour les conversations. Pour le mode de pensée, enveloppez le raisonnement dans des balises. Cela améliore les performances dans les tâches complexes.

Vous chargez le modèle via Hugging Face. Utilisez `from_pretrained("deepseek-ai/DeepSeek-V3.1")`. Tokenisez les entrées avec soin. Surveillez le nombre de tokens pour rester dans les limites. Ainsi, vous optimisez la précision.

Tarification et gestion des coûts pour l'API DeepSeek-V3.1

La tarification affecte l'adoption. L'API DeepSeek-V3.1 facture par million de tokens. Modèles : deepseek-chat et deepseek-reasoner.

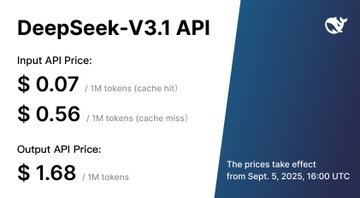

À partir du 5 septembre 2025, 16h00 UTC : Les deux modèles coûtent 0,07 $ pour l'entrée avec cache (cache hit), 0,56 $ pour l'entrée sans cache (cache miss), 1,68 $ pour la sortie.

Avant cela, standard (00:30-16:30 UTC) : deepseek-chat 0,07 $ hit, 0,27 $ miss, 1,10 $ sortie ; reasoner 0,14 $ hit, 0,55 $ miss, 2,19 $ sortie. Réduction (16:30-00:30) : environ la moitié des prix.

Aucun niveau gratuit n'est mentionné. Calculez les coûts : Estimez les tokens par requête. Utilisez la mise en cache pour les entrées répétées. Optimisez les invites pour réduire les tokens.

Suivez l'utilisation dans le tableau de bord. Définissez des budgets. Avec Apidog, simulez les appels pour prévoir les coûts. Par conséquent, gérez les dépenses efficacement.

Bonnes pratiques et dépannage pour l'API DeepSeek-V3.1

Suivez les directives pour réussir. Créez des invites concises. Fournissez du contexte dans les messages.

Surveillez la latence. Les contextes longs ralentissent les réponses. Fractionnez les entrées si possible.

Sécurisez les données : Évitez d'envoyer des informations sensibles.

Dépannage : Vérifiez les codes d'état. 401 signifie clé invalide. 429 trop de requêtes.

Mettez à jour régulièrement les SDK. Lisez la documentation pour les changements.

Mise à l'échelle : Regroupez les requêtes si pris en charge. Utilisez l'asynchrone pour le parallélisme.

Les forums communautaires aident. Partagez vos expériences.

En appliquant ces conseils, vous réaliserez des intégrations fiables.

Conclusion : Élevez vos projets d'IA avec l'API DeepSeek-V3.1

Vous savez maintenant comment utiliser efficacement l'API DeepSeek-V3.1. De la configuration aux fonctionnalités avancées, elle donne du pouvoir aux développeurs. Intégrez Apidog pour des flux de travail plus fluides. Commencez à construire dès aujourd'hui et constatez l'impact.