Sora 2 de OpenAI se destaca como una herramienta potente que combina indicaciones de texto con sincronización de audio avanzada para producir clips realistas. Los desarrolladores buscan con frecuencia formas de aprovechar esta tecnología evitando distracciones visuales como las marcas de agua, que pueden restar valor a las aplicaciones profesionales. Afortunadamente, el uso de la API de Sora 2 ofrece un camino hacia resultados más limpios, especialmente cuando se integra con herramientas robustas de gestión de API.

Este artículo explora los aspectos técnicos de Sora 2, centrándose en la utilización de la API y las estrategias para eliminar las marcas de agua. Aprenderá cómo configurar su entorno, ejecutar llamadas a la API y aplicar métodos de posprocesamiento. Además, la guía incorpora ejemplos prácticos y consejos de optimización para mejorar sus proyectos.

Comprendiendo Sora 2 y sus capacidades

OpenAI lanzó Sora 2 el 30 de septiembre de 2025, marcando un avance significativo en la tecnología de generación de video. Este modelo se basa en el Sora original al incorporar simulaciones físicas más precisas, animaciones realistas y audio sincronizado. Por ejemplo, Sora 2 renderiza con precisión escenarios complejos como una pelota de baloncesto rebotando en el tablero o una gimnasta realizando rutinas intrincadas. Los desarrolladores aprovechan estas características para crear contenido dinámico para aplicaciones en entretenimiento, educación y marketing.

Sora 2 opera como un modelo basado en difusión que transforma indicaciones de texto en videos de hasta 20 segundos de duración, con resoluciones que alcanzan 1080p en niveles superiores. Admite estilos que van desde el realismo cinematográfico hasta la estética del anime. Sin embargo, las salidas oficiales de la aplicación y el sitio web de Sora a menudo incluyen marcas de agua visibles para indicar la generación por IA, según las políticas de IA responsable de OpenAI. Estas marcas de agua aparecen como superposiciones en movimiento o metadatos incrustados, lo que puede limitar la usabilidad en entornos comerciales.

Al pasar a la versión API, Sora 2 ofrece mayor flexibilidad. La API, disponible en vista previa para desarrolladores, permite el acceso programático a los puntos finales de generación sin las limitaciones de la aplicación para el consumidor. Se accede a ella a través de la plataforma de OpenAI, lo que requiere una clave API y, potencialmente, una suscripción Pro para funciones mejoradas como resoluciones más altas y la ausencia de marcas de agua integradas en ciertas configuraciones. Según la documentación para desarrolladores, los puntos finales de la API se centran en solicitudes de texto a video, donde se especifican parámetros como la indicación, la duración y el estilo.

Plataformas como Replicate y ComfyUI ofrecen versiones alojadas de la API de Sora 2, lo que permite salidas sin marcas de agua a través de sus interfaces. Estas alternativas se integran a la perfección con herramientas como Apidog, que maneja la autenticación y el formato de las solicitudes. Al usar la API, se evita la marca de agua predeterminada aplicada en el nivel de aplicación gratuito, aunque algunas implementaciones aún incrustan metadatos. No obstante, este enfoque le permite generar videos limpios adaptados a sus necesidades.

Accediendo a la API de Sora 2: Requisitos previos y configuración

Antes de generar videos, debe asegurar el acceso a la API de Sora 2. OpenAI implementa la disponibilidad de la API para desarrolladores con cuentas activas, a menudo priorizando a aquellos con suscripciones Pro o empresariales. Comience iniciando sesión en la plataforma de desarrolladores de OpenAI en platform.openai.com. Allí, cree una clave API en la sección de claves API. Asegúrese de que su cuenta cumpla con los requisitos para el acceso anticipado a Sora 2, lo que puede implicar unirse a una lista de espera o verificar su caso de uso.

Una vez aprobado, configure su entorno de desarrollo. Instale las bibliotecas necesarias, como el SDK de OpenAI para Python, usando pip: pip install openai. Esta biblioteca simplifica las interacciones con la API. Para los usuarios de JavaScript, el paquete de Node.js ofrece una funcionalidad similar. Además, si opta por hosts de terceros como Replicate, regístrese en su sitio y obtenga un token de API.

La seguridad juega un papel crucial aquí. Siempre almacene su clave API en variables de entorno en lugar de codificarla directamente, para evitar su exposición. Por ejemplo, en Python, use os.environ['OPENAI_API_KEY'] = 'su-clave'. Esta práctica protege sus credenciales durante proyectos colaborativos.

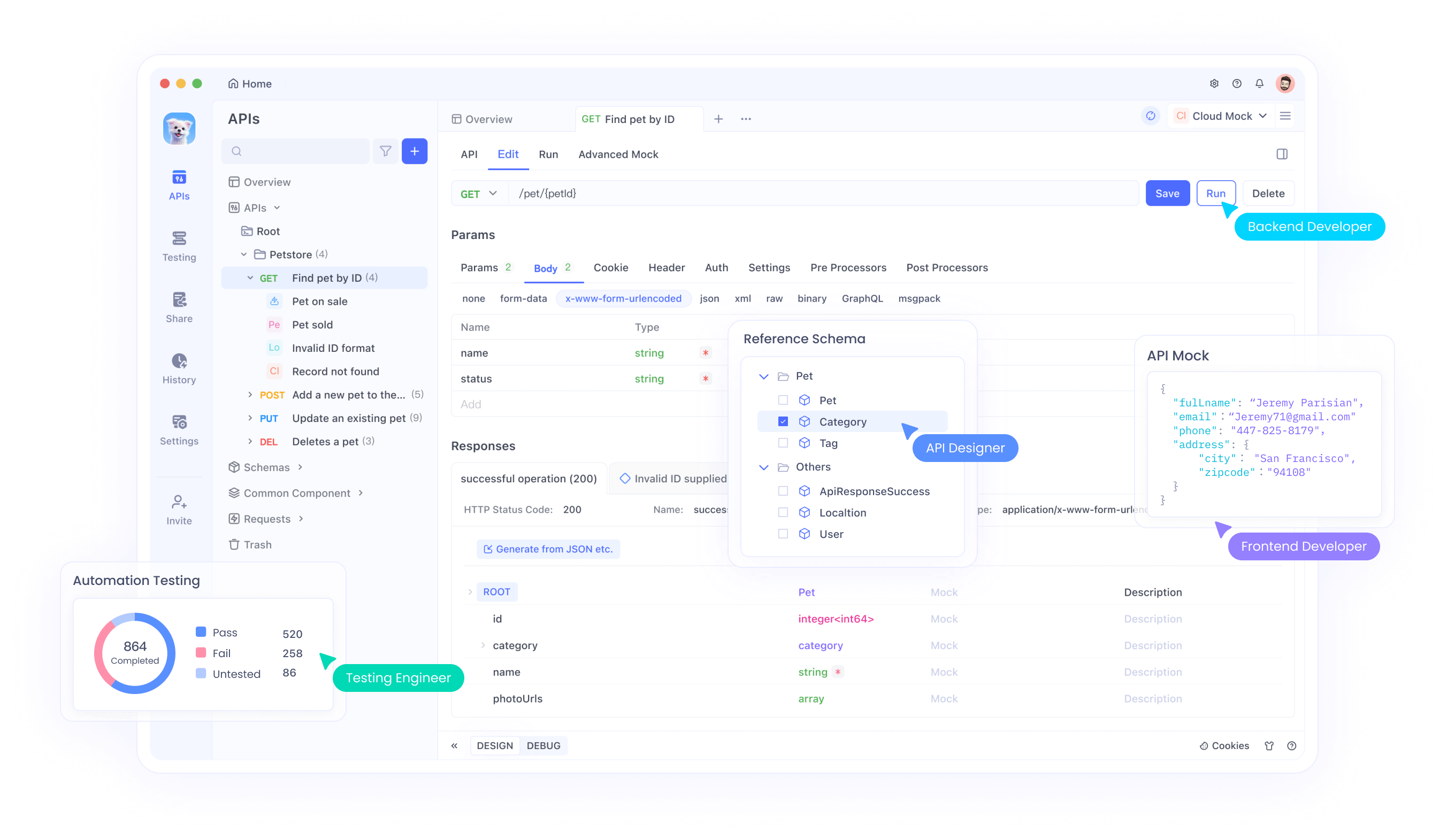

Ahora, integre Apidog en su configuración. Como cliente API integral, Apidog se destaca en la prueba y documentación de los puntos finales de OpenAI, incluido Sora 2. Descargue e instale Apidog desde su sitio web oficial. Al iniciar, cree un nuevo proyecto e importe la especificación de la API de OpenAI pegando la URL del esquema OpenAPI o cargando un archivo JSON. Apidog genera automáticamente puntos finales para modelos como Sora 2, lo que le permite personalizar las solicitudes con parámetros como el nombre del modelo ("sora-2") y las indicaciones de entrada.

La interfaz de Apidog se asemeja a Postman, pero ofrece funciones avanzadas como pruebas automatizadas y mocking. Agregue su clave API al encabezado de autorización, típicamente como un token Bearer. Pruebe un punto final simple, como la lista de modelos, para verificar la conectividad: Envíe una solicitud GET a /v1/models y confirme que Sora 2 aparece en la respuesta. Este paso asegura que su configuración funcione correctamente antes de proceder a la generación de video.

Configurando Apidog para solicitudes a la API de Sora 2

Con su entorno listo, se sumerge en las capacidades de Apidog para Sora 2. Cree una nueva colección de API dedicada a la generación de video. Dentro de ella, agregue una solicitud POST al punto final de Sora 2, generalmente /v1/video/generations o similar, según la documentación de OpenAI. Establezca el cuerpo de la solicitud en formato JSON.

Los parámetros clave incluyen:

model: Especifique "sora-2" para invocar la última versión.prompt: Una descripción de texto detallada, por ejemplo, "Un gato realizando un triple axel sobre hielo con audio de maullidos sincronizados".duration: En segundos, hasta 20.resolution: Opciones como "720p" o "1080p" para usuarios Pro.style: "realistic" (realista), "cinematic" (cinemático) o "anime".

Apidog le permite parametrizarlos para su reutilización. Por ejemplo, use variables como {{prompt}} para probar múltiples escenarios rápidamente. Además, habilite variables de entorno para alternar entre claves API de prueba y producción.

Para manejar respuestas asincrónicas, ya que la generación de video puede llevar minutos, configure webhooks o sondeos en Apidog. Configure un script para verificar el estado de la generación a través de una solicitud GET al punto final del ID del trabajo. Esta automatización ahorra tiempo y garantiza que recupere los videos completados de manera eficiente.

Además, Apidog admite scripting con JavaScript para acciones previas y posteriores a la solicitud. Escriba un script para validar la longitud del prompt antes de enviarlo, evitando errores. Por ejemplo:

if (pm.variables.get('prompt').length > 1000) {

throw new Error('Prompt too long');

}

Esta salvaguarda técnica mejora la fiabilidad. Una vez configurado, envíe su primera solicitud y supervise la respuesta, que típicamente incluye una URL de video o un archivo codificado en base64.

Generando videos con la API de Sora 2: Ejemplos paso a paso

Ahora ejecuta generaciones reales. Comience con una indicación básica para probar las aguas. En Apidog, rellene el cuerpo:

{

"model": "sora-2",

"prompt": "Una bulliciosa calle de la ciudad al anochecer con peatones y coches, incluyendo sonidos ambientales de la calle.",

"duration": 10,

"resolution": "720p"

}

Envíe la solicitud. La API la procesa y devuelve un ID de trabajo. Sondee el punto final de estado cada 10 segundos hasta que esté "completed" (completado). Recupere la URL del video de la respuesta.

Para un uso avanzado, incorpore cameos, una función que permite elementos del mundo real como la semejanza de una persona. Cargue un video de referencia a través de una solicitud de formulario multipart en Apidog. El cuerpo podría verse así:

{

"model": "sora-2",

"prompt": "La persona subida dando una charla TED sobre IA.",

"cameo_video": "base64-encoded-video",

"audio_sync": true

}

Apidog maneja las cargas de archivos de forma nativa, lo que lo hace perfecto.

Sin embargo, las salidas aún pueden contener marcas de agua si se utiliza el nivel estándar. El acceso a la API Pro, disponible para los suscriptores de ChatGPT Pro, a menudo ofrece opciones para descargas sin marcas de agua. Verifique su nivel de suscripción; la actualización lo desbloquea.

Para optimizar los prompts, experimente con los detalles. Agregue descriptores de física como "salto que desafía la gravedad" para aprovechar las fortalezas de simulación de Sora 2. Rastree las métricas de uso en los análisis de Apidog para mantenerse dentro de los límites de velocidad, típicamente 500 generaciones por mes para acceso prioritario.

Estrategias para eliminar marcas de agua de los videos de Sora 2

Incluso con acceso a la API, algunos videos incluyen marcas de agua. Esto se aborda mediante el posprocesamiento. Primero, comprenda los tipos de marcas de agua: superposiciones visibles (logotipos en movimiento) y metadatos invisibles (estándares C2PA).

Para la eliminación visible, emplee herramientas basadas en IA. Vmake AI, un servicio en línea gratuito, utiliza aprendizaje profundo para detectar y borrar marcas de agua en movimiento. Suba su video de Sora 2, seleccione el área de la marca de agua y procese. La herramienta conserva la calidad al pintar las secciones eliminadas con píxeles contextuales.

Alternativamente, use bibliotecas de código abierto como OpenCV en Python. Cargue el video:

import cv2

cap = cv2.VideoCapture('sora_video.mp4')

width = int(cap.get(cv2.CAP_PROP_FRAME_WIDTH))

height = int(cap.get(cv2.CAP_PROP_FRAME_HEIGHT))

fps = cap.get(cv2.CAP_PROP_FPS)

out = cv2.VideoWriter('clean_video.mp4', cv2.VideoWriter_fourcc(*'mp4v'), fps, (width, height))

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

# Detectar y enmascarar la marca de agua (lógica personalizada, por ejemplo, recorte de ROI o modelo de ML)

clean_frame = remove_watermark(frame) # Implementar función

out.write(clean_frame)

cap.release()

out.release()

Implemente remove_watermark usando un modelo preentrenado de Hugging Face, como una red de segmentación entrenada en conjuntos de datos de marcas de agua.

Para los metadatos, elimine las etiquetas C2PA con FFmpeg: ffmpeg -i input.mp4 -codec copy -bsf:v "filter_units=remove_types=6" output.mp4. Este comando elimina filtros de flujo de bits específicos sin recodificar.

Sin embargo, considere las implicaciones legales. Los términos de OpenAI prohíben la manipulación de las señales de procedencia, pero para uso interno o donde esté permitido, estos métodos son aplicables. Siempre atribuya el contenido generado por IA de forma ética.

Al integrar esto en los flujos de trabajo de Apidog, automatice el posprocesamiento mediante scripts. Después de recuperar la URL del video, descargue y ejecute el código de eliminación.

Técnicas avanzadas para la optimización de la API de Sora 2

Para mejorar su uso, encadene múltiples llamadas a la API. Genere un video base y luego remézclelo con una indicación de seguimiento: "Extiende la escena anterior con un giro dramático". Use el ID del trabajo como referencia en solicitudes posteriores.

Además, incorpore mejoras de audio. Sora 2 sincroniza los efectos de sonido automáticamente, pero usted puede ajustarlos especificando "incluir música de fondo orquestal" en las indicaciones.

La optimización del rendimiento implica el procesamiento por lotes de solicitudes. Apidog admite colecciones para ejecutar múltiples pruebas simultáneamente, ideal para experimentos de prompts A/B.

Además, controle los costos. El precio de la API de Sora 2 comienza en $0.05 por segundo de video para el estándar, con tarifas más altas para Pro para funciones premium. Realice un seguimiento a través del panel de OpenAI y configure alertas en Apidog.

Para la escalabilidad, implemente en entornos de producción. Utilice funciones en la nube como AWS Lambda para manejar las llamadas a la API, activadas por las entradas del usuario. Asegúrelas con puertas de enlace de API.

Mejores prácticas y solución de problemas para Sora 2 con Apidog

Adopte estas prácticas para maximizar la eficiencia. Primero, valide rigurosamente las entradas: los prompts deficientes producen videos de calidad inferior. Use las pruebas de aserción de Apidog para verificar los códigos de estado de respuesta (200 para éxito).

Solucione problemas comunes: Si la autenticación falla, regenere su clave. Para los límites de velocidad, implemente una retirada exponencial en los scripts:

import time

def api_call_with_retry(func, max_retries=5):

for attempt in range(max_retries):

try:

return func()

except Exception as e:

if 'rate_limit' in str(e):

time.sleep(2 ** attempt)

else:

raise

¿Errores de red? Cambie a la configuración de proxy de Apidog.

Además, colabore compartiendo proyectos de Apidog a través de enlaces, asegurando la alineación del equipo en las configuraciones de Sora 2.

Casos de estudio: Aplicaciones reales de Sora 2 sin marcas de agua

Considere una empresa de marketing que utiliza la API de Sora 2 para crear clips publicitarios. Generan videos sin marcas de agua para presentaciones de clientes, integrando Apidog para iteraciones rápidas.

En educación, los maestros producen lecciones animadas. Después de la eliminación, los videos se incrustan limpiamente en plataformas como YouTube.

Estos ejemplos ilustran la versatilidad de Sora 2 cuando no está obstaculizado por marcas de agua.

Perspectivas futuras y actualizaciones para la API de Sora 2

OpenAI continúa evolucionando Sora 2, con expansiones planificadas como duraciones más largas y mejores integraciones. Manténgase actualizado a través de su blog.

Apidog agrega regularmente funciones, como la generación de solicitudes asistida por IA, complementando los avances de Sora 2.

En resumen, dominar Sora 2 sin marcas de agua implica acceso a la API, facilitación de Apidog y técnicas de eliminación específicas. Implemente estos pasos para producir videos de calidad profesional de manera eficiente.