Los desarrolladores integran cada vez más modelos avanzados de IA en las aplicaciones para crear contenido multimedia atractivo. Los modelos Sora 2 y Sora 2 Pro de OpenAI representan avances significativos en la tecnología de generación de video. Estos modelos permiten a los usuarios producir videos ricamente detallados con audio sincronizado, a partir de simples indicaciones de texto o imágenes de referencia. Además, admiten el procesamiento asíncrono, lo que permite a las aplicaciones manejar tareas de generación sin bloquear otras operaciones.

Sora 2 se enfoca en la velocidad y la flexibilidad, lo que lo hace adecuado para la creación rápida de prototipos y la experimentación. En contraste, Sora 2 Pro ofrece resultados de mayor calidad, ideales para entornos de producción donde la precisión visual es importante. Ambos modelos operan a través de la API de OpenAI, proporcionando puntos finales que agilizan la creación, la verificación de estado y la recuperación de videos.

A medida que los desarrolladores exploran estos modelos, descubren que pequeños ajustes en las indicaciones o parámetros producen mejoras sustanciales en la calidad de la salida. Por lo tanto, comprender las capacidades centrales sienta las bases para una integración exitosa.

Comprensión de Sora 2 y Sora 2 Pro: Capacidades y diferencias clave

OpenAI diseñó Sora 2 como un modelo insignia de generación de video que transforma descripciones en lenguaje natural o imágenes en clips dinámicos con audio. El modelo destaca en el mantenimiento de la consistencia física, la coherencia temporal y la conciencia espacial en todos los fotogramas. Por ejemplo, simula un movimiento realista, como objetos interactuando en un espacio 3D, y asegura que el audio se sincronice perfectamente con los elementos visuales.

Sora 2 Pro se basa en esta base, pero mejora la fidelidad y la estabilidad. Los desarrolladores eligen Sora 2 Pro cuando necesitan resultados pulidos, como metraje cinematográfico o videos de marketing. La variante Pro maneja escenas complejas con mayor precisión, reduciendo los artefactos en la iluminación, las texturas y los movimientos. Sin embargo, esto tiene el costo de tiempos de renderizado más largos y mayores gastos.

Las diferencias clave surgen en las métricas de rendimiento. Sora 2 prioriza la entrega rápida, a menudo completando las generaciones en minutos para resoluciones básicas. Sora 2 Pro, por otro lado, invierte más recursos computacionales para refinar los detalles, lo que lo hace preferible para aplicaciones de alto riesgo. Además, las resoluciones admitidas varían: Sora 2 limita las salidas a 1280x720 o 720x1280, mientras que Sora 2 Pro se extiende a 1792x1024 o 1024x1792 para imágenes más nítidas.

Ambos modelos tienen limitaciones. Rechazan indicaciones que involucren personas reales, contenido con derechos de autor o material inapropiado. Las imágenes de entrada no pueden incluir rostros humanos, y las generaciones se adhieren a las políticas de contenido para audiencias menores de 18 años. En consecuencia, los desarrolladores deben elaborar las indicaciones cuidadosamente para evitar rechazos y garantizar el cumplimiento.

Al comparar estos modelos, los desarrolladores seleccionan el apropiado según las necesidades del proyecto. A continuación, la configuración del acceso se convierte en la prioridad.

Primeros pasos con la API de Sora 2 Pro: Configuración y autenticación

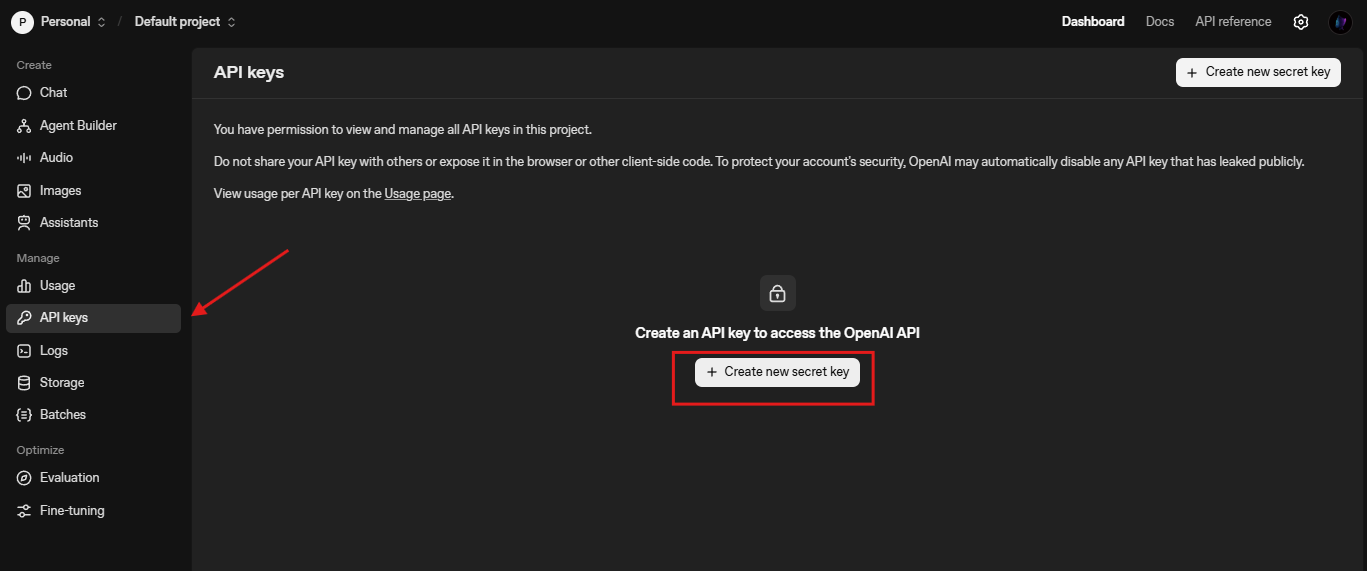

Los desarrolladores comienzan creando una cuenta de OpenAI. Después del registro, solicitan acceso a Sora, ya que la API permanece en vista previa y requiere aprobación. El proceso de solicitud implica describir los casos de uso y aceptar las pautas de IA responsable. Una vez aprobado, OpenAI otorga claves API a través del panel de control.

La autenticación se basa en tokens de portador. Los desarrolladores incluyen la clave API en los encabezados de las solicitudes para todos los puntos finales. Por seguridad, almacenan las claves en variables de entorno en lugar de codificarlas. Herramientas como la biblioteca dotenv de Python facilitan esta práctica.

En Python, los desarrolladores instalan el SDK de OpenAI con `pip install openai`. Luego inicializan el cliente:

import os

from openai import OpenAI

client = OpenAI(api_key=os.getenv("OPENAI_API_KEY"))

Los desarrolladores de JavaScript usan `npm install openai` e importan la biblioteca de manera similar. Esta configuración permite llamadas al punto final de videos, donde residen Sora 2 y Sora 2 Pro.

Los límites de velocidad y los niveles influyen en el acceso. Los niveles gratuitos no admiten modelos Sora; los niveles de pago comienzan en el Nivel 1 con un mínimo de solicitudes por minuto (RPM). A medida que aumenta el uso, los niveles se actualizan automáticamente, ampliando los límites. Los desarrolladores monitorean el uso en el panel para evitar la limitación.

Con la autenticación configurada, los desarrolladores proceden a explorar los puntos finales. Este paso garantiza una integración perfecta en las aplicaciones.

Explorando los puntos finales de la API para Sora 2 y Sora 2 Pro

La API de Sora 2 Pro se centra en la familia de puntos finales `/v1/videos`, que admite la creación, recuperación, listado y eliminación de videos. Los desarrolladores inician las generaciones con `POST /v1/videos`, especificando el modelo como 'sora-2' o 'sora-2-pro'.

El punto final de creación acepta parámetros como `prompt` (descripción de texto), `size` (cadena de resolución) y `seconds` (duración como "4", "8" o "12"). Los campos opcionales incluyen `input_reference` para inicios guiados por imágenes y `remix_video_id` para modificaciones.

Las respuestas devuelven JSON con un ID, estado (`queued` o `in_progress`) y porcentaje de progreso. Los desarrolladores consultan `GET /v1/videos/{video_id}` para rastrear el estado hasta su finalización o fallo.

Tras el éxito, `GET /v1/videos/{video_id}/content` descarga el archivo MP4. Las variantes permiten la recuperación de miniaturas (WEBP) o spritesheet (JPG). Los listados a través de `GET /v1/videos` proporcionan paginación con los parámetros `limit` y `after`.

La eliminación utiliza `DELETE /v1/videos/{video_id}` para gestionar el almacenamiento. Para la remezcla, `POST /v1/videos/{previous_video_id}/remix` aplica cambios específicos a través de una nueva indicación.

Los webhooks notifican sobre la finalización o el fallo, reduciendo la necesidad de sondeo. Los desarrolladores los configuran en la configuración, recibiendo eventos con IDs de video.

Estos puntos finales forman la columna vertebral de las integraciones de Sora. En consecuencia, dominar los parámetros mejora el control sobre las salidas.

Parámetros clave y formatos de solicitud en la API de Sora 2 Pro

Los parámetros dictan las características del video. El parámetro `model` selecciona 'sora-2' para la eficiencia o 'sora-2-pro' para la calidad. Las cadenas `prompt` describen escenas en detalle, incorporando ángulos de cámara, acciones, iluminación y diálogo.

`Size` especifica la resolución, como "1280x720" para horizontal o "720x1280" para vertical. Sora 2 Pro admite opciones más altas como "1792x1024". `Seconds` limita la duración a valores admitidos, con clips más cortos que producen resultados más fiables.

`Input_reference` carga imágenes a través de `multipart/form-data`, coincidiendo con el parámetro `size`. Esto ancla el primer fotograma, útil para una marca consistente.

Los formatos de solicitud varían: JSON para solo texto, multipart para imágenes. Los encabezados incluyen `Authorization: Bearer {API_KEY}` y `Content-Type` según sea necesario.

Los formatos de respuesta utilizan consistentemente JSON para los metadatos, con flujos binarios para las descargas de contenido. Los errores devuelven códigos y mensajes HTTP estándar, como 400 para parámetros no válidos.

Al ajustar estos parámetros, los desarrolladores ajustan las generaciones. Por ejemplo, combinar alta resolución con Sora 2 Pro maximiza la fidelidad, aunque extiende el tiempo de procesamiento.

La transición a ejemplos ilustra la aplicación práctica.

Ejemplos de código: Implementación de la API de Sora 2 Pro en Python y JavaScript

Los desarrolladores implementan la API de Sora 2 Pro a través de SDKs. En Python, una creación básica se ve así:

response = client.videos.create(

model="sora-2-pro",

prompt="A futuristic cityscape at dusk with flying vehicles and neon lights reflecting on wet streets.",

size="1792x1024",

seconds="8"

)

print(response)

El sondeo sigue:

import time

video_id = response.id

while True:

status = client.videos.retrieve(video_id)

if status.status == "completed":

break

elif status.status == "failed":

raise Exception("Generation failed")

time.sleep(10)

La descarga guarda el archivo:

content = client.videos.download_content(video_id)

with open("output.mp4", "wb") as f:

f.write(content)

En JavaScript, usando `async/await`:

const openai = new OpenAI();

async function generateVideo() {

const video = await openai.videos.create({

model: 'sora-2-pro',

prompt: 'An ancient forest awakening at dawn, with mist rising and animals stirring.',

size: '1024x1792',

seconds: '12'

});

let status = video.status;

while (status === 'queued' || status === 'in_progress') {

await new Promise(resolve => setTimeout(resolve, 10000));

const updated = await openai.videos.retrieve(video.id);

status = updated.status;

}

if (status === 'completed') {

const content = await openai.videos.downloadContent(video.id);

// Handle binary content, e.g., save to file

}

}

generateVideo();

Para referencias de imágenes en cURL:

curl -X POST "https://api.openai.com/v1/videos" \

-H "Authorization: Bearer $OPENAI_API_KEY" \

-H "Content-Type: multipart/form-data" \

-F model="sora-2-pro" \

-F prompt="The character jumps over the obstacle and lands gracefully." \

-F size="1280x720" \

-F seconds="4" \

-F input_reference="@start_frame.jpg;type=image/jpeg"

Ejemplo de remezcla:

curl -X POST "https://api.openai.com/v1/videos/$VIDEO_ID/remix" \

-H "Authorization: Bearer $OPENAI_API_KEY" \

-H "Content-Type: application/json" \

-d '{"prompt": "Change the background to a starry night sky."}'

Estos ejemplos demuestran flujos de trabajo centrales. Los desarrolladores los extienden para procesamiento por lotes o manejo de errores.

A medida que las aplicaciones escalan, las consideraciones de precios se vuelven cruciales.

Precios de la API para Sora 2 y Sora 2 Pro: Desglose de costos y optimización

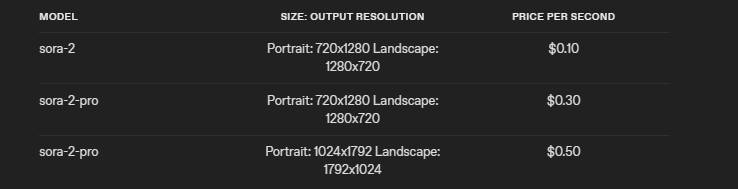

OpenAI cobra por los modelos Sora por segundo de video generado, variando según el modelo y la resolución. Sora 2 cuesta $0.10 por segundo para resoluciones de 720p (1280x720 o 720x1280). Sora 2 Pro eleva esto a $0.30 por segundo para lo mismo, y $0.50 por segundo para resoluciones más altas (1792x1024 o 1024x1792).

Para un video de 12 segundos a 720p usando Sora 2, el costo total es de $1.20. Lo mismo con Sora 2 Pro en alta resolución alcanza los $6.00. Los desarrolladores calculan los gastos en función de la duración y el volumen.

Las estrategias de optimización reducen los costos. Usa Sora 2 para borradores y cambia a Sora 2 Pro para los finales. Limita las duraciones a lo esencial y prueba las indicaciones con resoluciones más bajas. Agrupa clips cortos y únelos después de la generación.

Los límites de velocidad se vinculan a los niveles: el Nivel 1 permite 1-2 RPM para Pro, escalando a 20 RPM en el Nivel 5. Los niveles más altos se desbloquean después de un uso y gasto consistentes.

Al monitorear los costos en el panel, los desarrolladores mantienen los presupuestos. Esta conciencia apoya una escalabilidad sostenible.

Además, una indicación efectiva minimiza los reintentos y el desperdicio.

Mejores prácticas para la indicación en la API de Sora 2 Pro

Las indicaciones impulsan la calidad de la salida. Los desarrolladores las estructuran con detalles cinematográficos: tomas de cámara (por ejemplo, gran angular), acciones en secuencias, iluminación (por ejemplo, rayos de luz volumétricos) y paletas (3-5 colores).

Los parámetros de la API anulan la prosa para el tamaño y los segundos. Usa entradas de imagen para controlar los fotogramas iniciales, asegurando que la resolución coincida.

Para el movimiento, describe acciones simples y cronometradas: "El pájaro aletea dos veces, luego se desliza durante tres segundos." Los bloques de diálogo siguen a los elementos visuales: "Personaje: 'Hola mundo.'"

Itera a través de remezclas para ajustes, conservando las estructuras. Prueba variaciones: indicaciones cortas para la creatividad, detalladas para la precisión.

Los errores comunes incluyen la sobrecomplejidad, lo que lleva a inconsistencias. Comienza simple, agrega capas.

Estas prácticas producen resultados fiables. La integración de herramientas como Apidog agiliza las pruebas.

Integrando Apidog con la API de Sora 2 Pro para un desarrollo eficiente

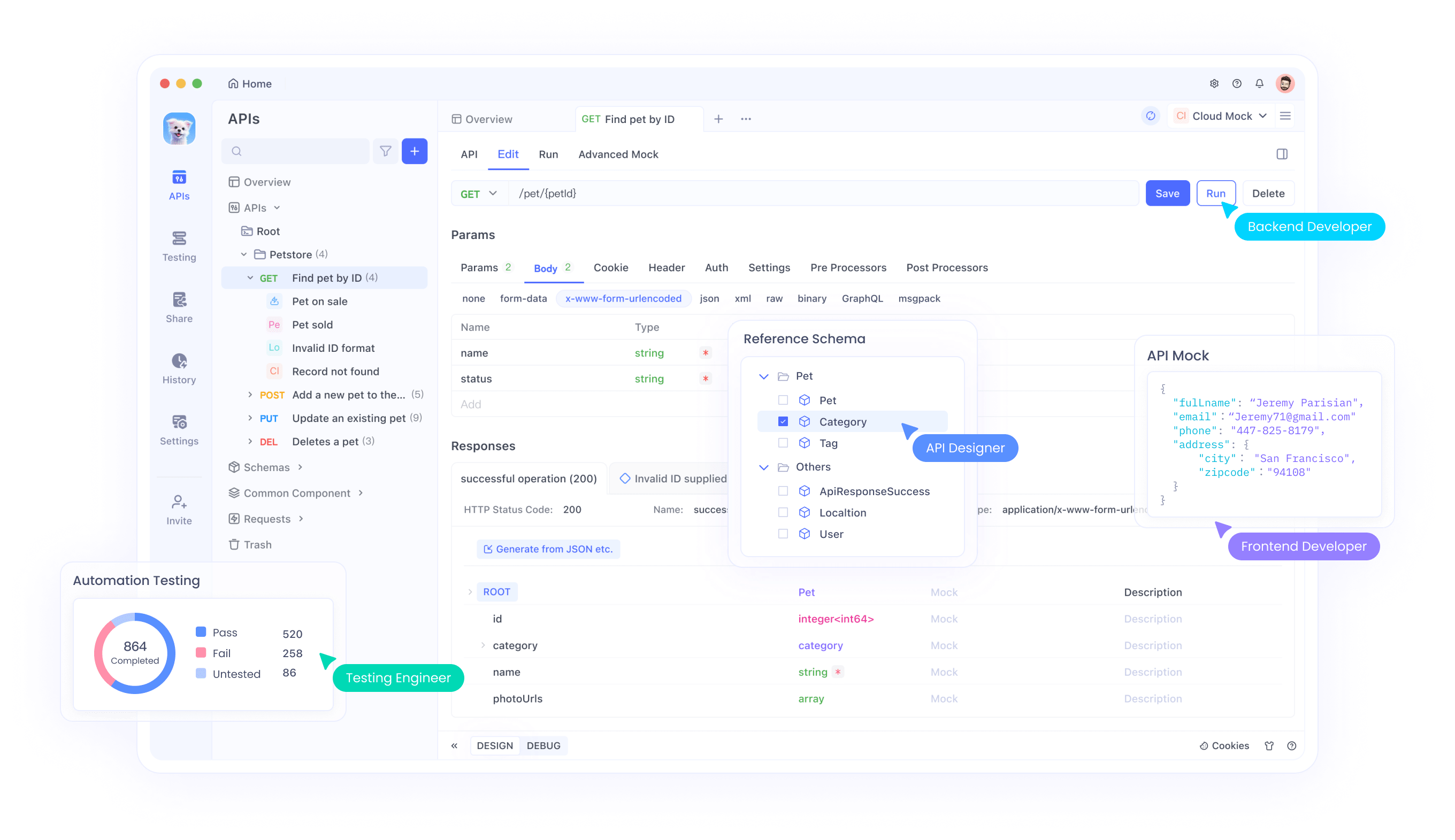

Apidog sirve como un cliente API avanzado, superando a herramientas básicas como Postman. Los desarrolladores lo usan para simular puntos finales, generar código y depurar llamadas a Sora 2 Pro.

Primero, importa la especificación de la API de OpenAI en Apidog. Crea colecciones para los puntos finales de video, configurando variables para las claves.

Apidog presenta mejoras de IA para la generación de indicaciones y la validación de respuestas. Para Sora, encadena solicitudes: crear, sondear el estado, descargar.

La generación de código exporta fragmentos de Python o JS directamente desde las solicitudes. Esto acelera la creación de prototipos.

Además, las herramientas de documentación de Apidog crean guías compartibles para los equipos.

Al incorporar Apidog, los desarrolladores reducen el tiempo de configuración y se centran en la innovación.

La resolución de problemas sigue de forma natural.

Resolución de problemas comunes en el uso de la API de Sora 2 Pro

Los problemas surgen de parámetros no válidos o violaciones de políticas. El estado "failed" a menudo se debe a indicaciones rechazadas; verifica si hay contenido prohibido.

Los errores de límite de velocidad (429) requieren reintentos con retroceso. Implementa retrasos exponenciales en el código.

Las generaciones incompletas señalan problemas de red; verifica las conexiones.

Para salidas de baja calidad, refina las indicaciones con detalles. Si las resoluciones no coinciden en las entradas, las solicitudes fallarán.

Los registros en el panel de OpenAI proporcionan información. Los desarrolladores resuelven la mayoría de los problemas al alinearse con la documentación.

Este enfoque proactivo mantiene las operaciones sin problemas.

Casos de uso avanzados: Creación de aplicaciones con la API de Sora 2 Pro

Los desarrolladores crean diversas aplicaciones. En marketing, generan anuncios personalizados a partir de datos de usuario. Las plataformas de e-learning crean videos explicativos dinámicamente.

Los juegos usan Sora para escenas de corte procedurales. Las herramientas de redes sociales remezclan contenido de usuario.

Integra con otras APIs de OpenAI: Usa GPT para mejorar las indicaciones antes de las llamadas a Sora.

Escala con colas y procesamiento asíncrono. Para un alto volumen, emplea webhooks para notificaciones.

Estos casos muestran versatilidad. La seguridad sigue siendo primordial.

Seguridad y cumplimiento en las integraciones de la API de Sora 2 Pro

Los desarrolladores aseguran las claves con bóvedas y las rotan regularmente. Cumplen con las políticas de datos, evitando entradas sensibles.

Monitorean el abuso a través del análisis de uso. Aseguran que las salidas sean adecuadas para las audiencias.

Al adherirse a las pautas, los desarrolladores fomentan el uso ético.

En resumen, Sora impulsa la tecnología creativa.

Conclusión: Maximizando el valor de la API de Sora 2 Pro

Sora 2 y Sora 2 Pro transforman la creación de medios. Los desarrolladores los aprovechan a través de APIs estructuradas, indicaciones optimizadas y herramientas como Apidog.

A medida que la tecnología evoluciona, mantenerse actualizado asegura la competitividad. Experimenta audazmente, itera sabiamente.