Alibaba lanza Qwen3-Max, un modelo de lenguaje grande insignia que supera los límites en las capacidades de inteligencia artificial. Este modelo surge de la serie Qwen, conocida por sus avances en modelos de base abiertos destinados a la inteligencia artificial general. Desarrolladores e investigadores ahora acceden a una herramienta que sobresale en tareas complejas, desde desafíos de codificación hasta razonamiento multifacético. A medida que los equipos integran Qwen3-Max a través de su API para aplicaciones del mundo real, las pruebas eficientes se vuelven esenciales.

Qwen3-Max escala a más de un billón de parámetros, entrenado con 36 billones de tokens, el doble que Qwen2.5. Maneja tareas agénticas y sigue instrucciones con precisión. Aunque comienza sin modos de pensamiento explícitos, las próximas características añadirán mejoras de razonamiento.

El modelo soporta más de 100 idiomas, expandiendo su uso global. Alibaba ofrece acceso a la API en su nube, simplificando la implementación.

Especificaciones Técnicas de Qwen3-Max

Alibaba diseña Qwen3-Max con un enfoque en la escalabilidad y eficiencia. El modelo cuenta con más de un billón de parámetros, posicionándolo entre los modelos de IA más grandes disponibles a través de API. Este tamaño inmenso permite al sistema procesar grandes cantidades de datos durante el preentrenamiento, lo que resulta en sólidas capacidades de reconocimiento de patrones y generación. Los ingenieros entrenan Qwen3-Max en un conjunto de datos que supera los 36 billones de tokens, duplicando el volumen utilizado en generaciones anteriores como Qwen2.5.

Qwen3-Max presenta una ventana de contexto de 262.144 tokens, con una entrada máxima de 258.048 tokens y una salida máxima de 65.536 tokens. Este contexto expansivo permite al modelo manejar documentos de formato largo, conversaciones extendidas y secuencias intrincadas de resolución de problemas sin perder coherencia. Los desarrolladores se benefician de esto en aplicaciones como el análisis de documentos o diálogos de múltiples turnos. Sin embargo, la interfaz de chat puede imponer limitaciones aparentes, pero el modelo subyacente soporta la capacidad total a través de llamadas a la API.

Qwen3-Max opera como un modelo instructivo no pensante en su lanzamiento inicial, priorizando la generación de respuestas directas. Alibaba planea introducir características de razonamiento, incluido el uso de herramientas y la implementación de modo pesado, que prometen puntuaciones de referencia casi perfectas. La arquitectura se basa en la serie Qwen3, incorporando mejoras en el seguimiento de instrucciones, la reducción de alucinaciones y un soporte multilingüe mejorado. Para la implementación, marcos como vLLM y SGLang facilitan un servicio eficiente, soportando el paralelismo tensorial a través de múltiples GPU.

En cuanto a los requisitos de hardware, Qwen3-Max exige recursos computacionales sustanciales. Ejecutarlo localmente requiere configuraciones de alta gama, pero el acceso a la API lo mitiga al aprovechar la infraestructura en la nube de Alibaba. El precio sigue una estructura escalonada basada en el volumen de tokens: para 0–32K tokens, los costos de entrada son $1.2 por millón, la salida $6 por millón; para 32K–128K, $2.4 y $12; y para 128K–252K, $3 y $15. Los nuevos usuarios reciben una cuota gratuita de un millón de tokens válida por 90 días, fomentando la experimentación.

Además, Qwen3-Max se integra con APIs compatibles con OpenAI, simplificando la migración desde otros proveedores. Esta compatibilidad se extiende al almacenamiento en caché de contexto, que optimiza las consultas repetidas y reduce los costos en entornos de producción. No obstante, para operaciones estables, los usuarios seleccionan entre las versiones más recientes y las de instantánea para gestionar los límites de tasa de manera efectiva.

Análisis del Rendimiento de Referencia

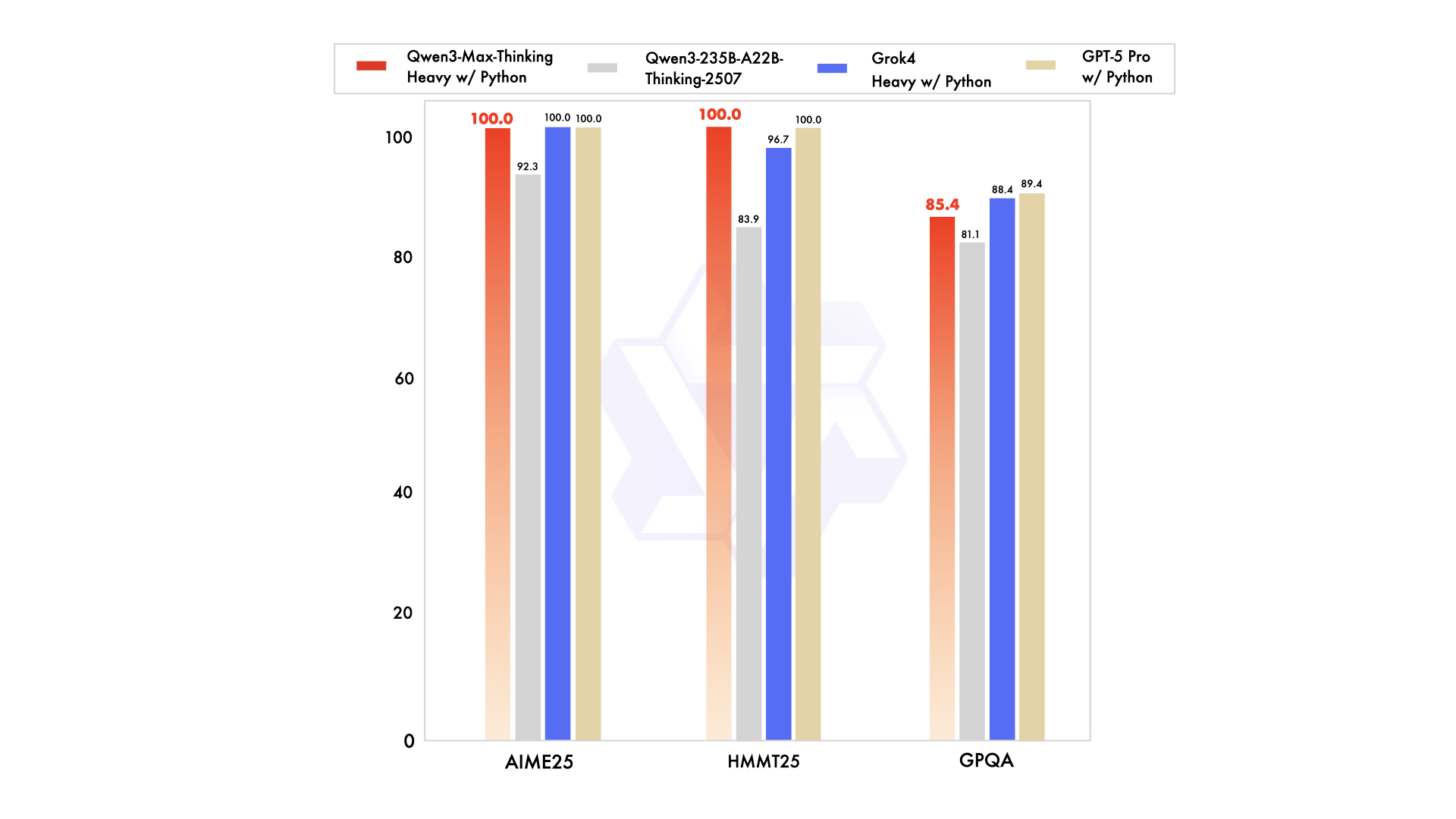

Qwen3-Max demuestra resultados excepcionales en múltiples pruebas de rendimiento, consolidando su posición como líder en el rendimiento de la IA. Alibaba evalúa el modelo en pruebas rigurosas centradas en codificación, matemáticas y razonamiento general. Por ejemplo, en SuperGPQA, Qwen3-Max-Instruct obtiene 65.1, superando a Claude Opus 4 con 56.5 y a DeepSeek-V3.1 con 43.9.

Además, en AIME25, un desafiante benchmark de matemáticas, Qwen3-Max alcanza 81.6, significativamente por delante de Qwen3-235B-A22B con 70.3 y otros. Esto resalta su destreza en la resolución de problemas matemáticos avanzados, donde la precisión y la deducción lógica resultan críticas. Pasando a las evaluaciones de codificación, LiveCodeBench v6 arroja una puntuación de 74.8 para Qwen3-Max, superando a competidores como Non-thinking con 52.3.

Además, Tau2-Bench (Verificado) sitúa a Qwen3-Max en 69.6, mientras que SWE-Bench Verificado registra 72.5, ambos liderando el grupo. Estas puntuaciones provienen de desafíos de codificación del mundo real, donde el modelo resuelve problemas de repositorios de GitHub de manera efectiva. Alibaba atribuye esto a la escalabilidad computacional implacable y a los datos masivos de preentrenamiento.

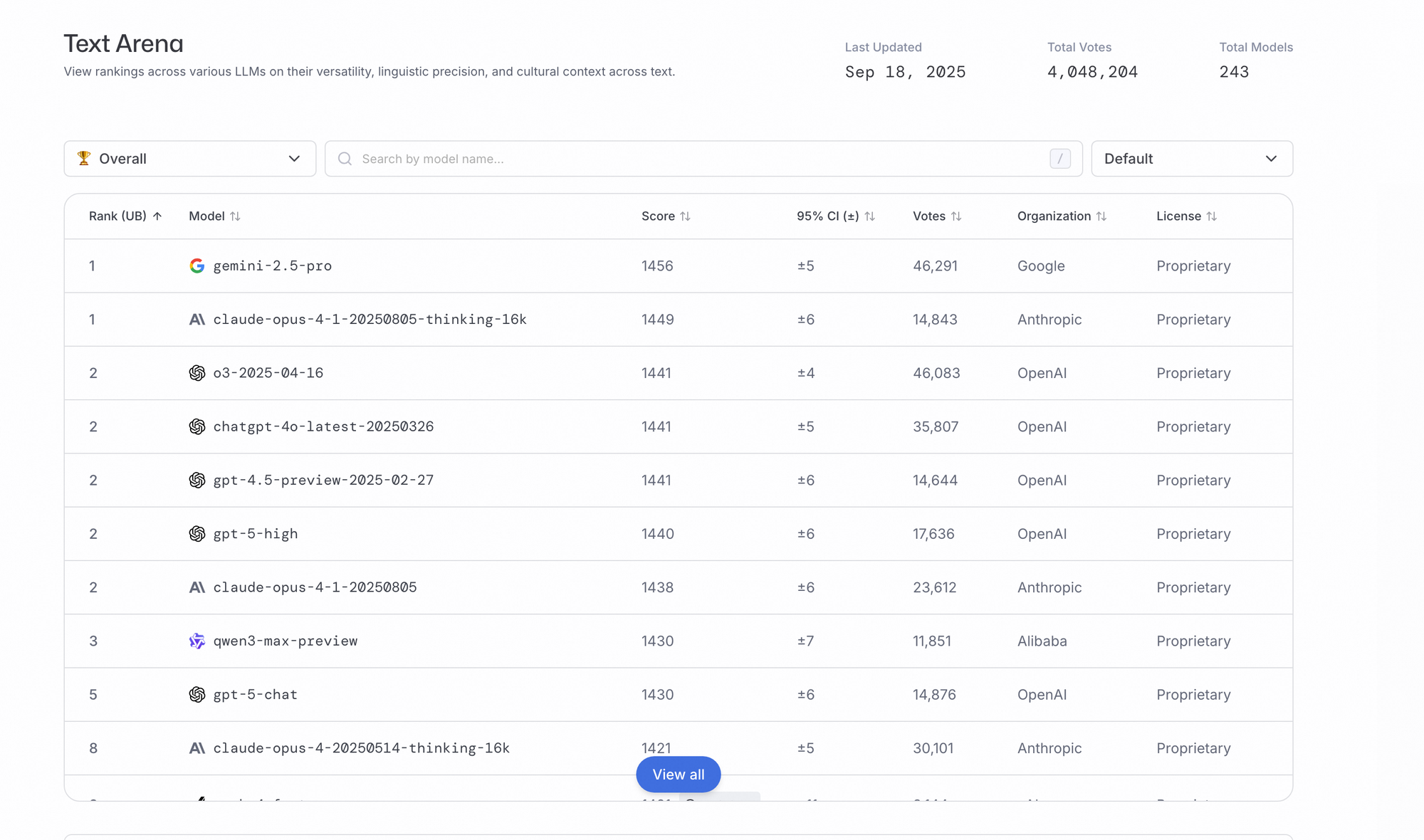

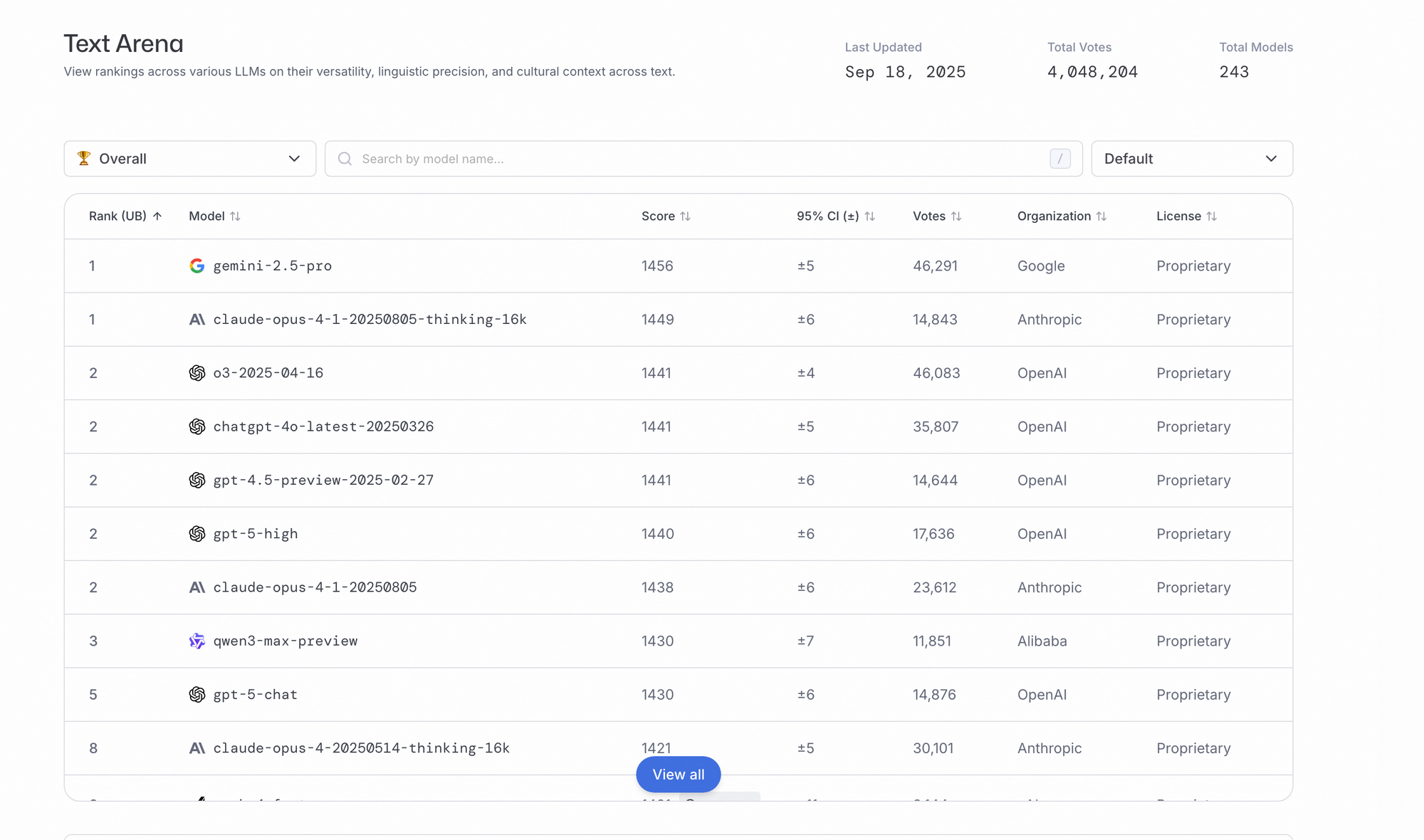

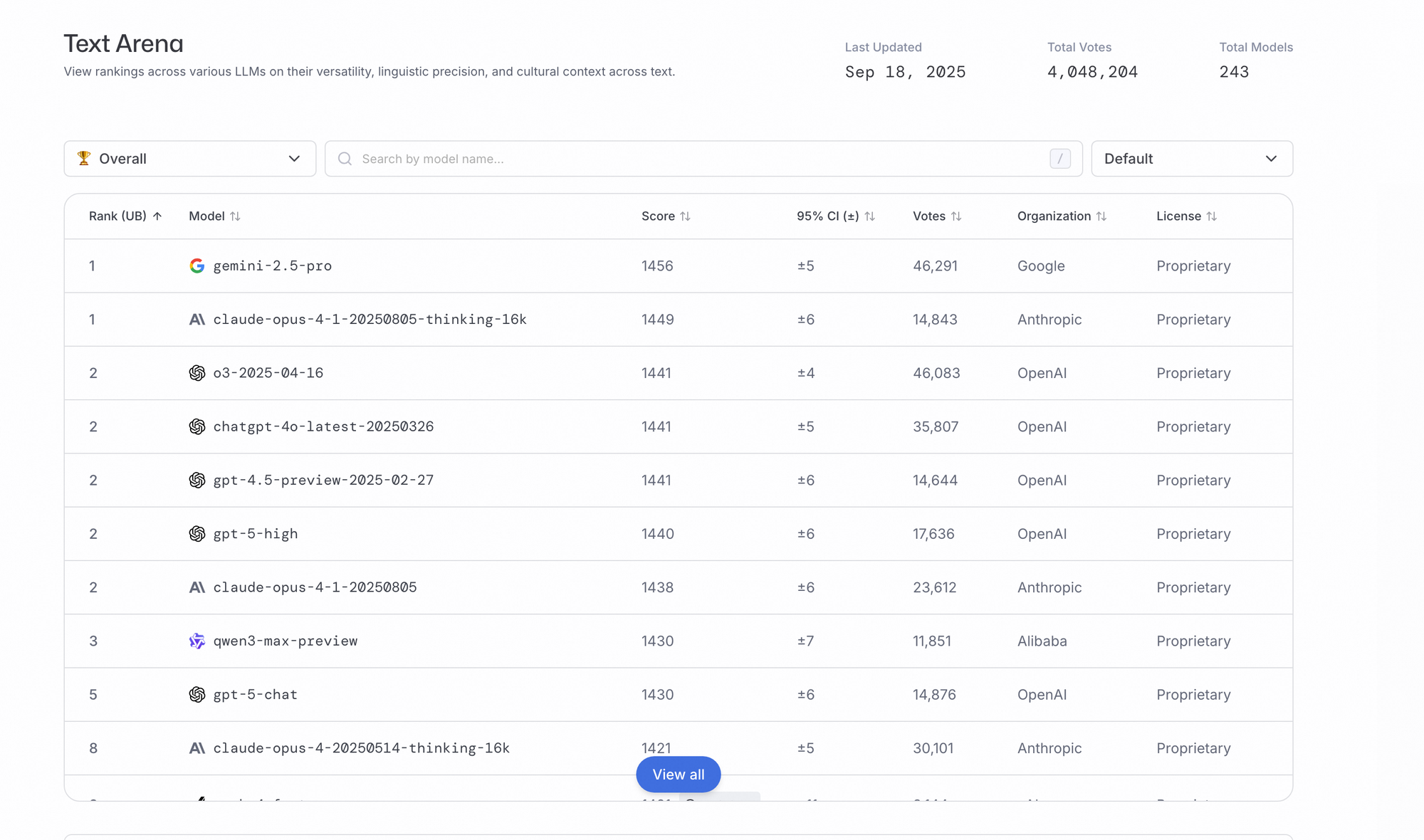

Además, Qwen3-Max sobresale en benchmarks agénticos como Arena-Hard v2 y LiveBench, clasificándose consistentemente por encima de Claude Opus 4 y DeepSeek-V3.1. Las pruebas de la comunidad revelan evidencia anecdótica de comportamiento similar al razonamiento en tareas más difíciles, produciendo respuestas estructuradas a pesar de su base no razonadora. Sin embargo, los benchmarks formales confirman su fiabilidad, con tasas de éxito del 100% en áreas como alucinaciones, conocimiento general y ética.

Los analistas señalan que el aumento de los "presupuestos de pensamiento", cuando están habilitados, impulsa el rendimiento en los dominios de matemáticas, codificación y ciencia. Esta característica controlada por el usuario, accesible en la aplicación Qwen, proporciona un control granular sobre la profundidad del razonamiento. En general, estas métricas subrayan la eficiencia de Qwen3-Max, clasificándose en el percentil 63 en velocidad y 34 en precio entre sus pares.

Comparaciones con Modelos de IA Líderes

Qwen3-Max compite directamente con modelos superiores como GPT-5, Claude 4 Opus y DeepSeek-V3.1. En tareas de codificación, Qwen3-Max supera a DeepSeek-V3.1 en desarrollo frontend y conversiones Java, aunque las mejoras en Python siguen siendo modestas. La retroalimentación de la comunidad en plataformas como Reddit destaca su potencial para igualar o superar a GPT-5 Pro antes de fin de año.

Además, frente a Claude Opus 4, Qwen3-Max lidera en SuperGPQA y AIME25, demostrando mayores capacidades matemáticas y generales. La escala de un billón de parámetros del modelo proporciona una ventaja en la cobertura de conocimiento de cola larga, reduciendo las alucinaciones en comparación con sus predecesores. Sin embargo, los modos de razonamiento de Claude ofrecen ventajas en ciertos escenarios, lo que Qwen3-Max abordará con futuras actualizaciones.

En tareas multilingües, Qwen3-Max soporta más de 100 idiomas, rivalizando con Gemini-2.5-Pro y Grok-3. Los benchmarks muestran resultados competitivos frente a estos, particularmente en el seguimiento de instrucciones y el uso de herramientas. En cuanto a precios, Qwen3-Max resulta más rentable, con tarifas escalonadas que superan las opciones premium de OpenAI y Anthropic.

Además, en comparación con modelos de peso abierto como Qwen3-235B-A22B, la variante Max mejora las habilidades agénticas sin un pensamiento profundo, logrando puntuaciones más altas en SWE-Bench y Tau2-Bench. Esto lo posiciona como un híbrido entre las fortalezas de código abierto y cerrado, aunque su naturaleza de código cerrado provoca debates sobre la accesibilidad.

Características y Capacidades Clave

Qwen3-Max sobresale en el seguimiento de instrucciones para chatbots y escritura. La reducción de alucinaciones garantiza la fiabilidad en clasificación y ética.

Las características agénticas manejan procesos de varios pasos mediante la llamada a herramientas de Qwen-Agent. Las respuestas rápidas son adecuadas para aplicaciones en tiempo real.

Soporta llamadas a funciones compatibles con OpenAI. El contexto largo ayuda al análisis de datos; los parámetros mejoran la creatividad.

Como no razonador, se adapta al pensamiento estructurado. Futuros "presupuestos de pensamiento" ajustarán el rendimiento del dominio.

Integración y Uso de API con Apidog

Los desarrolladores acceden a Qwen3-Max principalmente a través de la API de Alibaba Cloud, que soporta puntos finales compatibles con OpenAI. Esta configuración permite una integración sencilla en aplicaciones utilizando bibliotecas estándar. Por ejemplo, los usuarios llaman a la API con indicaciones como "¿Por qué el cielo es azul?" para generar respuestas.

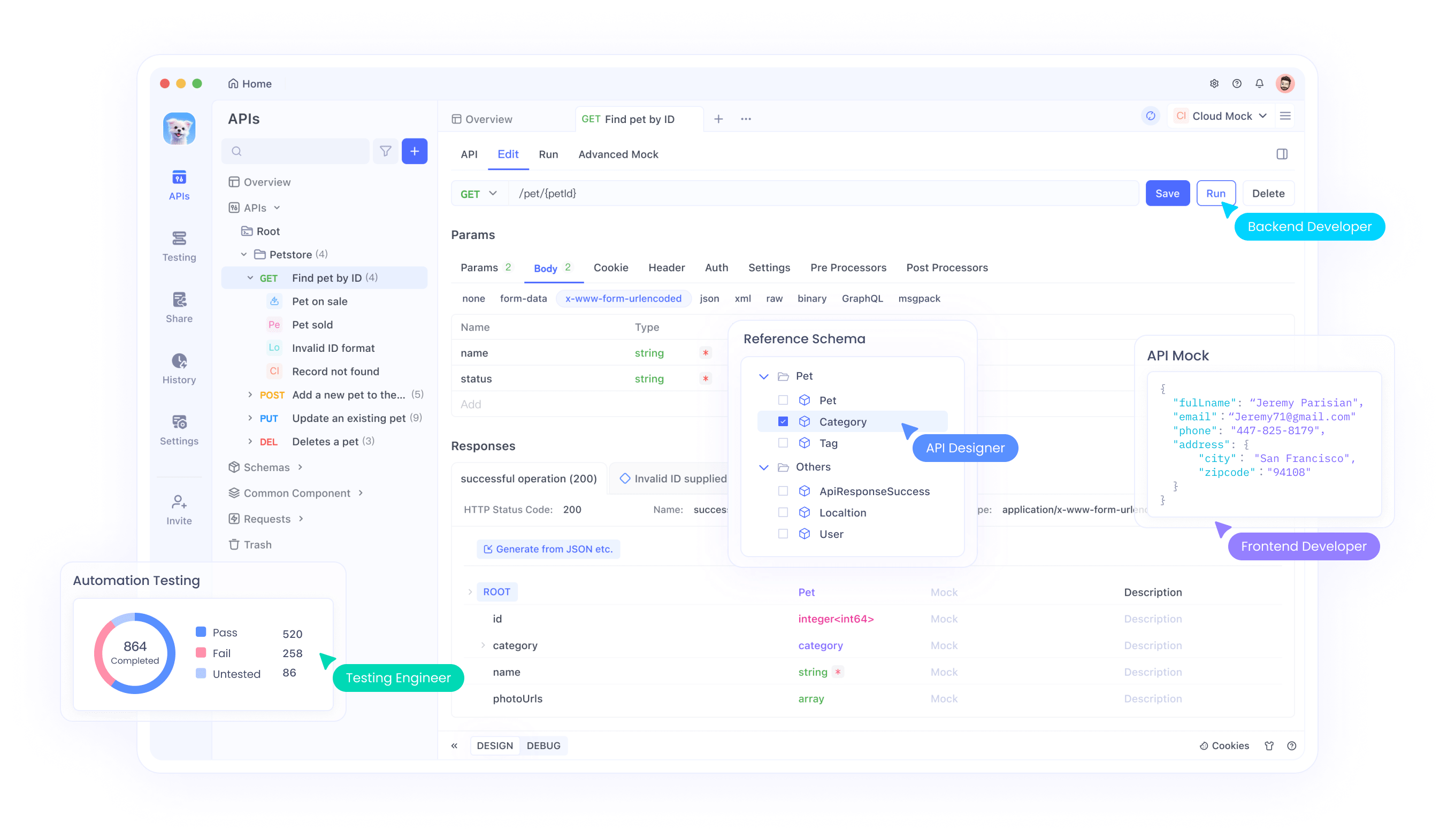

Apidog desempeña un papel crucial aquí, proporcionando una plataforma intuitiva para la prueba y gestión de API. Los ingenieros utilizan Apidog para simular solicitudes, monitorear respuestas y depurar integraciones con Qwen3-Max. Las características de la herramienta, como el encadenamiento de solicitudes y las variables de entorno, agilizan los flujos de trabajo al manejar grandes volúmenes de tokens.

Además, Apidog soporta la colaboración, permitiendo a los equipos compartir colecciones de API para proyectos de Qwen3-Max. Para empezar, descarga Apidog gratis e importa las especificaciones de la API de Qwen de la documentación de Alibaba. Esto asegura pruebas eficientes de características como el almacenamiento en caché de contexto, que reduce la latencia en tareas repetitivas.

Además, las integraciones con proveedores como OpenRouter y Vercel AI Gateway amplían las opciones. Apidog facilita el cambio entre ellos, asegurando la compatibilidad y el monitoreo del rendimiento en todos los ecosistemas.

Casos de Uso para Qwen3-Max

Las organizaciones aplican Qwen3-Max en diversos escenarios, aprovechando sus capacidades para la innovación. En el desarrollo de software, el modelo asiste en la generación de código y la depuración, resolviendo problemas de GitHub con alta precisión en SWE-Bench. Los desarrolladores lo integran a través de la API para automatizar solicitudes de extracción o refactorizar código heredado.

Además, en educación, Qwen3-Max resuelve problemas matemáticos avanzados, ayudando a los tutores a explicar conceptos de los benchmarks AIME25. Su soporte multilingüe permite a las plataformas de aprendizaje globales ofrecer contenido en idiomas nativos.

En entornos empresariales, las características agénticas impulsan herramientas de automatización, como chatbots para el servicio al cliente o pipelines de análisis de datos. Los proveedores de atención médica lo utilizan para el apoyo a decisiones éticas, beneficiándose de puntuaciones perfectas en los benchmarks de ética.

Además, las industrias creativas emplean Qwen3-Max para la escritura y generación de contenido, donde la reducción de alucinaciones garantiza resultados de calidad. Las plataformas de comercio electrónico lo integran para recomendaciones personalizadas, procesando contextos largos de historiales de usuario.

Sin embargo, en investigación, los científicos exploran su potencial de razonamiento para simulaciones y pruebas de hipótesis, anticipando mejoras en los modos de pensamiento.

Conclusión

Qwen3-Max transforma los paisajes de la IA con su potencia de un billón de parámetros y su dominio en los benchmarks. Los desarrolladores aprovechan su poder a través de APIs, mejoradas por herramientas como Apidog para una integración eficiente. A medida que Alibaba refina el modelo, promete innovaciones aún mayores en codificación, razonamiento y más allá. Los equipos adoptan Qwen3-Max hoy para mantenerse competitivos en un campo en evolución.