Mistral AI se ha ganado rápidamente un nombre con sus modelos de lenguaje de alto rendimiento. Ya sea que estés buscando construir un chatbot, generar texto creativo, analizar datos, escribir código o incrustar texto para búsqueda semántica, la API de Mistral proporciona las herramientas que necesitas. Pero como cualquier herramienta poderosa, hay una puerta de entrada: la clave de API.

Pensar en una clave de API como tu contraseña secreta o identificador único. Le dice a Mistral: "¡Hola, soy yo! Tengo permiso para usar tus servicios." Sin ella, los servidores de la API no sabrían quién está haciendo la solicitud o si están autorizados.

Esta guía es tu compañero paso a paso para navegar por la configuración inicial, entender el panorama de los modelos de Mistral, hacer tus primeras llamadas a la API e incluso usar herramientas como APidog para interactuar con la API. Desglosaremos todo de manera conversacional, con el objetivo de llevarte de cero a hacer llamadas exitosas a la API.

Tiempo Estimado: Leer y seguir podría tomar de 30 a 45 minutos.

Requisitos Previos: Una comprensión básica de lo que es una API es útil, pero no estrictamente necesaria. Explicaremos los conceptos a medida que avancemos. También necesitarás una conexión a Internet y un navegador web.

¿Listo? ¡Vamos a conseguir esa clave de API!

¿Quieres una plataforma integrada, Todo-en-Uno para que tu equipo de desarrolladores trabaje juntos con máxima productividad?

Apidog satisface todas tus demandas y reemplaza a Postman a un precio mucho más asequible!

Paso 1: Configurando Tu Cuenta de Mistral AI

Lo primero es lo primero, necesitas una cuenta en la plataforma de Mistral, conocida como "La Plateforme".

- Navegar a la Consola: Abre tu navegador web y dirígete a console.mistral.ai.

- Registrarse o Iniciar Sesión:

- Si eres nuevo, haz clic en la opción de registro. Probablemente necesitarás proporcionar una dirección de correo electrónico y crear una contraseña, o podrías registrarte utilizando una cuenta existente de Google o GitHub. Sigue las instrucciones en pantalla, que pueden incluir verificar tu dirección de correo electrónico.

- Si ya tienes una cuenta, simplemente inicia sesión con tus credenciales.

3. Información de Facturación (¡Importante!): Este es un paso crucial que a menudo confunde a las personas. Para realmente usar la API (incluso si planeas usar los modelos del nivel gratuito inicialmente, la plataforma a menudo requiere detalles de facturación para activar las claves), necesitas configurar la facturación.

- Una vez que hayas iniciado sesión, busca una sección típicamente etiquetada como "Espacio de trabajo" o tu nombre de cuenta en la barra lateral o en el menú de navegación.

- Dentro de esa sección, busca "Facturación".

- Haz clic en ella y sigue las instrucciones para añadir tu información de pago (generalmente una tarjeta de crédito). No te preocupes, generalmente solo te cobran por lo que usas, y muchos modelos pueden tener niveles gratuitos o créditos iniciales, pero activar los pagos suele ser necesario para habilitar tus claves de API para uso general. La página de precios de Mistral (enlace más adelante) tiene los detalles específicos.

- Asegúrate de que tus pagos estén marcados como "activos" o "habilitados". Puede tardar unos momentos después de añadir los detalles para que el estado se actualice.

¡Ahora tienes una cuenta de Mistral AI lista para usar! El siguiente paso es generar esa clave tan importante.

Paso 2: Generando Tu Clave de API Secreta

Con tu cuenta configurada y la facturación activada, vamos a crear la clave en sí.

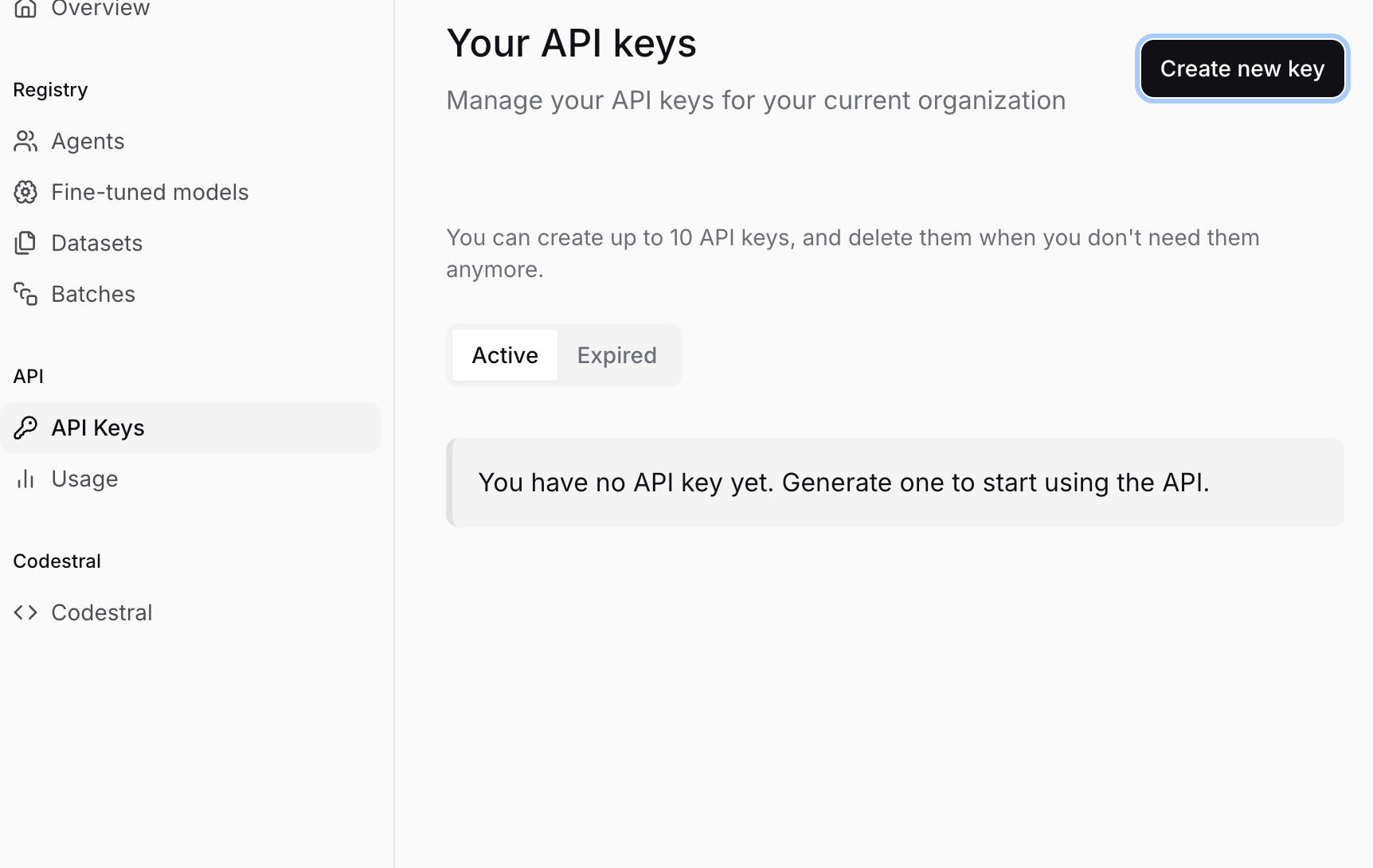

- Navegar a Claves de API: Mientras estés conectado a la consola de Mistral (console.mistral.ai), busca una sección llamada "Claves de API" en la barra lateral o en el menú de navegación. Haz clic en ella.

- Crear una Nueva Clave: Deberías ver un botón como "Crear nueva clave" o "+ Nueva Clave". Haz clic en él.

- Nombrar Tu Clave (Opcional pero Recomendado): Se te puede pedir que le des un nombre a tu clave. Esto es muy útil para la organización, especialmente si planeas crear múltiples claves más adelante (por ejemplo, una para "Mi Proyecto de Chatbot", otra para "Script de Análisis de Datos"). Elige un nombre descriptivo.

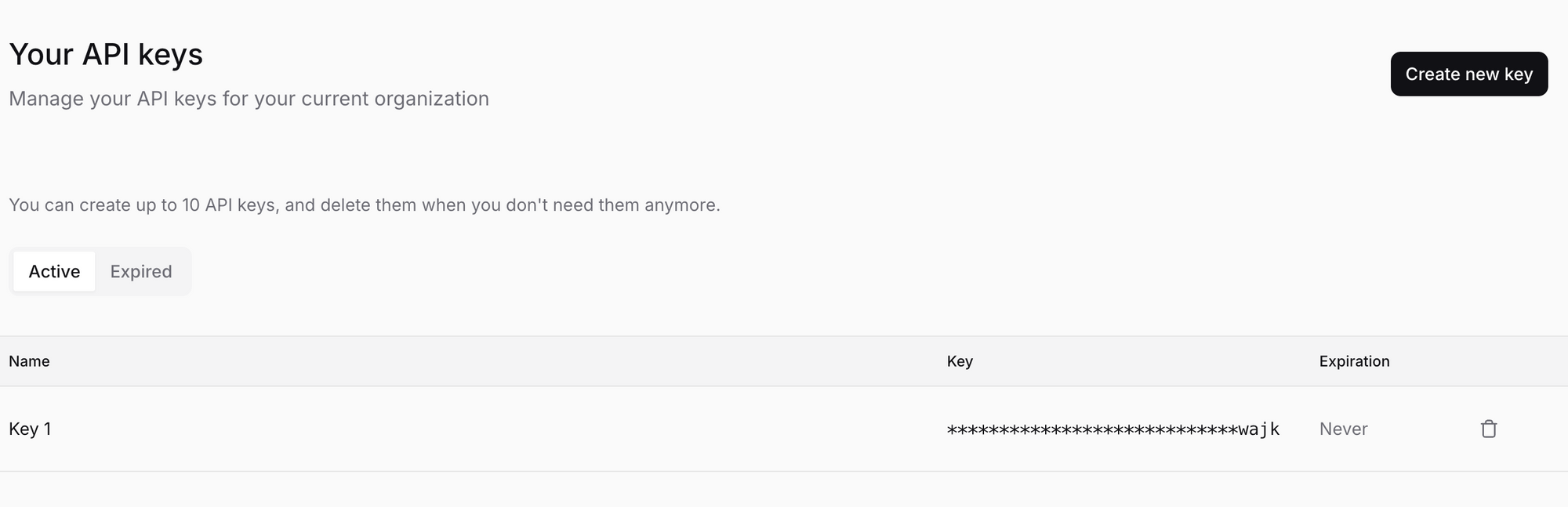

- Generar y COPIAR Tu Clave: Haz clic en el botón de confirmación final (por ejemplo, "Crear", "Generar"). Mistral generará ahora una clave de API única para ti. Tendrá el aspecto de una larga cadena de caracteres aleatorios, algo como

sk-aBcDeFgHiJkLmNoPqRsTuVwXyZ1234567890....... - !!! PASO CRÍTICO: ¡GUARDA TU CLAVE DE MANERA SEGURA !!!

- Mistral solo te mostrará esta clave UNA VEZ. Si cierras la ventana o navegas lejos sin copiarla, nunca la volverás a ver. Tendrías que generar una nueva clave.

- Copie la clave inmediatamente. Haz clic en el ícono de copiar o selecciona manualmente y copia toda la cadena.

- Almacénala de forma segura. Usa un administrador de contraseñas (como 1Password, Bitwarden, Dashlane) o una aplicación de notas seguras. NO la guardes en un archivo de texto sin formato en tu escritorio, no la envíes por correo electrónico sin seguridad, o no la incrustes directamente en tu código (más sobre eso más adelante). Trata esta clave como una contraseña para tu cuenta bancaria: cualquiera que la tenga puede hacer llamadas a la API cargadas a tu cuenta.

- No la compartas. En serio.

¡Lo has logrado! Ahora posees una clave de API de Mistral AI. Manténla a salvo y veamos cómo usarla.

Paso 3: Entendiendo el Panorama de Modelos de Mistral

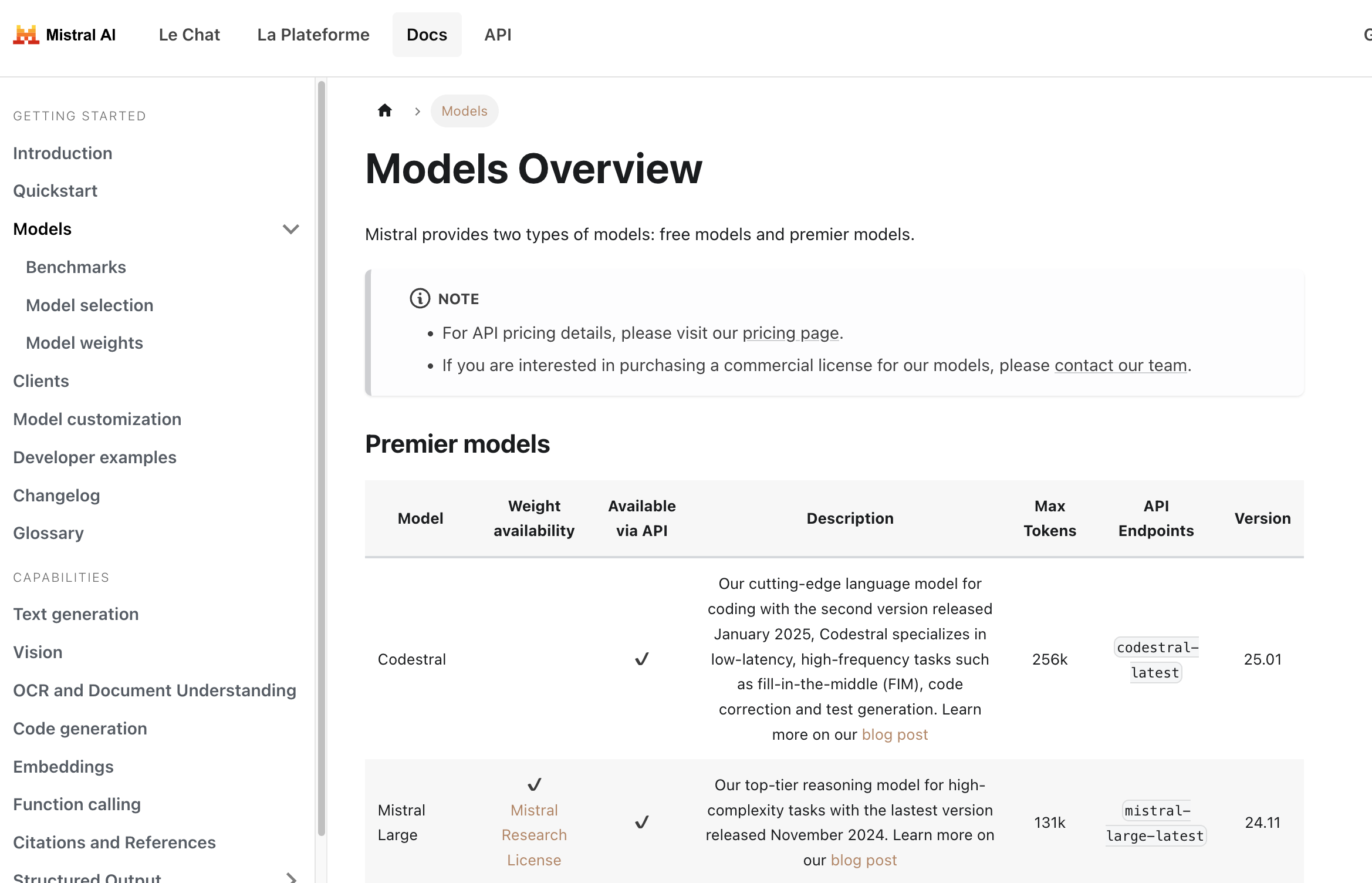

Antes de hacer una llamada a la API, necesitas decirle a Mistral qué modelo deseas usar. Mistral ofrece una variedad de modelos adaptados para diferentes tareas, equilibrando rendimiento, costo y capacidades. Elegir el adecuado es clave.

Puedes encontrar una descripción detallada de los modelos aquí: Descripción General de los Modelos de Mistral

Aquí hay un breve desglose de los tipos de modelos que encontrarás:

Modelos Premier: Estos son los modelos de mejor rendimiento de Mistral, que a menudo requieren pago.

Mistral Large: Su modelo insignia, diseñado para tareas de razonamiento complejas. Tiene una gran ventana de contexto (puede manejar mucho texto) y un fuerte rendimiento en varios benchmarks.Codestral: Modelos especializados ajustados para tareas de generación, finalización y explicación de código. Excelentes para desarrolladores.Pixtral Large: Un poderoso modelo multimodal capaz de entender tanto texto como imágenes.Mistral Embed: Un modelo altamente eficiente diseñado específicamente para crear representaciones numéricas (incrustaciones) de texto para tareas como búsqueda semántica, agrupamiento y clasificación.Mistral Moderation: Una herramienta para detectar contenido dañino o no deseado en texto.Mistral OCR: Servicio para extraer texto intercalado con imágenes de documentos.- Modelos especializados como

Mistral Saba(para idiomas de Oriente Medio/Asia del Sur) oMinistral(modelos eficientes de borde).

Modelos Gratuitos (A menudo con Pesos Abiertos): Estos modelos pueden tener pesos disponibles bajo licencias permisivas (como Apache 2.0), lo que significa que la comunidad de IA puede estudiarlos y construir sobre ellos. A menudo están disponibles a través de la API también, a veces con niveles gratuitos más generosos o costos más bajos.

Mistral Small: Un modelo más pequeño altamente capaz, equilibrando rendimiento y eficiencia. A menudo un excelente punto de partida.- Modelos más antiguos como

Mistral 7BoMixtral 8x7Bpueden seguir listados pero podrían estar transitando a un estado de legado (ver más abajo).

Versionado de Modelos y Etiquetas latest:

Notarás que los modelos a menudo tienen nombres como mistral-large-latest o mistral-large-2411.

*-latest: Esta etiqueta siempre apunta a la versión estable más reciente de ese modelo (por ejemplo,mistral-large-latestactualmente apunta amistral-large-2411). Usarlatestes conveniente para tener siempre las características más nuevas, pero ten en cuenta que el modelo subyacente puede cambiar, lo que podría alterar ligeramente el comportamiento o los resultados con el tiempo.*-YYYYMM(por ejemplo,mistral-large-2411): Esto se refiere a una versión específica y fechada del modelo (lanzada en noviembre de 2024 en este ejemplo). Usar una versión fechada asegura consistencia. Tu aplicación siempre utilizará la misma versión del modelo, lo cual es crucial para entornos de producción donde el comportamiento predecible es primordial.

Recomendación: Para desarrollo y exploración, latest está bien. Para aplicaciones en producción, considera firmemente usar una versión fechada por estabilidad.

Desaprobación de Modelos:

¡La IA avanza rápido! Mistral lanza continuamente modelos más nuevos y mejores. Como parte de este ciclo, los modelos más antiguos eventualmente son desaprobados y retirados. La página de Descripción General de Modelos incluye una sección sobre modelos heredados, mostrando sus fechas de desaprobación y retiro. Siempre verifica esto si dependes de un modelo más antiguo, y planifica tu migración a alternativas más nuevas con anticipación.

Elegir un Modelo:

- Tarea: ¿Qué necesitas hacer? (¿Chat, código, incrustaciones, análisis de imágenes?)

- Complejidad: ¿Qué tan difícil es la tarea? (¿Pregunta y respuesta simple vs. razonamiento matizado?)

- Costo: ¡Consulta la página de precios! Los modelos más grandes generalmente cuestan más.

- Velocidad: Los modelos más pequeños son típicamente más rápidos.

Comienza con un modelo más pequeño y barato (como mistral-small-latest) y ve si satisface tus necesidades. Si no, escala a modelos más grandes o más especializados.

Paso 4: Haciendo Tu Primera Llamada a la API (Finalización de Chat) con Python

¡Hagamos que algo suceda! El caso de uso más común es la finalización de chat: darle al modelo un aviso o un historial de conversación y obtener una respuesta. El punto final principal de Mistral para esto es /v1/chat/completions.

Usaremos el modelo mistral-large-latest para este ejemplo, pero puedes sustituirlo por cualquier nombre de modelo de chat adecuado.

Nota de Seguridad Importante: En los ejemplos a continuación, a menudo usamos os.environ["MISTRAL_API_KEY"] (Python) o process.env.MISTRAL_API_KEY (TypeScript). Esto asume que has configurado tu clave de API como una variable de entorno llamada MISTRAL_API_KEY. Esto es altamente recomendado sobre pegar la clave directamente en tu código.

- Cómo establecer una variable de entorno (temporal para la sesión de terminal):

- Mac/Linux:

export MISTRAL_API_KEY='tu_clave_api_real_aqui' - Windows (Símbolo del sistema):

set MISTRAL_API_KEY=tu_clave_api_real_aqui - Windows (PowerShell):

$env:MISTRAL_API_KEY='tu_clave_api_real_aqui' - Reemplaza

tu_clave_api_real_aquicon la clave que guardaste. Recuerda omitir las comillas si usas el Símbolo del sistema de Windows. Para una configuración más permanente, busca cómo establecer variables de entorno de manera persistente en tu sistema operativo.

Instala la biblioteca:

pip install mistralai

Crea un archivo Python (por ejemplo, mistral_test.py):

import os

from mistralai.client import MistralClient

from mistralai.models.chat_completion import ChatMessage

# Cargar la clave de API desde las variables de entorno

api_key = os.environ.get("MISTRAL_API_KEY")

if not api_key:

raise ValueError("¡Variable de entorno MISTRAL_API_KEY no configurada!")

# Definir el modelo que deseas usar

model_name = "mistral-large-latest" # O elige otro modelo

# Inicializar el cliente de Mistral

client = MistralClient(api_key=api_key)

print(f"Enviando solicitud al modelo: {model_name}")

# Definir los mensajes de la conversación

# La lista 'messages' contiene el historial del chat o un solo aviso del usuario

messages = [

ChatMessage(role="user", content="¿Cuál es el mejor queso francés?")

# Puedes agregar más mensajes para el historial de conversación:

# ChatMessage(role="assistant", content="¡Hay muchos quesos franceses maravillosos! Depende de tu gusto. ¿Prefieres queso suave, duro o azul?"),

# ChatMessage(role="user", content="Prefiero el queso suave.")

]

try:

# Hacer la llamada a la API al punto final de finalizaciones de chat

chat_response = client.chat(

model=model_name,

messages=messages,

# Parámetros opcionales:

# temperature=0.7, # Controla la aleatoriedad (0.0 = determinista, 1.0 = más aleatorio)

# max_tokens=150 # Limita la longitud de la respuesta

)

# Imprimir la respuesta del modelo

if chat_response.choices:

print("Respuesta del Modelo:")

print(chat_response.choices[0].message.content)

else:

print("No se recibió respuesta.")

# También puedes imprimir el objeto de respuesta completo para ver detalles de uso, etc.

# print("\nObjeto de Respuesta Completo:")

# print(chat_response)

except Exception as e:

print(f"Ocurrió un error: {e}")

Ejecuta el script:

python mistral_test.py

¡Deberías ver la respuesta del modelo impresa en tu terminal!

Paso 5: Probando Incrustaciones de Mistral AI con la API

Mistral no se trata solo de chat. ¡Veamos otra capacidad clave: Incrustaciones. Las incrustaciones transforman el texto en vectores numéricos que capturan el significado semántico. Los textos con significados similares tendrán vectores que están cerca unos de otros en el espacio vectorial. Esto es fundamental para RAG (Generación Aumentada por Recuperación), búsqueda semántica, sistemas de recomendación, etc.

El modelo de incrustación de Mistral se accede a través del punto final /v1/embeddings, utilizando típicamente el identificador de modelo mistral-embed.

Veamos cómo obtener incrustaciones para un par de oraciones con Python:

import os

from mistralai.client import MistralClient

api_key = os.environ.get("MISTRAL_API_KEY")

if not api_key:

raise ValueError("¡Variable de entorno MISTRAL_API_KEY no configurada!")

model_name = "mistral-embed"

client = MistralClient(api_key=api_key)

print(f"Solicitando incrustaciones utilizando el modelo: {model_name}")

texts_to_embed = [

"Mistral AI proporciona modelos de lenguaje poderosos.",

"Las incrustaciones son representaciones numéricas de texto.",

"¿Cómo está el clima hoy?"

]

try:

embeddings_response = client.embeddings(

model=model_name,

input=texts_to_embed

)

# La respuesta contiene una lista de objetos de incrustación, cada uno con el vector

print(f"Recibidas {len(embeddings_response.data)} incrustaciones.")

# Imprimir las primeras dimensiones de la primera incrustación como ejemplo

if embeddings_response.data:

first_embedding_vector = embeddings_response.data[0].embedding

print(f"Dimensiones de cada incrustación: {len(first_embedding_vector)}")

print(f"Primeras 5 dimensiones de la primera incrustación: {first_embedding_vector[:5]}")

# Normalmente almacenarías estos vectores para usarlos más tarde

# print("\nRespuesta Completa de Incrustaciones:")

# print(embeddings_response)

except Exception as e:

print(f"Ocurrió un error: {e}")

Ejecuta este script de Python y verás las dimensiones de las incrustaciones y un fragmento de la primera.

Otras Capacidades:

Mistral ofrece aún más. Aunque no detendremos el código aquí, asegúrate de explorar la documentación oficial para:

- Finalización (Legado): Aunque el chat es a menudo preferido, podría haber puntos finales de finalización más simples discutidos aquí: Capacidades de Finalización de Mistral

- Comprensión de Documentos (OCR): Extracción de texto de documentos, potencialmente manejando diseños e imágenes: Capacidades de Documentos de Mistral

- Llamada a Funciones: Permitiendo que los modelos interactúen con herramientas y APIs externas.

- Ajuste Fino: Personalizando modelos en tus propios datos (a menudo una característica empresarial).

Siempre consulta la documentación oficial de Mistral AI para obtener la información más actualizada sobre puntos finales, parámetros y capacidades.

Paso 6: Entendiendo Precios y Monitoreando el Uso

Usar modelos de IA poderosos a menudo tiene un costo. Es crucial entender cómo Mistral establece los precios para su uso de API.

- Los Precios Varían según el Modelo: Los modelos más grandes y capaces generalmente cuestan más por token (entrada y salida) que los modelos más pequeños. Los modelos de incrustación tienen su propia estructura de precios, generalmente basada en el número de tokens procesados.

- Tokens: Los modelos de IA procesan texto en partes llamadas tokens. Un token no es exactamente una palabra; puede ser una palabra, parte de una palabra o puntuación. Aproximadamente, 1000 tokens son unas 750 palabras, pero esto varía. El precio se especifica típicamente como "costo por 1 millón de tokens de entrada" y "costo por 1 millón de tokens de salida".

- Consulta la Página de Precios Oficial: Los precios pueden cambiar. Siempre consulta la página de precios oficial de Mistral AI para los detalles más recientes. Generalmente puedes encontrar un enlace a esto en su sitio web principal o dentro de la documentación de Descripción General de Modelos.

- Monitorea Tu Uso: La consola de Mistral AI (console.mistral.ai) generalmente tiene una sección (a menudo bajo "Facturación" o "Uso") donde puedes rastrear tus llamadas a la API y los costos asociados. Revisa esto regularmente para evitar sorpresas.

- Establece Presupuestos/Alertas: Si la plataforma lo permite, establece límites de gasto o alertas para notificarte si tu uso excede ciertos umbrales.

Ten cuidado con tu uso, especialmente al desarrollar aplicaciones que puedan hacer muchas llamadas. Optimiza tus avisos y elige el modelo más rentable que satisfaga tus necesidades.

Paso 7: Haciendo Llamadas a la API con APidog

Si bien codificar es común, a veces deseas una interfaz gráfica para probar puntos finales de API rápidamente. Herramientas como Postman, Insomnia o APidog son excelentes para esto. Vamos a repasar cómo usar APidog para hacer la misma llamada de finalización de chat que antes.

Descarga e Instala APidog: Si aún no lo has hecho, descarga APidog desde su sitio web oficial e instálalo en tu computadora.

Inicia APidog: Abre la aplicación.

Crea una Nueva Solicitud: Probablemente verás un botón "+" o una opción para crear una "Nueva Solicitud". Haz clic en él.

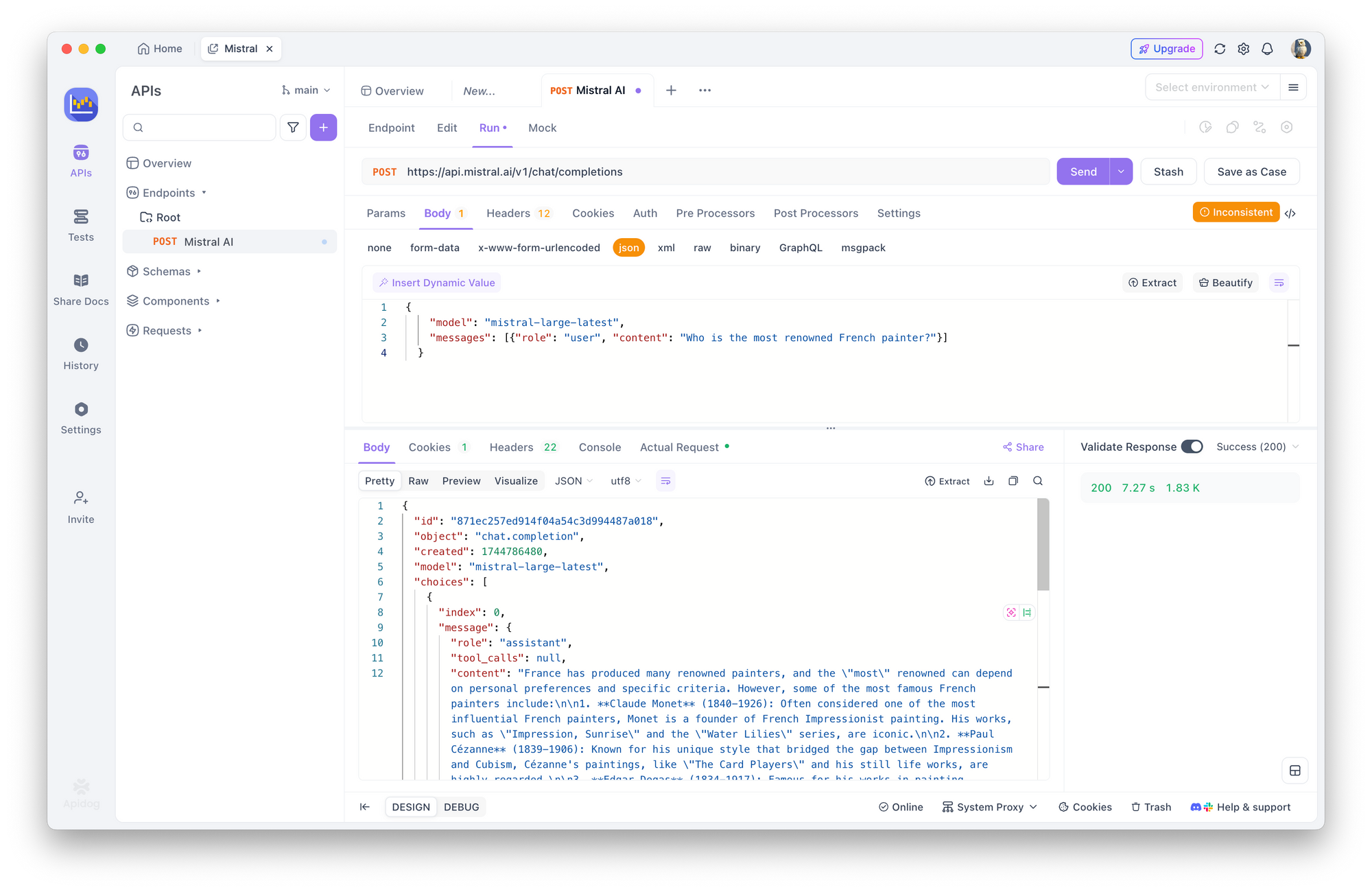

Establecer el Método HTTP y la URL:

- En el área de solicitud, busca el menú desplegable para el método HTTP (generalmente se establece de forma predeterminada en

GET). Cámbialo aPOST. - En el campo de entrada de URL al lado, ingresa el punto final de finalizaciones de chat de Mistral:

https://api.mistral.ai/v1/chat/completions

Configurar Autorización:

- Busca pestañas debajo de la barra de URL como "Params", "Authorization", "Headers", "Body". Haz clic en la pestaña "Authorization".

- En el menú desplegable "Type" dentro de esta pestaña, selecciona "Bearer Token".

- A la derecha aparecerá un campo etiquetado "Token". Pega tu Clave de API de Mistral guardada en este campo.

Establecer Encabezados de Solicitud:

- Haz clic en la pestaña "Headers".

- Necesitas agregar dos encabezados:

- En la primera fila vacía bajo "Key", escribe

Content-Type. En la columna "Value" junto a ella, escribeapplication/json. - En la siguiente fila vacía, escribe

Acceptpara "Key", yapplication/jsonpara "Value". - También establece

Authorization:Bearer $MISTRAL_API_KEY

Proporcionar el Cuerpo de la Solicitud:

- Haz clic en la pestaña "Body".

- Selecciona el botón de opción "raw".

- Justo a la derecha de "raw", a menudo hay un menú desplegable que muestra el formato (por ejemplo, "Texto"). Cambia este menú desplegable a "JSON".

- En el área de texto grande a continuación, pega la carga útil JSON para tu solicitud:

{

"model": "mistral-large-latest",

"messages": [{"role": "user", "content": "¿Quién es el pintor francés más renombrado?"}]

}

Enviar la Solicitud: Encuentra el botón "Send" (generalmente prominentemente mostrado cerca de la barra de URL) y haz clic en él.

Ver la Respuesta: APidog hará la llamada a la API de Mistral. La respuesta del servidor aparecerá en la sección inferior de la ventana de APidog, generalmente bajo una pestaña "Response" o "Body". Deberías ver la respuesta JSON, incluyendo la respuesta del modelo dentro de choices[0].message.content. También puedes inspeccionar los encabezados de respuesta y los códigos de estado (¡esperemos que 200 OK!).

Usar una herramienta como APidog es fantástico para experimentar con diferentes modelos, avisos y parámetros sin escribir ningún código.

Paso 8: Mejores Prácticas y Seguridad (Un Resumen Rápido)

Trabajar con claves de API requiere responsabilidad. Vamos a reiterar algunos puntos cruciales:

- NO Nunca Codifiques Claves: No pegues tu clave de API directamente en tu código fuente (

my_key = "sk-..."). Si comites este código en un repositorio público (como GitHub), tu clave estará expuesta y otros podrían usarla, acumulando cargos en tu cuenta. - Usa Variables de Entorno: Como se mostró en los ejemplos de código, cargar claves desde variables de entorno (

os.environ,process.env) es una práctica estándar mucho más segura. - Herramientas de Gestión de Secretos: Para aplicaciones más robustas, especialmente en entornos de equipo o implementaciones en la nube, usa servicios dedicados de gestión de secretos (como AWS Secrets Manager, Google Secret Manager, HashiCorp Vault).

- Menor Privilegio: Si Mistral permite crear claves con permisos específicos (esto no siempre está disponible), crea claves que solo tengan los permisos necesarios para una aplicación particular.

- Rotación de Claves: Para una mayor seguridad, considera generar periódicamente nuevas claves y retirar las antiguas (por ejemplo, cada pocos meses), aunque esto requiere actualizar tus aplicaciones.

- Monitorea Regularmente: Mantén un ojo en tu panel de uso en la consola de Mistral. La actividad inusual podría indicar una clave comprometida.

Conclusión: ¡Adelante y Construye!

¡Has navegado con éxito por el proceso de obtener y usar una clave de API de Mistral AI! Hemos cubierto:

- Configurar tu cuenta de Mistral y activar la facturación.

- Generar y almacenar de forma segura tu clave de API única.

- Entender los diferentes modelos de Mistral y cómo elegir uno.

- Hacer llamadas a la API utilizando Python, TypeScript y cURL para finalizaciones de chat e incrustaciones.

- Consultar precios y monitorear tu uso.

- Usar una herramienta GUI como APidog para pruebas fáciles de API.

- Reforzar prácticas esenciales de seguridad.

La API de Mistral es una puerta de entrada a capacidades de IA increíblemente poderosas. Tu clave de API es la clave literal para desbloquear ese potencial. Siguiendo los pasos y mejores prácticas aquí descritos, estás bien encaminado para integrar IA de última generación en tus propios proyectos.

No dudes en explorar más la documentación oficial de Mistral: es la fuente definitiva de verdad para todos los parámetros disponibles, modelos y funciones avanzadas.

¡Feliz construcción!

¿Quieres una plataforma integrada, Todo-en-Uno para que tu equipo de desarrolladores trabaje juntos con máxima productividad?

Apidog satisface todas tus demandas y reemplaza a Postman a un precio mucho más asequible!