La API de GPT-5 de OpenAI representa un avance significativo en las capacidades de IA, ofreciendo a los desarrolladores un poder inigualable para construir aplicaciones inteligentes. Ya sea que estés creando chatbots avanzados, automatizando flujos de trabajo complejos o generando contenido dinámico, la API de GPT-5 proporciona las herramientas para hacer realidad tus ideas.

¿Qué es GPT 5 y por qué es importante?

GPT 5 es la IA de última generación de OpenAI, lanzada el 7 de agosto de 2025. Sirve como un sistema unificado con razonamiento incorporado que elige entre pensamiento rápido o profundo según la complejidad de la solicitud. Supera a los modelos anteriores en escritura, codificación, asesoramiento de salud y más, al tiempo que reduce significativamente las alucinaciones y la adulación.

Este modelo es adecuado para escenarios donde la inteligencia a nivel experto y la fiabilidad marcan la diferencia.

Para empezar, necesitas una cuenta de OpenAI, una clave API generada y un entorno de desarrollo. Herramientas como Apidog simplifican las pruebas y la depuración, facilitando la integración de la API de GPT-5 en tus proyectos. Exploremos los requisitos previos para asegurar una configuración fluida.

Requisitos previos para usar la API de GPT-5

Antes de integrar la API de GPT-5, asegúrate de tener lo siguiente:

- Cuenta de OpenAI y clave API: Regístrate en la plataforma de OpenAI y genera una clave API desde el panel de control para autenticar las solicitudes.

- Entorno de Desarrollo: Configura un entorno de codificación con un lenguaje como Python, Node.js o cURL que admita solicitudes HTTP.

- Instalación de Apidog: Descarga Apidog para probar y gestionar llamadas API de manera eficiente. Su interfaz intuitiva ayuda a validar respuestas y depurar problemas.

- Conocimientos Básicos de API: Comprende los métodos HTTP (POST, GET) y el formato JSON para estructurar solicitudes.

Con esto en su lugar, estás listo para configurar tu entorno para la API de GPT-5. A continuación, cubriremos el proceso de configuración en detalle.

Configurando tu entorno para la API de GPT-5

Para interactuar con la API de GPT-5, configura tu entorno de desarrollo usando Python, una opción popular debido a su simplicidad y al robusto SDK de OpenAI. Sigue estos pasos:

Paso 1: Instala el SDK de OpenAI

Instala la biblioteca de Python de OpenAI para simplificar las interacciones con la API. Ejecuta el siguiente comando en tu terminal:

pip install openai

Esto instala la última versión del SDK de OpenAI, compatible con GPT-5.

Paso 2: Protege tu clave API

Genera una clave API desde el panel de control de OpenAI. Almacénala de forma segura en una variable de entorno para evitar la exposición accidental. Por ejemplo, en Python, usa el módulo os:

import os

os.environ["OPENAI_API_KEY"] = "your-api-key-here"

Alternativamente, usa un archivo .env con una biblioteca como python-dotenv para una mayor seguridad.

Paso 3: Verifica la instalación de Apidog

Instala Apidog para optimizar las pruebas. Después de la descarga, configúralo para enviar solicitudes al punto final de la API de GPT-5 (`https://api.openai.com/v1/chat/completions`). Añade tu clave API al encabezado de Autorización en la interfaz de Apidog para una prueba rápida.

Paso 4: Prueba la conectividad

Envía una solicitud de prueba simple para verificar tu configuración. Aquí tienes un ejemplo en Python:

from openai import OpenAI

client = OpenAI()

response = client.chat.completions.create(

model="gpt-5",

messages=[{"role": "user", "content": "Hello, GPT-5!"}]

)

print(response.choices[0].message.content)

Si tiene éxito, recibirás una respuesta de GPT-5. Usa Apidog para monitorear la solicitud y la respuesta para la depuración. Ahora, estructuremos las solicitudes de API para un rendimiento óptimo.

Estructurando las solicitudes de la API de GPT-5

La API de GPT-5 utiliza el punto final /v1/chat/completions, aceptando solicitudes POST con formato JSON. Una solicitud típica incluye el modelo, los mensajes y parámetros opcionales como temperature y max_tokens. Aquí tienes un ejemplo:

from openai import OpenAI

client = OpenAI()

response = client.chat.completions.create(

model="gpt-5",

messages=[

{"role": "system", "content": "You are a coding assistant."},

{"role": "user", "content": "Write a Python function to calculate Fibonacci numbers."}

],

temperature=0.7,

max_tokens=500

)

print(response.choices[0].message.content)

Parámetros clave

- Modelo: Especifica

gpt-5,gpt-5-miniogpt-5-nanosegún tus necesidades. - Mensajes: Un array de objetos de mensaje que definen el contexto de la conversación.

- Temperatura: Controla la aleatoriedad (0.0–2.0). Valores más bajos (por ejemplo, 0.7) aseguran salidas más enfocadas.

- Tokens Máximos: Limita la longitud de la respuesta para gestionar costos y rendimiento.

- Verbosidad: Un nuevo parámetro de GPT-5 (`low`, `medium`, `high`) para controlar el nivel de detalle de la respuesta.

Usa Apidog para probar diferentes combinaciones de parámetros y analizar las estructuras de respuesta. A continuación, exploraremos cómo manejar las respuestas de la API de manera efectiva.

Manejando las respuestas de la API de GPT-5

La API de GPT-5 devuelve respuestas JSON que contienen la salida del modelo, metadatos y detalles de uso. Una respuesta de ejemplo se ve así:

{

"id": "chatcmpl-123",

"object": "chat.completion",

"created": 1694016000,

"model": "gpt-5",

"choices": [

{

"index": 0,

"message": {

"role": "assistant",

"content": "Here's a Python function to calculate Fibonacci numbers:\n```python\ndef fibonacci(n):\n if n <= 0:\n return []\n if n == 1:\n return [0]\n fib = [0, 1]\n for i in range(2, n):\n fib.append(fib[i-1] + fib[i-2])\n return fib\n```"

},

"finish_reason": "stop"

}

],

"usage": {

"prompt_tokens": 20,

"completion_tokens": 80,

"total_tokens": 100

}

}

Analizando respuestas

Extrae el contenido de la respuesta usando Python:

content = response.choices[0].message.content

print(content)

Monitorea el uso de tokens (`usage.total_tokens`) para controlar los costos. La interfaz de Apidog muestra los datos de respuesta claramente, ayudándote a identificar problemas como salidas incompletas. Si ocurren errores, verifica el campo `error` en la respuesta para obtener detalles.

Casos de uso prácticos para la API de GPT-5

La versatilidad de la API de GPT-5 la hace ideal para diversas aplicaciones. Aquí tienes tres casos de uso prácticos:

1. Generación de código

GPT-5 sobresale en la generación de código funcional para tareas complejas. Por ejemplo, pídele que cree una aplicación web:

response = client.chat.completions.create(

model="gpt-5",

messages=[

{"role": "user", "content": "Create a single-page HTML app for a to-do list with JavaScript."}

]

)

La respuesta incluye código completo y ejecutable. Prueba la salida usando Apidog para asegurar la corrección.

2. Creación de contenido

Automatiza la generación de publicaciones de blog proporcionando un tema y pautas:

response = client.chat.completions.create(

model="gpt-5",

messages=[

{"role": "user", "content": "Write a 500-word blog post about AI trends in 2025."}

]

)

Refina las salidas con Apidog para asegurar que el contenido cumpla con tus requisitos de estilo y longitud.

3. Análisis de datos

Usa GPT-5 para analizar conjuntos de datos o generar ideas:

response = client.chat.completions.create(

model="gpt-5",

messages=[

{"role": "user", "content": "Analyze this CSV data and summarize trends: [insert data]."}

]

)

Apidog ayuda a validar la estructura de respuesta de la API para grandes conjuntos de datos.

Optimizando el rendimiento de la API de GPT-5

Para maximizar la eficiencia y minimizar los costos, sigue estas estrategias de optimización:

- Usa Prompts Específicos: Elabora prompts claros y detallados para reducir las salidas irrelevantes. Por ejemplo, en lugar de “Escribe sobre IA”, usa “Escribe un artículo de 300 palabras sobre la ética de la IA en la atención médica.”

- Aprovecha las Variantes: Elige

gpt-5-mini($0.25/1M tokens de entrada, $2/1M tokens de salida) ogpt-5-nano($0.05/1M tokens de entrada, $0.40/1M tokens de salida) para tareas sensibles al costo. El modelo completogpt-5cuesta $1.25/1M tokens de entrada y $10/1M tokens de salida. - Monitorea el Uso de Tokens: Rastrea el

usageen las respuestas para mantenerte dentro del presupuesto. Consulta la página de precios de OpenAI para más detalles. - Prueba con Apidog: Realiza pruebas a pequeña escala para optimizar los prompts antes de escalar.

- Ajusta la Verbosidad: Configura el parámetro

verbositypara equilibrar el detalle de la respuesta y el uso de tokens.

Al optimizar los prompts y seleccionar la variante de modelo adecuada, puedes lograr un alto rendimiento a menores costos. Ahora, abordemos los problemas comunes que podrías encontrar.

Solución de problemas comunes de la API de GPT-5

A pesar de su robustez, la API de GPT-5 puede presentar desafíos. Aquí tienes problemas comunes y soluciones:

- Errores de Autenticación: Asegúrate de que tu clave API sea válida y esté correctamente incluida en el encabezado

Authorization. Verifícala en la configuración de Apidog. - Límites de Tasa: Exceder los límites de uso provoca errores. Monitorea tu cuota en el panel de control de OpenAI y actualiza a un nivel de pago (por ejemplo, Pro por $200/mes para acceso ilimitado a GPT-5) si es necesario.

- Salidas Inesperadas: Refina los prompts para mayor claridad y prueba variaciones en Apidog para identificar la redacción óptima.

- Altos Costos: Usa

gpt-5-miniogpt-5-nanopara tareas menos complejas para reducir el consumo de tokens.

Las herramientas de depuración de Apidog ayudan a identificar problemas rápidamente visualizando los datos de solicitud y respuesta. A continuación, exploraremos cómo Apidog mejora la integración de la API de GPT-5.

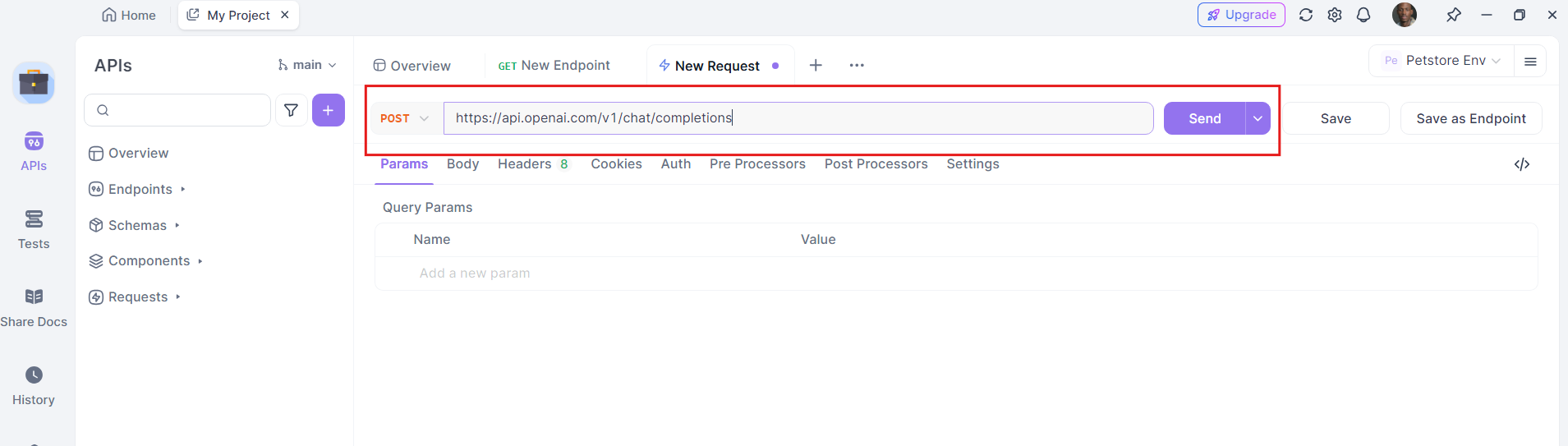

Configuración Rápida: Usando la API de GPT 5 con Apidog

Empieza sin problemas siguiendo estos pasos:

Instala Apidog: Descarga e inicia—es gratis.

Configura una Nueva Solicitud de API:

Método: POST

URL: https://api.openai.com/v1/chat/completions

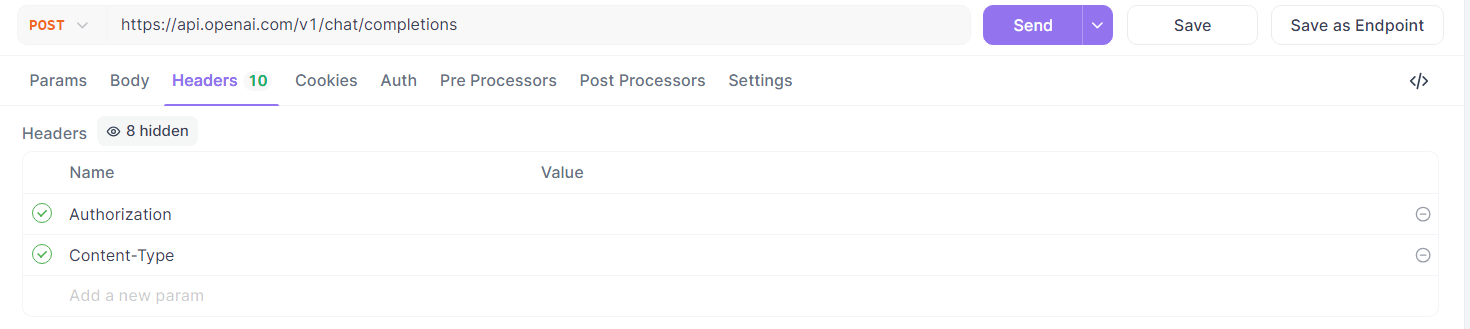

Encabezados:

Authorization: Bearer TU_CLAVE_API

Content-Type: application/json

Prepara tu Carga Útil:

{

"model": "gpt-5",

"messages": [

{"role": "system", "content": "Eres un asistente útil."},

{"role": "user", "content": "Explica claramente los pros y contras del precio de GPT-5."}

],

"reasoning_effort": "low",

"verbosity": "medium"

}

Ajusta "model" a "gpt-5-mini" o "gpt-5-nano" según sea necesario, y usa los parámetros "reasoning_effort" o "verbosity" para controlar el detalle de la salida. (OpenAI)

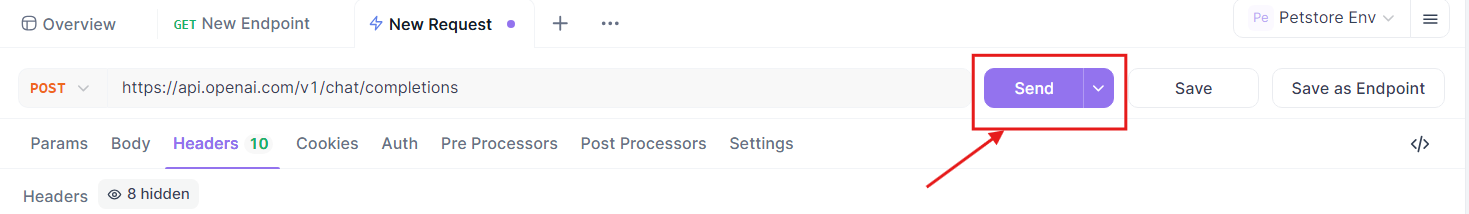

Ejecuta y Valida: Envía la solicitud a través de Apidog. Inspecciona la respuesta de finalización directamente dentro de Apidog.

Itera Gradualmente: Transiciona sin problemas de mini a GPT 5 completo según lo exijan los costos y la complejidad.

Mejores prácticas para usar la API de GPT-5

Para asegurar resultados óptimos, adopta estas mejores prácticas:

- Protege las Claves API: Almacena las claves en variables de entorno o en una solución de bóveda.

- Monitorea los Costos: Revisa regularmente el uso de tokens en el panel de control de OpenAI y optimiza los prompts.

- Pruebas Iterativas: Usa Apidog para probar los prompts incrementalmente antes de desplegar a escala.

- Mantente Actualizado: Sigue el blog de OpenAI para actualizaciones de API y nuevas características.

- Usa Completaciones Seguras: El entrenamiento de completaciones seguras de GPT-5 asegura respuestas más seguras para consultas sensibles. Diseña prompts para aprovechar esta característica.

Al seguir estas prácticas, maximizarás el potencial de la API de GPT-5 mientras mantienes la seguridad y la eficiencia.

Precios de la API que debes conocer

OpenAI ofrece GPT 5 en tres versiones—gpt-5, gpt-5-mini y gpt-5-nano. Te permiten equilibrar rendimiento, velocidad y costo:

| Modelo | Tokens de Entrada (por 1 M) | Tokens de Salida (por 1 M) |

|---|---|---|

| gpt-5 | $1.25 | $10.00 |

| gpt-5-mini | $0.25 | $2.00 |

| gpt-5-nano | $0.05 | $0.40 |

Para comparar, modelos competidores como Gemini 2.5 Flash son más caros para tareas similares. El nivel Pro ($200/mes) ofrece acceso ilimitado a GPT-5, ideal para usuarios intensivos. Siempre consulta la página de precios de OpenAI para actualizaciones.

Conclusión

Ahora tienes una guía sencilla para usar la API de GPT 5, completa con información sobre precios, orientación sobre el uso de la API y cómo Apidog simplifica todo—disponible gratis para equiparte rápidamente.

Continúa ajustando reasoning_effort, verbosity y el tamaño del modelo para que coincidan con las necesidades de tu proyecto. Combínalo con el diseño limpio de Apidog para una iteración rápida.