يتجه المطورون وعشاق الذكاء الاصطناعي بشكل متزايد إلى نماذج توليدية قوية مثل Wan 2.2 لإنشاء مقاطع فيديو سينمائية من مدخلات بسيطة. يتميز هذا النموذج ببنية "مزيج الخبراء" (Mixture-of-Experts) التي تعزز القدرة دون التضحية بالسرعة. عند دمج واجهة برمجة تطبيقات Wan 2.2 (مع LoRA)، تكتسب القدرة على ضبط المخرجات لأنماط أو حركات محددة، مما يجعله مثاليًا لتوليد الفيديو المخصص.

ما هو Wan 2.2؟

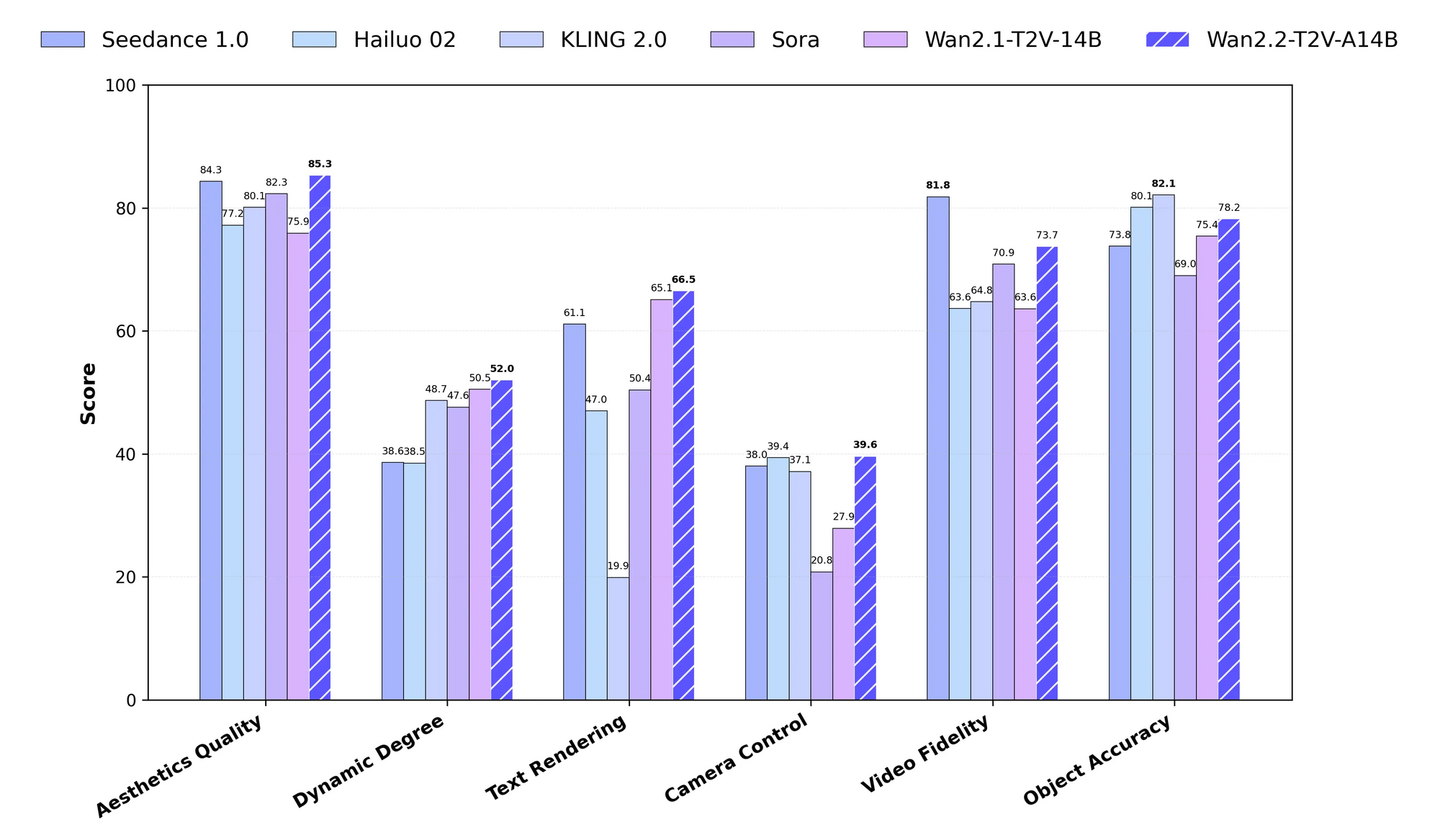

يمثل Wan 2.2 نموذجًا توليديًا متقدمًا ومفتوح المصدر للفيديو على نطاق واسع تم تطويره بواسطة فريق Wan. صممه المهندسون للتعامل مع المهام المعقدة مثل تحويل النص إلى فيديو (T2V)، والصورة إلى فيديو (I2V)، والكلام إلى فيديو (S2V). يستخدم النموذج إطار عمل "مزيج الخبراء" (MoE)، الذي يقسم عملية إزالة الضوضاء في نماذج الانتشار عبر خبراء متخصصين. على سبيل المثال، يدير خبراء الضوضاء العالية المراحل الزمنية المبكرة، بينما يصقل خبراء الضوضاء المنخفضة المراحل اللاحقة. ينتج عن هذا النهج إجمالي 27 مليار معلمة، مع 14 مليار معلمة نشطة فقط لكل خطوة استدلال، مما يضمن الكفاءة.

علاوة على ذلك، يدمج Wan 2.2 جماليات سينمائية من خلال مجموعات بيانات منسقة تؤكد على الإضاءة والتكوين ودرجات الألوان. تتوسع بيانات التدريب بشكل كبير عن الإصدارات السابقة، لتشمل 65.6% المزيد من الصور و 83.2% المزيد من مقاطع الفيديو، مما يعزز تعقيد الحركة والفهم الدلالي. يمكنك الوصول إلى متغيرات مثل نموذج TI2V ذو 5 مليارات معلمة، والذي يولد مقاطع فيديو بدقة 720P بمعدل 24 إطارًا في الثانية على الأجهزة الاستهلاكية مثل RTX 4090.

يتجلى جانب واجهة برمجة التطبيقات بشكل أساسي من خلال البرامج النصية مثل generate.py في المستودع الرسمي، ولكن الأنظمة الأساسية المستضافة توسعها لتشمل نقاط نهاية تعتمد على الويب. لذلك، يمكنك الاختيار بين التنفيذ المحلي للتحكم الكامل أو الخدمات السحابية لقابلية التوسع عند العمل مع واجهة برمجة تطبيقات Wan 2.2 (مع LoRA).

ما هي LoRA في سياق Wan 2.2؟

تعمل LoRA، أو Low-Rank Adaptation، كطريقة ضبط دقيقة موفرة للمعلمات للنماذج الكبيرة مثل Wan 2.2. يطبق المطورون LoRA لتكييف النموذج الأساسي مع مجموعات بيانات محددة دون إعادة تدريب البنية بأكملها. في Wan 2.2، تستهدف LoRA أوزان المحول، مما يسمح لك بإدخال أنماط أو شخصيات أو حركات مخصصة في عمليات توليد الفيديو.

على سبيل المثال، يمكنك تدريب LoRA على مجموعة بيانات من اللقطات المدارية لتخصيص متغير I2V في إنشاء حركات كاميرا دوارة. تحذر الوثائق الرسمية من استخدام LoRA المدربة على Wan 2.2 لمهام معينة مثل الرسوم المتحركة بسبب عدم الاستقرار المحتمل، ولكن أدوات المجتمع تتغلب على ذلك. تدمج الأنظمة الأساسية مثل fal.ai تقنية LoRA مباشرة في واجهة برمجة التطبيقات الخاصة بها، حيث تحدد مسارات لأوزان LoRA وعوامل التحجيم.

وبالتالي، فإن دمج LoRA في واجهة برمجة تطبيقات Wan 2.2 (مع LoRA) يقلل من تكاليف التدريب ويمكّن من التخصيص السريع. يمكنك دمج محولات LoRA في وقت الاستدلال، مما يحافظ على كفاءة النموذج الأساسي مع تحقيق مخرجات مستهدفة.

لماذا تستخدم واجهة برمجة تطبيقات Wan 2.2 مع LoRA؟

تختار واجهة برمجة تطبيقات Wan 2.2 (مع LoRA) للموازنة بين القوة والمرونة في تطبيقات الذكاء الاصطناعي للفيديو. يتطلب الضبط الدقيق التقليدي موارد هائلة، لكن LoRA يقلل من ذلك عن طريق تحديث المصفوفات ذات الرتب المنخفضة فقط. تقلل هذه الطريقة من استخدام الذاكرة ووقت التدريب، مما يجعلها في متناول المطورين الأفراد.

بالإضافة إلى ذلك، تكمل بنية MoE الخاصة بـ Wan 2.2 تقنية LoRA من خلال السماح بتعديلات خاصة بالخبراء. يمكنك إنشاء مقاطع فيديو ذات جماليات أو حركات محسّنة يصعب على النماذج الأساسية إنتاجها. على سبيل المثال، في إنشاء المحتوى، يمكنك استخدام LoRA للحفاظ على أنماط شخصيات متسقة عبر المشاهد.

تزيد واجهات برمجة التطبيقات المستضافة من هذه الفوائد عن طريق نقل الحسابات إلى السحابة. تتولى خدمات مثل fal.ai المهام الشاقة، لذلك يمكنك التركيز على المطالبات والمعلمات. وبالتالي، فإن هذا المزيج يناسب النماذج الأولية والإنتاج والتجريب، خاصة عند دمج أدوات مثل Apidog لإدارة واجهة برمجة التطبيقات بسلاسة.

كيفية إعداد بيئتك للاستخدام المحلي لواجهة برمجة تطبيقات Wan 2.2؟

تبدأ بنسخ مستودع Wan 2.2 من GitHub. نفّذ الأمر git clone https://github.com/Wan-Video/Wan2.2.git في طرفيتك، ثم انتقل إلى الدليل باستخدام cd Wan2.2. بعد ذلك، قم بتثبيت التبعيات باستخدام pip install -r requirements.txt. لمهام S2V، أضف pip install -r requirements_s2v.txt.

تأكد من أن نظامك يشغل PyTorch الإصدار 2.4.0 أو أعلى. يمكنك أيضًا تثبيت Hugging Face CLI باستخدام pip install "huggingface_hub[cli]" لتنزيل النماذج. قم بتعيين متغيرات البيئة إذا كنت تخطط لاستخدام امتداد المطالبة، مثل export DASH_API_KEY=your_key لتكامل Dashscope.

لإعدادات وحدات معالجة الرسومات المتعددة (Multi-GPU)، قم بتكوين Fully Sharded Data Parallel (FSDP) و DeepSpeed Ulysses. يمكنك تمكينها باستخدام علامات مثل --dit_fsdp و --ulysses_size 8. يقوم مستخدمو وحدة معالجة الرسومات الواحدة بتنشيط تحسينات الذاكرة عبر --offload_model و --convert_model_dtype. يهيئ هذا الإعداد لتشغيل برنامج generate.py النصي، وهو جوهر واجهة برمجة تطبيقات Wan 2.2 المحلية (مع LoRA).

كيفية تنزيل وتثبيت نماذج Wan 2.2؟

يمكنك تنزيل النماذج من Hugging Face أو ModelScope. لمتغير T2V-A14B، استخدم huggingface-cli download Wan-AI/Wan2.2-T2V-A14B --local-dir ./Wan2.2-T2V-A14B. كرر هذا لمتغيرات أخرى مثل I2V-A14B أو TI2V-5B.

ضع نقاط التحقق في الدلائل المناسبة. تتطلب النماذج ذات الـ 14 مليار معلمة ذاكرة VRAM كبيرة – حوالي 80 جيجابايت للاستدلال متعدد وحدات معالجة الرسومات – بينما يتناسب TI2V ذو الـ 5 مليارات معلمة مع بطاقة بسعة 24 جيجابايت. بعد التنزيل، تحقق من الملفات لتجنب التلف.

إذا واجهت مشكلات، فانتقل إلى مرايا ModelScope للمناطق التي بها قيود وصول. تضمن هذه الخطوة أن تكون لديك النماذج الأساسية جاهزة قبل تطبيق محولات LoRA في واجهة برمجة تطبيقات Wan 2.2 (مع LoRA).

كيفية استخدام برنامج generate.py النصي للمهام الأساسية في Wan 2.2؟

يمكنك استدعاء برنامج generate.py النصي لتنفيذ عمليات التوليد. لمهمة T2V بسيطة على وحدة معالجة رسومات واحدة، قم بتشغيل python generate.py --task t2v-A14B --size 1280x720 --ckpt_dir ./Wan2.2-T2V-A14B --offload_model True --convert_model_dtype --prompt "Two anthropomorphic cats in comfy boxing gear fight intensely on a spotlighted stage.".

اضبط المعلمات للأوضاع الأخرى. في I2V، أضف --image examples/i2v_input.JPG. لـ S2V، قم بتضمين --audio examples/audio_input.wav وقم بتمكين TTS باستخدام --enable_tts. يستخدم التنفيذ متعدد وحدات معالجة الرسومات torchrun --nproc_per_node=8 generate.py مع علامات FSDP.

تشكل هذه الأوامر العمود الفقري لواجهة برمجة تطبيقات Wan 2.2 المحلية (مع LoRA). يمكنك تجربة المطالبات والأحجام لتحسين المخرجات، والانتقال بسلاسة إلى دمج LoRA للتخصيصات المتقدمة.

كيفية تدريب LoRA لـ Wan 2.2؟

يمكنك تدريب LoRA باستخدام أدوات المجتمع مثل AI Toolkit أو Trooper.AI trainers. أولاً، قم بإعداد مجموعة البيانات الخاصة بك – قم بتنظيم مقاطع الفيديو أو الصور المتوافقة مع أسلوبك المستهدف. بالنسبة لـ I2V LoRA، ركز على المقاطع الخاصة بالحركة مثل اللقطات المدارية.

قم بإعداد بيئة التدريب على منصات مثل RunPod للوصول إلى وحدة معالجة الرسومات. قم بتحميل أوزان Wan 2.2 الأساسية في الدلائل المتوقعة. قم بتكوين المعلمات الفائقة (hyperparameters): اضبط معدل التعلم على 1e-5، وحجم الدفعة على 1، والعصور (epochs) من 10 إلى 20 اعتمادًا على حجم مجموعة البيانات.

قم بتشغيل برنامج التدريب النصي، مع مراقبة مقاييس الخسارة. تسهل أدوات مثل مكتبة PEFT من Hugging Face ذلك، مما يتيح لك حفظ LoRA كملف .safetensors. بمجرد التدريب، يمكنك تطبيق هذا المحول في عمليات التوليد، مما يعزز واجهة برمجة تطبيقات Wan 2.2 (مع LoRA) للمهام المتخصصة.

كيفية تطبيق LoRA في التوليد المحلي لـ Wan 2.2؟

يمكنك دمج LoRA في الإعدادات المحلية عبر ComfyUI أو البرامج النصية المخصصة. في ComfyUI، استخدم عقدة LoadLoRAModelOnly بين محمل النموذج وأخذ العينات. حدد مسار LoRA وقوته (على سبيل المثال، 0.8).

بالنسبة لـ generate.py، تضيف التفرعات أو الإضافات المجتمعية دعم LoRA، حيث يفتقر الإصدار الرسمي إلى التكامل المباشر. بدلاً من ذلك، استخدم مسار Diffusers لأوضاع الرسوم المتحركة، بتحميل LoRA باستخدام pipe.load_lora_weights("path/to/lora").

يحول هذا التطبيق المخرجات القياسية إلى مقاطع فيديو مخصصة. وبالتالي، يمكنك تحقيق الاتساق في الأنماط أو الحركات، مما يجعل واجهة برمجة تطبيقات Wan 2.2 (مع LoRA) أكثر مرونة للاستخدام في الإنتاج.

ما هي أفضل الخدمات المستضافة لواجهة برمجة تطبيقات Wan 2.2 مع LoRA؟

يمكنك الوصول إلى واجهة برمجة تطبيقات Wan 2.2 المستضافة (مع LoRA) عبر منصات مثل fal.ai. تدعم نقطة النهاية الخاصة بهم على https://api.fal.ai/v1/fal-ai/wan/v2.2-a14b/text-to-video/lora LoRA بشكل أصلي. اشترك للحصول على مفتاح API وقم بتكوينه في عميلك.

تشمل الخدمات الأخرى WaveSpeed.ai لـ I2V LoRA و Trooper.AI للتدريب. تلغي هذه الخدمات الحاجة إلى الأجهزة المحلية، وتتوسع بسهولة إلى درجات دقة عالية. وبالتالي، يمكنك إنشاء نماذج أولية بشكل أسرع، مع التكامل مع أدوات مثل Apidog لإدارة الطلبات.

كيفية المصادقة وإرسال الطلبات إلى واجهة برمجة تطبيقات fal.ai Wan 2.2؟

يمكنك المصادقة عن طريق تعيين متغير البيئة FAL_KEY. قم بتثبيت عميل fal-ai باستخدام npm install --save @fal-ai/client لـ JavaScript، أو استخدم ما يعادله في Python.

أرسل طلب POST مع حمولة JSON تتضمن prompt ومصفوفة loras. على سبيل المثال: {"prompt": "A cyberpunk cityscape at night", "loras": [{"path": "https://example.com/loras/cyberpunk.safetensors", "scale": 0.8}]}.

راقب الاستجابات بحثًا عن عناوين URL لمقاطع الفيديو. تستفيد هذه العملية من واجهة برمجة تطبيقات Wan 2.2 (مع LoRA) في البيئات السحابية، مما يضمن أداءً موثوقًا.

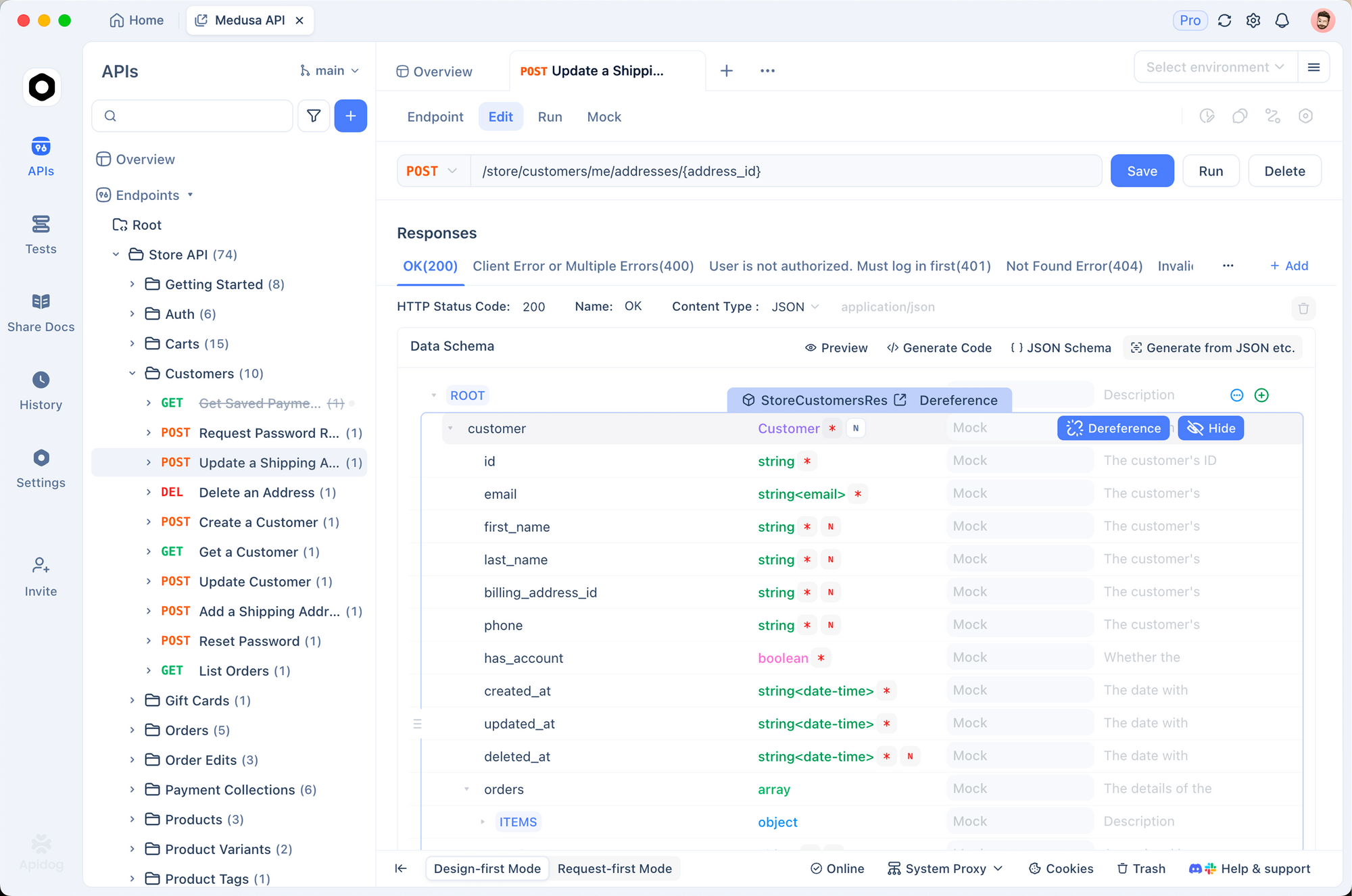

كيفية استخدام Apidog لاختبار واجهة برمجة تطبيقات Wan 2.2 مع LoRA؟

تبدأ بتثبيت Apidog وإنشاء مشروع API جديد. قم باستيراد تفاصيل نقطة نهاية fal.ai، مع تعيين الطريقة إلى POST وعنوان URL إلى مسار LoRA لتحويل النص إلى فيديو.

أضف رؤوسًا للمصادقة، مثل Authorization: Key your_fal_key. في علامة تبويب الجسم (Body)، قم بإنشاء JSON بمعلمات المطالبة وLoRA. أرسل الطلب وافحص الاستجابة، التي تتضمن رابط الفيديو الذي تم إنشاؤه.

تعمل ميزات Apidog مثل متغيرات البيئة والتحقق من الاستجابة على تبسيط تصحيح الأخطاء. على سبيل المثال، يمكنك حفظ تكوينات LoRA الشائعة كمجموعات. وبالتالي، يعزز Apidog سير عملك عند اختبار واجهة برمجة تطبيقات Wan 2.2 (مع LoRA)، مما يسمح بتكرارات سريعة.

ما هي المعلمات التي يجب ضبطها في واجهة برمجة تطبيقات Wan 2.2 مع LoRA؟

تقوم بضبط المعلمات الرئيسية لتحسين المخرجات. اضبط num_inference_steps على 27 لتحقيق التوازن، أو أعلى للحصول على جودة أفضل. تؤثر مقاييس الإرشاد مثل 3.5 على الالتزام بالمطالبات.

بالنسبة لـ LoRA، اضبط scale بين 0.5-1.0 للتحكم في قوة المحول. تتضمن خيارات الدقة 720p، بينما تتراوح معدلات الإطارات في الثانية (FPS) من 4-60. قم بتمكين التسريع لتوليد أسرع، على الرغم من أنه قد يقلل من الدقة.

بالإضافة إلى ذلك، استخدم المطالبات السلبية لتجنب العناصر غير المرغوب فيها. تعمل هذه الضبطات على تحسين واجهة برمجة تطبيقات Wan 2.2 (مع LoRA)، لتتكيف مع احتياجات المشروع المحددة.

كيفية التعامل مع المدخلات متعددة الأنماط في Wan 2.2 مع LoRA؟

يمكنك دمج الصور أو الصوت عن طريق تحديد --image أو --audio في البرامج النصية المحلية، أو الحقول المكافئة في واجهات برمجة التطبيقات المستضافة. طبق LoRA لتحسين هذه المدخلات، مثل تنسيق مخرجات I2V.

في fal.ai، أضف image_url لأوضاع TI2V. تقوم LoRA بتكييف الدمج، مما يضمن مقاطع فيديو متماسكة. وبالتالي، يمكنك إنشاء محتوى ديناميكي مثل الشخصيات المتحركة، مستفيدًا من الإمكانات الكاملة لواجهة برمجة تطبيقات Wan 2.2 (مع LoRA).

ما هي تقنيات التحسين المتقدمة للاستدلال في Wan 2.2؟

يمكنك استخدام تحسينات الذاكرة مثل تفريغ النموذج (model offloading) وتحويل نوع البيانات (dtype conversion) للتشغيل على أجهزة محدودة. بالنسبة لوحدات معالجة الرسومات المتعددة (multi-GPU)، يوزع FSDP الأجزاء بكفاءة.

في الإعدادات المستضافة، قم بوضع الطلبات غير المتزامنة في قائمة الانتظار للتعامل مع الدفعات. استخدم توسيع المطالبات مع نماذج اللغة الكبيرة (LLMs) لإثراء المدخلات. تعمل هذه التقنيات على تسريع واجهة برمجة تطبيقات Wan 2.2 (مع LoRA)، مما يجعلها مناسبة للتطبيقات في الوقت الفعلي.

كيفية دمج واجهة برمجة تطبيقات Wan 2.2 مع LoRA في التطبيقات؟

يمكنك بناء تطبيقات عن طريق تغليف استدعاءات API في خدمات الواجهة الخلفية. على سبيل المثال، قم بإنشاء خادم Node.js يقوم بتوكيل طلبات fal.ai، مع إضافة LoRA بناءً على مدخلات المستخدم.

تعامل مع خطاطيف الويب (webhooks) للمهام طويلة الأمد، لإعلام المستخدمين عند الانتهاء. ادمج مع الواجهات الأمامية لتوليد الفيديو التفاعلي. يدمج هذا التكامل واجهة برمجة تطبيقات Wan 2.2 (مع LoRA) في أدوات مثل منصات المحتوى.

ما هي الأمثلة التي توضح Wan 2.2 مع LoRA قيد التنفيذ؟

فكر في إنشاء مشهد سايبربانك: استخدم المطالبة "شوارع مضاءة بالنيون مع سيارات طائرة" (Neon-lit streets with flying cars) وتقنية LoRA المدربة على فن الدستوبيا. ينتج عن ذلك مقاطع فيديو مصممة بأسلوب خاص بتفاصيل محسّنة.

مثال آخر: تدريب LoRA على حركات الرقص لـ S2V، ومزامنة الصوت مع تصميم الرقصات. توضح هذه الحالات الاستخدامات العملية لواجهة برمجة تطبيقات Wan 2.2 (مع LoRA).

كيفية استكشاف المشكلات الشائعة وإصلاحها في واجهة برمجة تطبيقات Wan 2.2 وLoRA؟

تعالج أخطاء نفاد الذاكرة عن طريق تمكين علامات التفريغ (offload flags) أو تقليل الدقة. إذا تسببت LoRA في عدم الاستقرار، فقلل المقاييس أو أعد التدريب باستخدام مجموعات بيانات مستقرة.

بالنسبة لأخطاء واجهة برمجة التطبيقات، تحقق من المصادقة وصحة المعلمات في Apidog. تتطلب مشكلات الشبكة منطق إعادة المحاولة. وبالتالي، يمكنك حل المشكلات بكفاءة، مع الحفاظ على عمليات سلسة باستخدام واجهة برمجة تطبيقات Wan 2.2 (مع LoRA).

ما هي التطورات المستقبلية التي قد تؤثر على Wan 2.2 مع LoRA؟

يواصل الباحثون تطوير نماذج الانتشار، مع إمكانية دمج متغيرات LoRA أكثر كفاءة. قد تضيف مساهمات المجتمع دعم LoRA الأصلي إلى البرامج النصية الرسمية.

يمكن للخدمات المستضافة توسيع طرق العمل. البقاء على اطلاع يضمن لك الاستفادة من التطورات في واجهة برمجة تطبيقات Wan 2.2 (مع LoRA).

الخلاصة

أنت الآن تمتلك فهمًا شاملاً لكيفية الوصول إلى واجهة برمجة تطبيقات Wan 2.2 (مع LoRA) واستخدامها. بدءًا من الإعدادات المحلية وصولاً إلى واجهات برمجة التطبيقات المستضافة، وباستخدام أدوات مثل Apidog، يمكنك إنشاء مقاطع فيديو رائعة. طبق هذه التقنيات للابتكار في إنشاء المحتوى المدعوم بالذكاء الاصطناعي.