يتقدم مجال تكنولوجيا تحويل النص إلى كلام (TTS) بسرعة هائلة، متجاوزًا بكثير الأصوات الروبوتية في الماضي. يمكن أن تنتج أنظمة TTS الحديثة المدفوعة بالذكاء الاصطناعي الكلام البشري الواقعي والعاطفي بشكل ملحوظ، مما يخلق إمكانيات جديدة لمبدعي المحتوى والمطورين والشركات. بينما قادت خدمات السحابة المعقدة مثل Eleven Labs هذا المجال عبر إخراج عالي الجودة واستنساخ الأصوات، غالبًا ما تأتي بتكاليف اشتراك، واعتبارات خصوصية البيانات، والتحكم المحدود من قبل المستخدم.

هنا يأتي دور نماذج TTS مفتوحة المصدر التي تترك أثرًا كبيرًا. من خلال تقديم الشفافية والمرونة والابتكار المدفوع من المجتمع، فإنها تقدم بدائل مثيرة. واحدة من الوافدين الجدد الملحوظين في هذا المجال هي Dia-1.6B، التي طورتها Nari Labs. يتميز هذا النموذج بـ 1.6 مليار معلمة، ويتفوق ليس فقط في TTS القياسي ولكنه مصمم خصيصًا لتوليد الحوار الواقعي، مكتملًا بإشارات غير لفظية وخصائص صوت قابلة للتحكم.

تقدم هذه المقالة دليلًا شاملًا عن Dia-1.6B. سنستكشف قدراته الفريدة، ونوضح لماذا يقف كمعارض قوي مفتوح المصدر للمنصات الراسخة، ونمر عبر الخطوات لتشغيله على أجهزتك المحلية، ونغطي متطلباته التقنية، ونناقش الاعتبارات الأخلاقية الأساسية المحيطة باستخدامه. إذا كنت تبحث عن حل TTS قوي وقابل للتكيف وشفاف تحت سيطرتك المباشرة، فإن Dia-1.6B يستحق النظر الجاد.

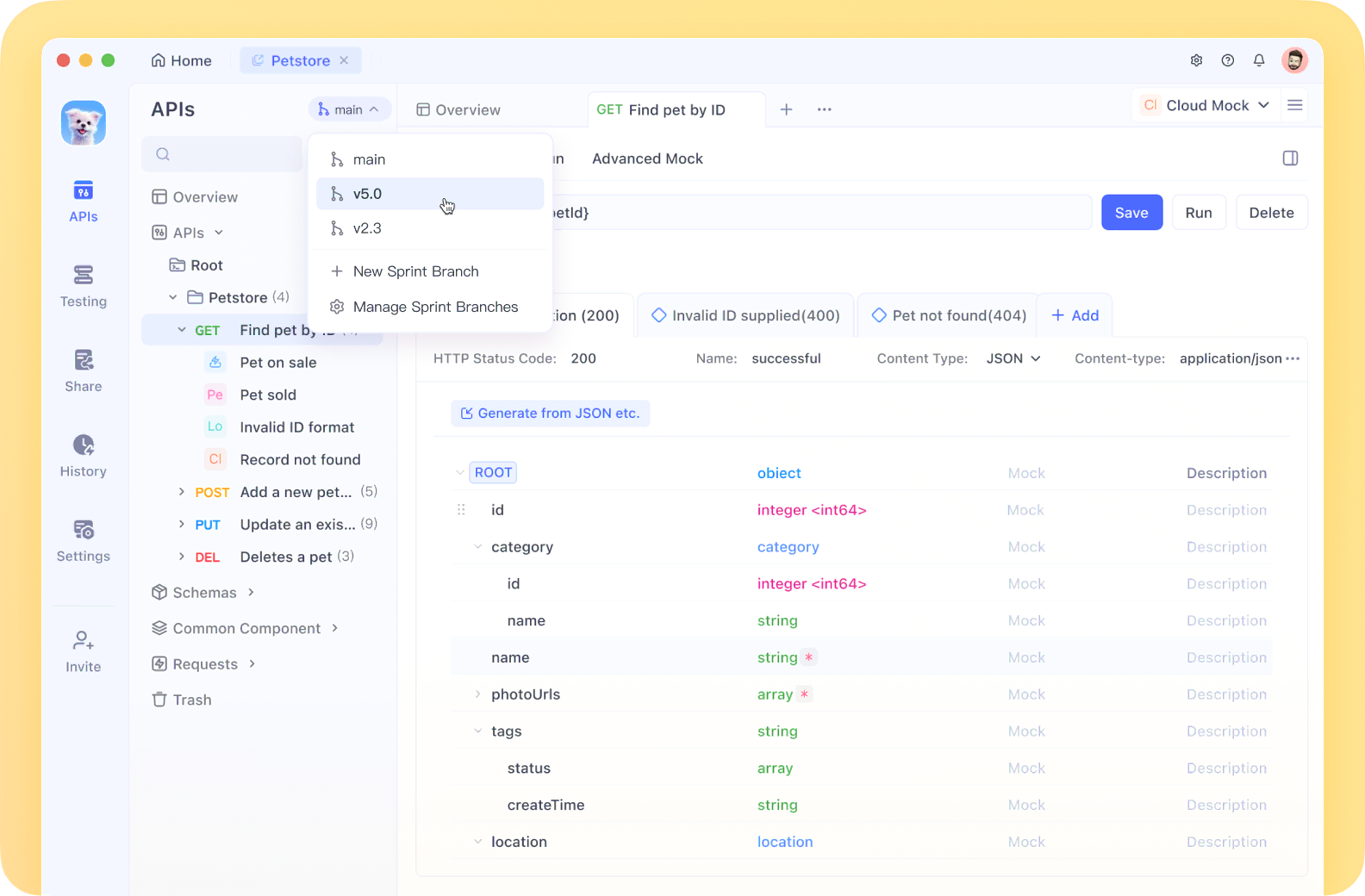

هل تريد منصة متكاملة وشاملة لفريق المطورين الخاص بك للعمل معًا ب أقصى إنتاجية?

Apidog يلبي جميع مطالبك، و يستبدل Postman بسعر أكثر قابلية للتحمل بكثير!

ما هو Dia-1.6B؟ مقدمة

Dia-1.6B هو نموذج لغوي كبير مصمم لتوليف النص إلى كلام، تم إنشاؤه بواسطة Nari Labs وجعله متاحًا عبر منصة Hugging Face. تكمن ميزته الأساسية في تحسينه لتوليد الحوار التفاعلي بدلاً من الجمل المعزولة.

Dia رائع بشكل مطلق 🤯

— Victor M (@victormustar) 22 أبريل 2025

نموذج TTS بمعلمات 1.6 مليار لإنشاء حوار واقعي من النص. تحكم في العاطفة/النغمة عبر تعديل الصوت + توليد إشارات غير لفظية مثل الضحك والسعال. مرخص Apache 2.0 🔥

⬇️ شارك العرض التقديمي عبر الإنترنت أدناه pic.twitter.com/b7jglAcwbG

تشمل الخصائص الرئيسية:

- حجم النموذج: مع 1.6 مليار معلمة، يمتلك Dia القدرة على التقاط تعقيدات الخطاب، بما في ذلك النغمة والإيقاع والنبرة العاطفية.

- توليد الحوار: تم بناؤه لمعالجة النصوص التي تحتوي على متحدثين متعددين. تحدد علامات بسيطة مثل

[S1]و[S2]المتحدثين المختلفين، مما يمكّن من إنشاء محادثات طبيعية بينهما. - التواصل غير اللفظي: لتعزيز الواقعية، يمكن لـ Dia توليد أصوات غير لفظية شائعة مثل الضحك (

(ضحك))، والسعال ((سعال))، أو clearing throat ((يخنق الحنجرة)) مباشرة عندما يتم تضمين هذه الإشارات في النص المدخل. - تعديل الصوت: يمكن للمستخدمين التأثير على صوت الإخراج من خلال تقديم عينة صوتية مدخلة. هذه الميزة تتيح التحكم في عاطفة ونغمة الخطاب الناتج وتشكّل الأساس لخصائص استنساخ الصوت الخاصة به.

- الأوزان والكود المفتوح: تم إصدار Dia-1.6B مع أوزان نموذج مفتوحة وكود استدلال تحت الترخيص الآمن Apache 2.0. وهذا يسمح لأي شخص بتنزيل النموذج وفحصه وتعديله واستخدامه بحرية، مما يعزز التعاون والشفافية. يتم استضافة أوزان النموذج على Hugging Face.

- دعم اللغات: حاليًا، يدعم Dia-1.6B توليد اللغة الإنجليزية فقط.

كما تقدم Nari Labs صفحة عرض توضيحي تقارن Dia-1.6B باستوديو ElevenLabs و Sesame CSM-1B، وبفضل دعم Hugging Face، تتوفر مساحة ZeroGPU للمستخدمين لتجربة النموذج دون إعداد محلي.

الميزات الرئيسية لـ Dia-1.6B

يميز Dia نفسه من خلال العديد من الميزات الأساسية:

- توليف الحوار الواقعي: هيكله مصمم بشكل خاص لتوليد محادثات تبدو طبيعية بين عدة متحدثين يتم تحديدهم بواسطة علامات نصية بسيطة.

- الأصوات غير اللفظية المدمجة: القدرة على إنتاج أصوات مثل الضحك أو السعال مباشرة من إشارات النص تضيف مستوى كبير من المصداقية الذي غالبًا ما يفتقر إليه TTS القياسي.

- استنساخ الصوت وتعديله: من خلال تقديم عينة صوتية مرجعية ونصها (بتنسيق صحيح)، يمكن للمستخدمين تعديل إخراج النموذج لمحاكاة خصائص صوت العينة أو التحكم في نغمتها العاطفية. يتوفر نص مثال (

example/voice_clone.py) في المستودع. تتيح المساحة الخاصة بـ Hugging Face أيضًا تحميل الصوت من أجل الاستنساخ. - سهولة الوصول مفتوحة المصدر: تم إصداره تحت ترخيص Apache 2.0 مع أوزان مفتوحة، مما يمكّن المستخدمين من الوصول الكامل إلى النموذج للبحث أو التطوير أو المشاريع الشخصية، بعيدًا عن قيود البائع.

Dia-1.6B مقابل Elevenlabs مقابل Sesame 1B: مقارنة سريعة

pic.twitter.com/kaFdal8a9n لنذهب، نموذج TTS مفتوح المصدر يتفوق على Elevenlabs و Sesame 1b بسعر 1.6b فقط.

— Chubby♨️ (@kimmonismus) 22 أبريل 2025

Dia 1.6b رائع بشكل مطلق. هذا يكاد لا يتفوق عليه شيء. https://t.co/mCAWSOaa8q

بينما تقدم منصات مثل Eleven Labs واجهات مصقولة ونتائج عالية الجودة، يقدم Dia-1.6B مزايا واضحة متأصلة في نهجه المفتوح المصدر والأول محليًا:

- التكلفة: عادة ما تتضمن خدمات السحابة رسوم اشتراك أو تسعير يعتمد على الاستخدام، مما قد يصبح كبيرًا. Dia-1.6B مجاني للتنزيل والاستخدام؛ التكاليف الوحيدة هي الاستثمار في الأجهزة واستهلاك الكهرباء.

- التحكم والخصوصية: يعني استخدام TTS السحابي إرسال بيانات نصك إلى خوادم خارجية. يضمن تشغيل Dia محليًا أن تبقى بياناتك تمامًا على جهازك، مما يوفر أقصى قدر من الخصوصية وال控制، وهو أمر حيوي للمعلومات الحساسة.

- الشفافية والتخصيص: تسمح الأوزان المفتوحة بالتفتيش، والأهم من ذلك، الضبط الدقيق على مجموعات بيانات أو أصوات معينة لأغراض فريدة. هذا المستوى من التخصيص عادة ما يكون مستحيلًا مع الأنظمة المغلقة والملكية.

- القدرة على العمل في وضع عدم الاتصال: تتطلب منصات السحابة اتصالًا بالإنترنت. يمكن لـ Dia، بمجرد تثبيته، العمل بالكامل في وضع عدم الاتصال، مما يجعله مناسبًا للبيئات ذات الاتصال المحدود أو الاحتياجات الأمنية المتزايدة.

- المجتمع والابتكار: تستفيد المشاريع مفتوحة المصدر من مساهمات المجتمع، بما في ذلك إصلاح الأخطاء، وتعزيز الميزات، والتطبيقات الجديدة، مما قد يسرع التقدم إلى ما بعد قدرة بائع واحد. تشجع Nari Labs المشاركة المجتمعية عبر خادم Discord الخاص بهم.

- الحرية من الاحتكار البائع: يعتمد الاعتماد على خدمة ملكية واحدة على الاعتماد. إذا غيّر المزود الأسعار أو الميزات أو الشروط، فإن الخيارات المتاحة للمستخدمين تكون محدودة. يوفر المصدر المفتوح الحرية للتكيف والتبديل.

يعني اختيار Dia-1.6B اختيار مزيد من التحكم والخصوصية والفعالية من حيث التكلفة على حساب الراحة واحتياجات الأجهزة.

البدء: تشغيل Dia-1.6B محليًا

إليك كيفية إعداد وتشغيل Dia-1.6B على جهاز الكمبيوتر الخاص بك، بناءً على تعليمات Nari Labs.

متطلبات الأجهزة

- اعتماد GPU: حاليًا، يتطلب Dia-1.6B وحدة معالجة رسومات NVIDIA معتمدة بـ CUDA. الدعم لوحدة المعالجة المركزية مخطط له لكنه لم يتم تنفيذه بعد.

- VRAM: يحتاج النموذج الكامل تقريبًا إلى 10 جيجابايت من ذاكرة GPU. يتطلب ذلك عادةً وحدات معالجة رسومات متوسط إلى عالي المستوى (مثل RTX 3070/4070 أو أفضل) أو بطاقات مؤسسات (مثل A4000). تهدف الإصدارات المستقبلية الكمية إلى تقليل هذا بشكل كبير.

- سرعة الاستدلال: تعتمد الأداء على GPU. على وحدات معالجة الرسومات المؤسسية، يمكن أن تكون سرعة التوليد أسرع من الزمن الحقيقي. في وحدة NVIDIA A4000، قامت Nari Labs بقياس تقريبًا 40 رمزًا/ثانية (حيث تشكل ~86 رمزًا 1 ثانية من الصوت). ستكون وحدات معالجة الرسومات الأقدم أبطأ.

بالنسبة للمستخدمين الذين ليس لديهم أجهزة مناسبة، تقترح Nari Labs تجربة مساحة Hugging Face ZeroGPU أو الانضمام إلى قائمة الانتظار للوصول إلى إصدارات أكبر مستضافة من نماذجهم.

المتطلبات الأساسية

- GPU: يجب أن تكون وحدة معالجة الرسومات NVIDIA المعتمدة بـ CUDA أساسية. تم اختبار النموذج مع PyTorch 2.0+ و CUDA 12.6. تأكد من أن برامج تشغيل GPU الخاصة بك محدثة.

- VRAM: تحتاج حوالي 10 جيجابايت من ذاكرة GPU للنموذج الكامل بمعلمات 1.6B. (الإصدارات الكمية المخططة للمستقبل ستخفض هذا).

- بايثون: تثبيت بايثون يعمل (مثل بايثون 3.8+).

- Git: مطلوب لاستنساخ مستودع البرمجيات.

- uv (موصى به): تستخدم Nari Labs

uv، وهو مدير حزم بايثون سريع. قم بتثبيته إذا لم يكن لديك (pip install uv). بينما هو اختياري، فإن استخدامه يبسط الإعداد.

التثبيت والبداية السريعة (واجهة Gradio)

استنساخ المستودع:

افتح الطرفية/موجه الأوامر، وانتقل إلى دليل التثبيت المطلوب، وشغّل:

git clone https://github.com/nari-labs/dia.git

انتقل إلى الدليل:

cd dia

تشغيل التطبيق (باستخدام uv):

هذه هي الطريقة الموصى بها. إنها تتعامل مع إنشاء البيئة الافتراضية وتثبيت الاعتماديات تلقائيًا.

uv run app.py

في المرة الأولى التي تنفذ فيها هذا الأمر، ستقوم بتنزيل الاعتمادات، بما في ذلك PyTorch ومكتبات Hugging Face و Gradio، وأوزان نموذج Dia (~1.6B معلمة)، ومكونات ترميز الصوت Descript. قد تستغرق هذه الإعداد الأولي بعض الوقت. ستكون عمليات البدء اللاحقة أسرع بكثير.

تشغيل التطبيق (بديل يدوي):

إذا لم تكن تستخدم uv، فعادةً ما ستقوم بما يلي:

# إنشاء بيئة افتراضية

python -m venv .venv

# تنشيطها (الصياغة تختلف حسب نظام التشغيل)

# Linux/macOS: source .venv/bin/activate

# Windows: .venv\Scripts\activate

# تثبيت الاعتمادات (تحقق من ملف pyproject.toml للتفاصيل)

pip install -r requirements.txt # أو ما يعادل ذلك

# تشغيل التطبيق

python app.py

(ملاحظة: تحقق من ملف pyproject.toml في المستودع المستنسخ للحصول على القائمة الدقيقة للحزم المطلوبة إذا قمت بالتثبيت يدويًا.)

- الوصول إلى واجهة Gradio:

بمجرد بدء الخادم، ستعرض طرفيتك عنوان URL محلي، عادةً مثلhttp://127.0.0.1:7860. افتح هذا العنوان في متصفح الويب الخاص بك.

استخدام واجهة Gradio:

تتيح واجهة الويب التفاعل السهل:

- إدخال النص: اكتب أو الصق نصك. استخدم

[S1]،[S2]، إلخ، للمتحدثين و(ضحك)،(سعال)للأصوات غير اللفظية. - تنبيه صوتي (اختياري): قم بتحميل ملف صوت مرجعي لتوجيه نمط الصوت أو تنفيذ الاستنساخ. تذكر أن تضع نص الصوت المرجعي قبل نصك الرئيسي في إدخال النص، وفقًا للتنسيق المطلوب (انظر الأمثلة).

- توليد: انقر على الزر لبدء التوليف. يعتمد وقت المعالجة على GPU الخاص بك وطول النص.

- الإخراج: سيظهر الصوت الناتج مع عناصر التحكم في التشغيل وخيار التنزيل.

ملاحظة حول اتساق الصوت: لم يتم ضبط نموذج Dia-1.6B الأساسي على صوت محدد. نتيجة لذلك، قد يؤدي توليد الصوت عدة مرات من نفس النص إلى أصوات مختلفة. لتحقيق إ output consistent بين الأجيال، يمكنك إما:

- استخدام تنبيه صوتي: قدم مقطع صوتي مرجعي (كما هو موضح أعلاه).

- تثبيت البذور: تعيين قيمة بذور عشوائية محددة (إذا كانت واجهة Gradio أو وظيفة المكتبة تعرض هذه المعلمة).

للتكامل في التطبيقات المخصصة، إليك مثال على نص بايثون وكيفية استخدام Dia:

import soundfile as sf

# التأكد من أن حزمة 'dia' مثبتة بشكل صحيح أو متاحة في مسار بايثون الخاص بك

from dia.model import Dia

# تحميل النموذج المدرب مسبقًا من Hugging Face (يقوم بالتنزيل إذا لزم الأمر)

model = Dia.from_pretrained("nari-labs/Dia-1.6B")

# إعداد النص المدخل مع علامات الحوار والإشارات غير اللفظية

text = "[S1] Dia هو نموذج نص إلى حوار بالأوزان المفتوحة. [S2] يمكنك التحكم الكامل في النصوص والأصوات. [S1] واو. مذهل. (ضحك) [S2] جربه الآن على Git hub أو Hugging Face."

# توليد الموجات الصوتية (يحتاج إلى GPU)

# الإخراج عادةً يكون مصفوفة NumPy

output_waveform = model.generate(text)

# تحديد معدل العينة (غالبًا ما يستخدم Dia 44100 هرتز)

sample_rate = 44100

# حفظ الصوت الناتج في ملف

output_filename = "dialogue_output.wav" # أو .mp3، إلخ.

sf.write(output_filename, output_waveform, sample_rate)

print(f"تم حفظ الصوت بنجاح في {output_filename}")

من المخطط إصدار حزمة PyPI وأداة واجهة سطر الأوامر (CLI) لتبسيط هذا الأمر في المستقبل.

هل تريد منصة متكاملة وشاملة لفريق المطورين الخاص بك للعمل معًا ب أقصى إنتاجية?

Apidog يلبي جميع مطالبك، و يستبدل Postman بسعر أكثر قابلية للتحمل بكثير!

الخاتمة: صوتك، سيطرتك

تشكل Dia-1.6B من Nari Labs علامة فارقة كبيرة في مجال النص إلى كلام مفتوح المصدر. إن تركيزها الفريد على توليد الحوار، واحتوائها على أصوات غير لفظية، والتزامها بالأوزان المفتوحة بموجب ترخيص Apache 2.0 يجعلها بديلاً قويًا للمستخدمين الذين يسعون لتحقيق المزيد من التحكم والخصوصية والتخصيص مقارنةً بما تقدمه الخدمات السحابية التقليدية. بينما تتطلب أجهزة قادرة ودرجة من الإعداد الفني، فإن الفوائد - عدم وجود رسوم استخدام مستمرة، السيادة الكاملة على البيانات، التشغيل في وضع عدم الاتصال، والقدرة على التكيف العميق - هي مزايا مثيرة. مع استمرار تطور Dia من خلال تحسينات مخطط لها مثل الكمية ودعم CPU، من المقرر أن تنمو قابليتها للوصول وفائدتها، مما يعزز دور المصدر المفتوح في مستقبل توليف الصوت. بالنسبة لأولئك الذين لديهم القدرة والاستعداد لتشغيل النماذج محليًا، يوفر Dia-1.6B طريقًا لامتلاك حقًا قدراتك في توليد الصوت.