تُطوّر OpenAI قدرات الذكاء الاصطناعي من خلال تقديم gpt-realtime إلى جانب تحسينات كبيرة لواجهة برمجة تطبيقات الوقت الفعلي (Realtime API). يستهدف هذا التطور المطورين الذين يبنون تطبيقات صوتية تفاعلية، حيث يوفر معالجة مباشرة من الكلام إلى الكلام تلتقط الفروق الدقيقة مثل النبرة والإشارات غير اللفظية. يمكن للمهندسين الآن الوصول إلى نموذج يعالج المدخلات الصوتية ويولد استجابات بزمن انتقال منخفض، مما يمثل تحولًا في كيفية تعامل الذكاء الاصطناعي مع المحادثات في الوقت الفعلي.

علاوة على ذلك، يتوافق هذا التحديث مع الطلب المتزايد على أنظمة الذكاء الاصطناعي متعددة الوسائط. يدمج المطورون الصوت والنص والصور بسلاسة، مما يوسع الإمكانيات لتطبيقات خدمة العملاء والمساعدين الافتراضيين والترفيه التفاعلي. بينما نستكشف هذه التطورات، فكر كيف تؤدي التحسينات الصغيرة في تصميم واجهة برمجة التطبيقات إلى تحسينات جوهرية في تجربة المستخدم.

فهم GPT-Realtime: النموذج الأساسي

تطلق OpenAI نموذج gpt-realtime كنموذج متخصص مصمم للتفاعلات الشاملة من الكلام إلى الكلام. يلغي هذا النموذج المسارات التقليدية التي تفصل التعرف على الكلام، ومعالجة اللغة، وتوليف النص إلى كلام. بدلاً من ذلك، يتعامل مع كل شيء في إطار موحد، مما يقلل من زمن الانتقال ويحافظ على دقة الكلام البشري.

يتفوق gpt-realtime في توليد مخرجات صوتية طبيعية. على سبيل المثال، يستجيب لتعليمات مثل "تحدث بسرعة واحترافية" أو "اتخذ نبرة متعاطفة بلكنة فرنسية". يُمكّن هذا التحكم الدقيق المطورين من تكييف أصوات الذكاء الاصطناعي مع سيناريوهات محددة، مما يعزز التفاعل في التطبيقات الواقعية.

بالإضافة إلى ذلك، يُظهر النموذج ذكاءً فائقًا في معالجة المدخلات الصوتية الأصلية. يكتشف العناصر غير اللفظية، مثل الضحك أو التوقفات المؤقتة، ويتكيف وفقًا لذلك. إذا قام المستخدم بتبديل اللغات في منتصف الجملة، فإن gpt-realtime يتبعه دون انقطاع.

تأتي هذه القدرة من التدريب المتقدم على مجموعات بيانات متنوعة، مما يمكّنه من تحقيق نتيجة 30.5% في معيار MultiChallenge الصوتي — وهو تحسن ملحوظ عن التكرارات السابقة.

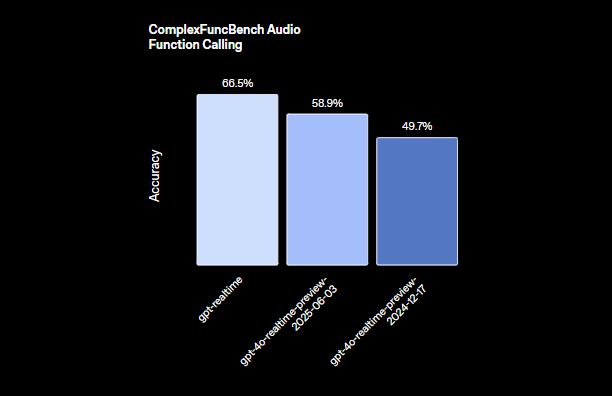

يقدّر المهندسون كيفية دمج gpt-realtime لاستدعاء الوظائف. بفضل نتيجة 66.5% في ComplexFuncBench، فإنه ينفذ الأدوات بشكل غير متزامن، مما يضمن بقاء المحادثات سلسة حتى أثناء العمليات الحسابية الطويلة. على سبيل المثال، بينما يعالج الذكاء الاصطناعي استعلام قاعدة بيانات، فإنه يواصل التفاعل مع المستخدم باستجابات تعبئة أو تحديثات.

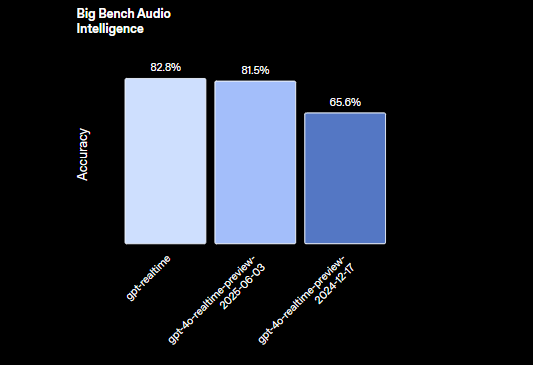

علاوة على ذلك، يدعم gpt-realtime مهام الاستدلال بدقة 82.8% في تقييم Big Bench Audio. يسمح هذا له بالتعامل مع الاستعلامات المعقدة التي تتضمن الاستنتاج المنطقي مباشرة من المدخلات الصوتية، متجاوزًا تحويل النص بالكامل.

تقدم OpenAI صوتين جديدين، مارين وسيدار، حصريين لهذا النموذج، بالإضافة إلى تحديثات لثمانية أصوات موجودة للحصول على مخرجات أكثر تعبيرًا. تضمن هذه التحسينات أن تبدو تفاعلات الذكاء الاصطناعي أكثر شبهاً بالإنسان، مما يسد الفجوة بين الاستجابات المكتوبة والحوار الحقيقي.

بالانتقال إلى الآثار العملية، يستفيد المطورون من gpt-realtime لبناء تطبيقات تستجيب في الوقت الفعلي، مثل خدمات الترجمة الفورية أو أدوات سرد القصص التفاعلية. تقلل كفاءة النموذج من النفقات الحسابية العامة، مما يجعله مناسبًا للنشر على الأجهزة الطرفية أو البنى التحتية السحابية.

الميزات الرئيسية لواجهة برمجة تطبيقات الوقت الفعلي (Realtime API)

تتلقى واجهة برمجة تطبيقات الوقت الفعلي (Realtime API) ترقيات جوهرية، تكمل قدرات gpt-realtime. تزودها OpenAI بميزات تسهل وكلاء الصوت الجاهزين للإنتاج، مع التركيز على الموثوقية وقابلية التوسع وسهولة التكامل.

أولاً، يبرز دعم خادم MCP (مزود السحابة المتعددة) عن بُعد. يقوم المطورون بتكوين خوادم خارجية لاستدعاء الأدوات، مثل التكامل مع Stripe للمدفوعات. يبسط هذا الإعداد سير العمل عن طريق تفريغ وظائف محددة إلى خدمات متخصصة. يمكنك تحديد عنوان URL للخادم ورموز التفويض ومتطلبات الموافقة مباشرة في جلسة API.

بعد ذلك، توسع وظيفة إدخال الصور نطاق API متعدد الوسائط. تضيف التطبيقات صورًا أو لقطات شاشة إلى الجلسات الجارية، مما يتيح محادثات مستندة إلى المرئيات. على سبيل المثال، يقوم المستخدم بتحميل رسم بياني، ويصفه الذكاء الاصطناعي أو يجيب على أسئلة حول محتواه. تتعامل هذه الميزة مع الصور كعناصر ثابتة، يتم التحكم فيها بواسطة منطق التطبيق للحفاظ على السياق.

علاوة على ذلك، يربط دعم SIP (بروتوكول بدء الجلسة) واجهة برمجة التطبيقات بشبكات الهاتف العامة وأنظمة PBX وهواتف المكتب. يسد هذا الفجوة بين الذكاء الاصطناعي الرقمي والاتصالات الهاتفية التقليدية، مما يسمح لوكلاء الصوت بالتعامل مع المكالمات من الخطوط الأرضية أو الهواتف المحمولة بسلاسة.

تمثل المطالبات القابلة لإعادة الاستخدام إضافة رئيسية أخرى. يقوم المطورون بحفظ وإعادة استخدام رسائل المطورين والأدوات والمتغيرات والأمثلة عبر جلسات متعددة. يعزز هذا الاتساق ويقلل من وقت الإعداد للتفاعلات المتكررة، مثل نصوص دعم العملاء القياسية.

تم تحسين واجهة برمجة التطبيقات للتفاعلات ذات زمن الانتقال المنخفض، مما يضمن موثوقية عالية في بيئات الإنتاج. تعالج المدخلات متعددة الوسائط — الصوت والصور — مع الحفاظ على حالة الجلسة، مما يمنع فقدان السياق في المحادثات الممتدة.

فيما يتعلق بمعالجة الصوت، تتفاعل واجهة برمجة تطبيقات الوقت الفعلي (Realtime API) مباشرة مع gpt-realtime لتوليد كلام معبر. تلتقط الفروق الدقيقة التي غالبًا ما تتجاهلها الأنظمة التقليدية، مما يؤدي إلى تجارب مستخدم أكثر جاذبية.

يستفيد المطورون أيضًا من الميزات المخصصة للمؤسسات، بما في ذلك إقامة البيانات في الاتحاد الأوروبي للامتثال والتزامات الخصوصية التي تحمي البيانات الحساسة.

بالانتقال إلى مقاييس الأداء، تعمل هذه التحديثات بشكل جماعي على تعزيز فائدة واجهة برمجة التطبيقات. على سبيل المثال، يمنع استدعاء الوظائف غير المتزامن الاختناقات، مما يسمح للذكاء الاصطناعي بتعدد المهام دون مقاطعة سير العمل.

كيفية استخدام واجهة برمجة تطبيقات GPT-Realtime: دليل خطوة بخطوة

يدمج المطورون واجهة برمجة تطبيقات gpt-realtime من خلال نقاط نهاية وتكوينات مباشرة. ابدأ بالحصول على مفاتيح API من منصة OpenAI، مع التأكد من أن حسابك يدعم واجهة برمجة تطبيقات الوقت الفعلي (Realtime API).

لتهيئة جلسة، أرسل طلب POST لإنشاء سر عميل في الوقت الفعلي. قم بتضمين معلمات الجلسة مثل الأدوات والأنواع. لتكامل MCP عن بعد، قم بهيكلة الحمولة على النحو التالي:

// POST /v1/realtime/client_secrets

{

"session": {

"type": "realtime",

"tools": [

{

"type": "mcp",

"server_label": "stripe",

"server_url": "https://mcp.stripe.com",

"authorization": "{access_token}",

"require_approval": "never"

}

]

}

}

يقوم هذا الكود بإعداد أداة لمدفوعات Stripe، حيث تقوم واجهة برمجة التطبيقات بتوجيه المكالمات إلى الخادم المحدد دون الحاجة إلى موافقة المستخدم في كل مرة.

بمجرد بدء الجلسة، تعامل مع التفاعلات في الوقت الفعلي عبر اتصالات WebSocket. قم بإنشاء WebSocket لنقطة نهاية Realtime API، وإرسال تدفقات الصوت كبيانات ثنائية. تعالج واجهة برمجة التطبيقات المدخلات وتعيد مخرجات الصوت في الوقت الفعلي.

بالنسبة للمدخلات الصوتية، قم بترميز كلام المستخدم وإرساله. يحلل gpt-realtime الصوت، ويولد استجابات بناءً على سياق الجلسة. لدمج الصور، استخدم حدث إنشاء عنصر المحادثة:

{

"type": "conversation.item.create",

"previous_item_id": null,

"item": {

"type": "message",

"role": "user",

"content": [

{

"type": "input_image",

"image_url": "data:image/png;base64,{base64_image_data}"

}

]

}

}

استبدل {base64_image_data} بالصورة المشفرة بتقنية base64 الفعلية. يضيف هذا سياقًا مرئيًا، مما يسمح للذكاء الاصطناعي بالإشارة إليه في الاستجابات.

قم بإدارة حالة الجلسة عن طريق تعيين حدود الرموز المميزة واقتطاع الأدوار القديمة للتحكم في التكاليف. بالنسبة للمحادثات الطويلة، قم بمسح السجل غير الضروري بشكل دوري مع الاحتفاظ بالتفاصيل الرئيسية.

للتعامل مع استدعاءات الوظائف، حدد الأدوات في إعداد الجلسة. عندما يستدعي الذكاء الاصطناعي وظيفة، تنفذها واجهة برمجة التطبيقات بشكل غير متزامن، وترسل تحديثات مؤقتة للحفاظ على استمرار المحادثة.

لتكامل SIP، قم بتكوين تطبيقك لتوجيه المكالمات عبر بوابات متوافقة. يتضمن ذلك إعداد خطوط SIP وربطها بجلسات Realtime API.

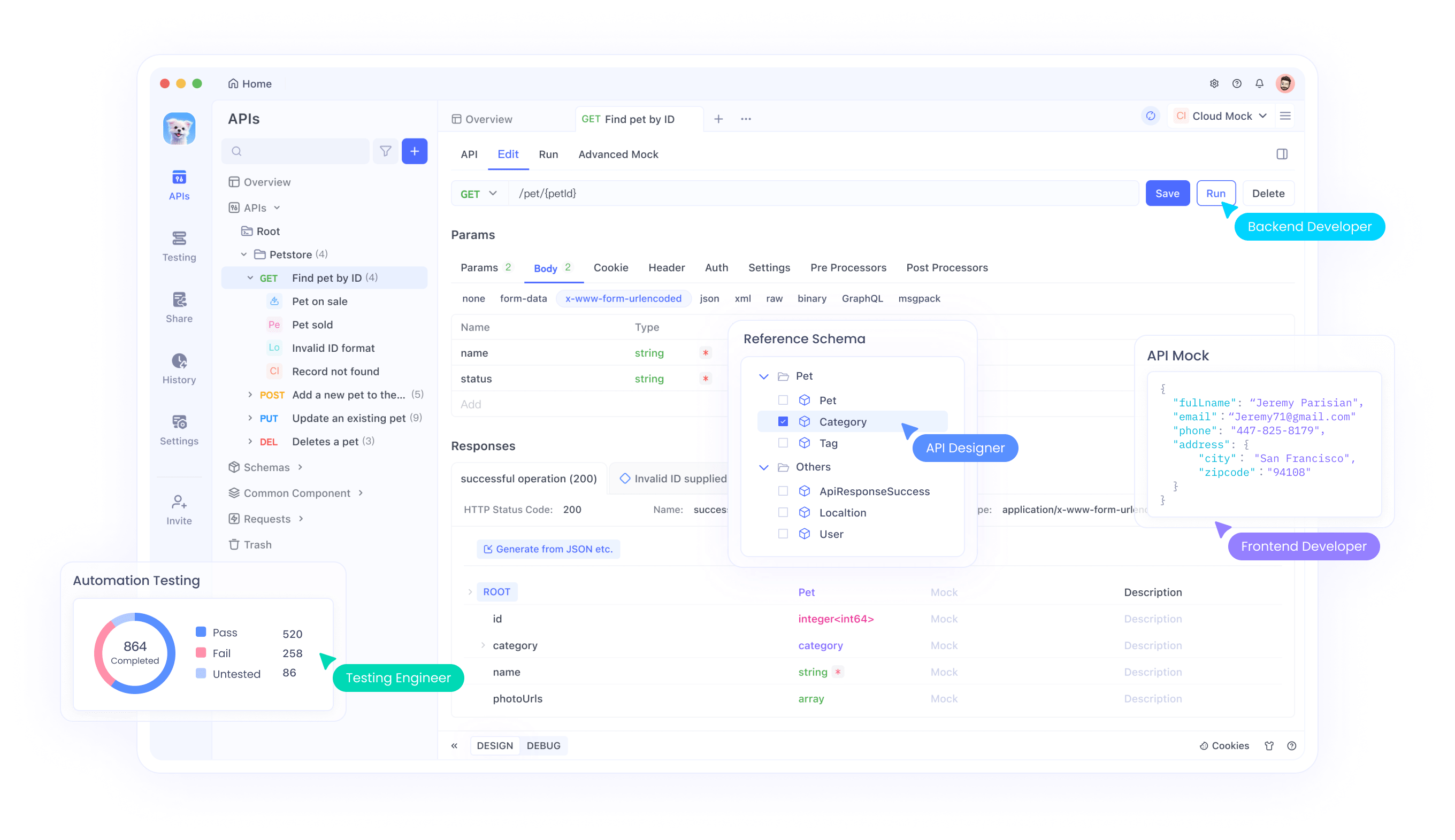

يعد اختبار عمليات التكامل هذه أمرًا بالغ الأهمية. هنا، يبرز Apidog كأداة لإدارة واجهات برمجة التطبيقات. يدعم اختبار WebSocket، مما يتيح لك محاكاة تبادلات الصوت في الوقت الفعلي وفحص الاستجابات. قم بتنزيل Apidog مجانًا لمحاكاة نقاط النهاية، والتحقق من صحة الحمولة، وضمان الاتصال السلس مع gpt-realtime.

من الناحية العملية، قم ببناء وكيل صوتي بسيط من خلال الجمع بين هذه العناصر. التقط مدخلات الميكروفون، وقم ببثها إلى واجهة برمجة التطبيقات، وقم بتشغيل الصوت الذي تم إنشاؤه. تسهل المكتبات مثل WebSocket في JavaScript أو وحدة websockets في Python ذلك.

راقب زمن الانتقال عن طريق توقيت الاستجابات ذهابًا وإيابًا. تضمن تحسينات OpenAI تأخيرات أقل من ثانية في معظم الحالات، ولكن ظروف الشبكة تؤثر على الأداء.

تعامل مع الأخطاء بسلاسة، مثل إعادة محاولة الاتصالات الفاشلة أو الرجوع إلى التفاعلات النصية إذا واجهت معالجة الصوت مشكلات.

لتوسيع هذا، قم بدمج المطالبات القابلة لإعادة الاستخدام. قم بتخزين قالب مطالبة مع تعليمات مثل "استجب دائمًا بتعاطف" وقم بتطبيقه على جلسات جديدة عبر معلمات API.

للاستخدام المتقدم، اجمع gpt-realtime مع نماذج OpenAI الأخرى. وجه الاستدلال المعقد إلى GPT-4o بينما تستخدم gpt-realtime لإدخال/إخراج الصوت، مما ينشئ أنظمة هجينة.

تشمل اعتبارات الأمان تشفير البيانات أثناء النقل وإدارة رموز الوصول بشكل آمن. تساعد التزامات OpenAI بالخصوصية، ولكن قم بتطبيق ضمانات إضافية للتطبيقات الحساسة.

دمج Apidog لإدارة فعالة لواجهة برمجة التطبيقات

يبرز Apidog كأداة حيوية للمطورين الذين يعملون مع واجهة برمجة تطبيقات gpt-realtime. توفر هذه المنصة ميزات شاملة لاختبار واجهة برمجة التطبيقات وتوثيقها والتعاون، وهي مصممة خصيصًا لعمليات التكامل المعقدة مثل WebSockets في الوقت الفعلي.

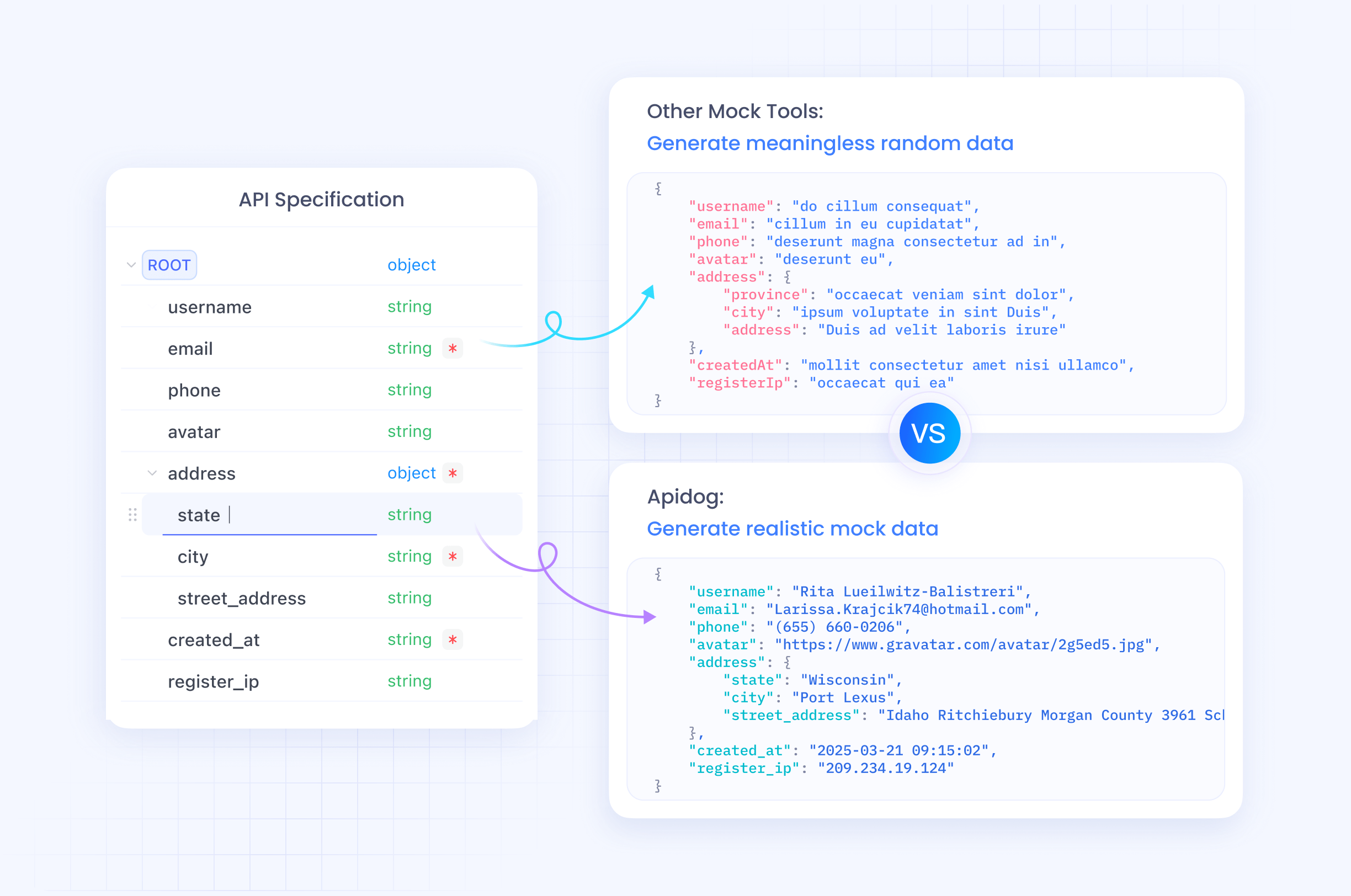

يستخدم المهندسون Apidog لتصميم طلبات API بصريًا، واستيراد مواصفات OpenAPI، وتشغيل الاختبارات الآلية. بالنسبة لواجهة برمجة تطبيقات الوقت الفعلي (Realtime API)، قم بمحاكاة تدفقات الصوت والتحقق من صحة المدخلات متعددة الوسائط دون كتابة تعليمات برمجية مكثفة.

علاوة على ذلك، تسمح إمكانيات المحاكاة في Apidog بالنماذج الأولية قبل التنفيذ الكامل. قم بإنشاء خوادم وهمية تحاكي استجابات gpt-realtime، مما يسرع دورات التطوير.

تدعم الأداة التعاون الجماعي، ومشاركة حالات الاختبار والبيئات. يثبت هذا أنه لا يقدر بثمن للفرق الموزعة التي تبني وكلاء صوتيين.

نظرًا لأن Apidog يتعامل مع ترميز base64 للصور والبيانات الثنائية للصوت، فإنه يبسط تصحيح الأخطاء. تتبع دورات الطلب/الاستجابة في الوقت الفعلي، وتحديد الاختناقات مبكرًا.

بالانتقال إلى النشر، استخدم مراقبة Apidog لضمان وقت تشغيل واجهة برمجة التطبيقات وأدائها بعد الإطلاق.

التسعير، التوفر، والآثار المستقبلية

تُسعّر OpenAI نموذج gpt-realtime بشكل تنافسي، مما يقلل التكاليف بنسبة 20% عن الإصدار التجريبي. يتم فرض 32 دولارًا لكل مليون رمز إدخال صوتي (0.40 دولارًا للرموز المخزنة مؤقتًا) و 64 دولارًا لكل مليون رمز إخراج. يشجع هذا الهيكل الاستخدام الفعال، مع عناصر تحكم لتقييد السياق واقتطاع الجلسات.

تصبح واجهة برمجة التطبيقات متاحة لجميع المطورين في 28 أغسطس 2025، مع وصول عالمي يشمل مناطق الاتحاد الأوروبي.

بالنظر إلى المستقبل، تمهد هذه التطورات الطريق لذكاء اصطناعي صوتي منتشر في كل مكان. تتبناها صناعات مثل الرعاية الصحية لتفاعلات المرضى، بينما تستخدمها التعليم للتدريس التفاعلي.

ومع ذلك، لا تزال هناك تحديات، مثل ضمان الاستخدام الأخلاقي وتخفيف التحيزات في معالجة الصوت.

باختصار، يعيد gpt-realtime و Realtime API من OpenAI تعريف الذكاء الاصطناعي في الوقت الفعلي، حيث يوفران أدوات يستغلها المطورون لتطبيقات مبتكرة. تؤدي التعديلات الصغيرة في التكامل إلى مكاسب كبيرة، مع التأكيد على التنفيذ الدقيق.