يسعى المطورون باستمرار إلى نماذج لغوية قوية تقدم أداءً موثوقًا عبر تطبيقات متنوعة. تقدم Zhipu AI نموذج GLM-4.6، وهو إصدار متقدم في سلسلة GLM يدفع حدود قدرات الذكاء الاصطناعي. يعتمد هذا النموذج على الإصدارات السابقة من خلال دمج تحسينات كبيرة في معالجة السياق والاستدلال والفائدة العملية. يدمج المهندسون GLM-4.6 في سير عملهم لمعالجة المهام المعقدة، من توليد التعليمات البرمجية إلى إنشاء المحتوى، بكفاءة ودقة أكبر.

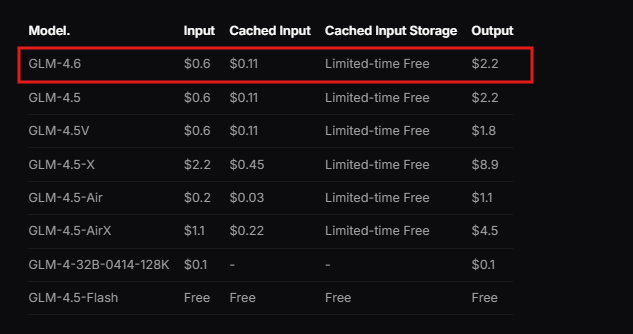

صممت Zhipu AI نموذج GLM-4.6 كجزء من خطة GLM Coding Plan، وهي خدمة قائمة على الاشتراك تبدأ بسعر معقول. يمكن للمستخدمين الوصول إلى هذا النموذج من خلال أدوات متكاملة مثل Claude Code و Cline و OpenCode وغيرها، مما يتيح تطويرًا سلسًا بمساعدة الذكاء الاصطناعي. يتفوق النموذج في سيناريوهات العالم الحقيقي، حيث يعالج سياقات واسعة وينتج مخرجات عالية الجودة. علاوة على ذلك، يظهر GLM-4.6 أداءً فائقًا في الاختبارات المعيارية، منافسًا القادة العالميين مثل Claude Sonnet 4. وهذا يجعله الخيار الأفضل للمطورين في الصين وخارجها الذين يحتاجون إلى دعم موثوق للذكاء الاصطناعي.

انتقالاً من فهم أساس النموذج، دعنا نفحص ميزاته الأساسية وكيف تفيد التطبيقات التقنية.

ما هو GLM-4.6؟

تطور Zhipu AI نموذج GLM-4.6 كنموذج لغوي كبير محسّن لمجموعة واسعة من المهام التقنية والإبداعية. يتميز النموذج ببنية Mixture of Experts (MoE) بمعاملات 355 مليار، مما يتيح الحساب الفعال مع الحفاظ على الأداء العالي. يقدر المستخدمون نافذة السياق الموسعة التي تبلغ 200 ألف رمز، وهي ترقية ملحوظة من حد 128 ألف في الإصدارات السابقة. يتيح هذا التوسع للنموذج إدارة التفاعلات المعقدة والطويلة دون فقدان الترابط.

بالإضافة إلى ذلك، يدعم GLM-4.6 أنماط إدخال وإخراج النص، مما يجعله متعدد الاستخدامات للتطبيقات التي تتطلب معالجة لغوية دقيقة. يصل الحد الأقصى لرمز الإخراج إلى 128 ألف رمز، مما يوفر مساحة كافية للاستجابات التفصيلية. يستفيد المطورون من هذه المواصفات لبناء أنظمة تتعامل مع البيانات الكبيرة، مثل تحليل المستندات أو سلاسل الاستدلال متعددة الخطوات.

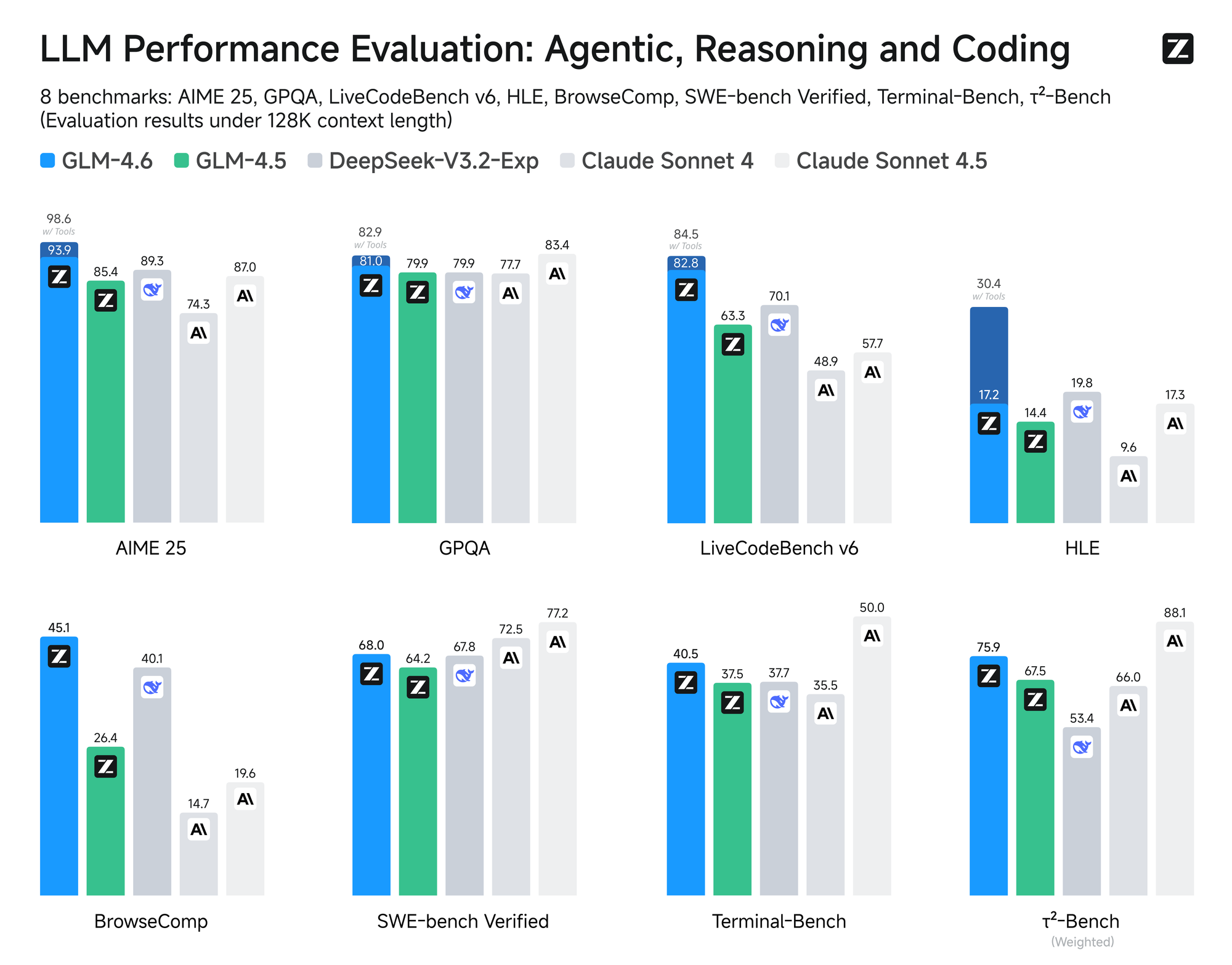

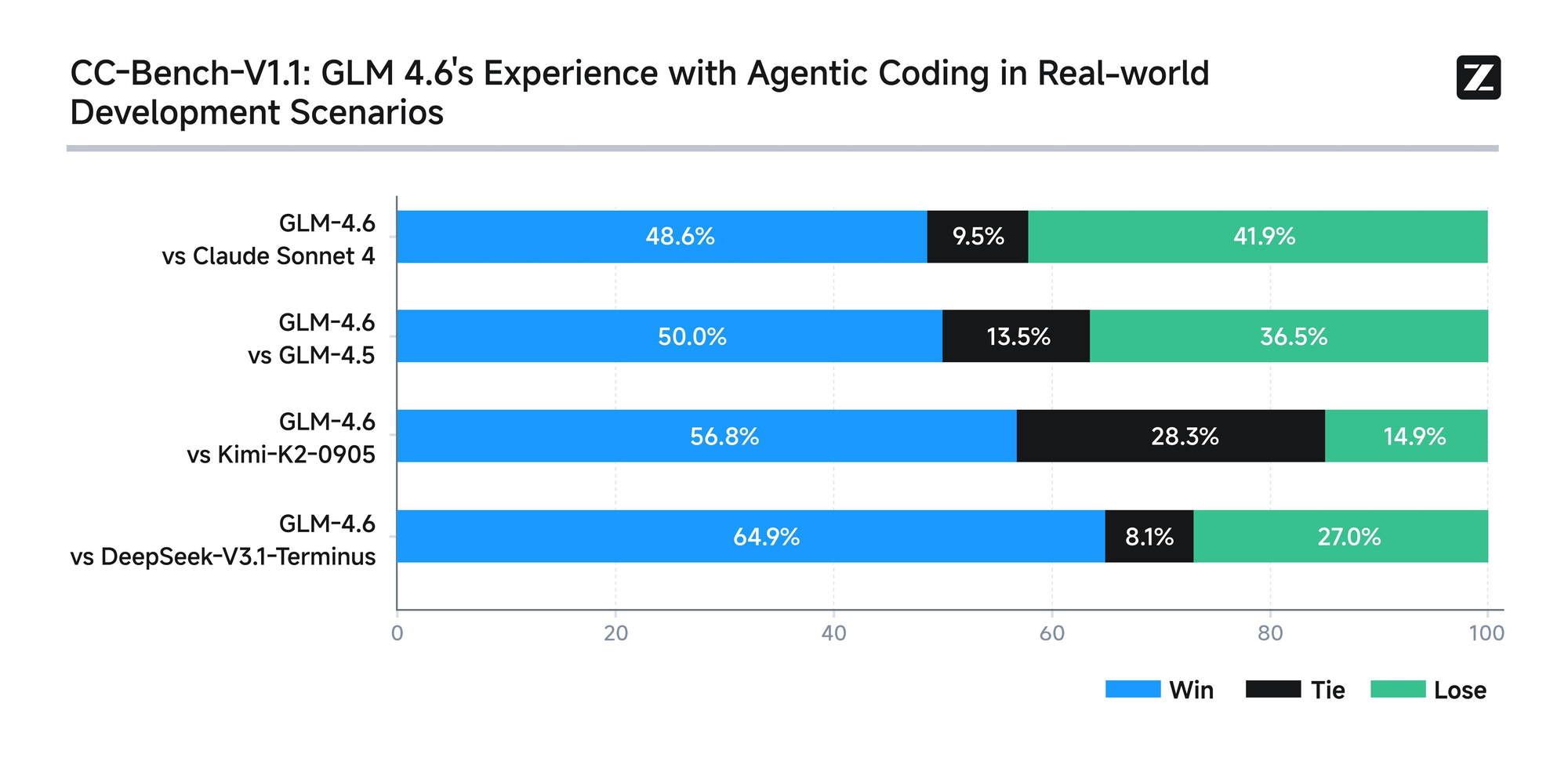

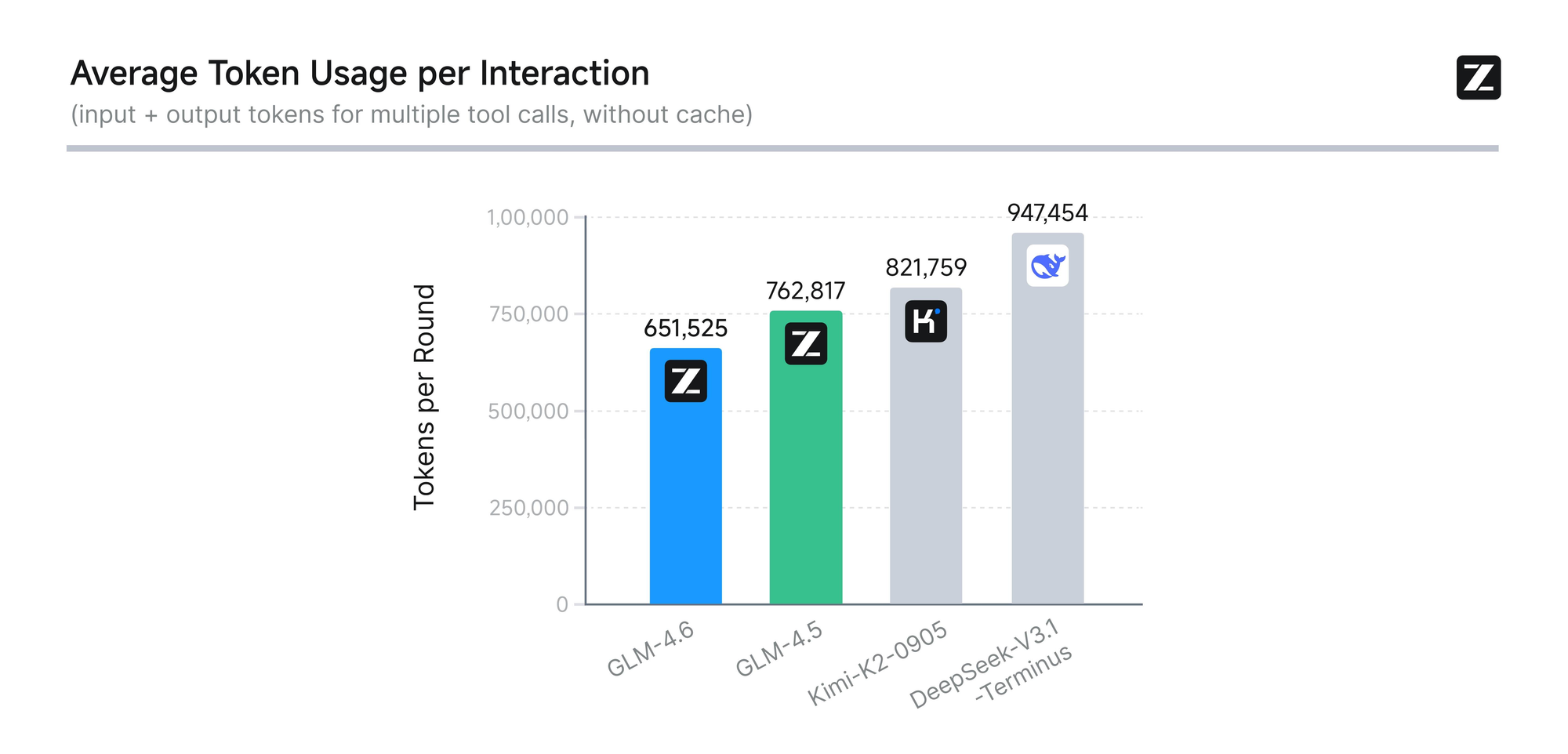

يخضع النموذج لتقييم صارم عبر ثمانية معايير موثوقة، بما في ذلك AIME 25، GPQA، LCB v6، HLE، و SWE-Bench Verified. تظهر النتائج أن GLM-4.6 يؤدي أداءً يضاهي النماذج الرائدة مثل Claude Sonnet 4 و 4.6. على سبيل المثال، في اختبارات الترميز الواقعية التي أجريت في بيئة Claude Code، يتفوق GLM-4.6 على المنافسين في 74 سيناريو عملي. ويحقق ذلك بكفاءة تزيد عن 30% في استهلاك الرموز، مما يقلل التكاليف التشغيلية للمستخدمين ذوي الحجم الكبير.

علاوة على ذلك، تلتزم Zhipu AI بالشفافية من خلال نشر جميع أسئلة الاختبار ومسارات الوكيل علنًا. تتيح هذه الممارسة للمطورين التحقق من الادعاءات وإعادة إنتاج النتائج، مما يعزز الثقة في التكنولوجيا. يدمج GLM-4.6 أيضًا قدرات استدلال متقدمة، ويدعم استخدام الأدوات أثناء الاستنتاج. تعزز هذه الميزة فائدته في الأطر الوكيلة، حيث يخطط النموذج وينفذ المهام بشكل مستقل.

بالإضافة إلى الترميز، يتألق GLM-4.6 في مجالات أخرى. فهو يحسن الكتابة لتتوافق بشكل وثيق مع التفضيلات البشرية، ويحسن الأسلوب وسهولة القراءة وأصالة لعب الأدوار. في مهام الترجمة، يحسن النموذج للغات الأقل شيوعًا مثل الفرنسية والروسية واليابانية والكورية، مما يضمن الاتساق الدلالي في السياقات غير الرسمية. يستخدمه منشئو المحتوى للروايات والسيناريوهات وكتابة الإعلانات، مستفيدين من التوسع السياقي والفروق الدقيقة العاطفية.

يمثل تطوير الشخصيات الافتراضية نقطة قوة أخرى، حيث يحافظ GLM-4.6 على نبرة متسقة عبر المحادثات متعددة الأدوار. وهذا يجعله مثاليًا للذكاء الاصطناعي الاجتماعي وتجسيد العلامة التجارية. في البحث الذكي والبحث العميق، يعزز النموذج فهم النية وتوليف النتائج، مما يوفر مخرجات ثاقبة.

بشكل عام، يمكّن GLM-4.6 المطورين من إنشاء تطبيقات أكثر ذكاءً. إن مزيجه من معالجة السياق الطويل، والاستخدام الفعال للرموز، والتطبيق الواسع يميزه في مشهد الذكاء الاصطناعي. الآن بعد أن فهمنا جوهر النموذج، ننتقل إلى الوصول إلى واجهة برمجة تطبيقاته للتنفيذ العملي.

كيفية الوصول إلى واجهة برمجة تطبيقات GLM-4.6

توفر Zhipu AI وصولاً مباشرًا إلى واجهة برمجة تطبيقات GLM-4.6 من خلال منصتها المفتوحة. يبدأ المطورون بالتسجيل للحصول على حساب على موقع Zhipu AI، وتحديداً على open.bigmodel.cn أو z.ai. تتطلب العملية التحقق من البريد الإلكتروني أو رقم الهاتف لضمان التسجيل الآمن.

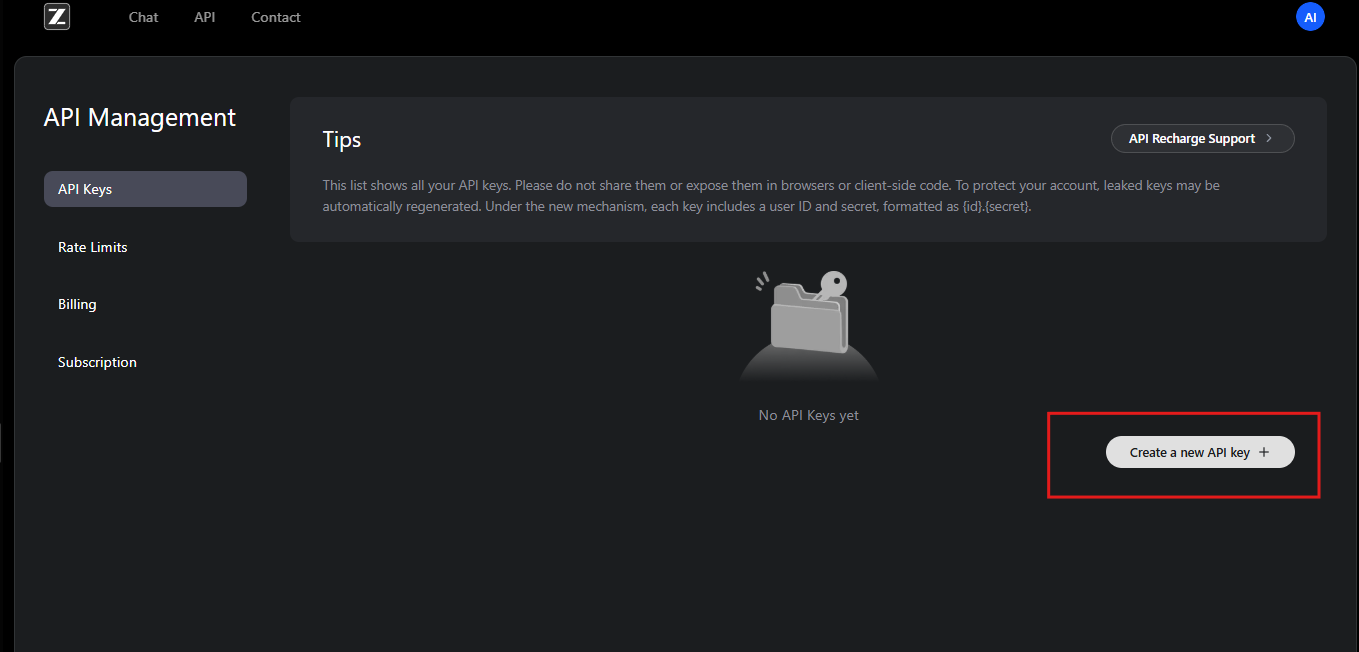

بمجرد التسجيل، يشترك المستخدمون في خطة GLM Coding Plan. تفتح هذه الخطة GLM-4.6 والنماذج ذات الصلة. يحصل المشتركون على الوصول إلى لوحة تحكم واجهة برمجة التطبيقات، حيث يقومون بإنشاء مفاتيح API. تعمل هذه المفاتيح كبيانات اعتماد للمصادقة على الطلبات.

بالإضافة إلى ذلك، تقدم Zhipu AI وثائق تفصل خطوات التكامل. يراجع المطورون هذا المورد لفهم المتطلبات الأساسية، مثل بيئات البرمجة المتوافقة. تتبع واجهة برمجة التطبيقات تصميم RESTful، متوافقًا مع عملاء HTTP القياسيين.

للبدء، يتنقل المستخدمون إلى قسم إدارة واجهة برمجة التطبيقات في حسابهم. هنا، يقومون بإنشاء مفتاح API جديد وتدوين قيمته بأمان. توصي Zhipu AI بتدوير المفاتيح بشكل دوري للأمان. علاوة على ذلك، توفر المنصة حصص استخدام بناءً على مستويات الاشتراك، مما يمنع الاستخدام المفرط.

إذا واجه المطورون مشكلات، يساعد فريق دعم Zhipu AI عبر البريد الإلكتروني أو المنتديات. كما يقدمون موارد مجتمعية لاستكشاف مشكلات الوصول الشائعة وإصلاحها. مع تأمين الوصول، تتضمن الخطوة التالية إعداد المصادقة للتفاعل بفعالية مع واجهة برمجة تطبيقات GLM-4.6.

المصادقة والإعداد لواجهة برمجة تطبيقات GLM-4.6

تشكل المصادقة العمود الفقري للتفاعلات الآمنة لواجهة برمجة التطبيقات. تستخدم Zhipu AI مصادقة رمز Bearer لواجهة برمجة تطبيقات GLM-4.6. يضمّن المطورون مفتاح API في رأس Authorization لكل طلب.

للإعداد، قم بتثبيت المكتبات الضرورية في بيئة التطوير الخاصة بك. يستخدم مستخدمو Python، على سبيل المثال، مكتبة requests. يمكنك استيرادها وتكوين الرؤوس على النحو التالي:

import requests

api_key = "your-api-key"

headers = {

"Authorization": f"Bearer {api_key}",

"Content-Type": "application/json"

}

يقوم هذا الرمز بإعداد البيئة لإرسال الطلبات. وبالمثل، في JavaScript مع Node.js، يستخدم المطورون واجهة برمجة تطبيقات fetch أو مكتبة axios. يقومون بتعيين الرؤوس في كائن الخيارات.

علاوة على ذلك، تأكد من أن نظامك يلبي متطلبات الشبكة. يقع نقطة نهاية واجهة برمجة تطبيقات GLM-4.6 على https://api.z.ai/api/paas/v4/chat/completions. اختبر الاتصال عن طريق اختبار النطاق أو إرسال طلب بسيط.

أثناء الإعداد، يقوم المطورون بتكوين متغيرات البيئة لتخزين مفتاح API بأمان. تمنع هذه الممارسة ترميز المعلومات الحساسة في البرامج النصية. تسهل أدوات مثل dotenv في Python أو process.env في Node.js ذلك.

إذا كنت تستخدم وكيلًا أو شبكة افتراضية خاصة (VPN)، فتحقق من أنها تسمح بالوصول إلى خوادم Zhipu AI. غالبًا ما تنبع أخطاء المصادقة من تنسيق مفتاح غير صحيح أو اشتراكات منتهية الصلاحية. تسجل Zhipu AI الأخطاء في الاستجابات، مما يساعد في تشخيص المشكلات.

بمجرد المصادقة، ينتقل المطورون إلى استكشاف نقاط النهاية. يضمن هذا الإعداد وصولاً موثوقًا وآمنًا إلى قدرات GLM-4.6.

استكشاف نقاط نهاية واجهة برمجة تطبيقات GLM-4.6

تتركز واجهة برمجة تطبيقات GLM-4.6 على نقطة نهاية أساسية لإكمال الدردشة. يرسل المطورون طلبات POST إلى https://api.z.ai/api/paas/v4/chat/completions لتوليد الاستجابات.

تتعامل نقطة النهاية هذه مع الوضعين الأساسي والتدفقي. في الوضع الأساسي، يعالج الخادم الطلب بأكمله ويعيد استجابة كاملة. ومع ذلك، يقدم وضع التدفق الإخراج بشكل تدريجي، وهو مثالي للتطبيقات في الوقت الفعلي.

لاستدعاء نقطة النهاية، قم بإنشاء حمولة JSON بمعلمات مطلوبة. يحدد حقل النموذج "glm-4.6". تحتوي مصفوفة الرسائل على أزواج الدور والمحتوى، محاكية للمحادثات.

على سبيل المثال، يبدو طلب curl الأساسي كالتالي:

curl -X POST "https://api.z.ai/api/paas/v4/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer your-api-key" \

-d '{

"model": "glm-4.6",

"messages": [

{"role": "user", "content": "Generate a Python function for sorting a list."}

]

}'

يستجيب الخادم بـ JSON يحتوي على المحتوى الذي تم إنشاؤه. يقوم المطورون بتحليل هذا لاستخراج رسائل المساعد.

بالإضافة إلى ذلك، تدعم نقطة النهاية ميزات متقدمة مثل خطوات التفكير. قم بتعيين كائن التفكير لتمكين الاستدلال التفصيلي في المخرجات.

يسمح فهم نقطة النهاية هذه للمطورين ببناء أنظمة ذكاء اصطناعي تفاعلية. بعد ذلك، سنقوم بتحليل معلمات الطلب بالتفصيل.

شرح مفصل لمعلمات طلب واجهة برمجة تطبيقات GLM-4.6

تتحكم معلمات الطلب في سلوك واجهة برمجة تطبيقات GLM-4.6. تتطلب معلمة النموذج "glm-4.6" لتحديد هذا الإصدار المحدد.

تدفع مصفوفة الرسائل المحادثة. يتضمن كل كائن دورًا - "user" للمدخلات، و "assistant" للاستجابات السابقة - ومحتوى كنصوص نصية. يقوم المطورون ببناء حوارات متعددة الأدوار عن طريق تبديل الأدوار.

علاوة على ذلك، يحد `max_tokens` من طول الاستجابة، مما يمنع الإخراج المفرط. اضبطه على 4096 للحصول على نتائج متوازنة. يقوم `temperature` بضبط العشوائية؛ القيم الأقل مثل 0.6 تنتج مخرجات حتمية، بينما تشجع القيم الأعلى الإبداع.

للتدفق، قم بتضمين "stream": true. يؤدي هذا إلى تغيير تنسيق الاستجابة إلى بيانات مجزأة.

تُمكّن معلمة `thinking` الاستدلال خطوة بخطوة. اضبط "thinking": {"type": "enabled"} لتضمين الأفكار الوسيطة في الاستجابات.

تتضمن المعلمات الاختيارية الأخرى `top_p` لأخذ العينات النووية و `presence_penalty` لتثبيط التكرار. يقوم المطورون بضبط هذه بناءً على حالات الاستخدام.

تؤدي المعلمات غير الصالحة إلى استجابات خطأ برموز مثل 400 للطلبات السيئة. تحقق دائمًا من الحمولات قبل الإرسال.

من خلال إتقان هذه المعلمات، يقوم المطورون بتخصيص استدعاءات واجهة برمجة تطبيقات GLM-4.6 للحصول على الأداء الأمثل.

التعامل مع الاستجابات من واجهة برمجة تطبيقات GLM-4.6

تصل الاستجابات من واجهة برمجة تطبيقات GLM-4.6 بتنسيق JSON. يقوم المطورون بتحليل مصفوفة الخيارات للوصول إلى المحتوى الذي تم إنشاؤه.

في الوضع الأساسي، تتضمن الاستجابة:

{

"id": "chatcmpl-...",

"object": "chat.completion",

"created": 1694123456,

"model": "glm-4.6",

"choices": [

{

"index": 0,

"message": {

"role": "assistant",

"content": "Your generated text here."

},

"finish_reason": "stop"

}

]

}

استخرج حقل المحتوى للاستخدام في التطبيقات.

في وضع التدفق، يتم تدفق الاستجابات كأحداث مرسلة من الخادم (SSE). يتبع كل جزء:

data: {"id":"chatcmpl-...","choices":[{"delta":{"content":" partial text"}}]}

يقوم المطورون بتجميع الفروقات لبناء الإخراج الكامل.

يتضمن التعامل مع الأخطاء التحقق من رموز الحالة. يشير 401 إلى فشل المصادقة، بينما يشير 429 إلى حدود المعدل.

سجل الاستجابات لتصحيح الأخطاء. يضمن هذا النهج التكامل القوي مع واجهة برمجة تطبيقات GLM-4.6.

أمثلة على التعليمات البرمجية لدمج واجهة برمجة تطبيقات GLM-4.6

يقوم المطورون بتطبيق واجهة برمجة تطبيقات GLM-4.6 بلغات مختلفة. في بايثون، استخدم requests لإجراء استدعاء أساسي:

import requests

import json

url = "https://api.z.ai/api/paas/v4/chat/completions"

payload = {

"model": "glm-4.6",

"messages": [{"role": "user", "content": "Explain quantum computing."}],

"max_tokens": 500,

"temperature": 0.7

}

headers = {

"Authorization": "Bearer your-api-key",

"Content-Type": "application/json"

}

response = requests.post(url, data=json.dumps(payload), headers=headers)

print(response.json()["choices"][0]["message"]["content"])

يرسل هذا الرمز استعلامًا ويطبع الاستجابة.

في JavaScript مع Node.js:

const fetch = require('node-fetch');

const url = 'https://api.z.ai/api/paas/v4/chat/completions';

const payload = {

model: 'glm-4.6',

messages: [{ role: 'user', content: 'Write a haiku about AI.' }],

max_tokens: 100

};

const headers = {

'Authorization': 'Bearer your-api-key',

'Content-Type': 'application/json'

};

fetch(url, {

method: 'POST',

body: JSON.stringify(payload),

headers

})

.then(res => res.json())

.then(data => console.log(data.choices[0].message.content));

للتدفق في بايثون، استخدم مكتبات تحليل SSE مثل sseclient.

توضح هذه الأمثلة التكامل العملي، مما يسمح للمطورين بالنمذجة الأولية بسرعة.

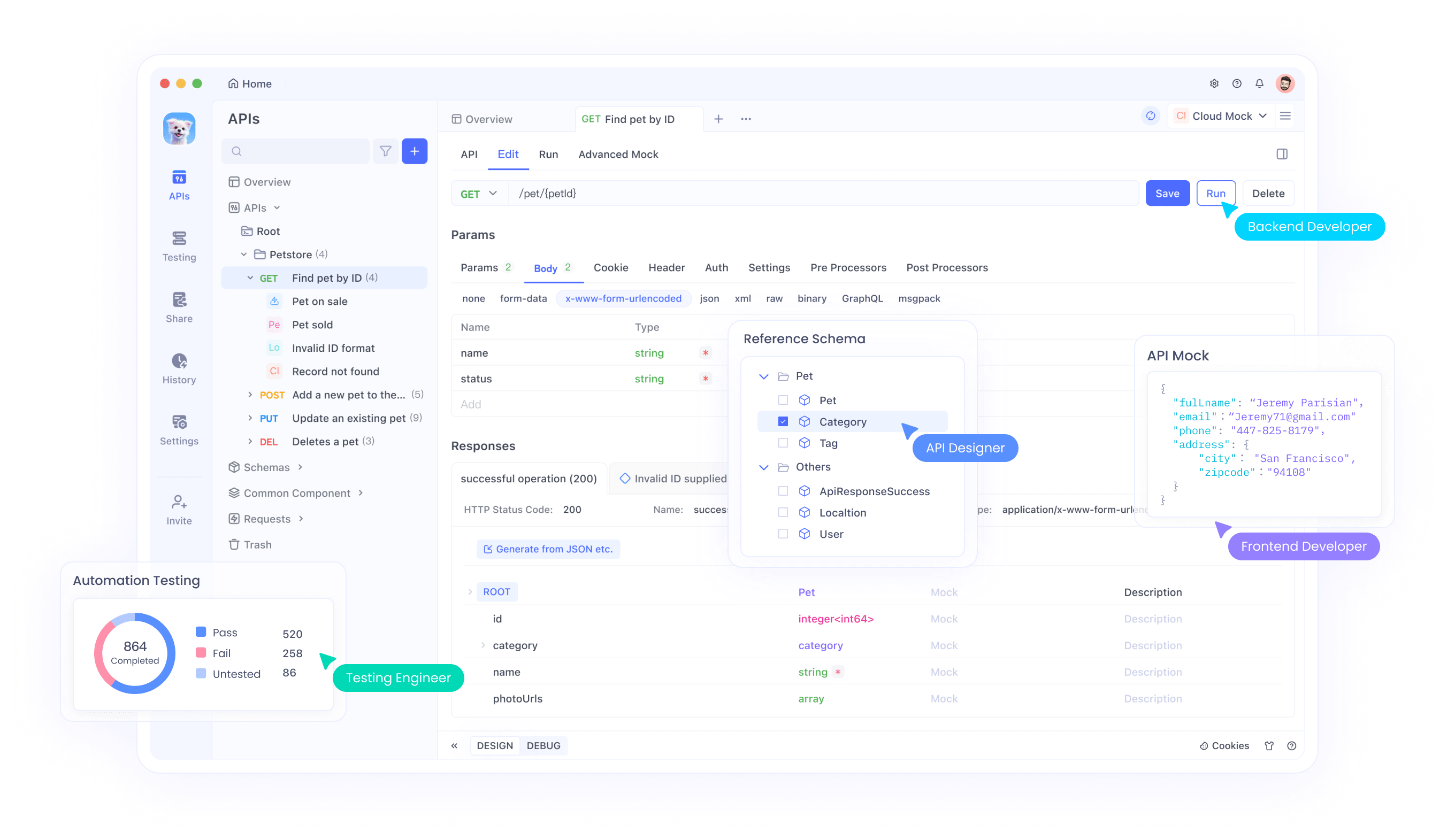

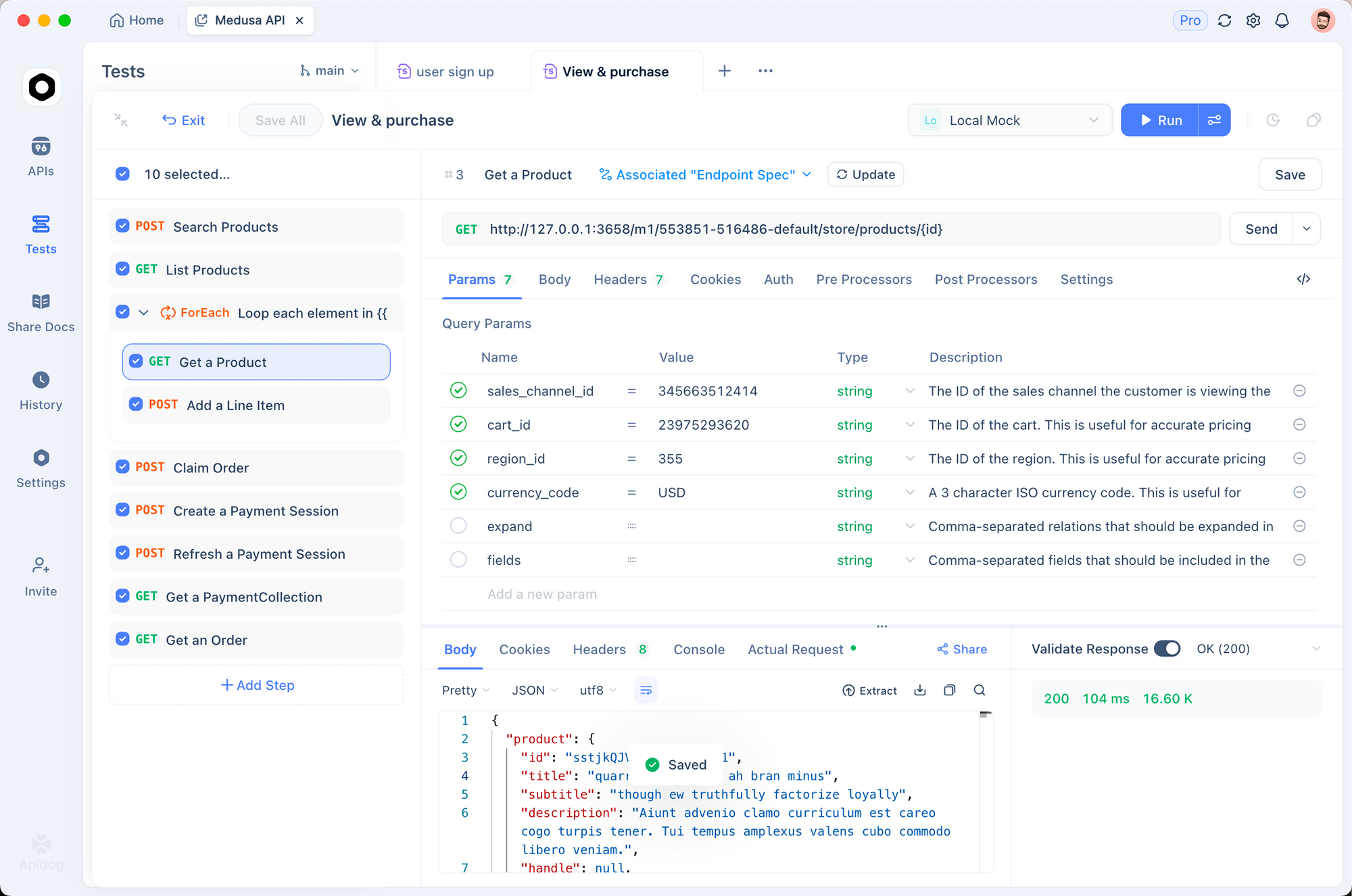

استخدام Apidog لاختبار واجهة برمجة تطبيقات GLM-4.6

يعمل Apidog كأداة ممتازة لاختبار واجهة برمجة تطبيقات GLM-4.6. تتيح هذه المنصة الشاملة للمطورين تصميم وتصحيح واختبار وأتمتة تفاعلات واجهة برمجة التطبيقات.

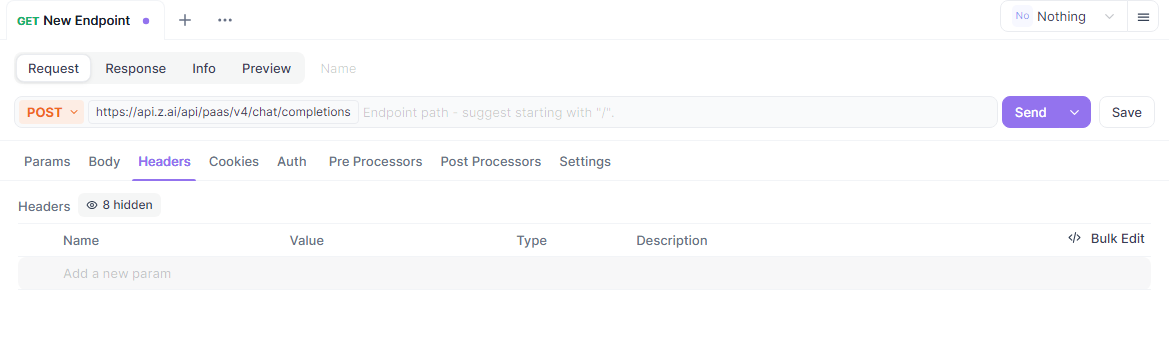

ابدأ بتنزيل Apidog من apidog.com وإنشاء مشروع. استورد نقطة نهاية واجهة برمجة تطبيقات GLM-4.6 عن طريق إضافة واجهة برمجة تطبيقات جديدة باستخدام الرابط https://api.z.ai/api/paas/v4/chat/completions.

قم بتعيين المصادقة في قسم الرؤوس في Apidog، بإضافة "Authorization: Bearer your-api-key". قم بتكوين نص الطلب بمعلمات JSON مثل النموذج والرسائل.

يسمح Apidog بإرسال الطلبات وعرض الاستجابات في واجهة سهلة الاستخدام. يختبر المطورون التباينات عن طريق تكرار الطلبات وتعديل المعلمات.

علاوة على ذلك، قم بأتمتة الاختبارات عن طريق إنشاء سيناريوهات في Apidog. حدد التأكيدات للتحقق من صحة محتوى الاستجابة، مما يضمن أن واجهة برمجة تطبيقات GLM-4.6 تعمل كما هو متوقع.

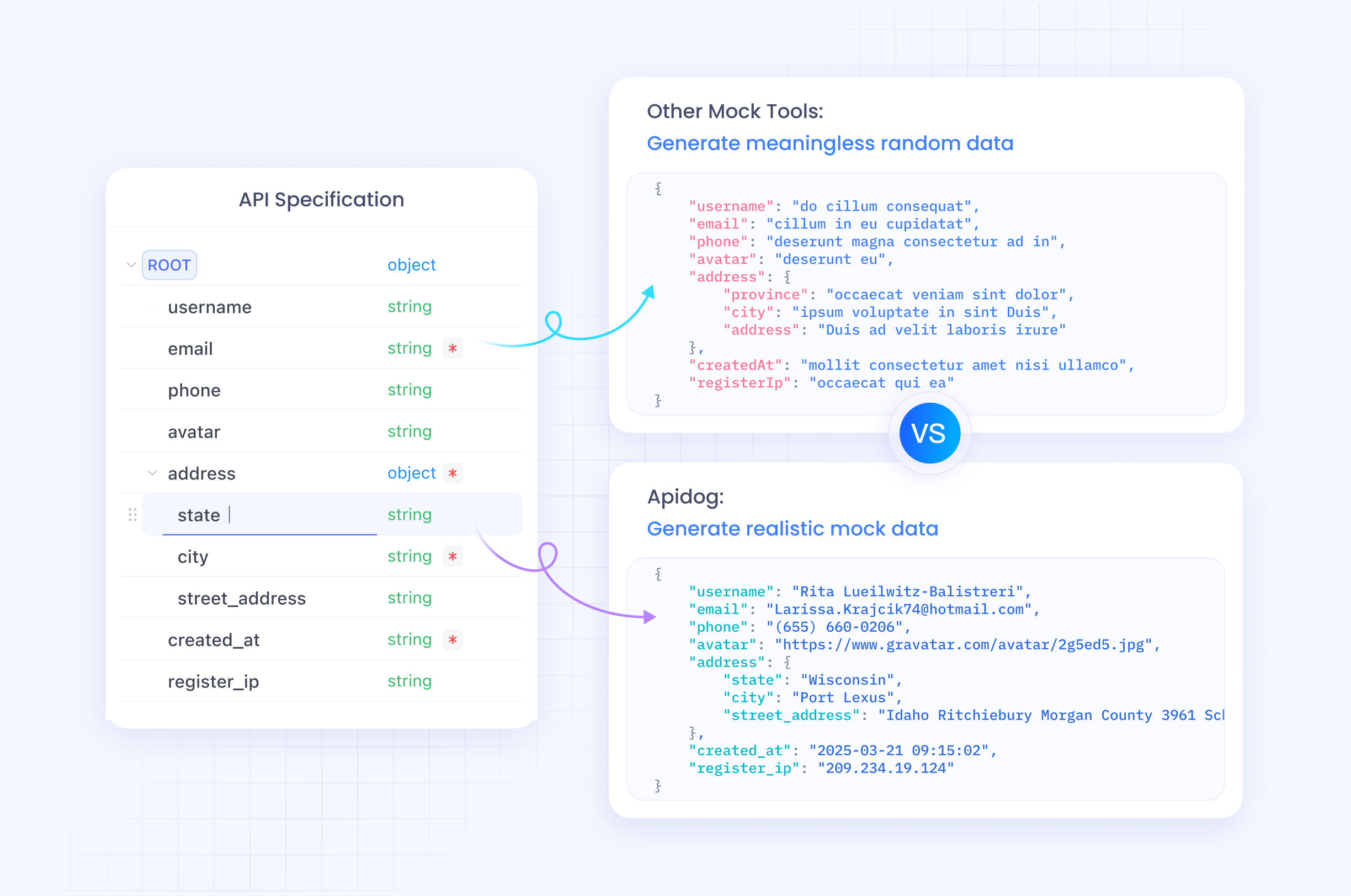

تحاكي الخوادم الوهمية في Apidog الاستجابات للتطوير دون اتصال بالإنترنت. تسرع هذه الميزة من النمذجة الأولية دون استدعاءات واجهة برمجة تطبيقات حية.

من خلال دمج Apidog، يقوم المطورون بتبسيط سير عمل واجهة برمجة تطبيقات GLM-4.6، مما يقلل الأخطاء ويسرع النشر.

أفضل الممارسات وحدود المعدل لواجهة برمجة تطبيقات GLM-4.6

يؤدي الالتزام بأفضل الممارسات إلى تحقيق أقصى استفادة من إمكانات واجهة برمجة تطبيقات GLM-4.6. يراقب المطورون الاستخدام للبقاء ضمن حدود المعدل، والتي يتم تحديدها عادةً بالرموز في الدقيقة أو الطلبات في اليوم بناءً على الاشتراك.

طبق التراجع الأسي لإعادة المحاولات عند حدوث أخطاء مثل 429. وهذا يمنع إغراق الخادم.

حسّن المطالبات من أجل الوضوح لتحسين جودة الاستجابة. استخدم رسائل النظام لتعيين السياق، وتوجيه النموذج بفعالية.

قم بتأمين مفاتيح API في بيئات الإنتاج. تجنب كشفها في التعليمات البرمجية من جانب العميل.

سجل التفاعلات للتدقيق وتحليل الأداء. توفر هذه البيانات معلومات للتحسينات.

تعامل مع الحالات الهامشية، مثل الاستجابات الفارغة أو المهلات، باستخدام آليات احتياطية.

تحدّث Zhipu AI حدود المعدل في الوثائق؛ تحقق بانتظام.

يضمن اتباع هذه الممارسات استخدامًا فعالاً وموثوقًا لواجهة برمجة تطبيقات GLM-4.6.

الاستخدام المتقدم لواجهة برمجة تطبيقات GLM-4.6

يستكشف المستخدمون المتقدمون التدفق للتطبيقات التفاعلية. قم بتعيين "stream": true ومعالجة الأجزاء في الوقت الفعلي.

ادمج الأدوات عن طريق تضمين استدعاءات الوظائف في الرسائل. يدعم GLM-4.6 استدعاء الأدوات، مما يتيح للوكلاء تنفيذ إجراءات خارجية.

على سبيل المثال، حدد الأدوات في الحمولة:

"tools": [

{

"type": "function",

"function": {

"name": "get_weather",

"description": "Get current weather",

"parameters": {...}

}

}

]

يستجيب النموذج باستدعاءات الأدوات إذا لزم الأمر.

اضبط درجة الحرارة لمهام محددة؛ منخفضة للاستعلامات الواقعية، وعالية للمهام الإبداعية.

اجمع مع السياقات الطويلة لتلخيص المستندات. قم بتغذية نصوص كبيرة في الرسائل.

ادمج في أطر عمل الوكلاء مثل LangChain لسير العمل المعقدة.

تطلق هذه التقنيات العنان للإمكانات الكاملة لـ GLM-4.6 في الأنظمة المتطورة.

الخلاصة

توفر واجهة برمجة تطبيقات GLM-4.6 للمطورين أداة قوية لابتكار الذكاء الاصطناعي. باتباع هذا الدليل، يمكنك دمجها بسلاسة في المشاريع. جرب الميزات، واختبر باستخدام Apidog، وطبق أفضل الممارسات لتحقيق النجاح. تواصل Zhipu AI تطوير GLM-4.6، واعدة بقدرات أكبر في المستقبل.