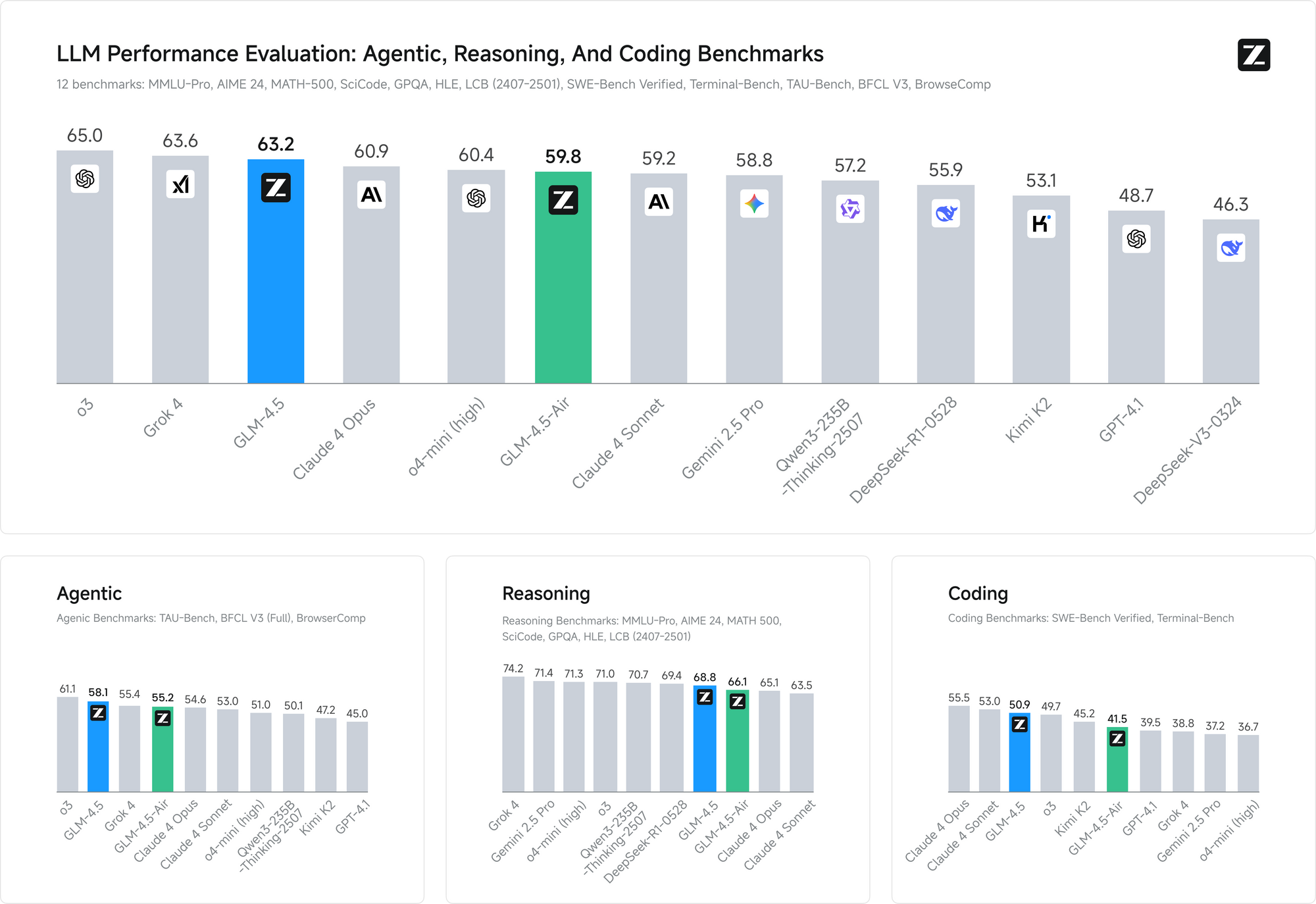

شهد مشهد الذكاء الاصطناعي مفتوح المصدر للتو تحولًا زلزاليًا آخر. فقد أصدرت شركة Z.ai، شركة الذكاء الاصطناعي الصينية المعروفة سابقًا باسم Zhipu، نموذجيها GLM-4.5 و GLM-4.5 Air، واعدةً بتجاوز DeepSeek مع وضع معايير جديدة لأداء الذكاء الاصطناعي وإمكانية الوصول إليه. تمثل هذه النماذج أكثر من مجرد تحسينات تدريجية—فهي تجسد إعادة تفكير أساسية في كيفية عمل الاستدلال الهجين والقدرات الوكيلة في بيئات الإنتاج.

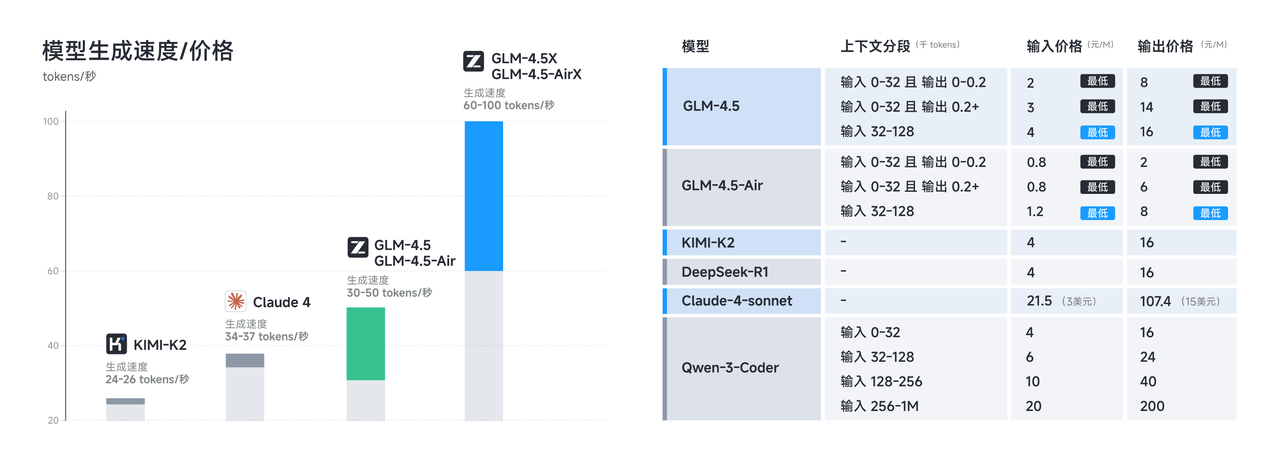

يأتي هذا الإصدار في لحظة حاسمة حيث يطالب المطورون بشكل متزايد ببدائل فعالة من حيث التكلفة للنماذج الاحتكارية دون التضحية بالقدرة. يحقق كل من GLM-4.5 و GLM-4.5 Air هذا الوعد من خلال ابتكارات معمارية متطورة تزيد من الكفاءة مع الحفاظ على أداء فائق في مهام الاستدلال والترميز والمهام متعددة الوسائط.

فهم ثورة بنية GLM-4.5

تمثل سلسلة GLM-4.5 خروجًا كبيرًا عن معماريات المحولات التقليدية. وبُني GLM-4.5 على بنية مطورة ذاتيًا بالكامل، ويحقق أداءً متقدمًا (SOTA) في النماذج مفتوحة المصدر من خلال العديد من الابتكارات الرئيسية التي تميزه عن المنافسين.

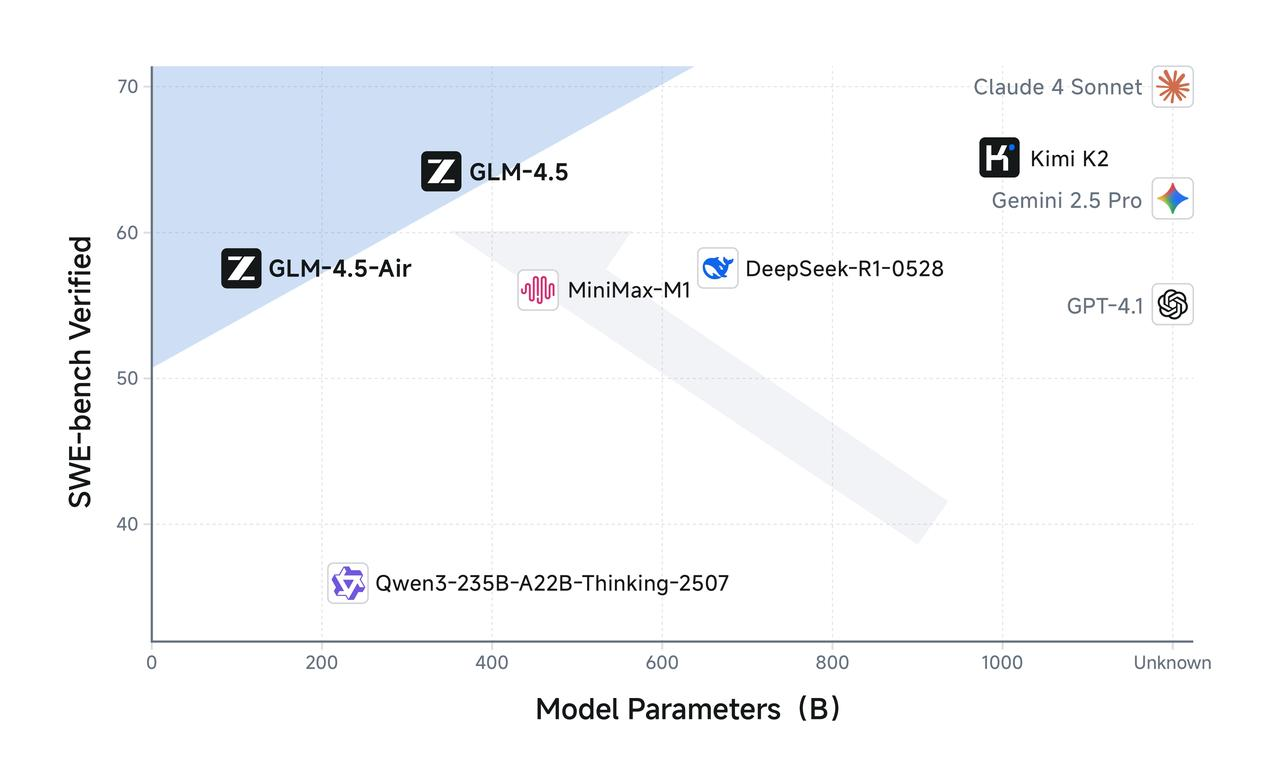

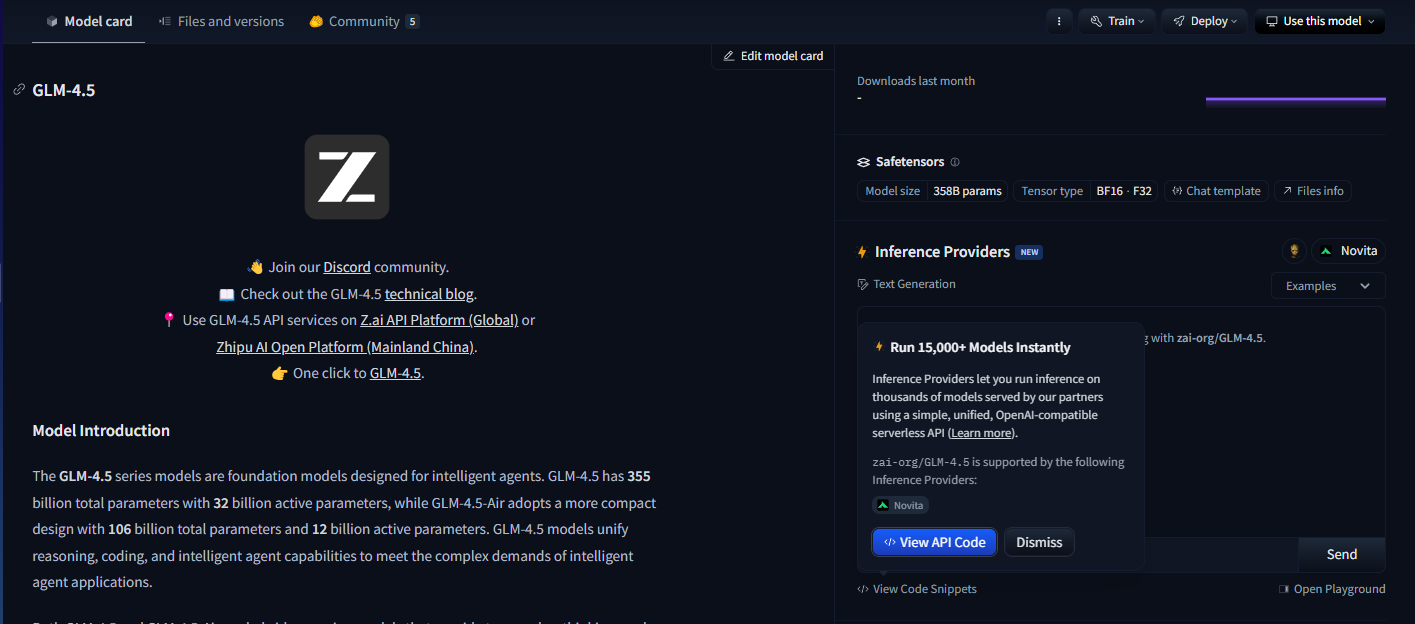

يتميز GLM-4.5 بإجمالي 355 مليار معلمة مع 32 مليار معلمة نشطة، بينما يتبنى GLM-4.5 Air تصميمًا أكثر إحكامًا بإجمالي 106 مليار معلمة و12 مليار معلمة نشطة. يعكس هذا التكوين للمعلمات توازنًا دقيقًا بين الكفاءة الحاسوبية وقدرة النموذج، مما يمكّن كلا النموذجين من تقديم أداء مبهر مع الحفاظ على تكاليف استنتاج معقولة.

تستخدم النماذج بنية متطورة من "مزيج الخبراء" (MoE) التي تنشط مجموعة فرعية فقط من المعلمات أثناء الاستنتاج. يستفيد كلاهما من تصميم "مزيج الخبراء" لتحقيق الكفاءة المثلى، مما يسمح لـ GLM-4.5 بمعالجة المهام المعقدة باستخدام 32 مليار معلمة فقط من أصل 355 مليار معلمة. وفي الوقت نفسه، يحافظ GLM-4.5 Air على قدرات استدلال مماثلة بـ 12 مليار معلمة نشطة فقط من إجمالي 106 مليار معلمة.

يعالج هذا النهج المعماري مباشرة أحد أكثر التحديات إلحاحًا في نشر نماذج اللغة الكبيرة: الحمل الحسابي الزائد للاستنتاج. تتطلب النماذج الكثيفة التقليدية تنشيط جميع المعلمات لكل عملية استنتاج، مما يخلق عبئًا حسابيًا غير ضروري للمهام الأبسط. تحل سلسلة GLM-4.5 هذه المشكلة من خلال توجيه المعلمات الذكي الذي يطابق التعقيد الحسابي مع متطلبات المهمة.

علاوة على ذلك، تدعم النماذج نوافذ سياق تصل إلى 128 ألف مدخل و96 ألف مخرج، مما يوفر قدرات كبيرة في معالجة السياق تمكن من الاستدلال المتطور طويل الأمد وتحليل المستندات الشامل. تثبت نافذة السياق الموسعة هذه قيمتها بشكل خاص للتطبيقات الوكيلة حيث يجب أن تحافظ النماذج على وعي بالتفاعلات المعقدة متعددة الخطوات.

خصائص أداء GLM-4.5 Air المحسّنة

يبرز GLM-4.5 Air كبطل الكفاءة في السلسلة، وقد صُمم خصيصًا للسيناريوهات التي تتطلب إدارة دقيقة للموارد الحاسوبية. GLM-4.5 Air هو نموذج أساسي مصمم خصيصًا لتطبيقات وكلاء الذكاء الاصطناعي، مبني على بنية "مزيج الخبراء" (MoE) التي تعطي الأولوية للسرعة وتحسين الموارد دون المساس بالقدرات الأساسية.

يوضح إصدار Air كيف يمكن لتقليل المعلمات المدروس أن يحافظ على جودة النموذج مع تحسين قابلية النشر بشكل كبير. مع إجمالي 106 مليار معلمة و12 مليار معلمة نشطة، يحقق GLM-4.5 Air مكاسب كفاءة ملحوظة تترجم مباشرة إلى تقليل تكاليف الاستنتاج وأوقات استجابة أسرع.

تمثل متطلبات الذاكرة مجالًا آخر يتفوق فيه GLM-4.5 Air. يتطلب GLM-4.5 Air ذاكرة GPU بحجم 16 جيجابايت (INT4 مُكمّم بحوالي 12 جيجابايت)، مما يجعله متاحًا للمؤسسات ذات القيود المعتدلة على الأجهزة. يثبت عامل إمكانية الوصول هذا أهميته الحاسمة للتبني على نطاق واسع، حيث لا تستطيع العديد من فرق التطوير تبرير تكاليف البنية التحتية المرتبطة بالنماذج الأكبر حجمًا.

يمتد التحسين إلى ما هو أبعد من كفاءة المعلمات الخالصة ليشمل التدريب المتخصص للمهام الموجهة للوكلاء. لقد تم تحسينه بشكل مكثف لاستخدام الأدوات، وتصفح الويب، وتطوير البرمجيات، وتطوير الواجهات الأمامية، مما يتيح التكامل السلس مع وكلاء الترميز. ويعني هذا التخصص أن GLM-4.5 Air يقدم أداءً فائقًا في مهام التطوير العملية مقارنة بالنماذج ذات الأغراض العامة من نفس الحجم.

تصبح زمن الاستجابة مهمًا بشكل خاص في التطبيقات التفاعلية حيث يتوقع المستخدمون ردود فعل شبه فورية. يتيح عدد المعلمات المخفض لـ GLM-4.5 Air وخط أنابيب الاستنتاج المحسّن أوقات استجابة أقل من الثانية لمعظم الاستفسارات، مما يجعله مناسبًا للتطبيقات في الوقت الفعلي مثل إكمال التعليمات البرمجية، وتصحيح الأخطاء التفاعلي، وإنشاء الوثائق الحية.

تنفيذ الاستدلال الهجين وفوائده

تكمن السمة المميزة لكلا نموذجي GLM-4.5 في قدراتهما على الاستدلال الهجين. فكلاهما، GLM-4.5 و GLM-4.5 Air، نماذج استدلال هجينة توفر وضعين: وضع التفكير للاستدلال المعقد واستخدام الأدوات، ووضع عدم التفكير للاستجابات الفورية. تمثل هذه البنية ثنائية الوضع ابتكارًا أساسيًا في كيفية تعامل نماذج الذكاء الاصطناعي مع أنواع مختلفة من المهام المعرفية.

يتم تفعيل وضع التفكير عندما تواجه النماذج مشاكل معقدة تتطلب استدلالًا متعدد الخطوات، أو استخدام الأدوات، أو تحليلًا موسعًا. خلال وضع التفكير، تولد النماذج خطوات استدلال وسيطة تظل مرئية للمطورين ولكنها مخفية عن المستخدمين النهائيين. تتيح هذه الشفافية تصحيح الأخطاء وتحسين عمليات الاستدلال مع الحفاظ على واجهات مستخدم نظيفة.

وعلى النقيض، يتعامل وضع عدم التفكير مع الاستفسارات المباشرة التي تستفيد من الاستجابات الفورية دون حمل زائد للاستدلال الموسع. يحدد النموذج تلقائيًا الوضع الذي سيستخدمه بناءً على تعقيد الاستعلام والسياق، مما يضمن الاستخدام الأمثل للموارد عبر حالات الاستخدام المتنوعة.

يحل هذا النهج الهجين تحديًا مستمرًا في أنظمة الذكاء الاصطناعي الإنتاجية: الموازنة بين سرعة الاستجابة وجودة الاستدلال. فالنماذج التقليدية إما أن تضحي بالسرعة من أجل استدلال شامل أو توفر استجابات سريعة ولكنها قد تكون سطحية. يلغي نظام GLM-4.5 الهجين هذه المقايضة عن طريق مطابقة تعقيد الاستدلال مع متطلبات المهمة.

يوفر كلاهما وضع التفكير للمهام المعقدة ووضع عدم التفكير للاستجابات الفورية، مما يخلق تجربة مستخدم سلسة تتكيف مع المتطلبات المعرفية المتغيرة. يمكن للمطورين تكوين معلمات اختيار الوضع لضبط التوازن بين السرعة وعمق الاستدلال بناءً على متطلبات التطبيق المحددة.

يثبت وضع التفكير قيمته بشكل خاص للتطبيقات الوكيلة حيث يجب على النماذج تخطيط إجراءات متعددة الخطوات، وتقييم خيارات استخدام الأدوات، والحفاظ على استدلال متماسك عبر التفاعلات الممتدة. وفي الوقت نفسه، يضمن وضع عدم التفكير أداءً سريع الاستجابة للاستعلامات البسيطة مثل البحث عن الحقائق أو مهام إكمال التعليمات البرمجية المباشرة.

المواصفات الفنية وتفاصيل التدريب

يعكس الأساس التقني الذي تقوم عليه قدرات GLM-4.5 المثيرة للإعجاب جهدًا هندسيًا واسع النطاق ومنهجيات تدريب مبتكرة. تم تدريب النماذج على 15 تريليون رمز، مع دعم نوافذ سياق تصل إلى 128 ألف مدخل و96 ألف مخرج، مما يوضح الحجم والتطور المطلوبين لأداء فائق.

يمثل تنسيق بيانات التدريب عاملًا حاسمًا في جودة النموذج، خاصة للتطبيقات المتخصصة مثل توليد التعليمات البرمجية والاستدلال الوكيلي. يشتمل corpus التدريب الذي يبلغ 15 تريليون رمز على مصادر متنوعة بما في ذلك مستودعات التعليمات البرمجية، والوثائق التقنية، وأمثلة الاستدلال، والمحتوى متعدد الوسائط الذي يتيح فهمًا شاملاً عبر المجالات.

تميز قدرات نافذة السياق GLM-4.5 عن العديد من النماذج المنافسة. يوفر GLM-4.5 طول سياق يبلغ 128 ألفًا وقدرة استدعاء وظائف أصلية، مما يتيح تحليلًا متطورًا طويل الأمد ومحادثات متعددة الأدوار دون اقتطاع السياق. تضمن نافذة سياق الإخراج التي تبلغ 96 ألفًا أن تتمكن النماذج من إنشاء استجابات شاملة دون قيود طول مصطنعة.

يمثل استدعاء الوظائف الأصلي ميزة معمارية أخرى تلغي الحاجة إلى طبقات تنسيق خارجية. يمكن للنماذج استدعاء الأدوات وواجهات برمجة التطبيقات الخارجية مباشرة كجزء من عملية الاستدلال الخاصة بها، مما يخلق سير عمل وكيل أكثر كفاءة وموثوقية. تثبت هذه القدرة أهميتها للتطبيقات الإنتاجية حيث يجب أن تتفاعل النماذج مع قواعد البيانات والخدمات الخارجية وأدوات التطوير.

تتضمن عملية التدريب تحسينًا متخصصًا للمهام الوكيلة، مما يضمن تطوير النماذج لقدرات قوية في استخدام الأدوات، والاستدلال متعدد الخطوات، والحفاظ على السياق. تتيح البنية الموحدة لسير عمل الاستدلال، والترميز، والإدراك-الفعل متعدد الوسائط انتقالات سلسة بين أنواع المهام المختلفة ضمن تفاعلات فردية.

تؤكد معايير الأداء فعالية أساليب التدريب هذه. في كلا المعيارين، يطابق GLM-4.5 أداء Claude في تقييمات قدرة الوكيل، مما يوضح قدرة تنافسية ضد النماذج الاحتكارية الرائدة مع الحفاظ على إمكانية الوصول مفتوحة المصدر.

مزايا الترخيص والنشر التجاري

يمثل ترخيص المصدر المفتوح إحدى أهم المزايا التنافسية لـ GLM-4.5 في مشهد الذكاء الاصطناعي الحالي. يتم إصدار النماذج الأساسية، والنماذج الهجينة (التفكير/غير التفكير)، وإصدارات FP8 جميعها للاستخدام التجاري غير المقيد والتطوير الثانوي بموجب ترخيص MIT، مما يوفر حرية غير مسبوقة للنشر التجاري.

يزيل نهج الترخيص هذا العديد من القيود التي تحد من نماذج المصدر المفتوح الأخرى. يمكن للمؤسسات تعديل، وإعادة توزيع، وتسويق تطبيقات GLM-4.5 دون رسوم ترخيص أو قيود استخدام. يعالج ترخيص MIT على وجه التحديد المخاوف التجارية التي غالبًا ما تعقد عمليات نشر الذكاء الاصطناعي للمؤسسات.

طرق الوصول المتعددة وتكامل المنصات

الموقع الرسمي والوصول المباشر لواجهة برمجة التطبيقات

تتضمن طريقة الوصول الأساسية استخدام منصة Z.ai الرسمية على chat.z.ai، والتي توفر واجهة سهلة الاستخدام للتفاعل الفوري مع النموذج. تتيح هذه الواجهة المستندة إلى الويب النماذج الأولية والاختبار السريع دون الحاجة إلى عمل تكامل تقني. يمكن للمطورين تقييم قدرات النموذج، واختبار استراتيجيات هندسة المطالبات، والتحقق من حالات الاستخدام قبل الالتزام بتطبيقات واجهة برمجة التطبيقات.

يوفر الوصول المباشر إلى واجهة برمجة التطبيقات (API) من خلال نقاط نهاية Z.ai الرسمية قدرات تكامل على مستوى الإنتاج مع توثيق ودعم شاملين. توفر واجهة برمجة التطبيقات الرسمية تحكمًا دقيقًا في معلمات النموذج، بما في ذلك اختيار وضع الاستدلال الهجين، واستخدام نافذة السياق، وخيارات تنسيق الاستجابة.

تكامل OpenRouter للوصول المبسط

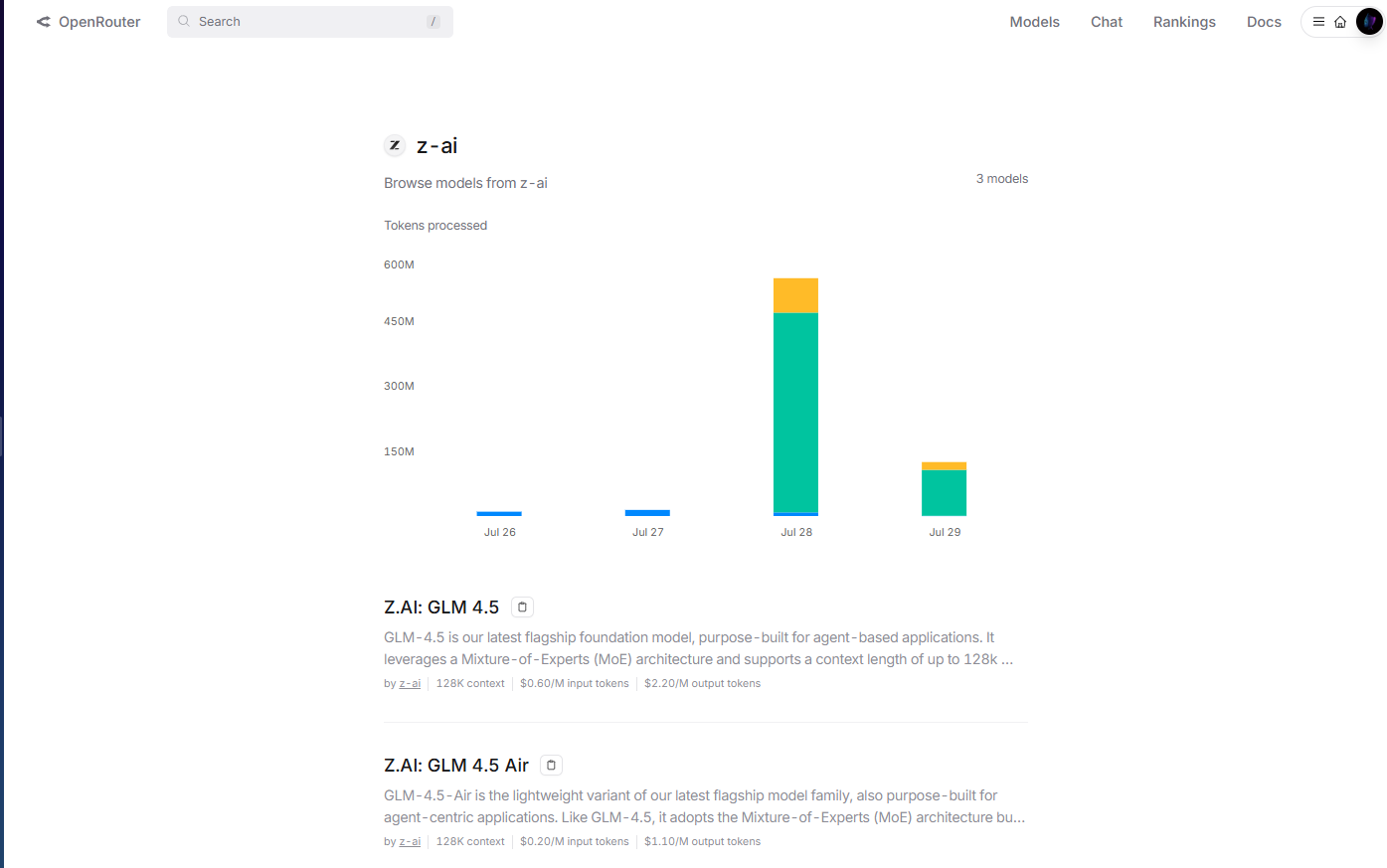

يوفر OpenRouter وصولاً مبسطًا إلى نماذج GLM-4.5 من خلال منصة واجهة برمجة التطبيقات الموحدة الخاصة بهم على openrouter.ai/z-ai. تثبت طريقة التكامل هذه قيمتها بشكل خاص للمطورين الذين يستخدمون بالفعل بنية OpenRouter التحتية متعددة النماذج، حيث إنها تلغي الحاجة إلى إدارة مفاتيح API منفصلة وأنماط تكامل.

يتعامل تطبيق OpenRouter مع المصادقة، وتحديد المعدل، ومعالجة الأخطاء تلقائيًا، مما يقلل من تعقيد التكامل لفرق التطوير. علاوة على ذلك، يتيح تنسيق API الموحد لـ OpenRouter سهولة تبديل النماذج واختبار A/B بين GLM-4.5 والنماذج الأخرى المتاحة دون تعديلات في التعليمات البرمجية.

تصبح إدارة التكلفة أكثر شفافية من خلال نظام الفوترة الموحد لـ OpenRouter، الذي يوفر تحليلات مفصلة للاستخدام وضوابط الإنفاق عبر موفري النماذج المتعددين. يبسط هذا النهج المركزي إدارة الميزانية للمؤسسات التي تستخدم نماذج ذكاء اصطناعي متعددة في تطبيقاتها.

Hugging Face Hub للنشر مفتوح المصدر

يستضيف Hugging Face Hub نماذج GLM-4.5، ويوفر بطاقات نماذج شاملة، ووثائق فنية، وأمثلة استخدام مدفوعة بالمجتمع. تثبت هذه المنصة أهميتها للمطورين الذين يفضلون أنماط النشر مفتوحة المصدر أو يتطلبون تخصيصًا واسع النطاق للنموذج.

يتيح تكامل Hugging Face النشر المحلي باستخدام مكتبة Transformers، مما يمنح المؤسسات تحكمًا كاملاً في استضافة النموذج وخصوصية البيانات. يمكن للمطورين تنزيل أوزان النموذج مباشرة، وتطبيق خطوط أنابيب استنتاج مخصصة، وتحسين تكوينات النشر لبيئات الأجهزة المحددة.

خيارات النشر المستضافة ذاتيًا

يمكن للمؤسسات ذات متطلبات خصوصية البيانات الصارمة أو احتياجات البنية التحتية المتخصصة نشر نماذج GLM-4.5 باستخدام تكوينات مستضافة ذاتيًا. يتيح ترخيص MIT النشر غير المقيد عبر بيئات السحابة الخاصة، والبنية التحتية المحلية، أو البنيات الهجينة.

يوفر النشر المستضاف ذاتيًا أقصى قدر من التحكم في سلوك النموذج، وتكوينات الأمان، وأنماط التكامل. يمكن للمؤسسات تنفيذ أنظمة مصادقة مخصصة، وبنية تحتية مراقبة متخصصة، وتحسينات خاصة بالمجال دون تبعيات خارجية.

يتيح النشر المستند إلى الحاويات باستخدام Docker أو Kubernetes تطبيقات مستضافة ذاتيًا قابلة للتوسع يمكنها التكيف مع متطلبات عبء العمل المتغيرة. تثبت أنماط النشر هذه قيمتها بشكل خاص للمؤسسات التي لديها خبرة حالية في تنسيق الحاويات.

التكامل مع سير عمل التطوير باستخدام Apidog

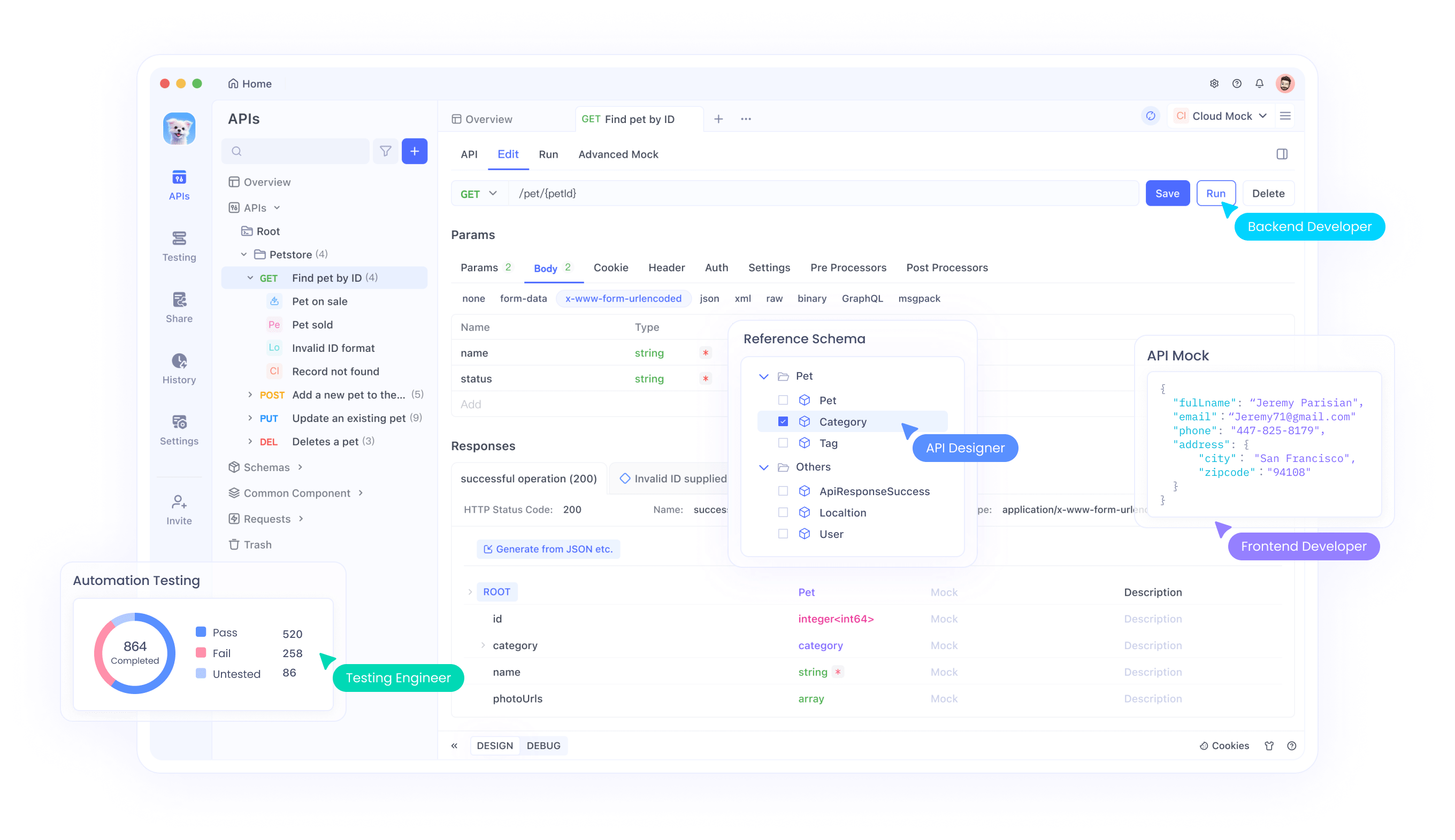

عند تطبيق نماذج GLM-4.5 عبر منصات مختلفة—سواء من خلال OpenRouter، أو الوصول المباشر لواجهة برمجة التطبيقات، أو عمليات نشر Hugging Face، أو التكوينات المستضافة ذاتيًا—يجب على المطورين التحقق من الأداء عبر حالات استخدام متنوعة، واختبار تكوينات معلمات مختلفة، وضمان معالجة موثوقة للأخطاء. يتيح إطار عمل اختبار واجهة برمجة التطبيقات في Apidog تقييمًا منهجيًا لاستجابات النموذج، وخصائص زمن الاستجابة، وأنماط استخدام الموارد عبر جميع طرق النشر هذه.

تثبت قدرات إنشاء الوثائق في المنصة قيمتها بشكل خاص عند نشر GLM-4.5 من خلال طرق وصول متعددة في وقت واحد. يمكن للمطورين إنشاء توثيق API شامل تلقائيًا يتضمن خيارات تكوين النموذج، ومخططات الإدخال/الإخراج، وأمثلة الاستخدام الخاصة بقدرات الاستدلال الهجين لـ GLM-4.5 عبر OpenRouter، وواجهة برمجة التطبيقات المباشرة، وعمليات النشر المستضافة ذاتيًا.

تسهل الميزات التعاونية داخل Apidog تبادل المعرفة عبر فرق التطوير التي تعمل مع تطبيقات GLM-4.5. يمكن لأعضاء الفريق مشاركة تكوينات الاختبار، وتوثيق أفضل الممارسات، والتعاون في أنماط التكامل التي تزيد من فعالية النموذج.

تضمن قدرات إدارة البيئة عمليات نشر GLM-4.5 متسقة عبر بيئات التطوير، والتدريج، والإنتاج، بغض النظر عما إذا كانت الفرق تستخدم خدمة OpenRouter المدارة، أو تكامل واجهة برمجة التطبيقات المباشر، أو التطبيقات المستضافة ذاتيًا. يمكن للمطورين الاحتفاظ بتكوينات منفصلة لبيئات مختلفة مع ضمان أنماط نشر قابلة للتكرار.

استراتيجيات التنفيذ وأفضل الممارسات

يتطلب النشر الناجح لنماذج GLM-4.5 دراسة متأنية لمتطلبات البنية التحتية، وتقنيات تحسين الأداء، وأنماط التكامل التي تزيد من فعالية النموذج. يجب على المؤسسات تقييم حالات الاستخدام المحددة الخاصة بها مقابل قدرات النموذج لتحديد تكوينات النشر المثلى.

تختلف متطلبات الأجهزة بشكل كبير بين GLM-4.5 و GLM-4.5 Air، مما يمكّن المؤسسات من اختيار الإصدارات التي تتناسب مع قيود بنيتها التحتية. يمكن للفرق التي لديها بنية تحتية قوية لوحدات معالجة الرسوميات (GPU) الاستفادة من نموذج GLM-4.5 الكامل للحصول على أقصى قدر من القدرة، بينما قد تجد البيئات ذات الموارد المحدودة أن GLM-4.5 Air يوفر أداءً كافيًا بتكاليف بنية تحتية أقل.

يمثل الضبط الدقيق للنموذج اعتبارًا حاسمًا آخر للمؤسسات ذات المتطلبات المتخصصة. يتيح ترخيص MIT تخصيصًا شاملاً للنموذج، مما يسمح للفرق بتكييف GLM-4.5 لتطبيقات خاصة بالمجال. ومع ذلك، يتطلب الضبط الدقيق تنسيقًا دقيقًا لمجموعات البيانات وخبرة تدريب لتحقيق أفضل النتائج.

يتطلب تكوين الوضع الهجين ضبطًا دقيقًا للمعلمات للموازنة بين سرعة الاستجابة وجودة الاستدلال. قد تفضل التطبيقات ذات متطلبات زمن الاستجابة الصارمة إعدادات افتراضية أكثر قوة لوضع عدم التفكير، بينما قد تستفيد التطبيقات التي تعطي الأولوية لجودة الاستدلال من عتبات أقل لوضع التفكير.

يجب أن تستفيد أنماط تكامل واجهة برمجة التطبيقات من قدرات استدعاء الوظائف الأصلية لـ GLM-4.5 لإنشاء سير عمل وكيل فعال. بدلاً من تنفيذ طبقات تنسيق خارجية، يمكن للمطورين الاعتماد على قدرات استخدام الأدوات المضمنة في النموذج لتقليل تعقيد النظام وتحسين الموثوقية.

اعتبارات الأمان وإدارة المخاطر

يؤدي نشر نماذج مفتوحة المصدر مثل GLM-4.5 إلى اعتبارات أمنية يجب على المؤسسات معالجتها من خلال استراتيجيات شاملة لإدارة المخاطر. يتيح توفر أوزان النموذج تدقيقًا أمنيًا شاملاً ولكنه يتطلب أيضًا معالجة دقيقة لمنع الوصول غير المصرح به أو سوء الاستخدام.

يتطلب أمان استنتاج النموذج الحماية من المدخلات العدائية التي قد تعرض سلوك النموذج للخطر أو تستخرج معلومات حساسة من بيانات التدريب. يجب على المؤسسات تنفيذ التحقق من المدخلات، وتصفية المخرجات، وأنظمة اكتشاف الشذوذ لتحديد التفاعلات التي قد تكون مشكلة.

يصبح أمان البنية التحتية للنشر حاسمًا عند استضافة نماذج GLM-4.5 في بيئات الإنتاج. تنطبق ممارسات الأمان القياسية بما في ذلك عزل الشبكة، وضوابط الوصول، والتشفير على عمليات نشر نماذج الذكاء الاصطناعي تمامًا كما تنطبق على التطبيقات التقليدية.

تتطلب اعتبارات خصوصية البيانات اهتمامًا دقيقًا لتدفقات المعلومات بين التطبيقات ونماذج GLM-4.5. يجب على المؤسسات التأكد من أن مدخلات البيانات الحساسة تتلقى الحماية المناسبة وأن مخرجات النموذج لا تكشف عن معلومات سرية عن غير قصد.

يمتد أمان سلسلة التوريد إلى مصدر النموذج والتحقق من سلامته. يجب على المؤسسات التحقق من مجاميع التحقق للنموذج، والتحقق من مصادر التنزيل، وتطبيق الضوابط التي تضمن أن النماذج المنشورة تتطابق مع التكوينات المقصودة.

تتيح طبيعة GLM-4.5 مفتوحة المصدر تدقيقًا أمنيًا شاملاً يوفر مزايا على النماذج الاحتكارية حيث تظل خصائص الأمان غير واضحة. يمكن للمؤسسات تحليل بنية النموذج، وخصائص بيانات التدريب، ونقاط الضعف المحتملة من خلال الفحص المباشر بدلاً من الاعتماد على تأكيدات أمان البائع.

الخاتمة

يمثل GLM-4.5 و GLM-4.5 Air تقدمًا كبيرًا في قدرات الذكاء الاصطناعي مفتوحة المصدر، حيث يقدمان أداءً تنافسيًا مع الحفاظ على إمكانية الوصول والمرونة التي تحدد مشاريع المصدر المفتوح الناجحة. لقد أصدرت Z.ai نموذجها الأساسي من الجيل التالي GLM-4.5، محققًا أداءً متقدمًا (SOTA) في النماذج مفتوحة المصدر من خلال ابتكارات معمارية تعالج تحديات النشر في العالم الحقيقي.

توضح بنية الاستدلال الهجين كيف يمكن للتصميم المدروس أن يزيل المقايضات التقليدية بين سرعة الاستجابة وجودة الاستدلال. يوفر هذا الابتكار نموذجًا لتطوير النماذج المستقبلية التي تعطي الأولوية للمنفعة العملية على أداء المعايير البحتة.

تتيح مزايا الكفاءة من حيث التكلفة الوصول إلى GLM-4.5 للمؤسسات التي كانت تجد سابقًا قدرات الذكاء الاصطناعي المتقدمة باهظة الثمن بشكل مفرط. يخلق الجمع بين تكاليف الاستنتاج المخفضة والترخيص المتساهل فرصًا لنشر الذكاء الاصطناعي عبر مختلف الصناعات وأحجام المؤسسات.