أنت بحاجة إلى أدوات فعالة لتوليد صور عالية الجودة من المطالبات النصية في التطبيقات الحديثة. يلبي Z-Image API هذا الطلب مباشرةً. يصل المطورون إلى نموذج قوي لتحويل النص إلى صورة من خلال واجهة مجانية تقدم نتائج واقعية بسرعة. يستفيد هذا الـ API من نموذج Z-Image-Turbo مفتوح المصدر من فريق Tongyi-MAI التابع لشركة Alibaba، والذي يعمل بموجب ترخيص Apache 2.0. تستفيد من الاستدلال في أقل من ثانية على الأجهزة المناسبة، مما يجعله مثاليًا للميزات في الوقت الفعلي في تطبيقات الويب، أو أدوات الجوال، أو سير العمل التلقائي.

بعد ذلك، تستكشف الأساس مفتوح المصدر لـ Z-Image-Turbo. ثم، تحصل على رؤى حول طرق الوصول إلى API وتؤكد هيكل تسعيره المجاني. أخيرًا، تقوم بتنفيذ عمليات دمج عملية. تزودك هذه الخطوات بالقدرة على نشر إمكانيات توليد الصور بفعالية.

فهم نموذج Z-Image-Turbo مفتوح المصدر

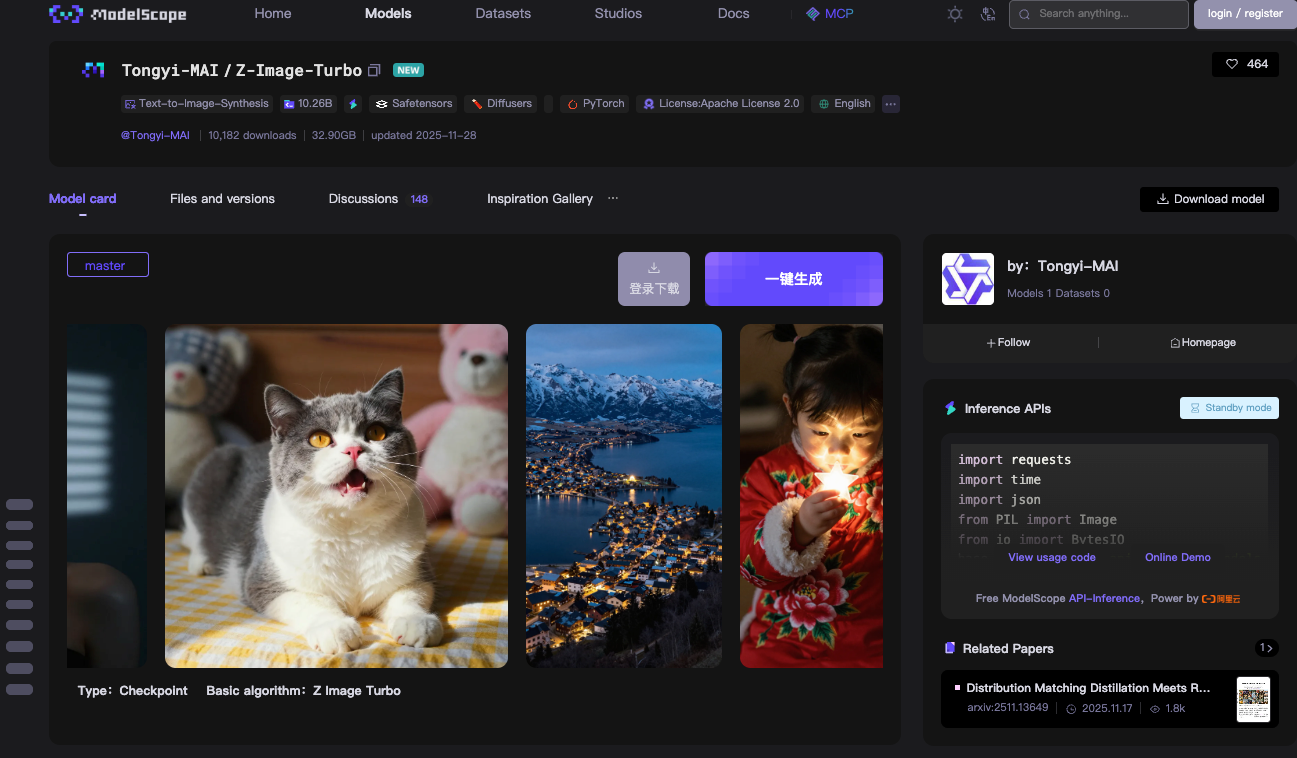

تبدأ بالتقنية الأساسية وراء Z-Image API: نموذج Z-Image-Turbo. يقوم فريق Tongyi-MAI التابع لشركة Alibaba بإطلاق هذا النموذج ذو الـ 6 مليارات معلمة كمصدر مفتوح بالكامل بموجب ترخيص Apache 2.0. يسمح هذا الترخيص بالاستخدام التجاري والتعديلات والتوزيع دون قيود، مما يسرع من اعتماده في بيئات الإنتاج.

يعتمد Z-Image-Turbo على بنية Scalable Single-Stream Diffusion Transformer (S3-DiT). تفصل النماذج التقليدية ثنائية التدفق معالجة النص والصورة، مما يهدر المعلمات. ومع ذلك، يقوم S3-DiT بربط رموز النص ورموز المعنى المرئي ورموز VAE للصور في تدفق واحد موحد. يزيد هذا التصميم من الكفاءة. ونتيجة لذلك، يتناسب النموذج مع 16 جيجابايت من ذاكرة الفيديو (VRAM) على وحدات معالجة الرسوميات الاستهلاكية مثل بطاقات NVIDIA RTX 40-series. يمكنك تحقيق ذلك دون التضحية بجودة الإخراج.

يتفوق النموذج في تركيب الصور الفوتوغرافية الواقعية. إنه يولد مشاهد مفصلة وصور شخصية ومناظر طبيعية من المطالبات الوصفية. على سبيل المثال، مطالبة مثل "بحيرة جبلية هادئة عند الغسق مع لافتات ثنائية اللغة بالإنجليزية والصينية" تنتج صورًا واضحة وواعية بالسياق. يتعامل Z-Image-Turbo مع التعليمات المعقدة بشكل جيد، بفضل مُحسِّن المطالبات (Prompt Enhancer) المدمج. يعمل هذا المكون على تحسين المدخلات لتحقيق التزام أفضل، مما يقلل من العيوب الشائعة في نماذج الانتشار السابقة.

تحدد سرعة الاستدلال ميزة Z-Image-Turbo. يتطلب 8 تقييمات للوظائف (NFEs) فقط، أي ما يعادل 9 خطوات استدلال عمليًا. على وحدات معالجة الرسوميات H800 المؤسسية، ترى زمن استجابة أقل من ثانية - غالبًا أقل من 500 مللي ثانية لكل صورة. تحقق الإعدادات الاستهلاكية من 2 إلى 5 ثوانٍ، اعتمادًا على الأجهزة. تنبع هذه الكفاءة من تقنيات التقطير مثل Decoupled-DMD و DMDR، التي تضغط نموذج Z-Image الأساسي مع الحفاظ على الأداء.

تقوم بتنزيل أوزان النموذج من ModelScope أو مستودعات Hugging Face. يتضمن الفرع الرئيسي ملفات نقطة الفحص التي يبلغ مجموعها حوالي 24 جيجابايت. تضمن توافقية PyTorch تكاملًا واسع النطاق. للاختبار المحلي، تقوم بتثبيت التبعيات عبر pip: torch، torchvision، و modelscope>=1.18.0. يقوم نص مسار أساسي بتحميل النموذج وتوليد صورة في أقل من 10 أسطر من التعليمات البرمجية.

خذ هذا المثال للاستدلال المحلي:

from modelscope.pipelines import pipeline

from modelscope.utils.constant import Tasks

import torch

device = "cuda" if torch.cuda.is_available() else "cpu"

pipe = pipeline(Tasks.text_to_image_synthesis, model="Tongyi-MAI/Z-Image-Turbo", device=device)

output = pipe({

"text": "A photorealistic golden retriever playing in a sunlit park, 1024x1024",

"width": 1024,

"height": 1024,

"num_inference_steps": 9

})

output["output_imgs"][0].save("generated_image.png")

يقوم هذا الكود بتهيئة المسار، ومعالجة المطالبة، وحفظ النتيجة. ستلاحظ المعلمة num_inference_steps: 9 — فهي تشغل عملية التقطير المكونة من 8 خطوات لتحقيق السرعة المثلى. يظل مقياس التوجيه عند 0.0، حيث تتخطى متغيرات Turbo التوجيه الخالي من المصنف للحفاظ على السرعة.

تؤكد المعايير التنافسية لـ Z-Image-Turbo. في ساحة الذكاء الاصطناعي من Alibaba، يحقق درجات عالية في تقييمات التفضيل البشري المستندة إلى Elo، متفوقًا على العديد من النماذج مفتوحة المصدر في الواقعية الفوتوغرافية ودقة النص. مقارنة بنماذج مثل Stable Diffusion 3، فإنه يستخدم خطوات أقل وذاكرة أقل، ومع ذلك يقدم تفاصيل مماثلة.

ومع ذلك، توجد قيود. يعطي النموذج الأولوية للسرعة على حساب الدقة القصوى؛ قد يؤدي تجاوز 1536x1536 إلى تشويش بدون ضبط دقيق. كما يفتقر إلى تحرير الصورة إلى صورة الأصلي في متغير Turbo - وهذا يقع على عاتق إصدار Z-Image-Edit القادم. ومع ذلك، لمهام تحويل النص إلى صورة، يوفر Z-Image-Turbo أساسًا قويًا ومتاحًا.

يمكنك تمديد هذا النموذج عبر Z-Image API، والذي يستضيفه على بنية ModelScope التحتية. يلغي هذا التحول من المحلي إلى السحابة أعباء الإعداد. وبالتالي، تركز على منطق التطبيق بدلاً من تحسين الأجهزة.

الوصول إلى Z-Image API المجاني: إعداد خطوة بخطوة

تنتقل بسلاسة إلى دمج واجهة برمجة التطبيقات (API). يعمل Z-Image API من خلال خدمة الاستدلال الخاصة بـ ModelScope، والتي تستضيف Z-Image-Turbo للمكالمات عن بعد. يتطلب هذا الإعداد الحد الأدنى من التكوين، ومع ذلك يوفر موثوقية على مستوى المؤسسات.

أولاً، تقوم بالتسجيل في منصة ModelScope. أنشئ حسابًا باستخدام بريدك الإلكتروني أو بيانات اعتماد GitHub. بمجرد تسجيل الدخول، انتقل إلى قسم API ضمن ملفك الشخصي. قم بإنشاء رمز ModelScope Token — يعمل هذا كمفتاح مصادقة Bearer الخاص بك. قم بتخزينه بأمان، حيث تتطلب جميع الطلبات وجوده في رأس Authorization.

تتمحور نقطة نهاية واجهة برمجة التطبيقات (API) حول المعالجة غير المتزامنة، والتي تناسب احتياجات الإنتاجية العالية. يمكنك إرسال مهام التوليد عبر طلب POST إلى https://api-inference.modelscope.cn/v1/images/generations. تعيد الاستجابات معرف مهمة (task_id) على الفور. ثم، تقوم بالاستعلام عن https://api-inference.modelscope.cn/v1/tasks/{task_id} كل 5-10 ثوانٍ حتى الاكتمال. يمنع هذا التصميم حدوث مهلات في عمليات التوليد الطويلة، على الرغم من أن سرعة Z-Image-Turbo تجعل فترات الانتظار قصيرة — عادةً من 5 إلى 15 ثانية من البداية إلى النهاية.

تتضمن الرؤوس الرئيسية:

Authorization: Bearer {your_token}Content-Type: application/jsonX-ModelScope-Async-Mode: true(للإرسال)X-ModelScope-Task-Type: image_generation(لتحقق الحالة)

يحدد جسم الطلب المعلمات مثل معرف النموذج، والمطالبة، والأبعاد، والخطوات. يمكنك تعيين "model": "Tongyi-MAI/Z-Image-Turbo" لاستهداف هذا المتغير. الأبعاد الافتراضية هي 1024x1024، ولكن يمكنك ضبط height و width لنسب أبعاد مخصصة. حافظ على guidance_scale: 0.0 و num_inference_steps: 9 للحصول على أفضل النتائج.

يوضح مثال curl كامل العملية:

# الخطوة 1: إرسال المهمة

curl -X POST "https://api-inference.modelscope.cn/v1/images/generations" \

-H "Authorization: Bearer YOUR_TOKEN" \

-H "Content-Type: application/json" \

-H "X-ModelScope-Async-Mode: true" \

-d '{

"model": "Tongyi-MAI/Z-Image-Turbo",

"prompt": "A futuristic cityscape at night with neon signs in Chinese and English",

"height": 1024,

"width": 1024,

"num_inference_steps": 9,

"guidance_scale": 0.0

}'

# استخراج task_id من الاستجابة، على سبيل المثال، {"task_id": "abc123"}

# الخطوة 2: الاستعلام عن الحالة

curl -X GET "https://api-inference.modelscope.cn/v1/tasks/abc123" \

-H "Authorization: Bearer YOUR_TOKEN" \

-H "X-ModelScope-Task-Type: image_generation"

عند النجاح، تتضمن استجابة الحالة "task_status": "SUCCEED" ومصفوفة output_images مع رابط قابل للتنزيل. يمكنك جلب الصورة عبر GET، وحفظها بتنسيق PNG أو JPEG.

بالنسبة للبدائل المتزامنة، يقدم ModelScope عرضًا توضيحيًا عبر الإنترنت على modelscope.cn/aigc/imageGeneration. حدد Z-Image-Turbo كنموذج افتراضي. يقوم الوضع السريع (Quick Mode) بتوليد الصور بدون معلمات، بينما يكشف الوضع المتقدم (Advanced Mode) عن أدوات التحكم الكاملة. تخدم هذه الواجهة النماذج الأولية، ولكنك تفضل API للأتمتة.

تثبت معالجة الأخطاء أنها ضرورية. تتضمن الرموز الشائعة 401 (رمز غير صالح)، 429 (حدود المعدل)، و 500 (مشاكل الخادم). نفذ إعادة المحاولات مع التراجع الأسي في كود الإنتاج. تتراوح حدود المعدل حوالي 10-20 طلبًا في الدقيقة للمستويات المجانية، على الرغم من أن الحصص الدقيقة تختلف حسب الحساب.

يمكنك دمج واجهة برمجة التطبيقات هذه في بيئات متنوعة. يستخدم مطورو Python مكتبة requests لاستدعاءات HTTP، كما هو موضح سابقًا. يستفيد مستخدمو Node.js من axios للاستعلام المستند إلى الوعود. حتى الدوال بدون خادم على AWS Lambda أو Vercel تُنشر بسهولة، نظرًا لحمولاتها الخفيفة.

يعزز Apidog مرحلة الوصول هذه. قم باستيراد مواصفات API إلى Apidog، الذي يقوم تلقائيًا بتوليد التوثيق وحالات الاختبار. يمكنك محاكاة الاستجابات، وتسلسل الطلبات للاستعلام، وتصدير المجموعات للمشاركة مع الفريق. تقلل هذه المنصة وقت تصحيح الأخطاء، مما يتيح لك التركيز على هندسة المطالبات.

من خلال هذه الخطوات، تقوم بإنشاء اتصال موثوق به بـ Z-Image API. الآن، تفحص تسعيرها لتأكيد فعاليتها من حيث التكلفة.

التسعير والحصص لـ Z-Image API

تؤكد القدرة على تحمل التكاليف بعد ذلك. لا يفرض Z-Image API أي رسوم على الاستدلال. يوفر ModelScope حوسبة مجانية غير محدودة لاستدعاءات Z-Image-Turbo، كما أُعلن في منشورهم الرسمي على X. يتضمن هذا النموذج بدون تكلفة الاستضافة وعرض النطاق الترددي وموارد GPU - وهو أمر نادر بين خدمات الذكاء الاصطناعي.

ومع ذلك، تنطبق الحصص لمنع الإساءة. تواجه الحسابات المجانية حدودًا مرنة: حوالي 50-100 جيل في الساعة، يتم إعادة تعيينها بشكل دوري. يمكنك مراقبة الاستخدام عبر لوحة تحكم ModelScope. يؤدي تجاوز الحدود إلى تقييد مؤقت، ولكن يمكنك الترقية إلى المستويات الاحترافية لأحجام أكبر إذا لزم الأمر. تبدأ الخطط الاحترافية برسوم منخفضة، ولكن المستوى المجاني يكفي لمعظم المطورين والهواة.

أفضل الممارسات لتحسين أداء Z-Image API

يمكنك تحسين استخدامك باستراتيجيات مستهدفة. أولاً، حدد المعلمات المثلى. التزم بـ 1024x1024 لتحقيق التوازن؛ قم بالترقية بعد التوليد إذا لزم الأمر. حدد الخطوات بـ 9 — القيم الأعلى تبطئ الاستدلال دون مكاسب.

يعزز تسريع الأجهزة الهجينة المحلية. قم بتمكين Flash Attention في Diffusers: pipe.transformer.set_attention_backend("flash"). يقلل هذا من الذاكرة بنسبة 20-30% على وحدات معالجة الرسوميات Ampere.

ترفع هندسة المطالبات الجودة. قم بهيكلة المدخلات على شكل "الموضوع + الإجراء + البيئة + النمط". اختبر الاختلافات في وضع المحاكاة الخاص بـ Apidog للتكرار بسرعة.

تحمي ممارسات الأمان عمليات الدمج. لا تعرض الرموز أبدًا في كود جانب العميل؛ استخدم وكلاء الخادم. تحقق من صحة المدخلات لمنع هجمات الحقن.

تتتبع أدوات المراقبة المقاييس. سجل أوقات التوليد ومعدلات النجاح واستخدام الرمز. تتكامل أدوات مثل Prometheus بسهولة مع لوحات المعلومات.

الخاتمة

أنت الآن تتقن Z-Image API بشكل كامل. من فهم بنية Z-Image-Turbo مفتوحة المصدر إلى تنفيذ استدعاءات API وتحسين سير العمل، يزودك هذا الدليل بالنجاح. يضفي نموذج التسعير المجاني طابعًا ديمقراطيًا على توليد الصور المتقدم، بينما تبسط أدوات مثل Apidog عملية التطوير.

طبق هذه التقنيات في مشروعك القادم. جرب المطالبات، قم بتوسيع نطاق عمليات الدمج، وساهم في النظام البيئي. مع تطور الذكاء الاصطناعي، يضعك Z-Image-Turbo في طليعة الأدوات الفعالة والإبداعية.