Los desarrolladores y entusiastas de la IA recurren cada vez más a potentes modelos generativos como Wan 2.2 para crear videos cinematográficos a partir de entradas sencillas. Este modelo se destaca por su arquitectura de Mezcla de Expertos, que aumenta la capacidad sin sacrificar la velocidad. Al combinar la API de Wan 2.2 (con LoRA), se obtiene la capacidad de ajustar las salidas para estilos o movimientos específicos, lo que lo hace ideal para la generación de video personalizada.

¿Qué es Wan 2.2?

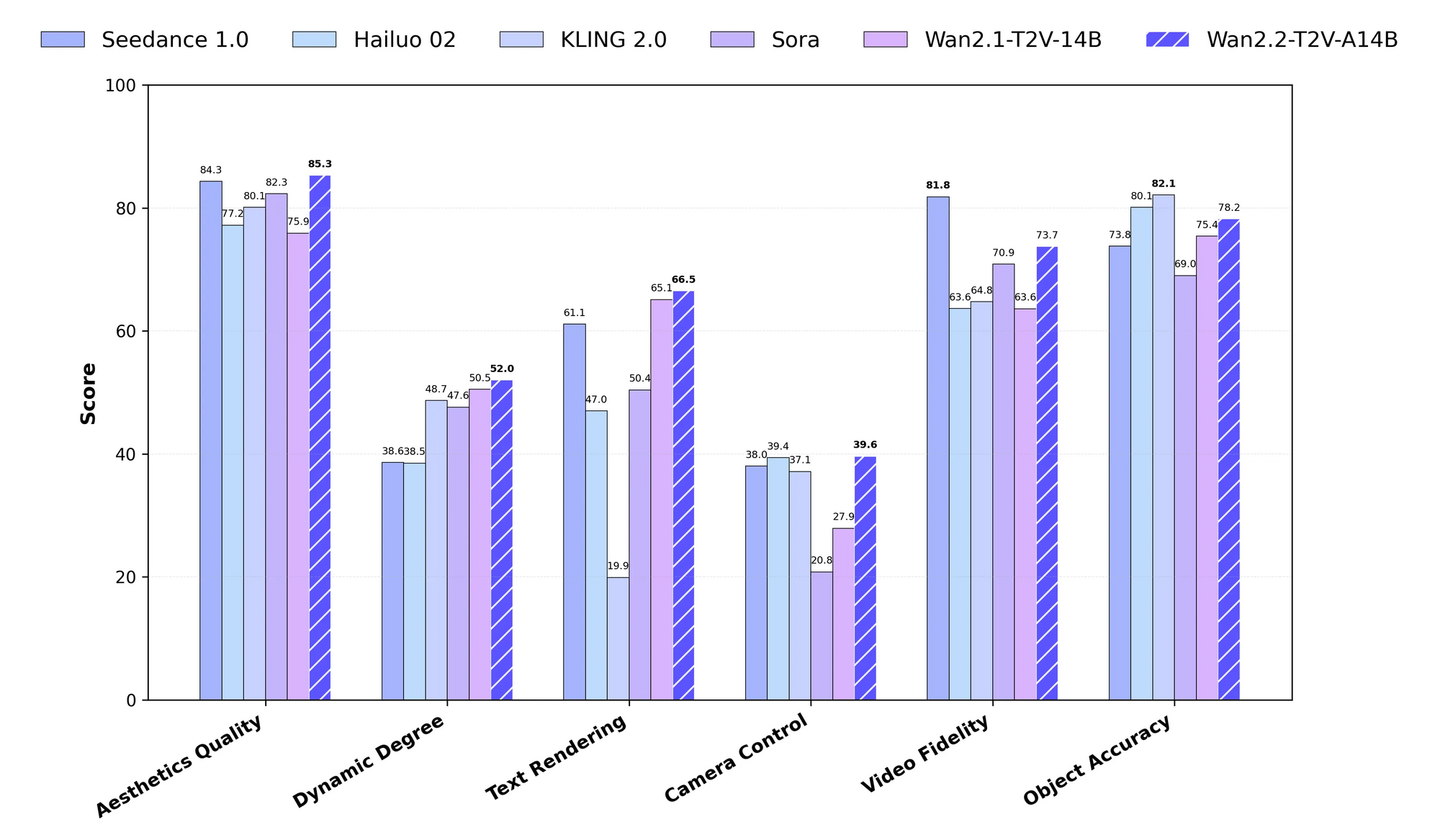

Wan 2.2 representa un modelo generativo de video a gran escala, de código abierto y avanzado, desarrollado por el equipo de Wan. Los ingenieros lo diseñaron para manejar tareas complejas como la generación de texto a video (T2V), imagen a video (I2V) y voz a video (S2V). El modelo emplea un marco de Mezcla de Expertos (MoE), que divide el proceso de eliminación de ruido en modelos de difusión entre expertos especializados. Por ejemplo, los expertos de alto ruido gestionan los pasos iniciales, mientras que los de bajo ruido refinan las etapas posteriores. Este enfoque resulta en un total de 27 mil millones de parámetros, con solo 14 mil millones activos por paso de inferencia, garantizando la eficiencia.

Además, Wan 2.2 incorpora estética cinematográfica a través de conjuntos de datos curados que enfatizan la iluminación, la composición y los tonos de color. Los datos de entrenamiento se expanden significativamente con respecto a versiones anteriores, incluyendo un 65.6% más de imágenes y un 83.2% más de videos, lo que mejora la complejidad del movimiento y la comprensión semántica. Se puede acceder a variantes como el modelo TI2V de 5 mil millones de parámetros, que genera videos de 720P a 24 FPS en hardware de consumo como una RTX 4090.

El aspecto de la API se manifiesta principalmente a través de scripts como `generate.py` en el repositorio oficial, pero las plataformas alojadas lo extienden a puntos finales basados en la web. Por lo tanto, puedes elegir entre la ejecución local para un control total o los servicios en la nube para la escalabilidad al trabajar con la API de Wan 2.2 (con LoRA).

¿Qué es LoRA en el Contexto de Wan 2.2?

LoRA, o Adaptación de Bajo Rango, sirve como un método de ajuste fino eficiente en parámetros para modelos grandes como Wan 2.2. Los desarrolladores aplican LoRA para adaptar el modelo base a conjuntos de datos específicos sin volver a entrenar toda la arquitectura. En Wan 2.2, LoRA se dirige a los pesos del transformador, lo que le permite inyectar estilos, personajes o movimientos personalizados en las generaciones de video.

Por ejemplo, puedes entrenar un LoRA con un conjunto de datos de tomas orbitales para especializar la variante I2V en la creación de movimientos de cámara giratorios. La documentación oficial advierte contra el uso de LoRA entrenado en Wan 2.2 para ciertas tareas como la animación debido a una posible inestabilidad, pero las herramientas de la comunidad superan esto. Plataformas como fal.ai integran LoRA directamente en su API, donde se especifican las rutas a los pesos de LoRA y los factores de escala.

En consecuencia, la incorporación de LoRA en la API de Wan 2.2 (con LoRA) reduce los costos de entrenamiento y permite una personalización rápida. Se fusionan los adaptadores LoRA en el momento de la inferencia, preservando la eficiencia del modelo base al tiempo que se logran salidas específicas.

¿Por Qué Usar la API de Wan 2.2 con LoRA?

Se opta por la API de Wan 2.2 (con LoRA) para equilibrar la potencia y la flexibilidad en las aplicaciones de IA de video. El ajuste fino tradicional exige recursos masivos, pero LoRA minimiza esto al actualizar solo matrices de bajo rango. Este método reduce el uso de memoria y el tiempo de entrenamiento, haciéndolo accesible para desarrolladores individuales.

Además, la estructura MoE de Wan 2.2 complementa a LoRA al permitir adaptaciones específicas de expertos. Se generan videos con estéticas o movimientos mejorados que los modelos "vainilla" (básicos) tienen dificultades para producir. Por ejemplo, en la creación de contenido, se usa LoRA para mantener estilos de personajes consistentes en todas las escenas.

Las API alojadas amplifican estos beneficios al descargar la computación a la nube. Servicios como fal.ai se encargan del trabajo pesado, para que usted se concentre en las indicaciones y los parámetros. Por lo tanto, esta combinación es adecuada para la creación de prototipos, la producción y la experimentación, especialmente cuando integra herramientas como Apidog para una gestión de API fluida.

¿Cómo Configurar su Entorno para el Uso Local de la API de Wan 2.2?

Comienza clonando el repositorio de Wan 2.2 desde GitHub. Ejecuta el comando `git clone https://github.com/Wan-Video/Wan2.2.git` en tu terminal, luego navega al directorio con `cd Wan2.2`. A continuación, instala las dependencias usando `pip install -r requirements.txt`. Para tareas S2V, añade `pip install -r requirements_s2v.txt`.

Asegúrate de que tu sistema ejecute PyTorch versión 2.4.0 o superior. También instala la CLI de Hugging Face con `pip install "huggingface_hub[cli]" ` para descargas de modelos. Configura variables de entorno si planeas usar la extensión de prompts, como `export DASH_API_KEY=your_key` para la integración con Dashscope.

Para configuraciones multi-GPU, configura Fully Sharded Data Parallel (FSDP) y DeepSpeed Ulysses. Habilitas estos con indicadores como `--dit_fsdp` y `--ulysses_size 8`. Los usuarios de una sola GPU activan optimizaciones de memoria mediante `--offload_model` y `--convert_model_dtype`. Esta configuración te prepara para ejecutar el script `generate.py`, el núcleo de la API local de Wan 2.2 (con LoRA).

¿Cómo Descargar e Instalar Modelos de Wan 2.2?

Descargas modelos de Hugging Face o ModelScope. Para la variante T2V-A14B, usa `huggingface-cli download Wan-AI/Wan2.2-T2V-A14B --local-dir ./Wan2.2-T2V-A14B`. Repite esto para otras variantes como I2V-A14B o TI2V-5B.

Coloca los checkpoints en los directorios apropiados. Los modelos de 14B requieren una VRAM sustancial, alrededor de 80 GB para inferencia multi-GPU, mientras que el TI2V de 5B cabe en una tarjeta de 24 GB. Después de la descarga, verifica los archivos para evitar la corrupción.

Si encuentras problemas, cambia a los espejos de ModelScope para regiones con restricciones de acceso. Este paso asegura que tengas los modelos base listos antes de aplicar los adaptadores LoRA en la API de Wan 2.2 (con LoRA).

¿Cómo Usar el Script Generate.py para Tareas Básicas en Wan 2.2?

Invoca el script `generate.py` para realizar generaciones. Para una tarea T2V sencilla en una sola GPU, ejecuta `python generate.py --task t2v-A14B --size 1280x720 --ckpt_dir ./Wan2.2-T2V-A14B --offload_model True --convert_model_dtype --prompt "Two anthropomorphic cats in comfy boxing gear fight intensely on a spotlighted stage."`.

Ajusta los parámetros para otros modos. En I2V, añade `--image examples/i2v_input.JPG`. Para S2V, incluye `--audio examples/audio_input.wav` y habilita TTS con `--enable_tts`. La ejecución multi-GPU usa `torchrun --nproc_per_node=8 generate.py` con banderas FSDP.

Estos comandos forman la columna vertebral de la API local de Wan 2.2 (con LoRA). Puedes experimentar con prompts y tamaños para refinar las salidas, haciendo una transición fluida a la integración de LoRA para personalizaciones avanzadas.

¿Cómo Entrenar un LoRA para Wan 2.2?

Entrenas LoRA usando herramientas de la comunidad como AI Toolkit o los entrenadores de Trooper.AI. Primero, prepara tu conjunto de datos: selecciona videos o imágenes alineados con tu estilo objetivo. Para un LoRA I2V, enfócate en clips específicos de movimiento como tomas orbitales.

Configura el entorno de entrenamiento en plataformas como RunPod para el acceso a la GPU. Carga los pesos base de Wan 2.2 en los directorios esperados. Configura los hiperparámetros: establece la tasa de aprendizaje en 1e-5, el tamaño del lote en 1 y las épocas en 10-20 dependiendo del tamaño del conjunto de datos.

Ejecuta el script de entrenamiento, monitoreando las métricas de pérdida. Herramientas como la biblioteca PEFT de Hugging Face facilitan esto, permitiéndote guardar el LoRA como un archivo `.safetensors`. Una vez entrenado, aplicas este adaptador en las generaciones, mejorando la API de Wan 2.2 (con LoRA) para tareas especializadas.

¿Cómo Aplicar LoRA en la Generación Local de Wan 2.2?

Integras LoRA en configuraciones locales a través de ComfyUI o scripts personalizados. En ComfyUI, usa el nodo `LoadLoRAModelOnly` entre el cargador de modelos y el muestreador. Especifica la ruta y la fuerza de LoRA (por ejemplo, 0.8).

Para `generate.py`, las bifurcaciones o extensiones de la comunidad añaden soporte para LoRA, ya que la versión oficial carece de integración directa. Alternativamente, usa la pipeline de Diffusers para modos de animación, cargando LoRA con `pipe.load_lora_weights("path/to/lora")`.

Esta aplicación transforma las salidas estándar en videos personalizados. Por lo tanto, logras consistencia en estilos o movimientos, haciendo que la API de Wan 2.2 (con LoRA) sea más versátil para uso en producción.

¿Cuáles Son los Mejores Servicios Alojados para la API de Wan 2.2 con LoRA?

Accedes a la API alojada de Wan 2.2 (con LoRA) a través de plataformas como fal.ai. Su punto final en `https://api.fal.ai/v1/fal-ai/wan/v2.2-a14b/text-to-video/lora` es compatible con LoRA de forma nativa. Regístrate para obtener una clave de API y configúrala en tu cliente.

Otros servicios incluyen WaveSpeed.ai para LoRA I2V y Trooper.AI para entrenamiento. Estos eliminan la necesidad de hardware local, escalando a altas resoluciones sin esfuerzo. En consecuencia, prototipas más rápido, integrando con herramientas como Apidog para la gestión de solicitudes.

¿Cómo Autenticarse y Enviar Solicitudes a la API de fal.ai Wan 2.2?

Te autenticas estableciendo la variable de entorno `FAL_KEY`. Instala el cliente de fal-ai con `npm install --save @fal-ai/client` para JavaScript, o usa equivalentes en Python.

Envía una solicitud POST con un payload JSON que incluya `prompt` y el array `loras`. Por ejemplo: `{"prompt": "A cyberpunk cityscape at night", "loras": [{"path": "https://example.com/loras/cyberpunk.safetensors", "scale": 0.8}]}`.

Monitoriza las respuestas para las URL de los videos. Este proceso aprovecha la API de Wan 2.2 (con LoRA) en entornos de nube, asegurando un rendimiento fiable.

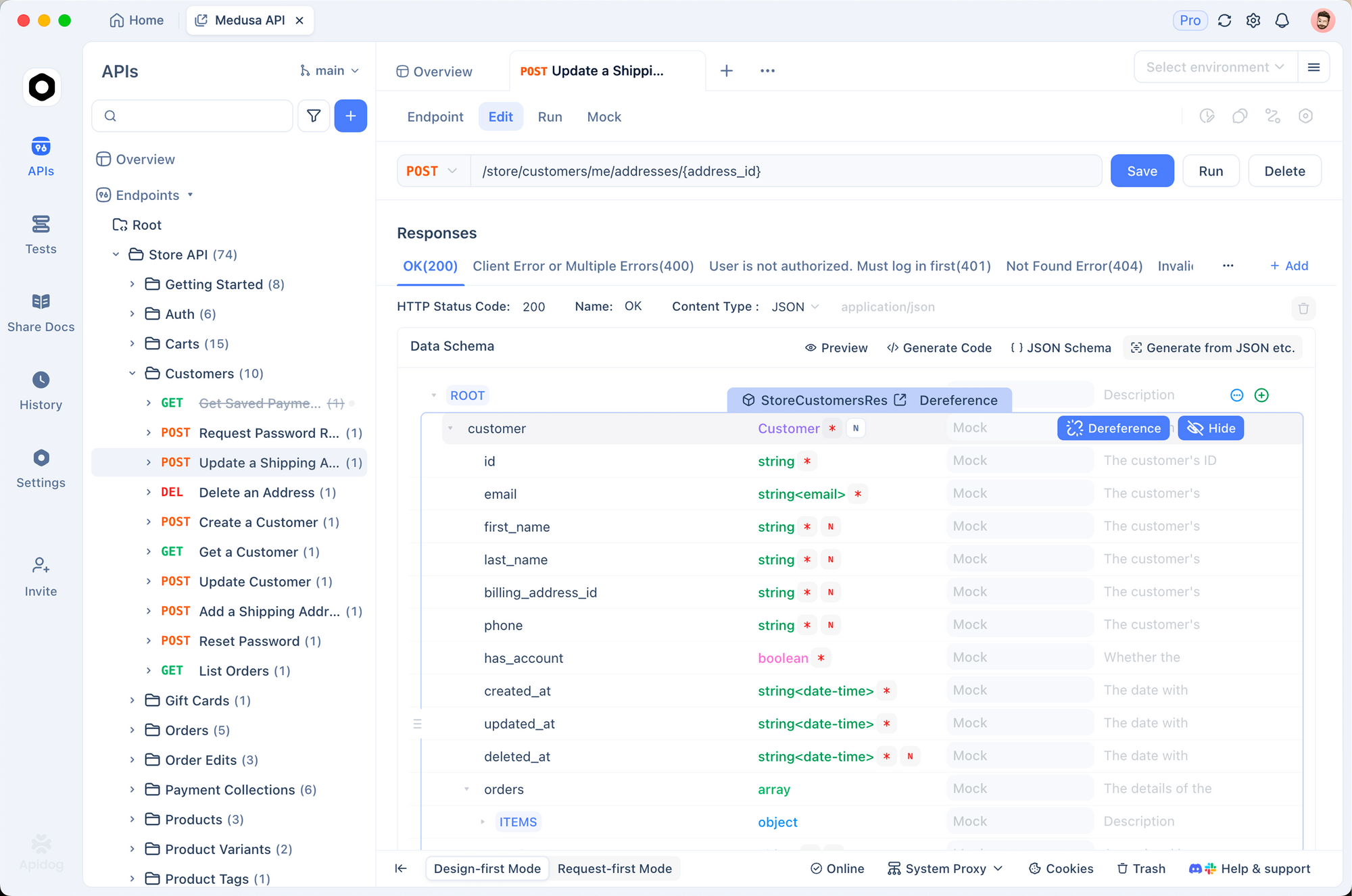

¿Cómo Usar Apidog para Probar la API de Wan 2.2 con LoRA?

Comienza instalando Apidog y creando un nuevo proyecto de API. Importa los detalles del punto final de fal.ai, configurando el método como POST y la URL a la ruta LoRA de texto a video.

Añade encabezados para la autenticación, como `Authorization: Key your_fal_key`. En la pestaña del cuerpo, construye JSON con los parámetros de prompt y LoRA. Envía la solicitud e inspecciona la respuesta, que incluye el enlace al video generado.

Las características de Apidog, como las variables de entorno y la validación de respuestas, agilizan la depuración. Por ejemplo, puedes guardar configuraciones comunes de LoRA como colecciones. Así, Apidog mejora tu flujo de trabajo al probar la API de Wan 2.2 (con LoRA), permitiendo iteraciones rápidas.

¿Qué Parámetros Debe Ajustar en la API de Wan 2.2 con LoRA?

Ajusta los parámetros clave para optimizar las salidas. Establece `num_inference_steps` en 27 para un equilibrio, o más alto para mayor calidad. Las escalas de guía como 3.5 influyen en la adherencia a los prompts.

Para LoRA, ajusta `scale` entre 0.5 y 1.0 para controlar la fuerza del adaptador. Las opciones de resolución incluyen 720p, mientras que los FPS varían de 4 a 60. Habilita la aceleración para generaciones más rápidas, aunque esto puede reducir la fidelidad.

Además, utiliza prompts negativos para evitar elementos no deseados. Estos ajustes refinan la API de Wan 2.2 (con LoRA), adaptándose a las necesidades específicas del proyecto.

¿Cómo Manejar Entradas Multimodales en Wan 2.2 con LoRA?

Incorporas imágenes o audio especificando `--image` o `--audio` en scripts locales, o campos equivalentes en APIs alojadas. Aplica LoRA para mejorarlos, como estilizar las salidas I2V.

En fal.ai, añade `image_url` para los modos TI2V. LoRA adapta la fusión, asegurando videos coherentes. Por lo tanto, creas contenido dinámico como personajes animados, aprovechando todo el potencial de la API de Wan 2.2 (con LoRA).

¿Cuáles Son las Técnicas de Optimización Avanzadas para la Inferencia de Wan 2.2?

Empleas optimizaciones de memoria como la descarga de modelos (model offloading) y la conversión de tipo de dato (dtype conversion) para ejecutarlos en hardware limitado. Para configuraciones multi-GPU, FSDP distribuye los fragmentos de manera eficiente.

En configuraciones alojadas, encola solicitudes asíncronas para manejar lotes. Utiliza la expansión de prompts con LLMs para enriquecer las entradas. Estas técnicas aceleran la API de Wan 2.2 (con LoRA), haciéndola adecuada para aplicaciones en tiempo real.

¿Cómo Integrar la API de Wan 2.2 con LoRA en Aplicaciones?

Construyes aplicaciones envolviendo las llamadas a la API en servicios de backend. Por ejemplo, crea un servidor Node.js que actúe como proxy para las solicitudes de fal.ai, añadiendo LoRA basándose en las entradas del usuario.

Gestiona webhooks para trabajos de larga duración, notificando a los usuarios al finalizar. Intégrate con frontends para la generación interactiva de video. Esta integración incrusta la API de Wan 2.2 (con LoRA) en herramientas como plataformas de contenido.

¿Qué Ejemplos Demuestran Wan 2.2 con LoRA en Acción?

Considera generar una escena ciberpunk: Usa el prompt "Calles iluminadas con neón con coches voladores" y un LoRA entrenado en arte distópico. El resultado produce videos estilizados con detalles mejorados.

Otro ejemplo: Entrena LoRA con movimientos de baile para S2V, sincronizando el audio con la coreografía. Estos casos ilustran usos prácticos de la API de Wan 2.2 (con LoRA).

¿Cómo Solucionar Problemas Comunes con la API de Wan 2.2 y LoRA?

Aborda los errores de falta de memoria habilitando las banderas de descarga (offload flags) o reduciendo la resolución. Si LoRA causa inestabilidad, reduce las escalas o reentrena con conjuntos de datos estables.

Para fallos de la API, verifica la autenticación y la validez de los parámetros en Apidog. Los problemas de red requieren lógica de reintento. Así, resuelves problemas de manera eficiente, manteniendo operaciones fluidas con la API de Wan 2.2 (con LoRA).

¿Qué Desarrollos Futuros Podrían Impactar a Wan 2.2 con LoRA?

Los investigadores continúan avanzando en los modelos de difusión, integrando potencialmente variantes de LoRA más eficientes. Las contribuciones de la comunidad podrían añadir soporte nativo de LoRA a los scripts oficiales.

Los servicios alojados podrían expandir las modalidades. Mantenerse actualizado asegura que aprovechas las evoluciones en la API de Wan 2.2 (con LoRA).

Conclusión

Ahora posee una comprensión exhaustiva de cómo acceder y utilizar la API de Wan 2.2 (con LoRA). Desde configuraciones locales hasta APIs alojadas, y con herramientas como Apidog, genera videos impresionantes. Aplique estas técnicas para innovar en la creación de contenido impulsada por IA.