Los desarrolladores buscan constantemente herramientas que agilicen los flujos de trabajo complejos, y Devstral 2 de Mistral AI emerge como un cambio de juego en este espacio. Esta familia de modelos de codificación de código abierto, que comprende Devstral 2 y Devstral Small 2, sobresale en tareas como la exploración de bases de código, la corrección de errores y las ediciones de varios archivos. ¿Qué lo distingue? Su integración con la API de Mistral permite un acceso sin problemas a la generación de código de alto rendimiento directamente en sus aplicaciones. Además, al combinarlo con la herramienta Vibe CLI, se habilita una automatización basada en terminal que se siente intuitiva pero potente.

Comprendiendo Devstral 2: Un desglose técnico de la familia de modelos

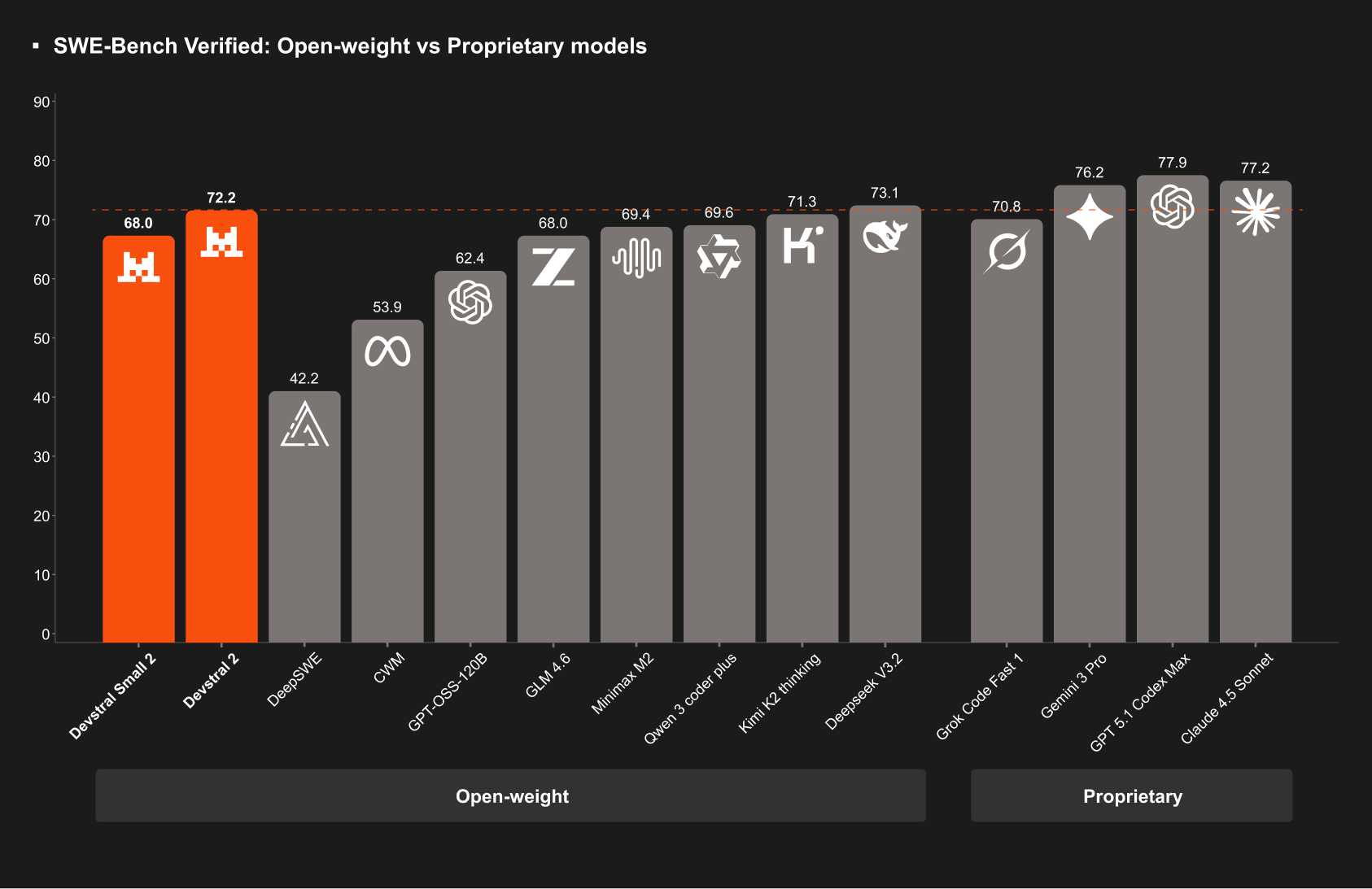

Los ingenieros de Mistral AI diseñaron Devstral 2 para abordar directamente los desafíos del mundo real de la ingeniería de software. En su núcleo, Devstral 2, un transformador denso de 123B parámetros, procesa código con precisión, logrando un 72.2% en el benchmark SWE-bench Verified. Esta puntuación refleja su capacidad para resolver problemas de GitHub de forma autónoma, superando a modelos como DeepSeek V3.2 con una tasa de victoria del 42.8% en evaluaciones humanas. En consecuencia, los equipos lo adoptan para tareas de grado de producción sin la sobrecarga de competidores más grandes.

Mientras tanto, Devstral Small 2, con 24B parámetros, se dirige a entornos con recursos limitados. Obtiene un 68.0% en SWE-bench e introduce soporte multimodal, aceptando entradas de imagen para tareas como la generación de código basada en capturas de pantalla. Ambos modelos operan bajo licencias permisivas: Devstral 2 a través de una MIT modificada, y Devstral Small 2 bajo Apache 2.0. Esta apertura fomenta las contribuciones de la comunidad y el ajuste fino personalizado.

Técnicamente, estos modelos aprovechan una ventana de contexto de 256K tokens, lo que les permite ingerir repositorios completos para un análisis holístico. Por ejemplo, Devstral 2 rastrea las dependencias de los frameworks entre archivos, detecta fallos y sugiere reintentos, características que reducen la depuración manual hasta en un 50% en los benchmarks. Además, su arquitectura optimiza la eficiencia de costos; los desarrolladores reportan ahorros de 7x sobre Claude Sonnet para resultados equivalentes.

Considere las implicaciones para el uso empresarial. Devstral 2 maneja el razonamiento a nivel de arquitectura, modernizando sistemas heredados refactorizando código monolítico en microservicios. En contraste, Devstral Small 2 se ejecuta en configuraciones de una sola GPU, lo que lo hace ideal para despliegues en el borde. Como resultado, las organizaciones escalan la codificación asistida por IA sin grandes reformas de infraestructura.

Para cuantificar el rendimiento, examine métricas clave:

| Modelo | Parámetros | Puntuación SWE-bench | Ventana de Contexto | Soporte Multimodal | Licencia |

|---|---|---|---|---|---|

| Devstral 2 | 123B | 72.2% | 256K | No | Modified MIT |

| Devstral Small 2 | 24B | 68.0% | 256K | Sí | Apache 2.0 |

Estas especificaciones posicionan a Devstral 2 como una columna vertebral versátil para agentes de código. A continuación, pasamos a Vibe CLI, que lleva esta potencia a su línea de comandos.

Explorando Vibe CLI: Interfaz de línea de comandos para la automatización de Devstral 2

Vibe CLI se erige como el compañero de código abierto de Mistral AI para Devstral 2, transformando las indicaciones en lenguaje natural en cambios de código ejecutables. Los desarrolladores lo instalan mediante un simple comando curl: curl -LsSf https://mistral.ai/vibe/install.sh | bash. Una vez configurado, lanza una interfaz de chat interactiva en el terminal, completa con autocompletado e historial persistente.

¿Qué hace que Vibe CLI sea efectivo? Incorpora un contexto consciente del proyecto, escaneando directorios para referenciar archivos con la notación `@`. Por ejemplo, escriba `@main.py` para incluir un script para análisis. Además, ejecute comandos de shell usando `!`, como `!git status`, para integrar el control de versiones sin problemas. Los comandos de barra (`/`) mejoran aún más la usabilidad: `/config` ajusta la configuración, mientras que `/theme` personaliza la interfaz.

Bajo el capó, Vibe CLI se adhiere al Protocolo de Comunicación de Agentes, permitiendo extensiones de IDE como el plugin de Zed. Conéctelo a través de un archivo `config.toml`, donde especificará los proveedores de modelos (por ejemplo, instancias locales de Devstral o claves API de Mistral), los permisos de herramientas y las reglas de autoaprobación para las ejecuciones. Esta flexibilidad previene el exceso; para proyectos sensibles, desactive la escritura de archivos por defecto.

En la práctica, Vibe CLI brilla en flujos de trabajo iterativos. Suponga que mantiene una aplicación web Python. Indíquele: "Refactorizar el módulo de autenticación en @auth.py para usar JWT en lugar de sesiones". Vibe CLI explora dependencias, genera diferencias y aplica cambios a través de `!git apply`. Si surgen conflictos, los detecta y propone alternativas, reflejando los mecanismos de reintento de Devstral 2.

Los benchmarks muestran que Vibe CLI completa tareas de principio a fin 3 veces más rápido que la edición manual en escenarios de múltiples archivos. Además, su modo de scripting soporta scripts de automatización, como el procesamiento por lotes de revisiones de PR. Para ejecuciones locales, combínelo con Devstral Small 2 en hardware de consumo; los tiempos de inferencia se reducen a segundos por respuesta.

Sin embargo, la verdadera fortaleza de Vibe CLI reside en su sinergia con la API. Actúa como proxy para las solicitudes a la API de Mistral, almacenando en caché las respuestas para mayor eficiencia. A medida que avancemos, este puente se volverá crucial para las integraciones personalizadas.

Accediendo a la API de Devstral 2: Guía de implementación paso a paso

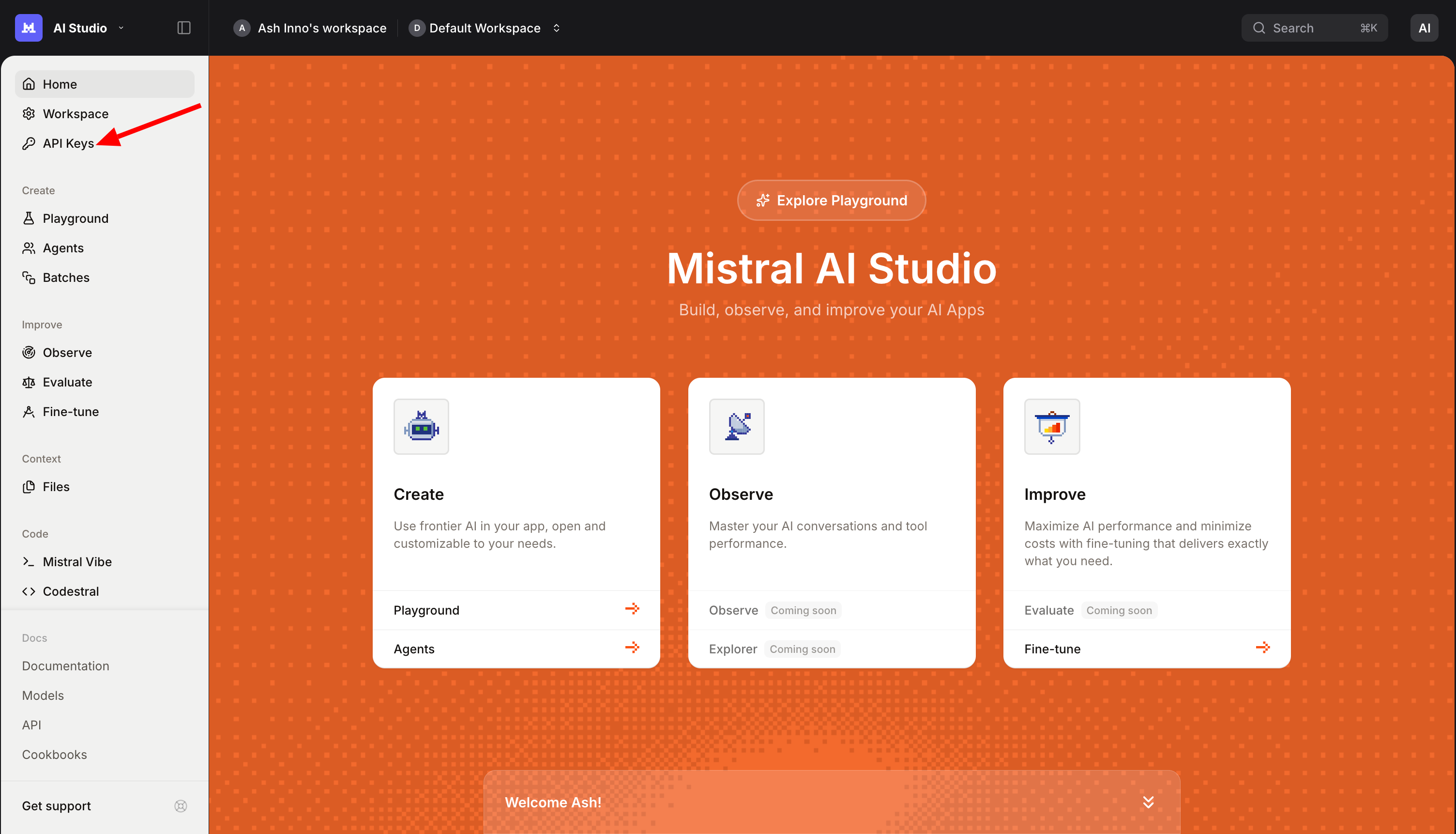

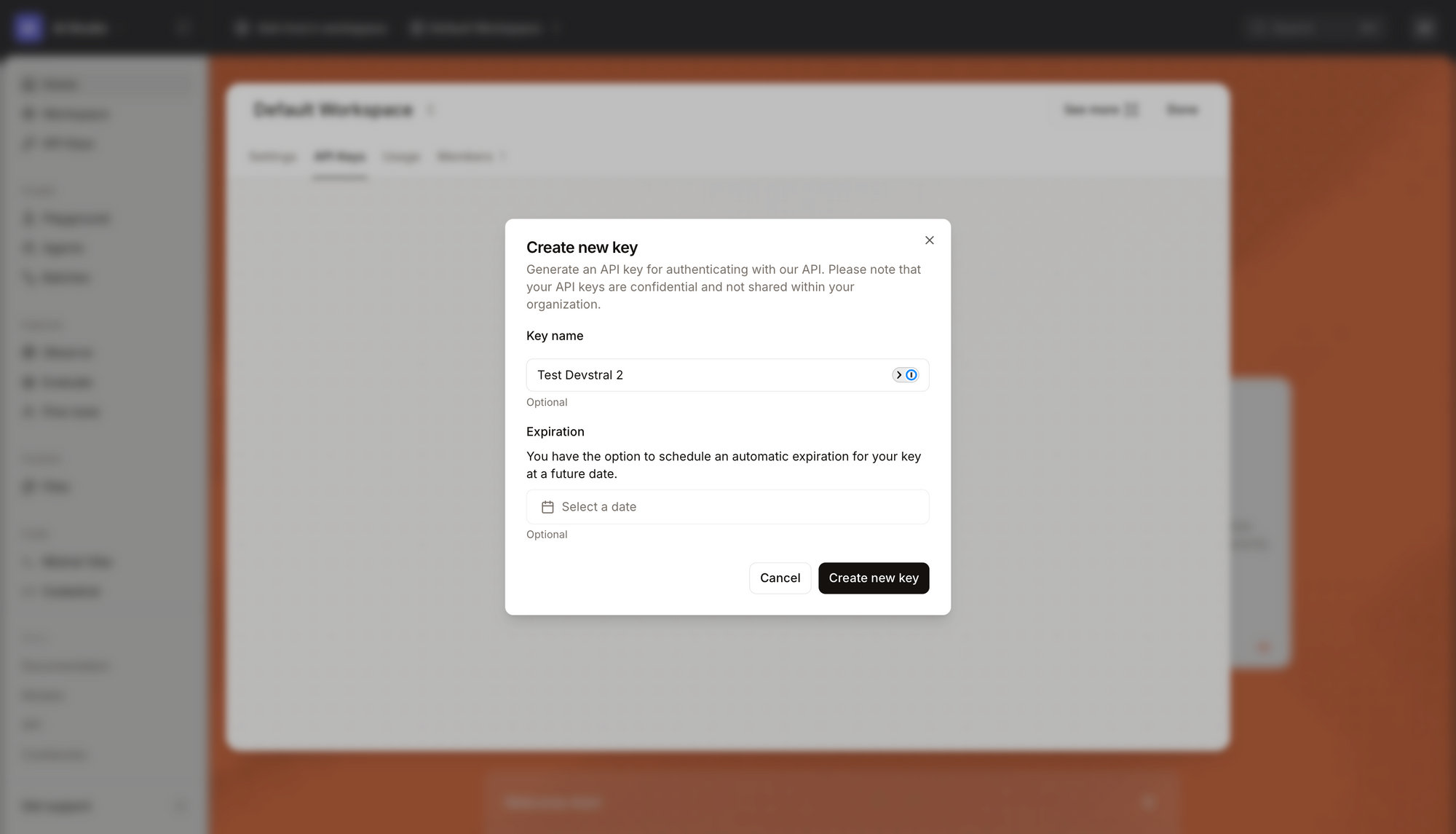

El acceso a la API de Devstral 2 requiere una cuenta de Mistral AI, disponible en la consola. El registro otorga acceso gratuito inmediato durante el período introductorio, pasando luego a un modelo de pago por uso: $0.40 de entrada / $2.00 de salida por millón de tokens para Devstral 2, y $0.10 / $0.30 para Devstral Small 2. La autenticación utiliza claves API, generadas en el panel de la consola.

Comience obteniendo su clave. Navegue a la sección de API, cree una nueva clave y guárdela de forma segura.

La API sigue las convenciones RESTful sobre HTTPS, con puntos finales alojados en https://api.mistral.ai/v1. Las operaciones principales incluyen completado de chat, ajuste fino y embeddings, pero para la codificación, céntrese en /v1/chat/completions.

Elabore solicitudes en formato JSON. Un ejemplo básico de curl para Devstral 2:

curl https://api.mistral.ai/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $MISTRAL_API_KEY" \

-d '{

"model": "devstral-2",

"messages": [{"role": "user", "content": "Write a Python function to parse JSON configs."}],

"max_tokens": 512,

"temperature": 0.1

}'

Esta llamada devuelve el código generado en el campo choices[0].message.content. Ajuste temperature para la creatividad (0.0 para salidas deterministas) y max_tokens para la longitud de la respuesta. Para tareas de base de código, incluya el contexto en la solicitud: anteponga el contenido de los archivos o use mensajes del sistema para las instrucciones.

El uso avanzado implica el streaming de respuestas con "stream": true, ideal para plugins de IDE en tiempo real. La API soporta hasta 256K tokens, así que procese grandes entradas por lotes. La gestión de errores es importante; los códigos comunes incluyen 401 (no autorizado) y 429 (límites de tasa). Implemente reintentos con retroceso exponencial:

import requests

import time

import os

def call_devstral(prompt, model="devstral-2"):

url = "https://api.mistral.ai/v1/chat/completions"

headers = {

"Authorization": f"Bearer {os.getenv('MISTRAL_API_KEY')}",

"Content-Type": "application/json"

}

data = {

"model": model,

"messages": [{"role": "user", "content": prompt}],

"max_tokens": 1024,

"temperature": 0.2

}

while True:

response = requests.post(url, json=data, headers=headers)

if response.status_code == 429:

time.sleep(2 ** attempt) # Exponential backoff

attempt += 1

elif response.status_code == 200:

return response.json()["choices"][0]["message"]["content"]

else:

raise Exception(f"API error: {response.status_code}")

# Example usage

code = call_devstral("Optimize this SQL query: SELECT * FROM users WHERE age > 30;")

print(code)

Este fragmento de Python demuestra llamadas resilientes. Para el soporte multimodal con Devstral Small 2, suba imágenes mediante codificación base64 en el array de contenido.

Los límites de tarifa varían según el nivel; monitorice el uso a través de la consola. Los puntos finales de ajuste fino (/v1/fine_tuning/jobs) permiten la personalización en conjuntos de datos propietarios, requiriendo archivos JSONL con pares de solicitud-completado.

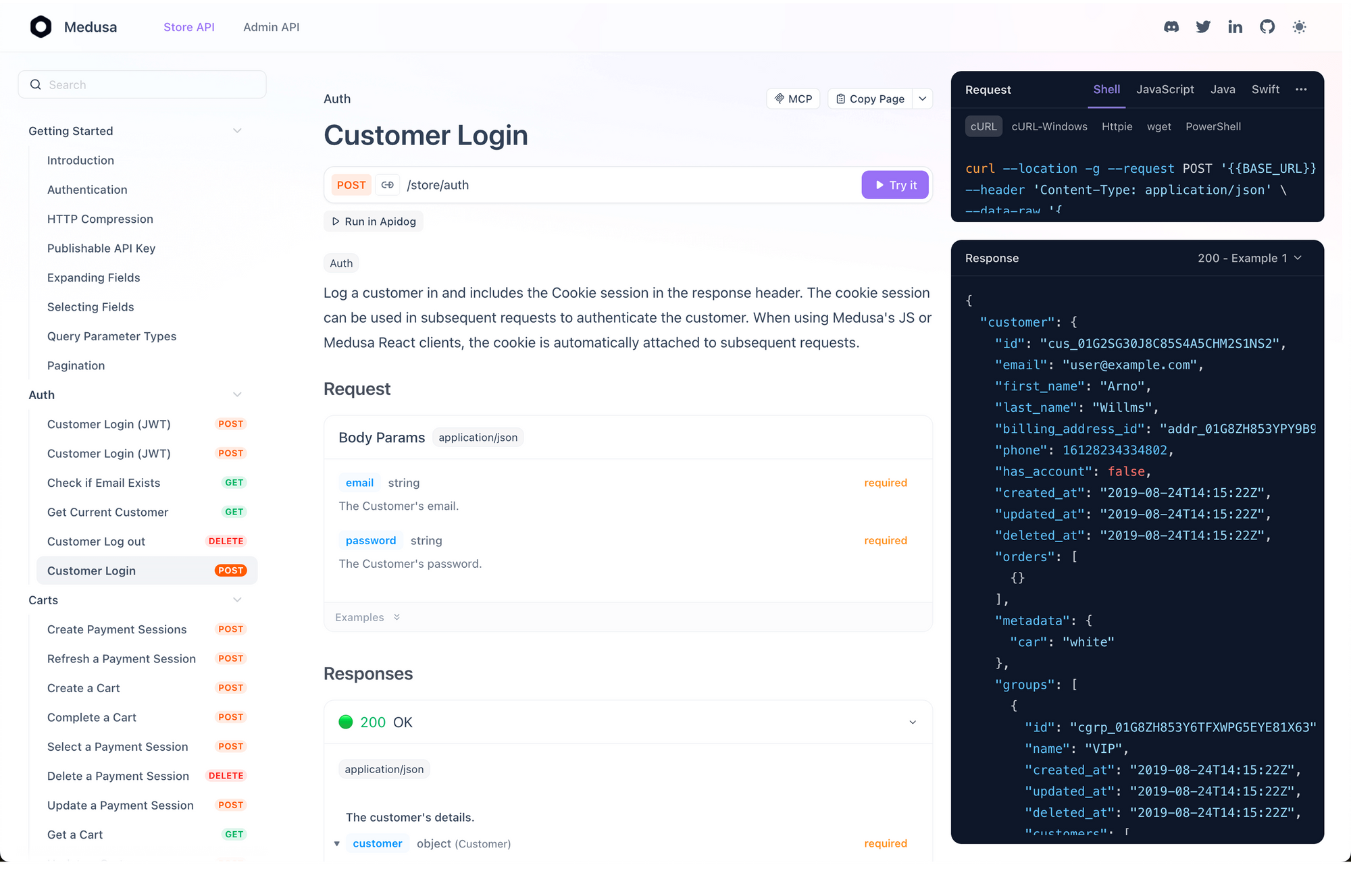

Pasando a las pruebas, Apidog simplifica la validación. Importe la especificación OpenAPI de Mistral en Apidog, simule entornos y ejecute colecciones para simular flujos de trabajo. Este enfoque detecta los casos extremos a tiempo.

Integrando la API de Devstral 2 con Apidog: Mejores prácticas para el desarrollo impulsado por API

Apidog eleva el uso de la API de Devstral 2 al proporcionar una plataforma unificada para el diseño, las pruebas y la documentación. Comience descargando Apidog —gratuito para individuos— y creando un nuevo proyecto. Pegue el esquema de la API de Mistral (disponible en la consola) para autogenerar los puntos finales.

¿Por qué Apidog? Soporta OpenAPI 3.0, alineándose con la especificación de Mistral, y ofrece constructores de solicitudes visuales. Pruebe una finalización de chat: Establezca el método en POST, añada su token Bearer e introduzca cargas JSON. El visor de respuestas de Apidog analiza JSON, destacando las salidas de código para una revisión rápida.

Para la automatización, aproveche los scripts de Apidog. Los scripts de pre-solicitud obtienen contextos dinámicos, como las diferencias de Git recientes, antes de llamar a la API. Los scripts de post-respuesta analizan las generaciones y activan los comandos de Vibe CLI. Ejemplo de script en JavaScript:

// Pre-solicitud: Obtener contexto del repositorio

pm.sendRequest({

url: 'https://api.github.com/repos/user/repo/contents/',

method: 'GET',

header: {

'Authorization': 'token {{github_token}}'

}

}, (err, res) => {

if (!err) {

pm.variables.set('context', res.json().map(f => f.name).join('\n'));

}

});

// La solicitud principal utiliza {{context}} en la indicación

Esta integración asegura que las indicaciones se mantengan relevantes. Además, las funciones de colaboración de Apidog permiten a los equipos compartir colecciones, estandarizando el uso de Devstral 2.

Casos de uso avanzados: Aprovechando Devstral 2 y Vibe CLI en producción

Más allá de lo básico, la API de Devstral 2 potencia agentes sofisticados. Combínela con Vibe CLI para flujos de trabajo híbridos: use CLI para prototipos locales, luego despliegue puntos finales de API en pipelines de CI/CD. Por ejemplo, intégrelo con GitHub Actions:

name: Revisión de Código

on: [pull_request]

jobs:

review:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v3

- name: Ejecutar Revisión de Devstral

run: |

curl -X POST https://api.mistral.ai/v1/chat/completions \

-H "Authorization: Bearer ${{ secrets.MISTRAL_API_KEY }}" \

-d '{

"model": "devstral-2",

"messages": [{"role": "user", "content": "Review changes in ${{ github.event.pull_request.diff_url }}"}]

}' | jq '.choices[0].message.content' > review.md

- name: Comentar PR

uses: actions/github-script@v6

with:

script: |

github.rest.pulls.createReview({

owner: context.repo.owner,

repo: context.repo.repo,

pull_number: context.payload.pull_request.number,

body: fs.readFileSync('review.md', 'utf8')

})

Este YAML automatiza las revisiones, extrayendo diferencias y generando retroalimentación. Vibe CLI complementa al manejar fusiones locales: vibe "Aplicar cambios sugeridos de review.md".

En escenarios multimodales, la API de Devstral Small 2 procesa capturas de pantalla de la interfaz de usuario. Ingrese imágenes base64: {"type": "image_url", "image_url": {"url": "data:image/png;base64,iVBOR..."}}. Las aplicaciones incluyen auditorías de accesibilidad, donde el modelo sugiere mejoras en el texto alternativo.

Para escala empresarial, ajuste fino con datos específicos del dominio. Suba conjuntos de datos a /v1/fine_tuning/jobs, especificando épocas y tasas de aprendizaje. Después del entrenamiento, la API sirve modelos personalizados en puntos finales dedicados, reduciendo la latencia en un 30%.

La computación en el borde se beneficia del tiempo de ejecución en el dispositivo de Devstral Small 2. Despliegue a través de ONNX, integrando alternativas de API para el tráfico de desbordamiento. Herramientas como Kilo Code o Cline extienden esto, incrustando la lógica de Vibe CLI en VS Code.

Las métricas de los adoptantes muestran ganancias de productividad de 5x: una startup refactorizó un monolito de 100K líneas en semanas, atribuyendo el mérito al seguimiento de dependencias de Devstral 2.

Conclusión: Transforme su codificación con la API de Devstral 2 hoy mismo

Devstral 2 redefine el desarrollo asistido por IA a través de su robusta familia de modelos, el intuitivo Vibe CLI y una API accesible. Los desarrolladores los aprovechan para todo, desde soluciones rápidas hasta refactorizaciones completas, respaldados por impresionantes benchmarks y ahorros de costos.

Implemente las estrategias descritas: comience con las instalaciones de Vibe CLI, asegure las claves API y pruebe a través de Apidog. Pequeñas optimizaciones, como indicaciones precisas o contextos en caché, generan aumentos sustanciales de eficiencia. A medida que la IA evoluciona, Devstral 2 lo posiciona a la vanguardia.

¿Listo para experimentar? Diríjase a la consola de Mistral, ponga en marcha Vibe CLI y descargue Apidog de forma gratuita. Su próximo gran avance le espera.