Desarrolladores de todo el mundo confían en CodeX, el potente asistente de codificación impulsado por IA de OpenAI, para optimizar sus flujos de trabajo y abordar tareas de programación complejas. Sin embargo, discusiones recientes en plataformas como X revelan una preocupación creciente: muchos usuarios perciben que CodeX ofrece resultados subóptimos en comparación con su rendimiento inicial. Te encuentras con errores frustrantes, respuestas más lentas o sugerencias de código incompletas, y te preguntas si la herramienta realmente ha disminuido su calidad. Esta percepción persiste a pesar de las afirmaciones de OpenAI de mejoras continuas y de métricas que muestran un crecimiento en el uso.

Los ingenieros informan de casos en los que CodeX tiene dificultades con tareas intrincadas, como aplicar parches o manejar conversaciones extendidas, lo que lleva a suposiciones de degradación. Sin embargo, el equipo de OpenAI aborda activamente estos problemas mediante investigaciones rigurosas, demostrando un compromiso con la transparencia. Por ejemplo, recientemente publicaron un informe detallado que describe los hallazgos de los comentarios de los usuarios y las evaluaciones internas.

Entendiendo CodeX: Su Funcionalidad Principal y Evolución

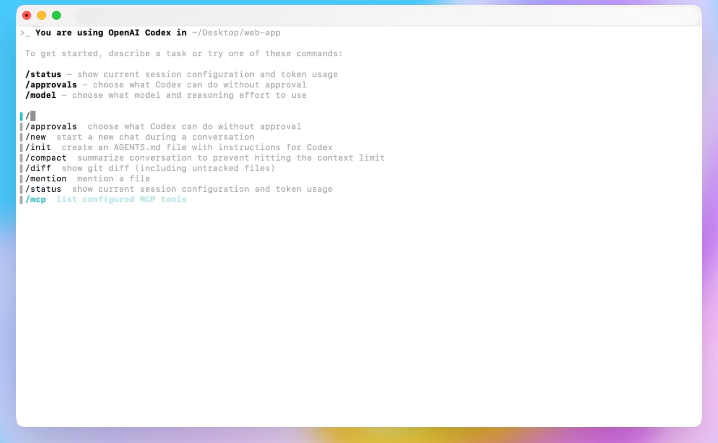

CodeX representa un avance significativo en la programación asistida por IA, basándose en la fundación de OpenAI en modelos de lenguaje grandes. Los ingenieros diseñan CodeX para interpretar instrucciones en lenguaje natural y generar fragmentos de código, depurar problemas e incluso gestionar repositorios completos. A diferencia de los plugins IDE tradicionales, CodeX se integra profundamente con interfaces de línea de comandos y editores, permitiendo interacciones fluidas.

OpenAI lanzó CodeX como una evolución de modelos anteriores como Codex, incorporando mejoras de la arquitectura GPT-5. Esta iteración se centra en la persistencia, permitiendo a la IA reintentar tareas y adaptarse a los comentarios del usuario dentro de las sesiones. En consecuencia, los desarrolladores utilizan CodeX para diversas aplicaciones, desde la escritura de scripts simples hasta integraciones de sistemas complejas.

Sin embargo, a medida que crece la adopción, los usuarios empujan los límites de CodeX. Por ejemplo, las tareas iniciales pueden implicar funciones básicas, pero los usuarios avanzados intentan ediciones de múltiples archivos u orquestaciones de API. Este cambio revela limitaciones, lo que plantea preguntas sobre la consistencia del rendimiento.

Además, CodeX emplea herramientas como `apply_patch` para modificaciones de archivos y `compaction` para la gestión del contexto. Estas características mejoran la usabilidad pero introducen variables que afectan los resultados. Cuando introduces una instrucción, CodeX la procesa a través de una API de respuestas, que transmite tokens y analiza los resultados. Cualquier discrepancia en este proceso puede manifestarse como una percepción de simplificación o empeoramiento.

Informes de Usuarios: Señales de que CodeX Podría Estar Rindiendo por Debajo de lo Esperado

Los usuarios comparten activamente experiencias en plataformas sociales, destacando casos en los que CodeX no cumple con las expectativas. Por ejemplo, un desarrollador en X señaló que CodeX sobresale en tareas iniciales pero tiene dificultades con la complejidad creciente, lo que lleva a suposiciones de degradación del modelo.

Específicamente, los informes incluyen que CodeX genera diferencias incorrectas durante la aplicación de parches, lo que resulta en eliminaciones y recreaciones de archivos. Este comportamiento interrumpe los flujos de trabajo, especialmente en sesiones interrumpidas. Otra queja común se refiere a la latencia; las tareas que antes se completaban rápidamente ahora se extienden debido a reintentos con tiempos de espera prolongados.

Además, los usuarios observan cambios de idioma a mitad de la respuesta, como pasar del inglés al coreano, atribuidos a errores en el muestreo restringido. Estas anomalías afectan a menos del 0.25% de las sesiones, pero amplifican la frustración cuando se encuentran.

Además, la compactación —una característica que resume las conversaciones para gestionar el contexto— recibe críticas. A medida que las sesiones se alargan, múltiples compactaciones degradan la precisión, lo que lleva a OpenAI a añadir advertencias: iniciar nuevas conversaciones para interacciones específicas.

Además, las variaciones de hardware contribuyen; las configuraciones más antiguas producen ligeras caídas de rendimiento, lo que afecta la retención. Los desarrolladores con planes premium informan inconsistencias, aunque las métricas muestran un crecimiento general.

Pasando de estos informes, el análisis de la evidencia cuantitativa proporciona claridad sobre si estos problemas indican una verdadera degradación o una evolución en el uso.

Analizando la Evidencia: Métricas, Comentarios y Patrones de Uso

OpenAI recopila datos extensos sobre el rendimiento de CodeX, incluyendo evaluaciones en todas las versiones de CLI y hardware. Las evaluaciones confirman mejoras, como una reducción del 10% en el uso de tokens después de las actualizaciones de CLI 0.45, sin regresiones en las tareas principales.

Sin embargo, los comentarios de los usuarios a través del comando `/feedback` revelan tendencias. Los ingenieros clasifican más de 100 problemas diariamente, vinculándolos a hardware o características específicas. Los modelos predictivos correlacionan la retención con factores como el sistema operativo y el tipo de plan, identificando el hardware como un culpable menor.

Además, el análisis de sesiones muestra un aumento en el uso de la compactación con el tiempo, correlacionándose con caídas de rendimiento. Las evaluaciones cuantifican esto: la precisión disminuye con compactaciones repetidas.

Además, la integración de búsqueda web (`--search`) y los cambios de instrucciones durante dos meses no muestran un impacto negativo. Sin embargo, las ineficiencias de la caché de autenticación añaden 50 ms de latencia por solicitud, lo que agrava las percepciones de los usuarios.

Además, el uso evoluciona; más desarrolladores emplean herramientas MCP, aumentando la complejidad de la configuración. OpenAI recomienda configuraciones minimalistas para obtener resultados óptimos.

En consecuencia, la evidencia sugiere que las percepciones provienen de exigir a CodeX tareas más difíciles en lugar de una simplificación inherente. Como resumió un usuario de X: "CodeX es tan bueno que la gente siguió intentando usarlo para tareas más difíciles y no las hizo tan bien, y entonces la gente simplemente asumió que el modelo empeoró".

Este análisis sienta las bases para la respuesta investigativa de OpenAI, que aborda estos puntos directamente.

Respuesta de OpenAI: La Investigación Transparente sobre el Rendimiento de CodeX

OpenAI se compromete con la transparencia, prometiendo investigar seriamente los informes de degradación. Tibo, miembro del equipo de Codex, anunció la investigación en X, delineando un plan para mejorar los mecanismos de retroalimentación, estandarizar el uso interno y realizar evaluaciones adicionales.

Los ingenieros actuaron rápidamente, lanzando CLI 0.50 con `/feedback` mejorado, vinculando los problemas a clústeres y hardware. Eliminaron más de 60 'feature flags', simplificando la pila.

Además, un equipo dedicado formuló hipótesis y probó problemas diariamente. Este enfoque descubrió soluciones, desde la retirada de hardware antiguo hasta el refinamiento de la compactación.

Además, OpenAI compartió un informe completo titulado "Fantasmas en la Máquina Codex", detallando los hallazgos sin regresiones importantes pero reconociendo factores combinados.

Además, restablecieron los límites de tasa y reembolsaron créditos debido a un error de facturación, demostrando acciones centradas en el usuario.

Pasando a los detalles, los hallazgos clave del informe iluminan los matices técnicos detrás de las preocupaciones de los usuarios.

Hallazgos Clave del Informe de Degradación de CodeX de OpenAI

El informe concluye que no existe un único problema grande; en cambio, se acumulan cambios de comportamiento y problemas menores. Para el hardware, las evaluaciones y los modelos señalaron unidades más antiguas, lo que llevó a su eliminación y a optimizaciones de equilibrio de carga.

Con respecto a la compactación, una mayor frecuencia con el tiempo degrada las sesiones. OpenAI mejoró las implementaciones para evitar resúmenes recursivos y añadió indicaciones para el usuario.

Para `apply_patch`, fallos raros provocan eliminaciones arriesgadas; las mitigaciones limitan tales secuencias, con mejoras del modelo planificadas.

Los tiempos de espera no muestran regresiones amplias —la latencia mejora— pero persisten los reintentos ineficientes. Las inversiones se dirigen a un mejor manejo de procesos largos.

Un error de muestreo restringido causa tokens fuera de distribución, que se corregirá inminentemente.

Las auditorías de la API de respuestas revelan cambios menores de codificación sin impacto en el rendimiento.

Otras investigaciones, como las evaluaciones de versiones de CLI y prompts, confirman la estabilidad.

Además, las configuraciones en evolución con más herramientas recomiendan la simplicidad.

Estos hallazgos validan las experiencias de los usuarios al tiempo que corroboran que no hay una simplificación general.

Mejoras Implementadas y Direcciones Futuras para CodeX

OpenAI actúa sobre los hallazgos, implementando correcciones como advertencias de compactación y correcciones de muestreo. Las purgas de hardware y las reducciones de latencia mejoran la fiabilidad.

Además, forman un equipo permanente para monitorear el rendimiento en el mundo real, reclutando talento para optimizaciones continuas.

Además, la socialización de la retroalimentación aumenta, asegurando una entrada continua.

El trabajo futuro incluye mejoras en la persistencia del modelo y la adaptabilidad de las herramientas.

En consecuencia, CodeX evoluciona, abordando las percepciones a través de mejoras basadas en datos.

Sin embargo, mientras esperan estas, los desarrolladores buscan complementos como Apidog.

Herramientas Complementarias: Cómo Apidog Mejora los Flujos de Trabajo de CodeX

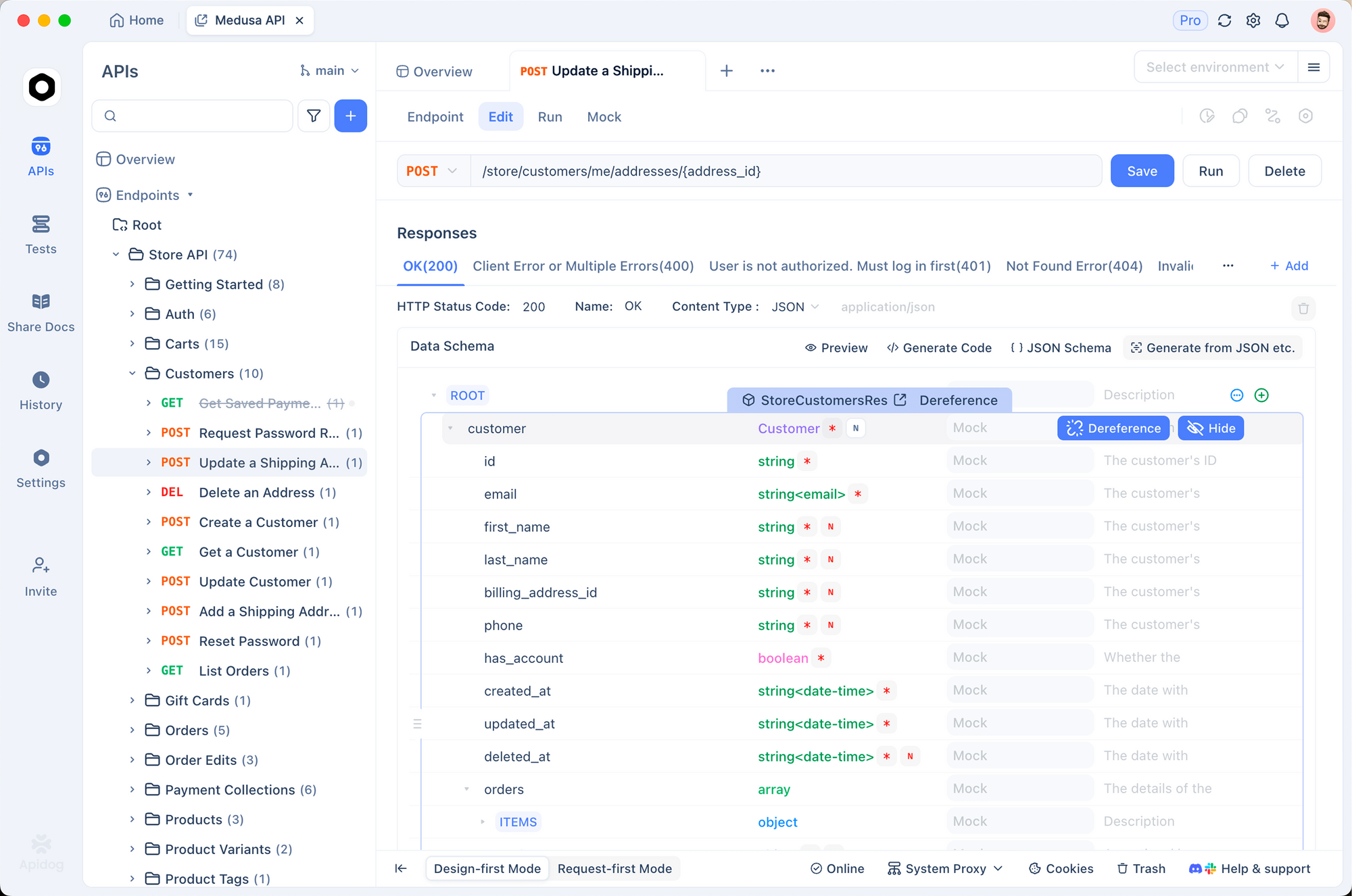

Cuando CodeX maneja tareas de API, surgen inconsistencias, especialmente en las integraciones. Apidog, una plataforma API robusta, llena este vacío.

Los desarrolladores utilizan Apidog para diseñar, probar y documentar APIs, asegurando que el código generado por CodeX funcione correctamente.

Por ejemplo, simula puntos finales en Apidog antes de la implementación de CodeX, reduciendo errores.

Además, la descarga gratuita de Apidog ofrece funciones de colaboración, versionado y automatización, ideal para equipos que enfrentan limitaciones de CodeX.

Transicionando sin problemas, Apidog se integra con entornos de codificación, validando las salidas de la IA.

Así, emparejar CodeX con Apidog optimiza el desarrollo, mitigando las degradaciones percibidas.

Casos de Estudio: Ejemplos del Mundo Real de Discusiones en X

Los hilos de X proporcionan ejemplos vívidos. Un usuario destacó cómo el éxito de CodeX generó una ambición excesiva, haciéndose eco de la evolución del uso del informe.

Otro discutió la velocidad de la CLI, cambiando a alternativas para tareas rápidas, lo que subraya las preocupaciones sobre la latencia.

Además, los restablecimientos de facturación abordaron los cargos excesivos, restaurando la confianza.

Estas anécdotas, combinadas con los datos del informe, ilustran problemas multifacéticos.

Mejores Prácticas para Maximizar el Rendimiento de CodeX

Para contrarrestar las percepciones, adopta prácticas: mantén las sesiones cortas, minimiza las herramientas, usa `/feedback`.

Además, monitorea las actualizaciones; las mejoras de la CLI impactan directamente en los resultados.

Además, experimenta con las instrucciones para mayor precisión.

En consecuencia, estos pasos mejoran las experiencias.

Conclusión: Abrazando el Cambio en CodeX y Más Allá

Los usuarios perciben CodeX como menos inteligente debido a tareas complejas y problemas menores, pero la evidencia muestra evolución, no declive. La investigación y las correcciones de OpenAI afirman su compromiso.

Además, la integración de Apidog garantiza flujos de trabajo resilientes.

En última instancia, adapta estrategias, aprovecha las herramientas y contribuye con comentarios: pequeños ajustes producen ganancias significativas en la productividad.