Los desarrolladores confían cada vez más en modelos avanzados de IA para mejorar la eficiencia de la codificación, automatizar flujos de trabajo complejos y construir aplicaciones inteligentes. Claude Opus 4.5 de Anthropic surge como una solución líder en este espacio, ofreciendo un rendimiento superior en ingeniería de software, tareas agentivas y razonamiento de múltiples pasos. Este modelo establece nuevos puntos de referencia en la codificación y el uso de computadoras en el mundo real, lo que lo hace esencial para los equipos técnicos que abordan proyectos a nivel de producción.

Esta guía le proporciona el conocimiento técnico para aprovechar Claude Opus 4.5 de manera efectiva. Cubrimos la configuración, la mecánica central de la API, configuraciones avanzadas y estrategias de optimización. Al seguir estos pasos, sus aplicaciones se posicionan para aprovechar la ventana de contexto de 200K tokens del modelo, el uso mejorado de herramientas y la gestión eficiente de tokens. En consecuencia, logrará ciclos de desarrollo más rápidos y características impulsadas por IA más confiables.

¿Qué es Claude Opus 4.5?

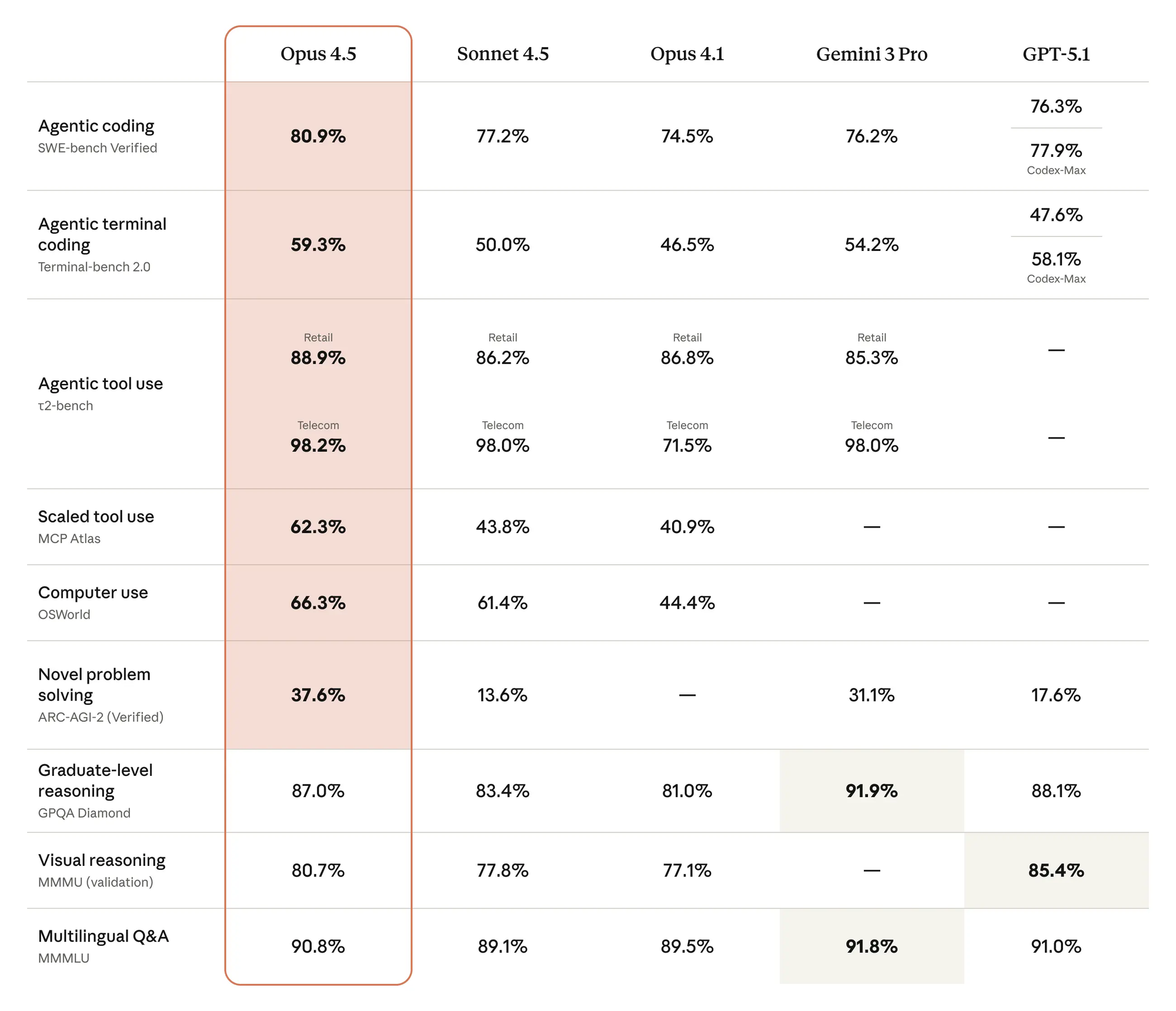

Los ingenieros de Anthropic diseñaron Claude Opus 4.5 como su modelo insignia, priorizando la profundidad en el razonamiento, la precisión en la codificación y la autonomía agentiva. Esta iteración se basa en versiones anteriores al incorporar avances en el procesamiento de la visión, la precisión matemática y la resolución de ambigüedades. Por ejemplo, el modelo sobresale en el manejo de compromisos en escenarios complejos, como la modificación de itinerarios de vuelo en simulaciones empresariales o la depuración de bases de código extensas sin orientación explícita.

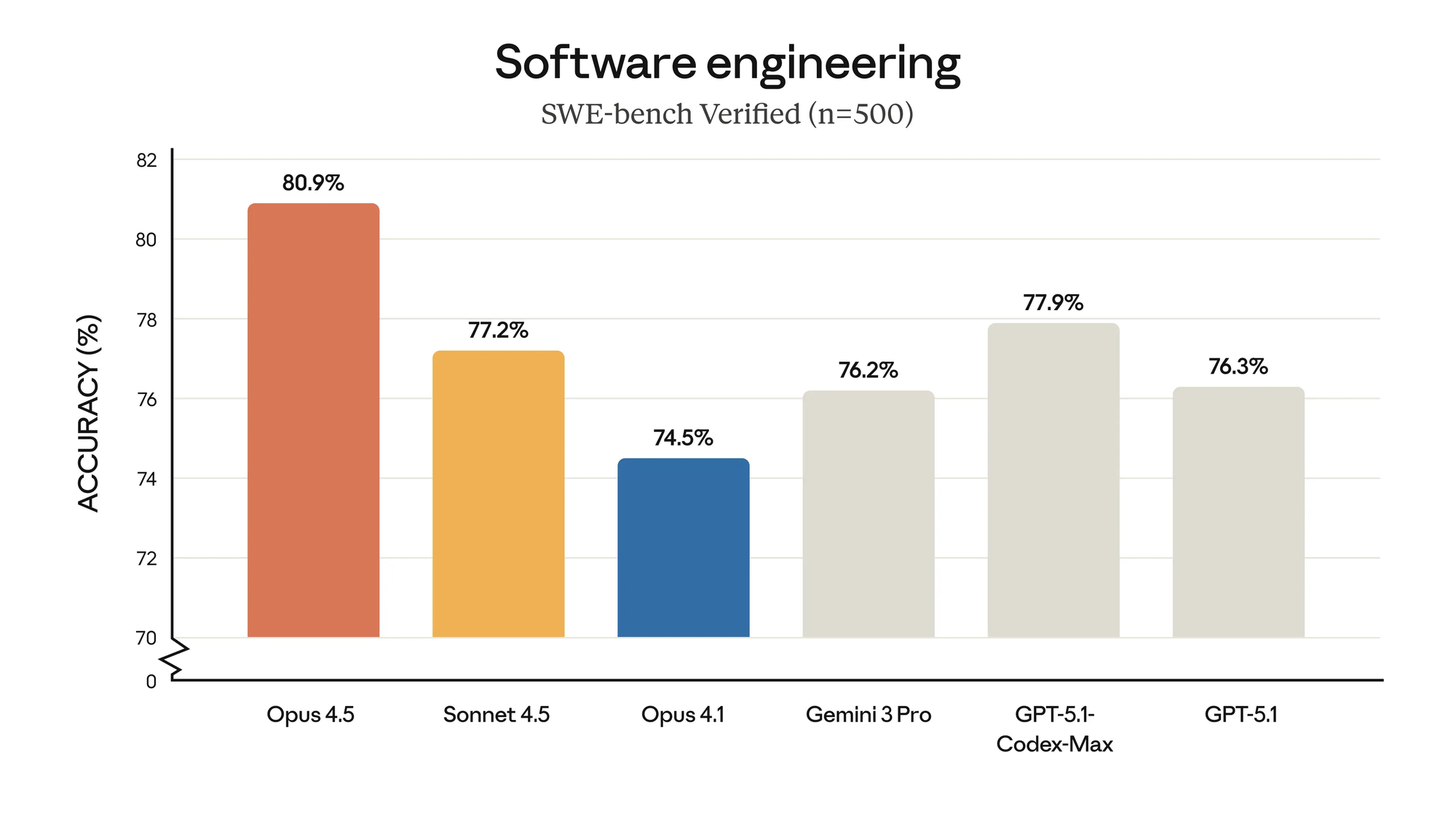

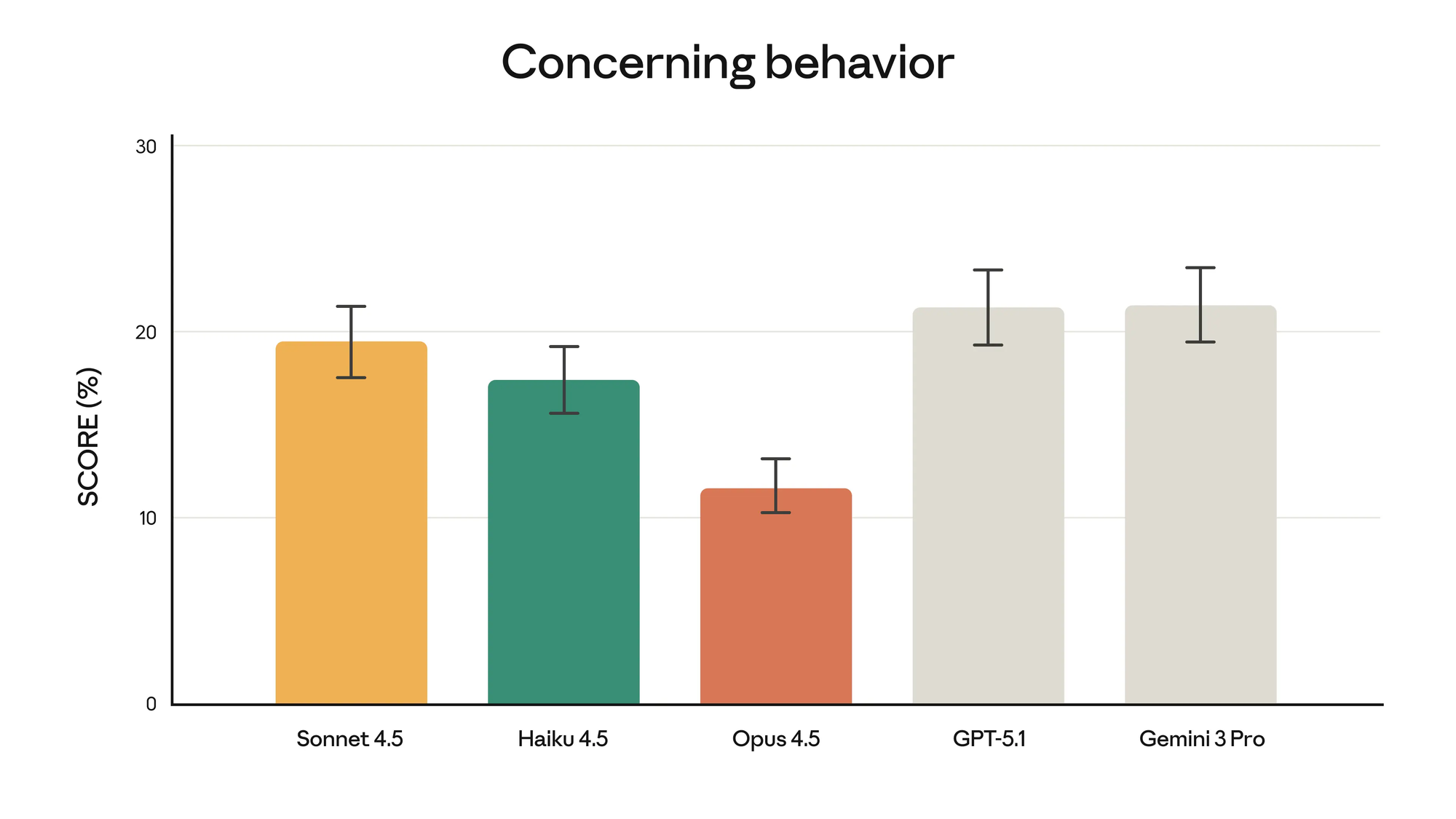

Entre sus capacidades clave se incluyen resultados de vanguardia en SWE-bench Verified, donde supera a sus predecesores hasta en 4.3 puntos porcentuales, mientras utiliza un 48% menos de tokens de salida con el máximo esfuerzo.

Los desarrolladores acceden a estas fortalezas a través de la API de Claude, que soporta una ventana de contexto de 200K tokens, ideal para análisis de formato largo o revisiones de código de múltiples archivos. Además, el modelo se integra perfectamente con plataformas en la nube como Amazon Bedrock, Google Vertex AI y Microsoft Foundry, permitiendo despliegues escalables.

El precio refleja su posicionamiento premium: 5 dólares por millón de tokens de entrada y 25 dólares por millón de tokens de salida, con ahorros mediante el almacenamiento en caché de prompts (hasta un 90%) y el procesamiento por lotes (50%). Sin embargo, estos costos subrayan la necesidad de patrones de uso precisos, que abordaremos más adelante. En esencia, Claude Opus 4.5 permite a los desarrolladores construir agentes que gestionan proyectos de principio a fin, desde la planificación inicial hasta la ejecución, con una mínima supervisión humana.

Configuración de su entorno de desarrollo

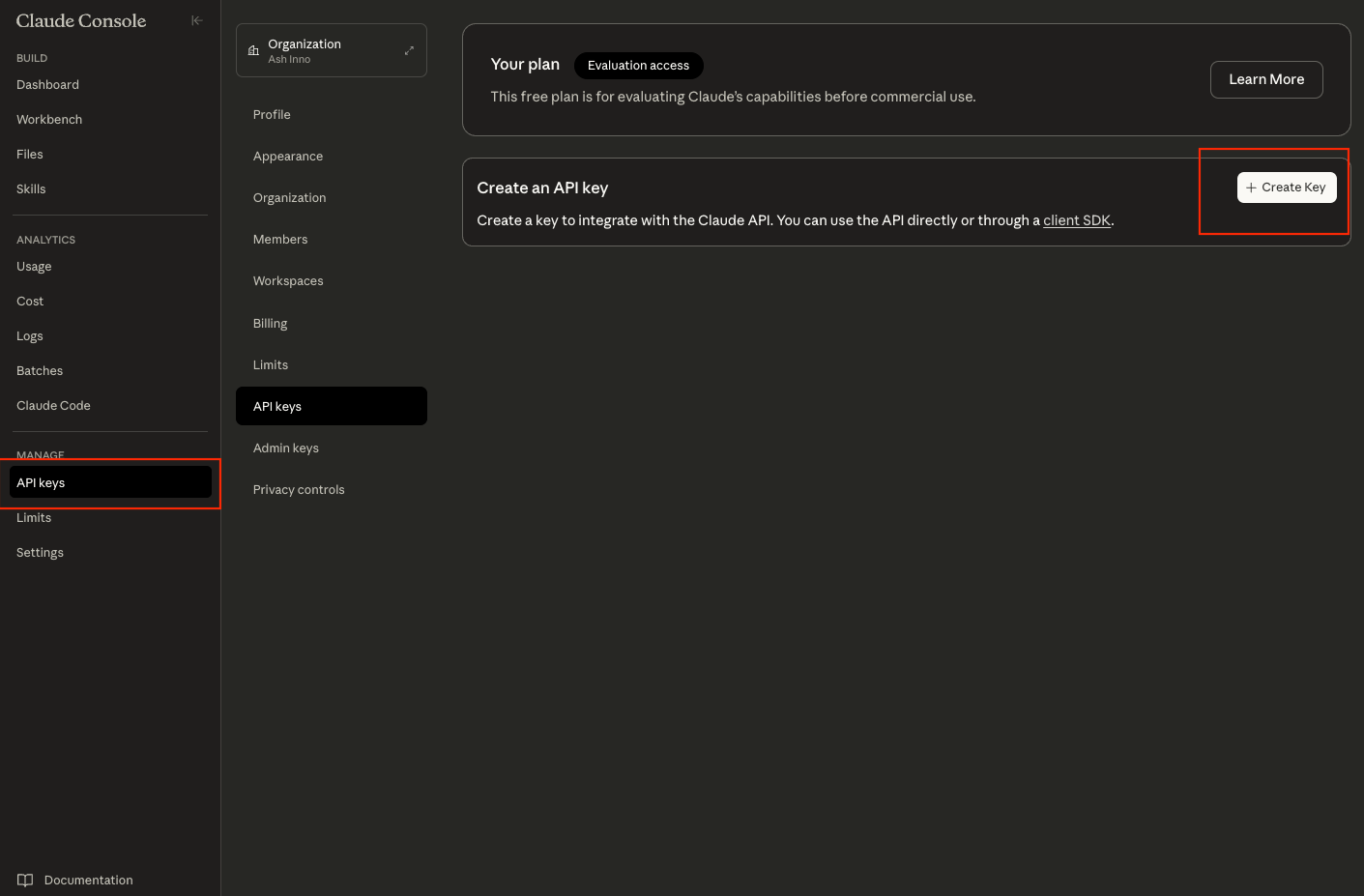

Comience preparando un entorno robusto para interactuar con la API de Claude. Primero, obtenga una clave de API de la Consola de Anthropic en console.anthropic.com. Regístrese o inicie sesión, navegue a la sección "API Keys" y genere una nueva clave. Guárdela de forma segura; use variables de entorno como export ANTHROPIC_API_KEY='su-clave-aquí' en su terminal o archivos .env en la raíz de su proyecto.

A continuación, instale el SDK oficial de Anthropic, que abstrae las complejidades HTTP y maneja los reintentos. Para Python, ejecute pip install anthropic. Esta biblioteca soporta llamadas síncronas y asíncronas, esenciales para aplicaciones de alto rendimiento. De manera similar, los desarrolladores de Node.js ejecutan npm install @anthropic-ai/sdk. Verifique la instalación importando el módulo: en Python, import anthropic; client = anthropic.Anthropic(api_key=os.getenv('ANTHROPIC_API_KEY')).

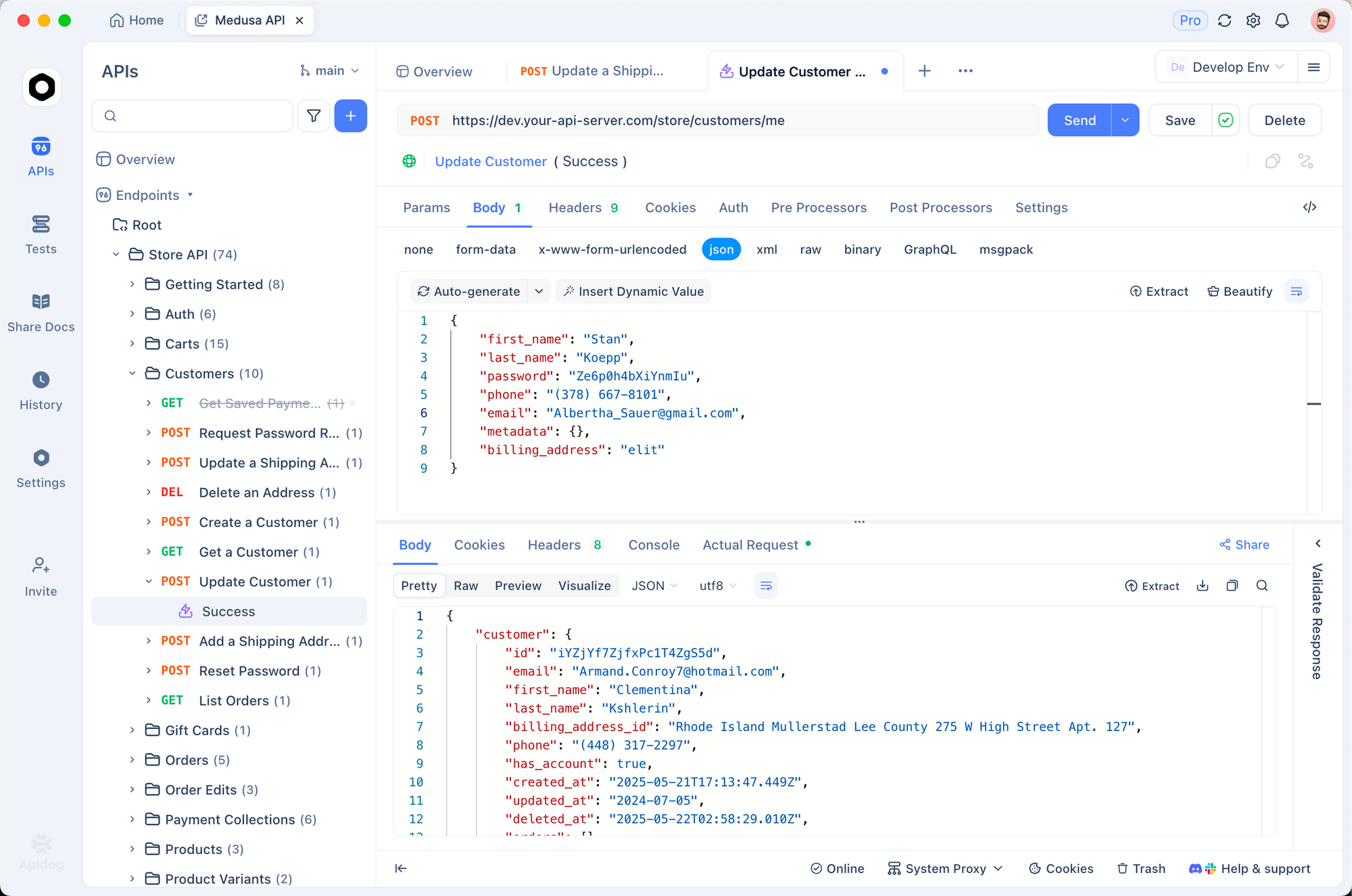

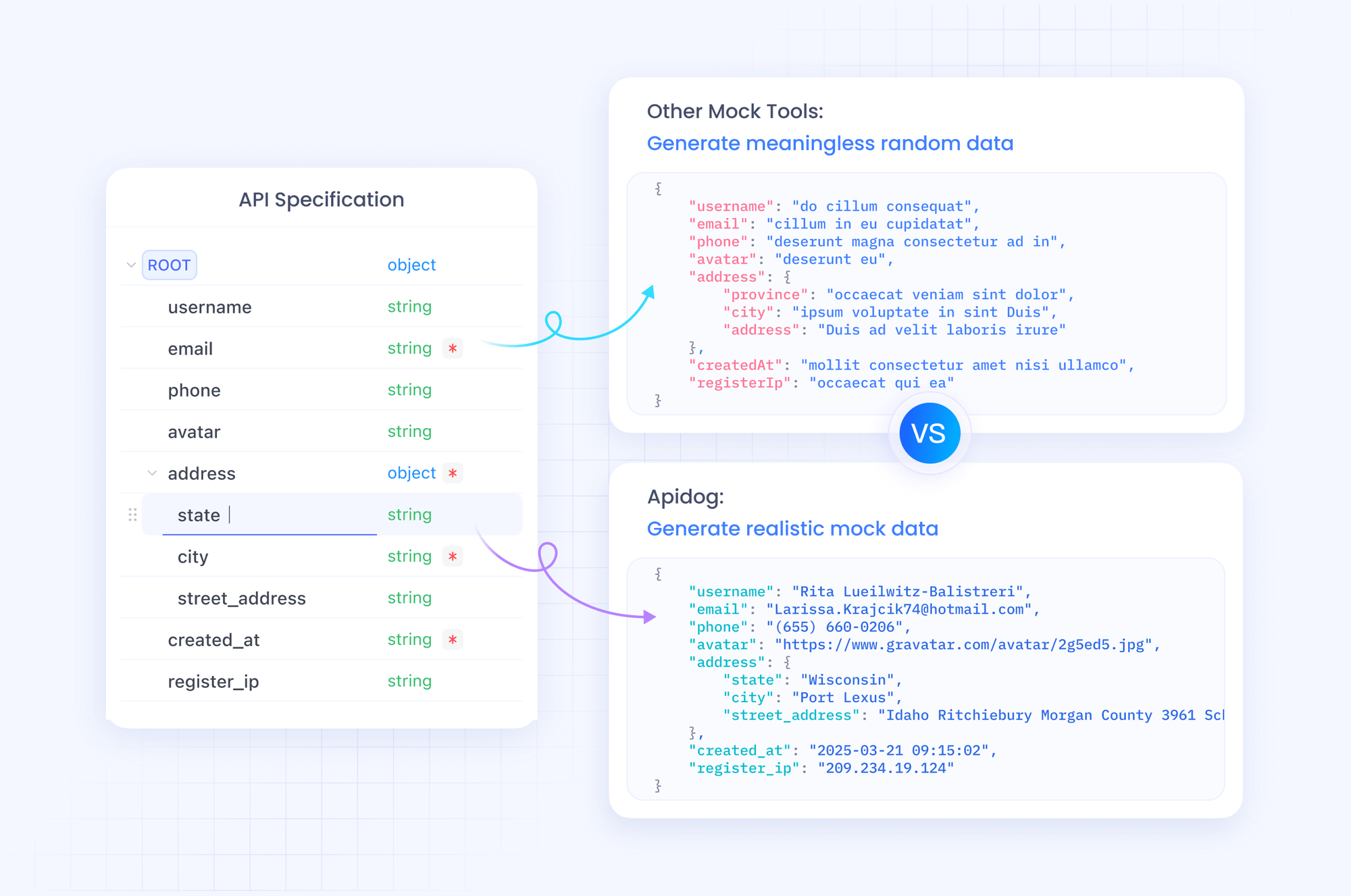

Para las pruebas, integre Apidog temprano. Esta herramienta genera comandos curl y colecciones de Postman a partir de sus experimentos con el SDK, asegurando la consistencia entre equipos. Importe su clave de API en las variables de entorno de Apidog y cree una nueva solicitud al endpoint /v1/messages. Esta preparación evita errores comunes como los de autenticación, permitiéndole centrarse en la ingeniería de prompts.

Una vez configurado, confirme la conectividad con una simple verificación de estado. Envíe una solicitud básica para validar su clave y red. Este paso confirma que su entorno maneja los límites de tasa de la API, inicialmente 50 solicitudes por minuto para los modelos Opus, escalables con los niveles de uso.

Autenticación y conceptos básicos de la API

Anthropic aplica la autenticación mediante tokens Bearer, un mecanismo estándar inspirado en OAuth2. Incluya su clave API en el encabezado Authorization como Bearer ${ANTHROPIC_API_KEY} para cada solicitud. La URL base es https://api.anthropic.com/v1, con el endpoint principal /messages para completar chats.

Las solicitudes siguen una estructura de carga útil JSON. Defina un campo model que especifique claude-opus-4-5-20251101, el identificador exacto para esta versión. Agregue una matriz messages que contenga pares rol-contenido: las indicaciones del sistema establecen pautas de comportamiento, mientras que los mensajes del usuario desencadenan respuestas. Por ejemplo:

{

"model": "claude-opus-4-5-20251101",

"max_tokens": 1024,

"messages": [

{"role": "user", "content": "Explain quantum entanglement in simple terms."}

]

}

El SDK lo simplifica: en Python, client.messages.create(model="claude-opus-4-5-20251101", max_tokens=1024, messages=[{"role": "user", "content": "Su prompt aquí"}]). Las respuestas devuelven una matriz content con deltas de texto para el streaming, o bloques completos para el modo por lotes.

Los límites de tasa se aplican por organización: Opus 4.5 se limita a 10,000 tokens por minuto inicialmente, con ráfagas de hasta 50,000. Supervise a través de encabezados de respuesta como x-ratelimit-remaining. Si se excede, implemente un retroceso exponencial en su código; el SDK lo maneja de forma nativa con retry_on=anthropic.RetryStatus.SERVER_ERROR.

Las mejores prácticas de seguridad incluyen rotar las claves trimestralmente y restringirlas a rangos de IP específicos en la consola. De este modo, mantiene el cumplimiento en entornos empresariales mientras escala las llamadas a la API.

Realizando su primera solicitud a la API

Ejecute su solicitud inaugural para comprender el ritmo de la API. Comience con una consulta sencilla que ponga a prueba la destreza de razonamiento del modelo. En Python:

import anthropic

import os

client = anthropic.Anthropic(api_key=os.getenv("ANTHROPIC_API_KEY"))

response = client.messages.create(

model="claude-opus-4-5-20251101",

max_tokens=500,

messages=[

{"role": "user", "content": "Write a Python function to compute Fibonacci numbers up to n=20."}

]

)

print(response.content[0].text)

Este código invoca al modelo, que genera un código eficiente que aprovecha la memoización, mostrando su aptitud para la codificación. La respuesta llega en menos de 2 segundos con el esfuerzo predeterminado, con tokens de salida alrededor de 150 para resultados concisos.

Para el streaming, añada stream=True a la llamada. Esto produce deltas incrementales, ideales para UIs en tiempo real. Analícelos a través de un bucle generador:

stream = client.messages.stream(

model="claude-opus-4-5-20251101",

max_tokens=500,

messages=[{"role": "user", "content": "Your streaming prompt"}]

)

for text in stream:

print(text.content[0].text, end="", flush=True)

Apidog lo complementa visualizando los flujos en su visor de respuestas, destacando el consumo de tokens. Experimente aquí para refinar los prompts antes de la producción.

Maneje los errores de forma proactiva. Un estado 429 indica limitación; captúrelo con bloques try-except. De manera similar, los 400s señalan JSON malformado; valide las cargas útiles usando el verificador de esquemas de Apidog. A través de estos conceptos básicos, usted construye una base para integraciones más intrincadas.

Características avanzadas: Control de esfuerzo y gestión de contexto

Claude Opus 4.5 introduce el parámetro effort, un cambio de juego para equilibrar velocidad y profundidad. Establézcalo en "low", "medium" o "high" en las solicitudes: "low" prioriza respuestas rápidas (latencia sub-segundo), mientras que "high" asigna un cómputo extendido para salidas matizadas, impulsando benchmarks como SWE-bench en 15 puntos.

Incorpórelo así:

response = client.messages.create(

model="claude-opus-4-5-20251101",

effort="high",

max_tokens=2000,

messages=[{"role": "user", "content": "Analyze tradeoffs in microservices vs. monoliths for a fintech app."}]

)

Con un esfuerzo "alto", el modelo emplea blocs de notas entrelazados y un presupuesto de pensamiento de 64K, produciendo tablas detalladas de pros y contras. Sin embargo, esto aumenta los costos; un esfuerzo "medio" a menudo es suficiente para el 80% de las tareas, igualando la eficiencia de Sonnet 4.5 con un 76% menos de tokens.

La gestión del contexto sigue el mismo patrón. La ventana de 200K acomoda repositorios enteros; use el SDK de compactación del lado del cliente para resumir intercambios previos. Instálelo vía pip install anthropic-compaction, y luego:

from anthropic.compaction import compact_context

compacted = compact_context(previous_messages)

# Append to new messages array

Esta característica brilla en bucles agentivos, donde los agentes mantienen la memoria a través de las sesiones. Para sistemas multi-agente, defina subagentes a través de llamadas a herramientas, permitiendo que Opus 4.5 orqueste equipos, por ejemplo, uno para investigación y otro para validación.

Pasando a las herramientas, Opus 4.5 soporta definiciones avanzadas. Declare esquemas JSON para funciones como consultas a bases de datos:

{

"name": "get_user_data",

"description": "Fetch user profile",

"input_schema": {"type": "object", "properties": {"user_id": {"type": "string"}}}

}

El modelo invoca herramientas de forma autónoma, analizando argumentos e inyectando resultados en seguimientos. Esto permite flujos de trabajo híbridos, como agentes encadenados a API para escaneos de ciberseguridad.

Integración de herramientas y construcción de agentes

El uso de herramientas eleva a Claude Opus 4.5 a alturas agentivas. Defina herramientas en la matriz tools de las solicitudes. El modelo decide la invocación basándose en el contexto, generando llamadas en formato XML para mayor precisión.

Ejemplo: Integrar una herramienta API meteorológica.

tools = [

{

"name": "get_weather",

"description": "Retrieve current weather for a city",

"input_schema": {

"type": "object",

"properties": {"city": {"type": "string"}},

"required": ["city"]

}

}

]

response = client.messages.create(

model="claude-opus-4-5-20251101",

max_tokens=1000,

tools=tools,

messages=[{"role": "user", "content": "Plan a trip to Paris; check weather."}]

)

Si el modelo llama a la herramienta, extráigala de response.stop_reason == "tool_use", ejecútela externamente y añada la salida como mensaje de resultado de la herramienta. Repita el bucle hasta la finalización para una ejecución completa del agente.

Para el uso de computadora, habilite las funciones beta a través de los encabezados. Esto permite la inspección y automatización de la pantalla, con la herramienta Zoom para análisis a nivel de píxel, crucial para la depuración de la interfaz de usuario.

Apidog agiliza la prueba de herramientas: simule endpoints en su simulador y luego exporte a código SDK. Este enfoque iterativo refina la fiabilidad del agente, reduciendo las llamadas alucinatorias.

En configuraciones multiagente, aproveche las herramientas de memoria para la persistencia del estado. Almacene datos clave en una herramienta de memoria, consultada entre subagentes. En consecuencia, los sistemas manejan tareas extensas como auditorías de software, donde un agente planifica y otros ejecutan.

Manejo de errores y mejores prácticas

Las aplicaciones robustas anticipan fallas. Implemente un manejo integral de errores para las peculiaridades de la API. Para errores 4xx, registre el error.type (por ejemplo, "invalid_request") y reintente con cargas útiles corregidas. Use la biblioteca tenacity para decoradores:

from tenacity import retry, stop_after_attempt, wait_exponential

@retry(stop=stop_after_attempt(3), wait=wait_exponential(multiplier=1, min=4, max=10))

def safe_api_call(prompt):

return client.messages.create(model="claude-opus-4-5-20251101", messages=[{"role": "user", "content": prompt}])

Monitoree el uso de tokens a través de usage en las respuestas: entrada, salida y aciertos de caché. Establezca presupuestos dinámicamente: si la salida excede el 80% de max_tokens, trunque y resuma.

Las mejores prácticas incluyen la ingeniería de prompts con etiquetas XML para la estructura: <thinking>Razona paso a paso</thinking><output>Respuesta final</output>. Esto guía al modelo, especialmente con poco esfuerzo. Además, habilite la seguridad a través de prompts de sistema que impongan pautas éticas.

Para la producción, agrupe las solicitudes para reducir costos: ponga en cola las consultas no urgentes y procéselas de 100 en 100. Almacene en caché las indicaciones frecuentes para un ahorro del 90%. Audite regularmente las salidas para verificar la alineación: Opus 4.5 resiste las inyecciones, pero valide los datos sensibles.

Optimización del rendimiento y el costo

La optimización garantiza un uso sostenible. Perfile las solicitudes con las analíticas de Apidog: rastree la latencia, el gasto de tokens y las tasas de éxito. Identifique los cuellos de botella, como las indicaciones verbosas, y condénselas usando la compactación.

Aproveche el almacenamiento en caché de prompts: etiquete los prefijos reutilizables con cache_control: {"type": "ephemeral"}. En caso de aciertos, pague solo el 25% por las entradas. Para los agentes, persista el caché entre llamadas para mantener el contexto de forma económica.

Escale con patrones asíncronos. En Node.js:

const { Anthropic } = require('@anthropic-ai/sdk');

const anthropic = new Anthropic({ apiKey: process.env.ANTHROPIC_API_KEY });

async function parallelRequests(prompts) {

const promises = prompts.map(p =>

anthropic.messages.create({ model: 'claude-opus-4-5-20251101', messages: [{role: 'user', content: p}] })

);

return Promise.all(promises);

}

Esto maneja eficientemente las bifurcaciones de agentes concurrentes. Con un esfuerzo alto, limite el presupuesto de pensamiento a 32K para controlar los costos sin sacrificar la calidad.

Compare su configuración con los puntos de referencia: Opus 4.5 alcanza el 72.5% en SWE-bench, así que pruebe evaluaciones personalizadas. Ajuste el esfuerzo por tarea: bajo para la ideación, alto para la verificación.

Conclusión

Ahora posee las herramientas para integrar eficazmente la API de Claude Opus 4.5 en su stack. Desde la configuración inicial hasta la orquestación de agentes, esta guía describe un camino para aprovechar sus puntos fuertes en codificación y razonamiento. Recuerde, los pequeños refinamientos, como el almacenamiento en caché o el ajuste del esfuerzo, producen ganancias sustanciales en rendimiento y economía.

Experimente de forma iterativa, utilizando Apidog para validar cada capa. A medida que construya, supervise las actualizaciones de Anthropic para mejoras. En última instancia, Claude Opus 4.5 transforma el desarrollo de un trabajo manual a una inteligencia orquestada. Comience a implementar hoy mismo y observe cómo sus proyectos escalan con precisión.